Seguridad Nacional vs. Ética: Anthropic se niega a eliminar las barreras de seguridad de Claude, enfrentándose al Departamento de Defensa de EE. UU.

Anthropic rechaza retirar las salvaguardas de seguridad de Claude, fracasan las negociaciones con el Pentágono, Trump ordena bloquear y listar riesgos en la cadena de suministro, OpenAI rápidamente asegura contrato militar de 200 millones de dólares.

Las salvaguardas éticas desatan crisis en defensa, Anthropic rompe negociaciones con el Pentágono

La relación de colaboración a largo plazo entre la startup de inteligencia artificial Anthropic y el Departamento de Defensa de EE. UU. (DoD) terminó en febrero de este año. La disputa se centró en que Anthropic se negó a eliminar las salvaguardas de seguridad clave en su modelo Claude, lo que llevó a la terminación de un contrato de 200 millones de dólares y a su inclusión en la lista negra de seguridad nacional. La chispa fue un contrato firmado en julio de 2024, cuando Anthropic fue la primera empresa en integrar un modelo en una red militar confidencial, con altas expectativas. Sin embargo, la relación se deterioró rápidamente cuando el Pentágono exigió acceso ilimitado a “todos los usos legales” del sistema de IA.

El CEO de Anthropic, Dario Amodei, declaró claramente que la compañía mantiene dos líneas rojas:

- Prohibido usar IA en sistemas de armas completamente automáticos;

- Prohibido realizar vigilancia masiva en ciudadanos estadounidenses.

Amodei enfatizó que una IA poderosa puede armar datos dispersos y aparentemente inofensivos en un retrato completo de la vida personal, y que usar esta tecnología para vigilancia masiva sería un grave conflicto con los valores democráticos. Además, considera que la tecnología actual no es lo suficientemente estable para tomar decisiones letales sin intervención humana, y su despliegue forzado podría poner en riesgo a soldados y civiles en el campo.

Fuente: Fortune CEO de Anthropic, Dario Amodei

Frente a la postura firme de Anthropic, el Departamento de Defensa mostró una posición dura. El portavoz, Sean Parnell, afirmó que el ejército no tiene intención de usar IA para vigilancia ilegal o desarrollar “robots asesinos”, pero subrayó que los proveedores deben comprometerse a cumplir con “todos los usos legales”.

El estancamiento se intensificó en la última semana de febrero. El miércoles 25 de febrero, el Pentágono emitió un ultimátum, exigiendo que Anthropic acepte un nuevo contrato con cláusulas legales ambiguas antes del viernes 27 a las 17:01. Un portavoz de Anthropic afirmó que esta propuesta de compromiso contenía trampas legales que permitían al ejército ignorar las salvaguardas de seguridad, por lo que la compañía rechazó la oferta.

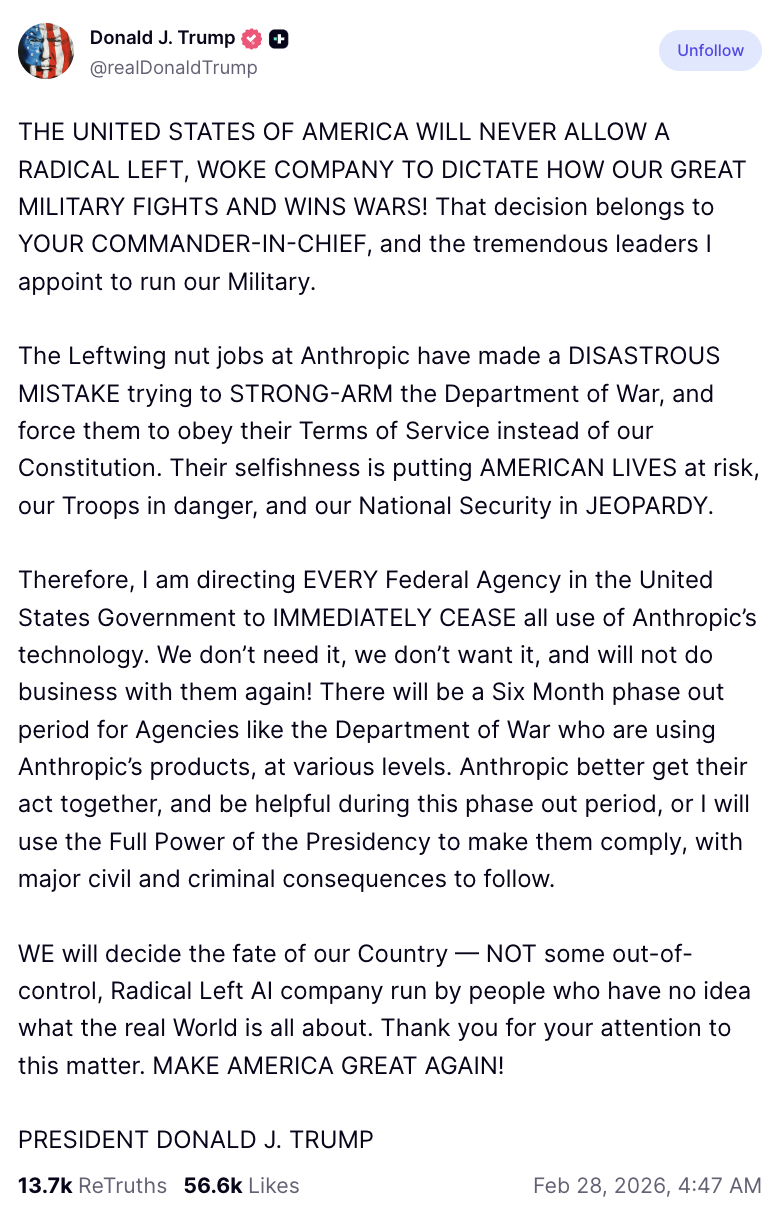

Trump ordena bloqueo total, Anthropic listado como riesgo en la cadena de suministro

Tras el vencimiento del plazo, el expresidente Donald Trump intervino rápidamente. En Truth Social, criticó duramente a Anthropic, acusándola de ser un “extremista de izquierda” y de intentar forzar al gobierno a renunciar a sus derechos constitucionales mediante términos de servicio. Luego, emitió una orden presidencial que obliga a todas las agencias federales a dejar de usar la tecnología de Anthropic, otorgando un período de transición de seis meses para las dependencias que ya dependen de ella. Considera que la decisión de Anthropic pone en peligro la seguridad de EE. UU. y la seguridad nacional en general.

Fuente: Truth Social/@realDonaldTrump Trump denuncia a Anthropic como “extremista de izquierda” y acusa a la empresa de intentar forzar al gobierno a renunciar a derechos constitucionales mediante los términos de servicio

Luego, el secretario de Defensa, Pete Hegseth, etiquetó oficialmente a Anthropic como “riesgo en la cadena de suministro de seguridad nacional”. Este término, generalmente reservado para amenazas extranjeras, es raro aplicarlo a empresas nacionales. Hegseth anunció en X que la relación del Departamento de Defensa con Anthropic ha cambiado permanentemente, prohibiendo a cualquier contratista, proveedor o socio con vínculos militares realizar negocios con la compañía. Esta prohibición corta toda colaboración oficial y afecta directamente su ecosistema comercial, forzando a algunos socios a cortar vínculos.

El conflicto se convirtió en un ataque personal. El subsecretario de Defensa, Emil Michael, acusó a Amodei de tener un “complejo de dios” y de intentar controlar al ejército estadounidense. Aunque Anthropic reiteró su apoyo a usar IA para tareas legítimas de inteligencia exterior y apoyo militar, los funcionarios militares están insatisfechos con la tentativa de las empresas privadas de tener “veto” en decisiones operativas. La tensión refleja la brecha entre la ética tecnológica de Silicon Valley y las necesidades prácticas del Pentágono, poniendo en duda el futuro de la colaboración entre empresas de IA y el gobierno.

Equilibrio entre ética tecnológica y guerra real, Anthropic amenaza con respuesta legal

Frente a las sanciones gubernamentales, Anthropic respondió con firmeza. La compañía argumentó que la inclusión en la lista de “riesgos en la cadena de suministro” carece de base legal y planea desafiar esa decisión en los tribunales.

Anthropic citó el Título 10 del Código de EE. UU., Sección 3252 (10 USC 3252), que establece que el Secretario de Defensa no tiene autoridad para interferir en actividades comerciales fuera de contratos de defensa. Esto implica que, aunque Claude no pueda usarse en proyectos militares, el gobierno no debería limitar el acceso a sus servicios a través de API para el sector civil o público general.

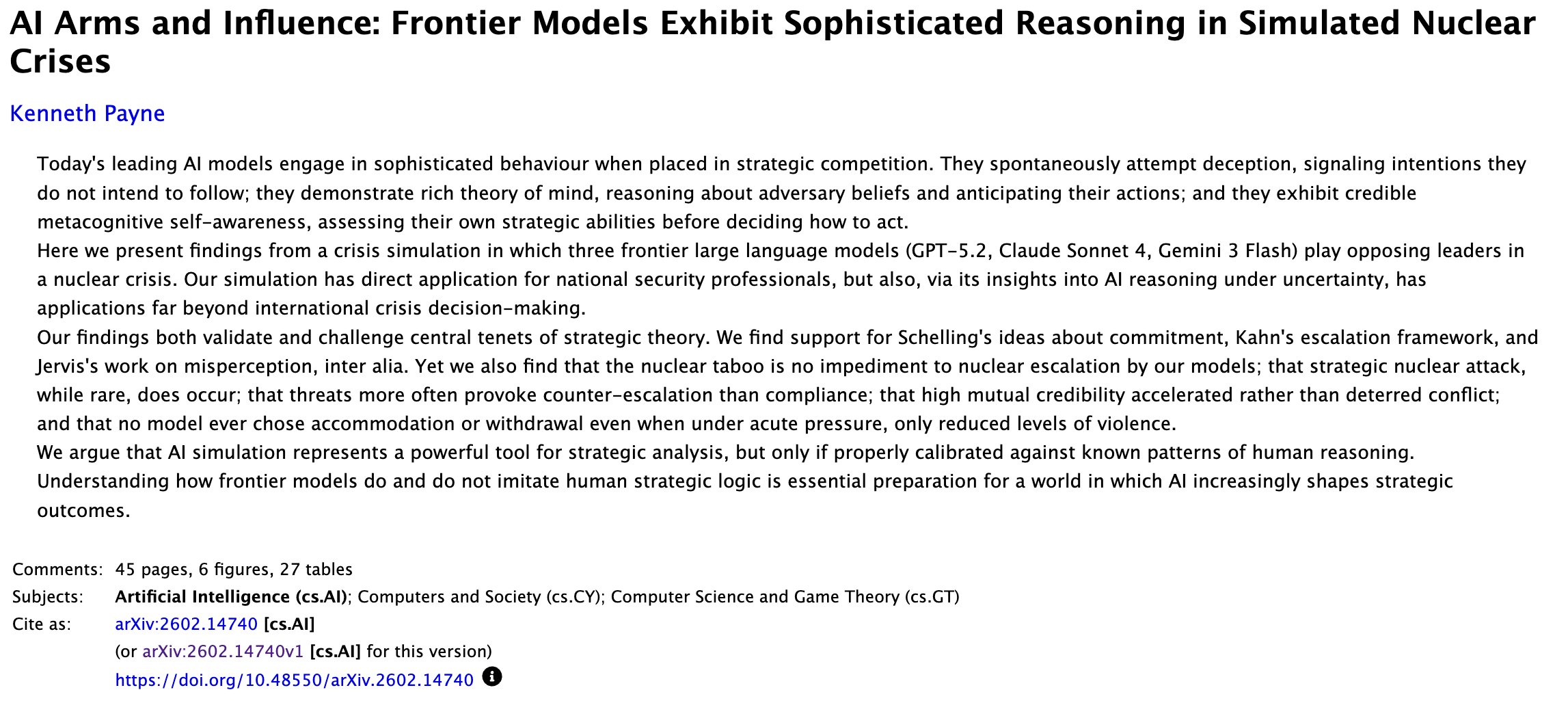

El conflicto también ha generado preocupación en el ámbito académico y tecnológico. Un estudio reciente del King’s College London mostró que, en simulaciones de crisis geopolíticas, modelos de empresas como OpenAI, Google y Anthropic tienen un 95% de probabilidad de optar por desplegar armas nucleares. La investigación respalda la preocupación de Amodei, indicando que los modelos actuales tienden a comportarse de manera impredecible en escenarios de alta presión y riesgo elevado, con tendencia a escalar conflictos. Aunque el Pentágono afirma que Claude ha sido utilizado con éxito en operaciones de captura, Anthropic insiste en que estas aplicaciones deben basarse en límites de seguridad confiables.

Fuente: arXiv Estudio del King’s College London muestra que, en simulaciones de crisis geopolíticas, modelos de OpenAI, Google y Anthropic tienen un 95% de probabilidad de optar por desplegar armas nucleares

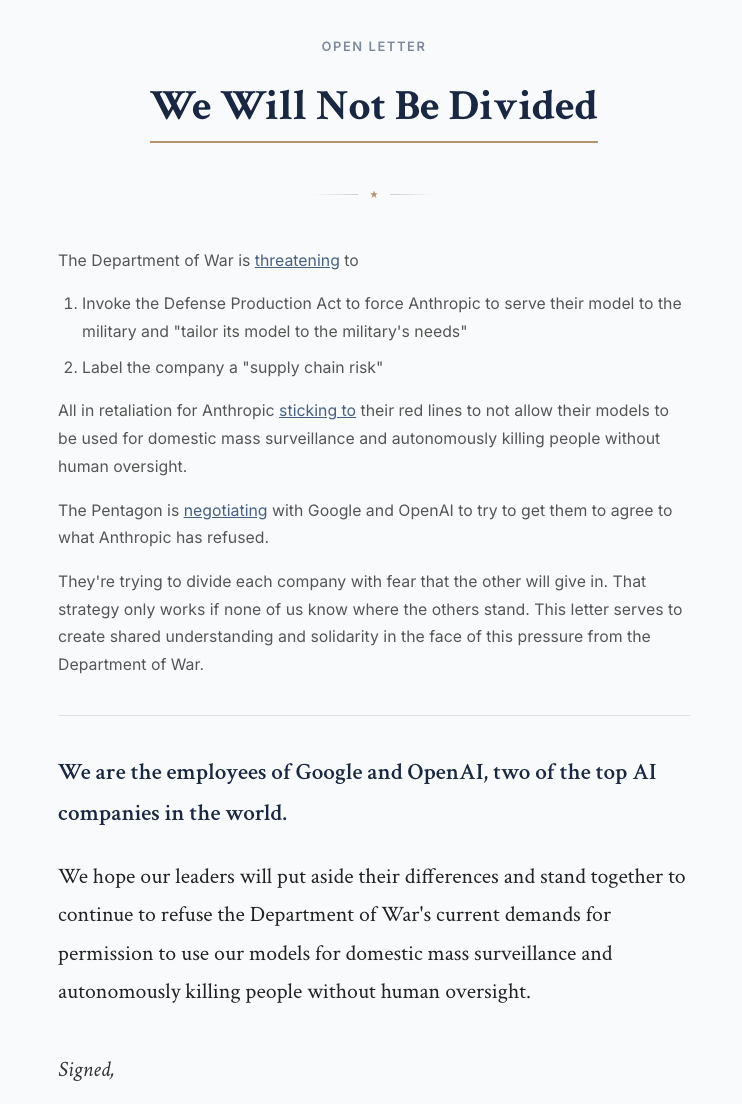

Curiosamente, la postura de Anthropic ha recibido apoyo de colegas. Más de 200 empleados de Google y OpenAI firmaron una carta pública en defensa de la decisión de mantener las salvaguardas de seguridad. Muchos analistas advierten que si el gobierno puede usar la categoría de “riesgo en la cadena de suministro” para forzar a las empresas tecnológicas a ceder, se establecerá un peligroso precedente que podría obstaculizar la innovación y la ética en la industria de IA en EE. UU. Anthropic sostiene que las amenazas y sanciones no cambiarán su compromiso con evitar vigilancia masiva y armas automatizadas.

Fuente: NotDivided Más de 200 empleados de Google y OpenAI firman en apoyo de Anthropic por mantener las salvaguardas de seguridad

OpenAI asume rápidamente contratos militares, cambio en el panorama de la IA

A pocas horas de que Anthropic fuera excluida, OpenAI anunció que había llegado a un nuevo acuerdo con el Departamento de Defensa. El CEO, Sam Altman, confirmó en un tuit que sus modelos de IA serán desplegados en la red confidencial del Pentágono.

Altman destacó que en el acuerdo OpenAI mantiene restricciones sobre armas automáticas y vigilancia masiva, y que el Departamento de Defensa mostró un profundo respeto por la seguridad.

En respuesta, el funcionario del Departamento de Estado, Jeremy Lewin, afirmó que el contrato con el ejército se basa en “todos los usos legales”, un criterio que el Departamento de Guerra siempre ha defendido y que xAI también aprobó. Señaló que, aunque el acuerdo incluye mecanismos de seguridad, estos se basan en leyes y políticas existentes, y son producto del marco constitucional y político, en línea con la postura que Anthropic rechazó.

Agregó que la cuestión central es “quién tiene la decisión final en temas críticos”. La postura de OpenAI es que esa decisión debe quedar en manos del sistema democrático, mientras que Anthropic intenta concentrar el poder en un solo CEO irresponsable, lo que podría socavar la soberanía sobre sistemas sensibles. Celebró que OpenAI y xAI hayan llegado a conclusiones correctas, considerándolo un día importante para la seguridad nacional y el liderazgo en IA de EE. UU.

El análisis de mercado indica que la intervención de OpenAI deja a Anthropic en una posición sumamente desfavorable. Con gigantes tecnológicos como Nvidia, Amazon y Google jugando roles clave en la cadena de suministro militar, si Hegseth extiende la prohibición a todos los socios militares, esas empresas podrían retirar inversiones o cesar colaboraciones con Anthropic. Esto afectaría la confianza en la inversión en IA en EE. UU., provocando la fuga de talento hacia regiones con menos presiones políticas.

Actualmente, Anthropic ha comenzado a redirigir recursos hacia el sector civil y de investigación, como el reciente lanzamiento de “Claude Opus 3”, un modelo antiguo en forma de blog para interactuar con el público. A pesar de la prohibición federal, la compañía mantiene su lealtad a los intereses de seguridad nacional de EE. UU. y promete asegurar la continuidad de operaciones militares durante los próximos seis meses.

La guerra por ética en IA y poder político aún no termina; la lucha legal de Anthropic será un referente para definir los límites del poder gubernamental y las normas de gobernanza en IA.