72 horas, triple crisis: El alma de Anthropic está siendo subastada

Escrito por: Ada, Deep Tide TechFlow

Martes 24 de febrero. Washington, Pentagon.

El CEO de Anthropic, Dario Amodei, está sentado frente al Secretario de Defensa, Pete Hegseth. Según varias fuentes citadas por NPR y CNN, el ambiente de la reunión es “cortés”, pero el contenido no deja lugar a dudas.

Hegseth le dio un ultimátum: antes del viernes a las 17:01, levantar las restricciones militares sobre Claude, permitiendo que el Pentágono lo utilice para “todos los usos legales”, incluyendo la puntería en armas autónomas y la vigilancia masiva en el país.

De lo contrario, cancelarán el contrato de 200 millones de dólares, activarán la Ley de Producción de Defensa, y tomarán medidas de expropiación forzada. Además, incluirán a Anthropic en la lista de “riesgos en la cadena de suministro”, lo que equivale a ponerlo en la lista negra de entidades hostiles de Rusia y China.

El mismo día, Anthropic lanzó la tercera versión de su “Política de Expansión Responsable” (RSP 3.0), eliminando silenciosamente la promesa más fundamental desde su fundación: que no entrenarían modelos más potentes si no garantizaban medidas de seguridad adecuadas.

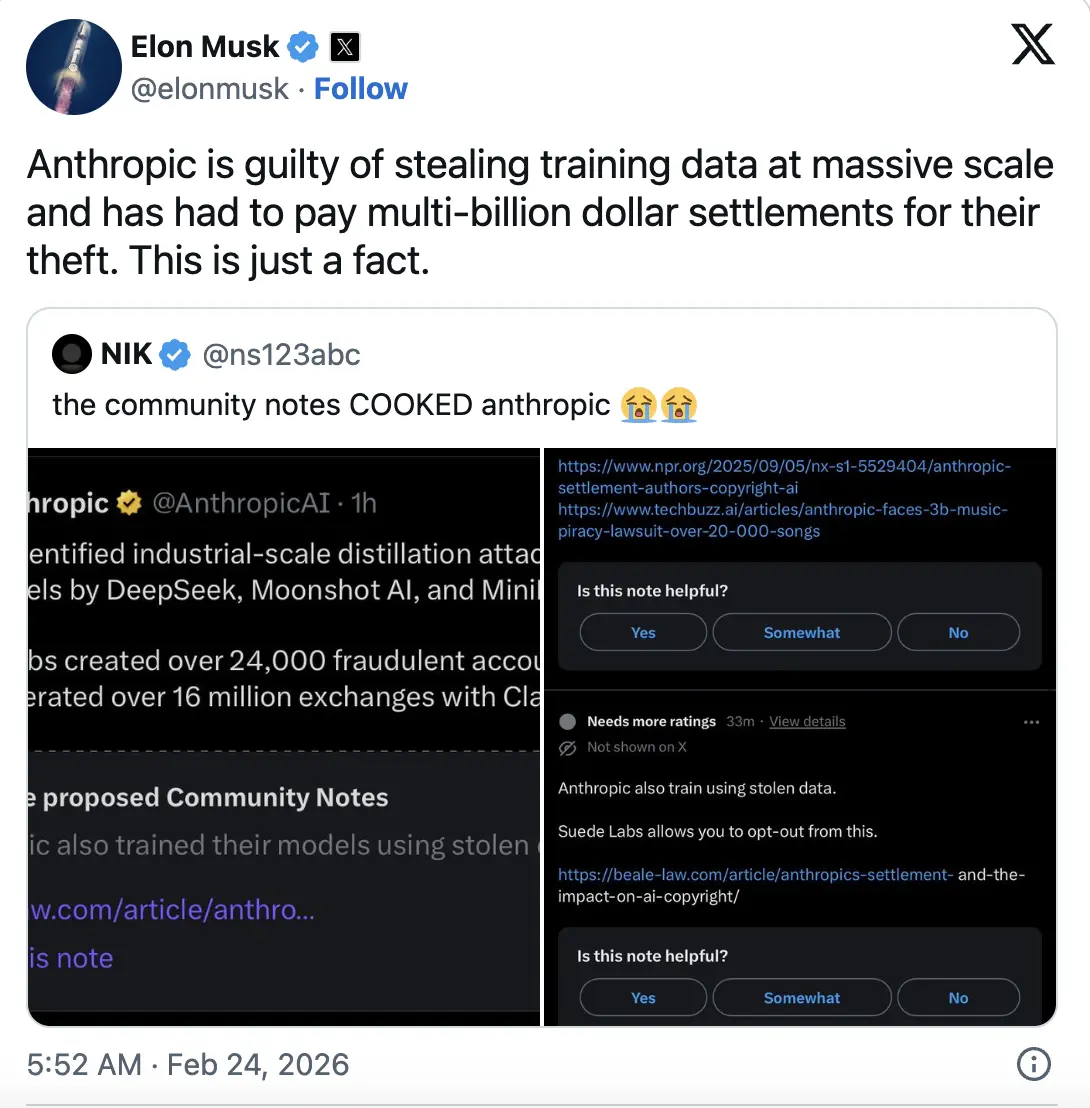

También ese día, Elon Musk publicó en X: “Anthropic está robando datos de entrenamiento a gran escala, eso es un hecho.” Además, la nota comunitaria de X añadió que Anthropic pagó 1.500 millones de dólares en acuerdo por entrenar a Claude con libros pirata.

En 72 horas, esta empresa de IA que se autodenomina “con alma” ha desempeñado tres roles: mártir de la seguridad, ladrón de propiedad intelectual y traidora del Pentágono.

¿Quién es el verdadero?

Quizá todos.

El “o se someten o se van” del Pentágono

La historia en su nivel más simple.

Anthropic fue la primera empresa de IA en obtener acceso confidencial del Departamento de Defensa de EE. UU. El contrato, obtenido el verano pasado, tiene un límite de 200 millones de dólares. Luego, OpenAI, Google y xAI también consiguieron contratos de igual escala.

Según Al Jazeera, Claude fue utilizado en una operación militar en enero de este año, que involucró el secuestro del presidente venezolano Maduro.

Pero Anthropic puso dos líneas rojas: no apoyar armas autónomas completamente, ni vigilancia masiva de ciudadanos estadounidenses. La compañía argumenta que la IA no es confiable para controlar armas, y que actualmente no existen leyes o regulaciones que regulen su uso en vigilancia masiva.

El Pentágono no acepta.

El asesor de IA de la Casa Blanca, David Sacks, acusó públicamente en X en octubre pasado a Anthropic de “utilizar el miedo como arma para controlar la regulación”.

Los competidores ya se rindieron. OpenAI, Google y xAI aceptaron que el ejército utilice su IA en “todos los escenarios legales”. Musk’s Grok acaba de ser aprobado para acceder a sistemas confidenciales esta semana.

Anthropic es el último en mantenerse firme.

Hasta el cierre de esta edición, Anthropic afirmó en un comunicado reciente que no tiene intención de ceder. Pero el plazo del viernes a las 17:01 se acerca rápidamente.

Un ex funcionario anónimo del Departamento de Justicia y Defensa expresó su confusión a CNN: “¿Cómo puede una empresa ser considerada ‘riesgo en la cadena de suministro’ y al mismo tiempo ser obligada a trabajar para el ejército?”

Buena pregunta, pero eso no está en la agenda del Pentágono. Lo que les importa es que, si Anthropic no cede, tomarán medidas forzadas o la descartarán en Washington.

“Ataque de destilación”: una acusación que golpea en la cara

El 23 de febrero, Anthropic publicó un blog con tono enérgico acusando a tres empresas chinas de realizar “ataques de destilación a nivel industrial” contra Claude.

Las acusadas son DeepSeek, Moonshot AI y MiniMax.

Anthropic afirma que estas empresas usaron 24,000 cuentas falsas para realizar más de 16 millones de interacciones dirigidas a extraer las capacidades centrales de Claude en razonamiento, llamadas a herramientas y programación.

La compañía califica esto como una amenaza a la seguridad nacional, alegando que los modelos destilados “probablemente no mantengan las barreras de seguridad” y podrían ser utilizados por gobiernos autoritarios para ciberataques, desinformación y vigilancia masiva.

La narrativa es perfecta, y el momento también.

Justo después de que la administración Trump relajara las restricciones de exportación de chips a China, y cuando Anthropic buscaba argumentos para su lobby contra esas restricciones.

Pero Musk disparó: “Anthropic está robando datos de entrenamiento a gran escala y pagó miles de millones en acuerdos. Eso es un hecho.”

Tory Green, cofundador de la empresa de infraestructura de IA IO.Net, comentó: “¿Ustedes entrenan sus modelos con datos de toda la web, y luego otros usan su API pública para aprender de ustedes? Eso se llama ‘ataque de destilación’.”

Anthropic llama “ataque” a la destilación, pero en la industria de IA es algo común. OpenAI la usó para comprimir GPT-4, Google para optimizar Gemini, y hasta Anthropic lo hace. La diferencia es que ahora la víctima es ella misma.

El profesor de IA de la Universidad Tecnológica de Nanyang en Singapur, Erik Cambria, dijo a CNBC: “La línea entre uso legítimo y uso malicioso suele ser difusa.”

Más irónico aún, es que Anthropic pagó 1.500 millones en acuerdo por entrenar a Claude con libros pirata, y ahora acusa a otros de usar su API pública para aprender de ella. No es doble estándar, es triple.

Anthropic quería jugar a la víctima, pero terminó siendo acusada como acusadora.

El desmontaje de la promesa de seguridad: RSP 3.0

El mismo día en que enfrentaba al Pentágono y se enfrentaba a Silicon Valley, Anthropic lanzó la tercera versión de su Política de Expansión Responsable.

El científico jefe de Anthropic, Jared Kaplan, afirmó en una entrevista: “Creemos que dejar de entrenar modelos de IA no ayuda a nadie. En un contexto de rápido avance de la IA, hacer promesas unilaterales… y que los competidores sigan a toda velocidad, no tiene sentido.”

En otras palabras, si los demás no juegan limpio, nosotros tampoco.

Las versiones 1.0 y 2.0 de RSP contenían una promesa rígida: si el modelo superaba las medidas de seguridad, se detenía el entrenamiento. Esa promesa le otorgó a Anthropic una reputación única en círculos de seguridad de IA.

Pero en la versión 3.0, esa promesa desaparece.

Se reemplaza por un marco más “flexible”: dividir las medidas de seguridad propias y las recomendaciones de seguridad que requieren colaboración de toda la industria en dos vías. Se publicará un informe de riesgos cada 3-6 meses, con revisión de expertos externos.

¿Suena responsable?

Chris Painter, evaluador independiente de la organización sin fines de lucro METR, comentó tras revisar el borrador inicial: “Esto indica que Anthropic cree que necesita entrar en un ‘modo de triaje’, porque los métodos para evaluar y mitigar riesgos no siguen el ritmo del crecimiento de capacidades. Esto más bien demuestra que la sociedad no está preparada para los riesgos potencialmente catastróficos de la IA.”

Según TIME, la compañía dedicó casi un año a discutir internamente esta reescritura, y el CEO Amodei y la junta la aprobaron por unanimidad. La justificación oficial es que la política original buscaba impulsar un consenso en la industria, pero la industria no pudo seguir el ritmo. La administración Trump adoptó una postura de laissez-faire respecto a la IA, e incluso intentó derogar regulaciones estatales. La legislación federal sobre IA sigue sin avanzar. Aunque en 2023 parecía posible establecer un marco global de gobernanza, han pasado tres años y esa puerta parece cerrada.

Un investigador anónimo que sigue de cerca la gobernanza de IA dijo con más crudeza: “RSP es la marca más valiosa de Anthropic. Eliminar la promesa de detener el entrenamiento es como que una marca de alimentos orgánicos arranque silenciosamente las palabras ‘orgánico’ de su envase y diga que ahora sus controles son más transparentes.”

Valoraciones de 380 mil millones y la fractura de identidad

A principios de febrero, Anthropic cerró una ronda de financiación de 30 mil millones de dólares, valorada en 380 mil millones, con Amazon como inversor principal. Desde su fundación, ha logrado ingresos anuales de 14 mil millones de dólares, creciendo más de diez veces en los últimos tres años.

Al mismo tiempo, el Pentágono amenaza con incluirla en la lista negra. Musk la acusa públicamente de robo de datos. Sus compromisos de seguridad se han eliminado. Tras la renuncia del responsable de seguridad de IA, Mrinank Sharma, escribió en X: “El mundo está en peligro.”

¿Contradicciones?

Quizá la contradicción sea parte del ADN de Anthropic.

Fundada por ex ejecutivos de OpenAI, temían que OpenAI avanzara demasiado rápido en seguridad. Luego crearon su propia empresa para construir modelos más potentes a mayor velocidad, y al mismo tiempo, advertían sobre los peligros de esos modelos.

Su modelo de negocio puede resumirse en una frase: somos más temerosos de la IA que nadie, y por eso, deberías pagar para que construyamos IA.

Este relato funcionó a la perfección en 2023-2024. La seguridad en IA fue la palabra de moda en Washington, y Anthropic fue su principal cabildero.

Pero en 2026, cambió el viento.

“IA woke” se convirtió en un insulto, las leyes estatales de regulación de IA fueron bloqueadas por la Casa Blanca, y la ley SB 53 de California, apoyada por Anthropic, fue firmada, pero a nivel federal, nada avanzó.

La estrategia de seguridad de Anthropic, que antes era una ventaja competitiva, ahora se desliza hacia un pasivo político.

La compañía intenta hacer un equilibrio complejo: necesita ser “segura” para mantener su marca, pero también “flexible” para no ser abandonada por el mercado o el gobierno. El problema es que la tolerancia en ambos lados se está reduciendo.

¿Cuánto vale la narrativa de seguridad?

Al juntar estas tres cosas, la imagen queda clara.

Acusar a las empresas chinas de destilar Claude busca reforzar la narrativa de control de exportaciones de chips. Para no perder en la carrera armamentística, eliminaron la promesa de pausa de seguridad. Rechazan la demanda del Pentágono de armas autónomas para mantener su “moralidad”.

Cada paso tiene lógica, pero entre sí son contradictorios.

No puedes decir que las empresas chinas “destilan” tu modelo y que eso pone en riesgo la seguridad nacional, y al mismo tiempo eliminar la promesa de detener el entrenamiento si el modelo se vuelve incontrolable. Si el modelo realmente fuera tan peligroso, deberías ser más cauteloso, no más agresivo.

A menos que seas Anthropic.

En la industria de IA, la identidad no la define tu declaración, sino tu balance. La narrativa de “seguridad” de Anthropic es, en esencia, un valor de marca.

En la carrera armamentística de IA, ese valor era dinero. Los inversores estaban dispuestos a pagar más por “IA responsable”, los gobiernos a aprobar “IA confiable”, y los clientes a pagar por “IA más segura”.

Pero en 2026, ese valor se está evaporando.

Lo que enfrenta Anthropic ahora no es una cuestión de “si cede o no”, sino de “a quién cede primero”. Ceder al Pentágono dañaría su marca. Ceder a la competencia anularía su promesa de seguridad. Ceder a los inversores, significaría sacrificar ambos lados.

El viernes a las 17:01, Anthropic dará su respuesta.

Pero, pase lo que pase, una cosa ya está clara: aquella que alguna vez se apoyó en “somos diferentes a OpenAI”, ahora se está volviendo igual a todos los demás.

El fin de la crisis de identidad, suele ser la desaparición de la identidad misma.