Anthropic acusa a 3 empresas chinas de entrenamiento de IA! Los usuarios critican la doble moral: ustedes también roban derechos de autor

Anthropic acusa a tres empresas chinas de IA, DeepSeek, Moonshot AI y Min, de copiar sus capacidades de modelos mediante técnicas de destilación. Esta acción fue criticada por usuarios en línea, quienes la calificaron como una violación de derechos de autor, y también generó un intenso debate en Estados Unidos sobre la exportación de chips y la seguridad nacional.

Anthropic acusa a 3 laboratorios chinos de IA de entrenamiento mediante destilación, para obtener capacidades avanzadas de modelos

El desarrollador del chatbot de IA Claude, Anthropic, ha declarado públicamente que las tres empresas chinas DeepSeek, Moonshot AI y MiniMax, establecieron más de 24,000 cuentas falsas para acceder y comunicar con el modelo Claude en más de 16 millones de ocasiones, y utilizaron técnicas de destilación para transferir las capacidades centrales de Claude a sus propios modelos.

La “destilación” es una técnica común en entrenamiento de IA, que consiste en evaluar la calidad de las respuestas generadas por modelos más antiguos, grandes o maduros, para que modelos más pequeños y económicos puedan aprender y transferir los resultados computacionales de los modelos grandes.

Originalmente, la destilación era una técnica legal utilizada en la industria de IA para crear modelos ligeros para clientes, pero los competidores también pueden usarla para copiar directamente los resultados de investigación de otros laboratorios.

Anthropic señala que, estas tres empresas chinas usaron servidores proxy para evadir detecciones, y recopilaron en gran escala las capacidades de inferencia proxy, uso de herramientas y programación de Claude, que son sus principales diferencias.

Fuente de la imagen: X Anthropic acusa a 3 empresas chinas de IA de entrenamiento mediante destilación, para obtener capacidades avanzadas de modelos

Críticas en línea: doble estándar y controversia por demandas por derechos de autor

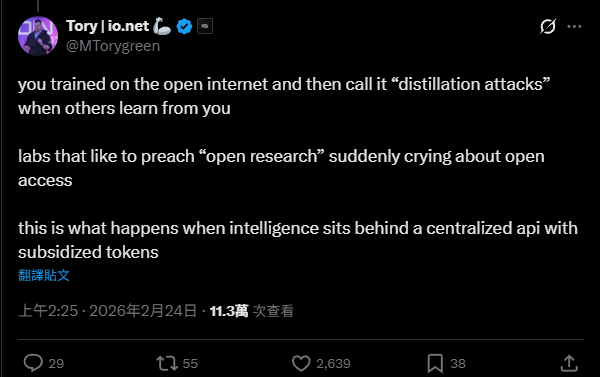

Sin embargo, tras la declaración de Anthropic, se generaron muchas burlas y dudas en línea, con algunos usuarios señalando que la postura de Anthropic respecto a las técnicas de entrenamiento de modelos muestra un doble estándar.

Tory Green, cofundador de la empresa de infraestructura de IA IO.Net, criticó en un tuit que las empresas de IA entrenan con datos públicos, pero cuando otros aprenden de ellas, lo llaman ataque de destilación. Anthropic, que suele promover la investigación abierta, ahora se queja por el acceso abierto.

En 2025, Reddit, un foro muy conocido en EE.UU., presentó una demanda contra Anthropic, acusando a la compañía de recopilar sin autorización más de 100,000 publicaciones y comentarios del foro para ajustar el modelo Claude. Reddit afirmó que Anthropic violó los términos de uso, y que incluso después de anunciar públicamente que había detenido la recopilación, continuó accediendo a los servidores de Reddit más de 100,000 veces.

Además, Anthropic enfrenta una demanda colectiva por usar ilegalmente 7 millones de libros para entrenar su modelo Claude, y en septiembre del año pasado acordó pagar hasta 1.5 mil millones de dólares en un acuerdo, el mayor monto en la historia de EE.UU. por derechos de autor, aunque aún debe ser aprobado por la corte.

- Reportajes relacionados:****¡El mayor caso de compensación en la historia de IA! Entrenamiento con libros pirateados de Claude, acuerdo de 48 mil millones, autores taiwaneses también reciben compensación

OpenAI también advierte sobre DeepSeek

Además de Anthropic, el gigante de IA OpenAI también enfrenta una situación similar.

Según un memorando interno visto la semana pasada por Reuters, OpenAI ha advertido a legisladores estadounidenses que DeepSeek está intentando copiar sus modelos y usarlos para entrenar sus propios algoritmos, apuntando a desarrolladores de ChatGPT y a la principal empresa de IA en EE.UU.

OpenAI ha detectado cuentas relacionadas con empleados de DeepSeek que desarrollan métodos para evadir las restricciones de acceso de OpenAI. Utilizan enrutadores de terceros confusos y otras fuentes ocultas para acceder de forma programada a modelos de IA en EE.UU., y obtener resultados para realizar destilación.

Controversia sobre técnicas de destilación en IA china, en un momento en que EE.UU. relaja controles de exportación de chips

Mientras las empresas de IA en EE.UU. acusan a China de usar técnicas de destilación para entrenar modelos, el país enfrenta un debate sensible sobre la política de exportación de chips a China, en un momento en que la administración Trump en enero permitió oficialmente a empresas estadounidenses como Nvidia exportar chips avanzados como el H200 a China.

Los críticos argumentan que, en un momento clave de la competencia global por el liderazgo en IA, relajar los controles de exportación aumentará significativamente la capacidad de China en cálculos de IA.

Dmitri Alperovitch, presidente del think tank Silverado Policy Accelerator, afirmó que el rápido avance de los modelos de IA chinos se debe en parte a la apropiación de modelos estadounidenses mediante técnicas de destilación. Estas evidencias refuerzan la necesidad de que EE.UU. se niegue a vender chips de IA a estas empresas, para no ampliar su ventaja.

Anthropic advierte que los sistemas de IA creados por empresas estadounidenses tienen mecanismos de protección para evitar que actores estatales o no estatales utilicen IA para desarrollar armas biológicas o realizar actividades maliciosas en internet. Sin embargo, los modelos de IA construidos mediante destilación suelen carecer de estas medidas de seguridad.

Anthropic teme que, si laboratorios extranjeros de IA logran integrar estas capacidades sin restricciones en sistemas militares y de inteligencia, los gobiernos autoritarios podrán usar IA para realizar ataques cibernéticos, campañas de desinformación y vigilancia masiva, aumentando exponencialmente los riesgos de seguridad.

Lectura adicional:

¡Hackers chinos lanzan un ataque masivo de IA! Anthropic: velocidad y escala de los hackers de IA ya superan a los humanos