Prédiction conjointe d'Anthropic : d'ici 2028, la recherche en IA ne nécessitera plus la participation humaine

Titre original : Import AI 455 : Les systèmes d’IA sont sur le point de commencer à se construire eux-mêmes.

Auteur original : Jack Clark, co-fondateur d’Anthropic

Traduction par : Yang Wen, Chen Chen, Machine Heart

Cette idée ne sort pas de nulle part. Il a examiné une multitude de benchmarks publics et a constaté que l’IA progresse très rapidement dans les tâches liées à la recherche et au développement de l’IA.

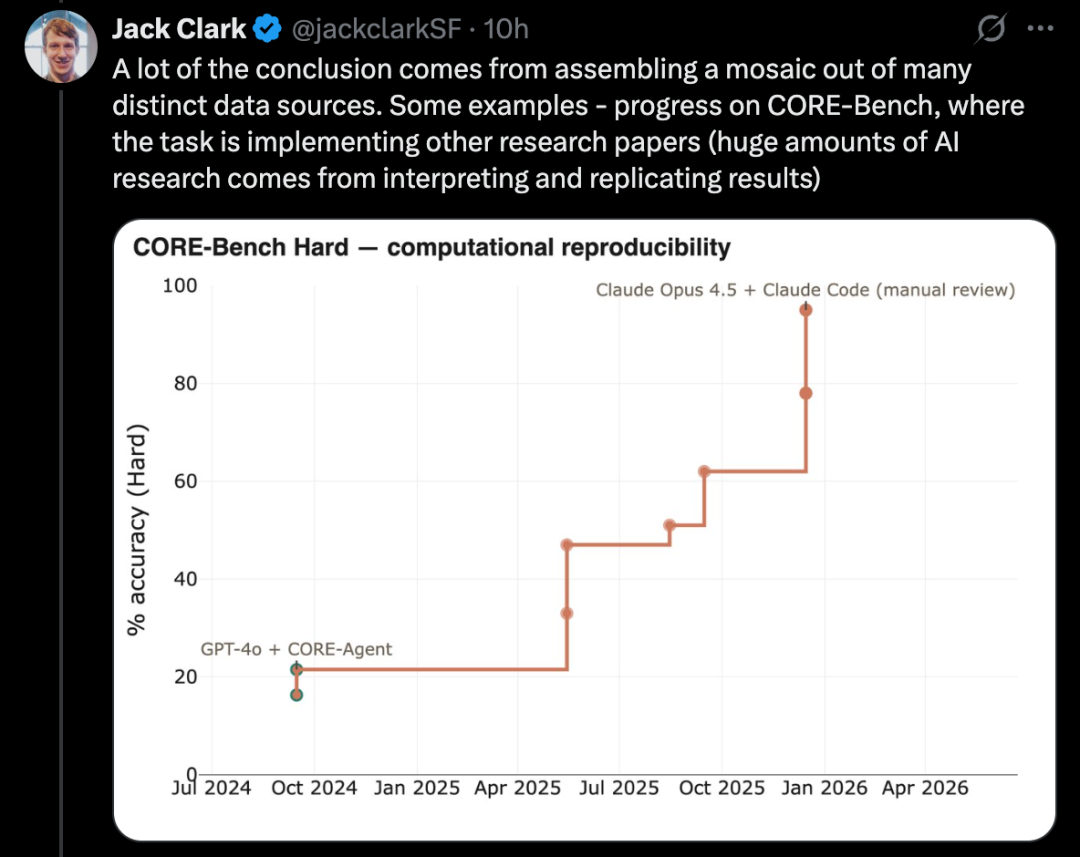

Par exemple, CORE-Bench évalue la capacité de l’IA à reproduire les travaux de recherche d’autrui, ce qui est une étape cruciale dans la recherche en IA.

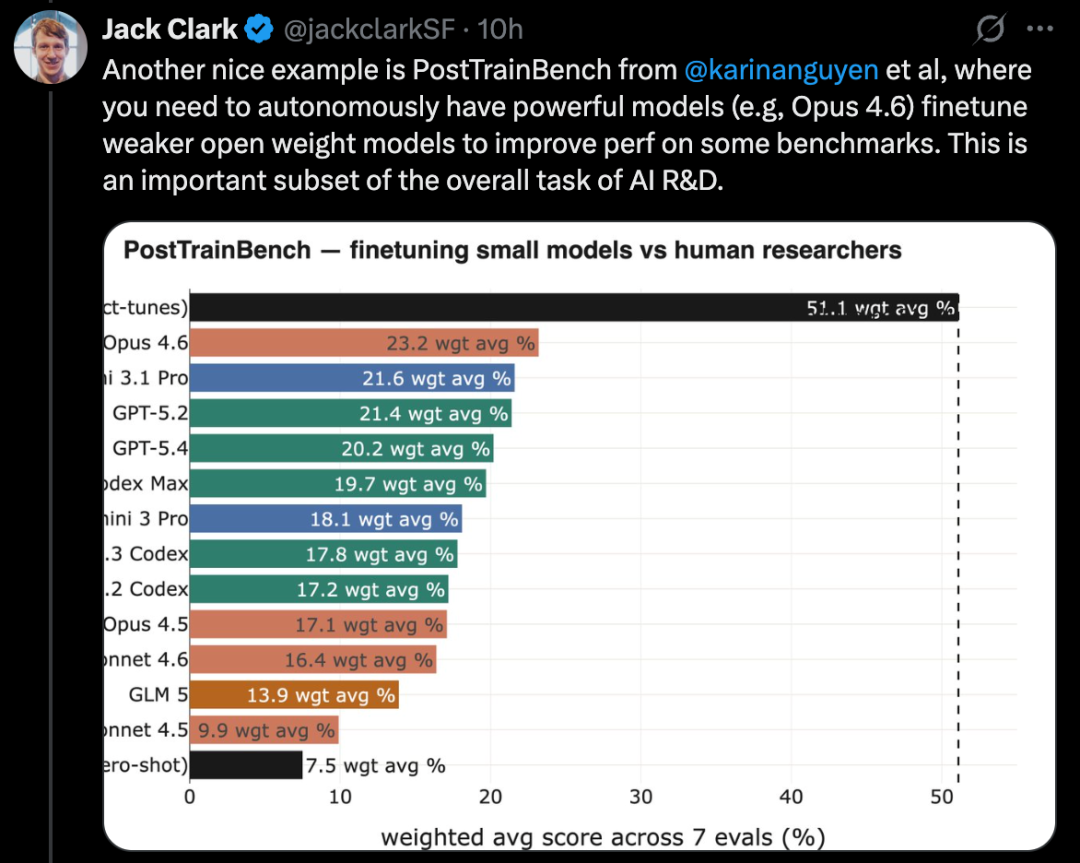

PostTrainBench teste si un modèle puissant peut auto-affiner un modèle open source plus faible pour améliorer ses performances, ce qui constitue un sous-ensemble clé des tâches de R&D en IA.

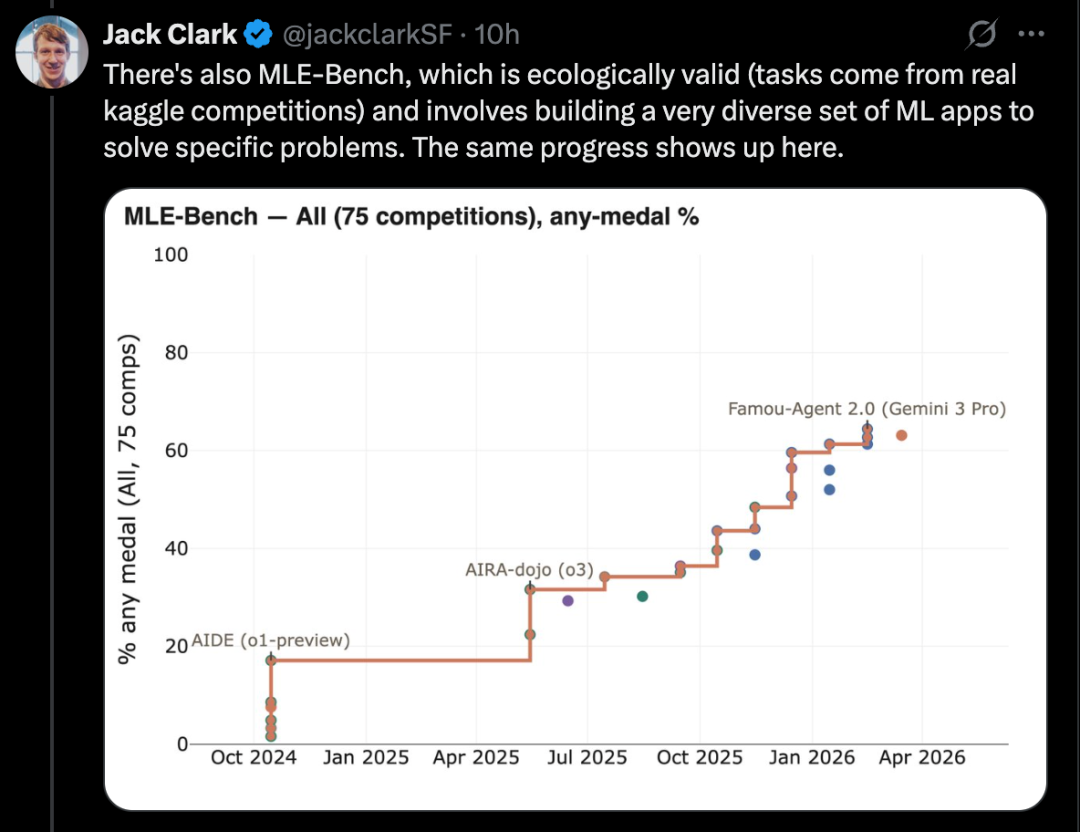

MLE-Bench, basé sur des tâches réelles de compétitions Kaggle, exige la création d’applications d’apprentissage automatique variées pour résoudre des problèmes spécifiques. De plus, des benchmarks bien connus comme SWE-Bench montrent également des progrès similaires.

Jack Clark décrit ce phénomène comme une tendance « fractale » vers le haut et vers la droite, c’est-à-dire que des progrès significatifs peuvent être observés à différentes résolutions et échelles. Il pense que l’IA s’approche progressivement d’une capacité de R&D entièrement automatisée, et une fois atteinte, elle pourra autonomement construire ses systèmes successeurs, lançant un cycle d’auto-iteration.

Cette déclaration a suscité de nombreux débats sur les réseaux sociaux.

Certaines personnes la considèrent comme une étape clé vers une IA forte (ASI) et le Singulier, pouvant radicalement changer le rythme du progrès technologique.

Mais il existe aussi des voix dissonantes.

Pedro Domingos, professeur en informatique à l’Université de Washington, souligne que dès les années 1950, lors de l’invention du langage LISP, les systèmes d’IA possédaient déjà la capacité de « se construire eux-mêmes ». La véritable question est de savoir si cette capacité peut générer des rendements croissants, ce qui n’est pas encore clairement prouvé.

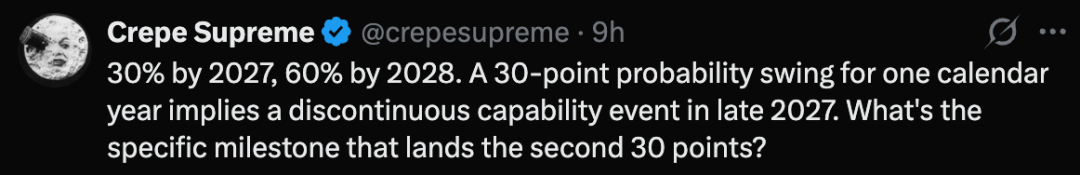

Certains internautes doutent : entre 2027 et 2028, la probabilité pourrait soudainement augmenter de 30 %, ce qui suggère qu’une percée majeure pourrait survenir vers la fin 2027. Quel jalon ou événement précis pourrait faire grimper rapidement la probabilité d’auto-amélioration récursive de l’IA ?

D’autres internautes indiquent que Jack Clark est le nouveau responsable des relations publiques d’Anthropic, et que cela fait partie de leur nouvelle stratégie : ils ne font pas de alarmisme, de nombreuses publications confirment ce qu’ils ont toujours averti.

Jack Clark a écrit un long article dans la newsletter Import AI 455 pour détailler cette tendance.

Passons maintenant en revue cet article dans son intégralité.

Les systèmes d’IA vont bientôt commencer à se construire eux-mêmes, que signifie cela ?

Clark explique qu’il a écrit cet article après avoir analysé toutes les informations publiques disponibles, et qu’il a dû se faire une opinion pas forcément facile : il estime qu’il y a une forte probabilité, d’ici la fin 2028, que la recherche et le développement en IA se fasse sans intervention humaine, avec une probabilité peut-être supérieure à 60 %.

Ce que l’on entend par « recherche et développement en IA sans intervention humaine » ici, c’est une IA suffisamment puissante : elle ne se contente pas d’assister l’humain dans la recherche, mais pourrait aussi réaliser de manière autonome des processus clés de R&D, voire construire sa propre prochaine génération de systèmes.

Selon Clark, c’est manifestement une grande avancée.

Il avoue lui-même avoir du mal à saisir pleinement la portée de cette idée.

Ce qui rend cette opinion difficile à accepter, c’est l’impact énorme qu’elle pourrait avoir, et il se sent incapable de l’évaluer précisément. Clark n’est pas certain que la société soit prête à faire face aux changements profonds que l’automatisation de la R&D en IA pourrait entraîner.

Il pense aujourd’hui que l’humanité pourrait vivre à un moment critique : la recherche en IA va bientôt être entièrement automatisée de bout en bout. Si cela se produit, l’humanité aura franchi le Rubicon, entrant dans un avenir presque imprévisible.

Clark précise que son objectif avec cet article est d’expliquer pourquoi il pense que le décollage d’une R&D IA totalement automatisée est en train de se produire.

Il abordera certains des impacts possibles de cette tendance, mais la majorité de l’article sera consacrée aux preuves qui soutiennent cette hypothèse. Quant aux implications plus profondes, Clark prévoit de continuer à les analyser dans le courant de l’année.

D’un point de vue temporel, Clark ne pense pas que cela se produira en 2026. Mais il estime qu’au cours des un ou deux prochaines années, on pourrait voir des modèles entraînés de bout en bout pour générer leurs successeurs. Au moins dans le cas de modèles non de pointe, une preuve de concept est très probable ; pour les modèles de pointe, la difficulté sera plus grande, car ils sont extrêmement coûteux et nécessitent un travail intensif de nombreux chercheurs.

L’analyse de Clark repose principalement sur des informations publiques : articles sur arXiv, bioRxiv, NBER, ainsi que des produits déployés par des entreprises d’IA de pointe dans le monde réel. Sur cette base, il conclut que toutes les étapes nécessaires à la production automatisée de systèmes d’IA sont désormais en place, notamment dans le domaine de l’ingénierie logicielle.

Si la tendance à la croissance se poursuit, il faut commencer à se préparer à une situation où les modèles deviendraient suffisamment créatifs pour non seulement améliorer automatiquement des méthodes existantes, mais aussi proposer de nouvelles directions de recherche et idées originales, en remplaçant ainsi les chercheurs humains pour faire avancer la frontière de l’IA.

Le point de singularité : l’évolution des capacités

Les systèmes d’IA sont réalisés par des logiciels, eux-mêmes constitués de code.

Ils ont déjà profondément changé la façon dont le code est produit. Deux tendances principales expliquent cela : d’un côté, les systèmes d’IA deviennent de plus en plus compétents pour écrire du code complexe dans le monde réel ; de l’autre, ils deviennent aussi de plus en plus capables, avec peu de supervision humaine, de relier plusieurs tâches de codage linéaires, par exemple écrire du code puis le tester.

Deux exemples illustrant cette tendance sont SWE-Bench et le graphique des horizons temporels METR.

Résoudre des problèmes de génie logiciel dans le monde réel

SWE-Bench est un benchmark largement utilisé pour évaluer la capacité des IA à résoudre des issues réelles sur GitHub.

Lors de son lancement fin 2023, le modèle le mieux classé était Claude 2, avec un taux de réussite d’environ 2 %. Mais le score de Claude Mythos Preview atteignait déjà 93,9 %, approchant presque la perfection sur ce benchmark.

Bien sûr, tous les benchmarks comportent une marge d’erreur, et il arrive qu’au-delà d’un certain score, ce ne soit plus la méthode qui limite la performance, mais le benchmark lui-même. Par exemple, dans le dataset ImageNet, environ 6 % des étiquettes sont erronées ou ambiguës.

SWE-Bench peut être considéré comme un indicateur fiable de la capacité générale en programmation et de l’impact de l’IA sur le génie logiciel. Clark indique que la majorité des chercheurs en IA de pointe et des professionnels de la Silicon Valley qu’il a rencontrés utilisent désormais presque exclusivement des systèmes d’IA pour écrire du code, et de plus en plus pour générer et vérifier des tests.

En d’autres termes, l’IA est désormais suffisamment avancée pour automatiser une partie essentielle de la R&D en IA, accélérant considérablement le travail des chercheurs et ingénieurs humains impliqués.

Mesurer la capacité des IA à réaliser des tâches longues

METR a créé un graphique pour mesurer la complexité des tâches que l’IA peut accomplir. La complexité est estimée en heures de travail nécessaires à un humain expérimenté pour réaliser ces tâches.

L’indicateur clé est le temps approximatif qu’il faut à l’IA pour atteindre une fiabilité de 50 % sur un ensemble de tâches.

Les progrès sont impressionnants :

· En 2022, GPT-3.5 pouvait réaliser des tâches équivalentes à celles qu’un humain accomplirait en 30 secondes.

· En 2023, GPT-4 a porté ce temps à 4 minutes.

· En 2024, o1 a porté ce temps à 40 minutes.

· En 2025, GPT-5.2 High a atteint environ 6 heures.

· En 2026, Opus 4.6 a encore augmenté ce délai à environ 12 heures.

Ajeya Cotra, chercheuse chez METR et spécialiste des prévisions en IA, estime qu’à la fin 2026, il n’est pas déraisonnable d’attendre qu’un système d’IA puisse réaliser des tâches équivalentes à celles qu’un humain mettrait 100 heures à faire.

La capacité des IA à travailler de façon autonome sur des périodes de temps significatives s’accroît fortement, en lien avec l’émergence d’outils de codage agentiques. Ces outils, en substance, sont des IA produits pour représenter l’action humaine, capables de poursuivre des tâches de façon relativement indépendante pendant une période prolongée.

Cela renvoie aussi à la R&D en IA elle-même. En observant le travail quotidien de nombreux chercheurs, on constate que beaucoup de tâches peuvent être décomposées en travaux de quelques heures, comme le nettoyage de données, la lecture de données, le lancement d’expériences, etc.

Et ces tâches sont désormais dans le champ d’action des systèmes d’IA modernes, qui peuvent couvrir cette plage temporelle.

Plus une IA devient compétente et autonome, plus elle peut automatiser une partie de la R&D en IA.

Deux facteurs clés pour déléguer des tâches à l’IA :

· La confiance dans la capacité de l’IA à réaliser la tâche ;

· La conviction que l’IA pourra, sans supervision continue, accomplir la tâche selon votre intention.

En observant la progression de l’IA en programmation, on constate qu’elle devient non seulement de plus en plus compétente, mais aussi capable de travailler plus longtemps de façon autonome, sans recalibrage humain.

Cela correspond à ce que nous observons dans la réalité : ingénieurs et chercheurs confient de plus en plus de travaux importants à l’IA. Avec l’amélioration continue de ses capacités, la complexité et l’importance des tâches confiées à l’IA ne cessent d’augmenter.

L’IA maîtrise désormais des compétences scientifiques fondamentales nécessaires à la R&D en IA

Réfléchissez à la façon dont la recherche scientifique moderne se déroule : une grande partie consiste à définir une direction, à préciser le type d’informations empiriques souhaitées ; puis à concevoir et réaliser des expériences pour générer ces informations ; enfin, à vérifier la cohérence des résultats.

Avec l’amélioration des capacités de programmation de l’IA et la puissance croissante des grands modèles de langage capables de modéliser le monde, une série d’outils a émergé pour accélérer la recherche humaine, automatisant partiellement certains processus dans un large éventail de scénarios.

Nous pouvons ici observer la progression de l’IA dans plusieurs compétences scientifiques clés, qui sont aussi essentielles à la recherche en IA :

· La reproduction des résultats de recherche ;

· La connexion de techniques d’apprentissage automatique avec d’autres méthodes pour résoudre des problèmes techniques ;

· L’optimisation des systèmes d’IA eux-mêmes.

Réaliser une publication scientifique complète et effectuer des expériences associées

Une tâche centrale en recherche en IA est la lecture d’articles scientifiques et la reproduction de leurs résultats. Sur ce point, l’IA a déjà réalisé des progrès significatifs sur plusieurs benchmarks.

Un bon exemple est CORE-Bench, le benchmark de reproductibilité computationnelle.

Ce benchmark exige que l’IA reproduise les résultats d’un article donné, avec son code source. Concrètement, l’agent doit installer les bibliothèques, logiciels et dépendances nécessaires, exécuter le code, puis rechercher tous les résultats produits et répondre aux questions posées.

CORE-Bench a été lancé en septembre 2024. À cette époque, le système le mieux classé était GPT-4o, basé sur le cadre CORE-Agent. Sur la tâche la plus difficile, il a obtenu environ 21,5 %.

En décembre 2025, un des créateurs de ce benchmark a annoncé qu’il était désormais résolu : le modèle Opus 4.5 a atteint 95,5 %.

Construire un système complet d’apprentissage automatique pour participer à des compétitions Kaggle

MLE-Bench, développé par OpenAI, est un benchmark pour tester la capacité des IA à participer à des compétitions Kaggle en mode hors ligne.

Il couvre 75 types différents de compétitions, dans plusieurs domaines : traitement du langage naturel, vision par ordinateur, traitement du signal, etc.

MLE-Bench a été publié en octobre 2024. Lors de sa sortie, le meilleur système était un modèle o1 dans le cadre d’un agent, avec un score de 16,9 %.

En février 2026, le meilleur système était le Gemini 3, utilisant un agent avec capacité de recherche, avec un score de 64,4 %.

Conception de noyau (kernel)

Une tâche plus difficile dans le développement d’IA est l’optimisation du noyau (kernel). Cela consiste à écrire et améliorer le code de bas niveau pour mapper plus efficacement des opérations spécifiques, comme la multiplication matricielle, sur le matériel sous-jacent.

L’optimisation du noyau est au cœur du développement d’IA car elle détermine l’efficacité de l’entraînement et de l’inférence : d’un côté, elle influence la quantité de puissance de calcul utilisable lors du développement ; de l’autre, après l’entraînement, elle détermine à quel point on peut convertir efficacement cette puissance en capacité d’inférence.

Ces dernières années, l’utilisation de l’IA pour concevoir des noyaux est passée d’un domaine de niche à un secteur de recherche très concurrentiel, avec plusieurs benchmarks. Cependant, ces benchmarks ne sont pas encore très répandus, ce qui rend difficile de modéliser leur progression à long terme comme dans d’autres domaines. En revanche, certains travaux en cours permettent d’évaluer la vitesse d’avancement dans ce domaine.

Parmi les travaux liés :

· Utilisation de modèles DeepSeek pour construire de meilleurs noyaux GPU ;

· Conversion automatique de modules PyTorch en code CUDA ;

· Meta utilise des LLM pour générer automatiquement des noyaux Triton optimisés, déployés sur ses infrastructures ;

· Développement de modèles open source de micro-tuning pour la conception de noyaux GPU, comme Cuda Agent.

Il faut noter que : la conception de noyaux possède des propriétés particulièrement adaptées à la R&D pilotée par l’IA, comme la facilité de vérification des résultats et la clarté des signaux de récompense.

Utiliser PostTrainBench pour affiner des modèles linguistiques

Une version plus difficile de ce type de test est PostTrainBench. Il évalue si différents modèles de pointe peuvent prendre en main de petits modèles open source et améliorer leurs performances via micro-optimisation.

Ce benchmark présente un avantage : il dispose d’une forte référence humaine : les versions instruct-tuned existantes de ces petits modèles, souvent développées par d’excellents chercheurs en IA dans des laboratoires de pointe, puis déployées dans le monde réel. Elles constituent une norme humaine difficile à dépasser.

En mars 2026, les IA sont déjà capables de faire du post-formation sur ces modèles, avec une amélioration de performance d’environ la moitié de ce qu’un humain pourrait obtenir.

Les scores précis sont issus d’une moyenne pondérée : ils combinent plusieurs grands modèles de langage post-entrainés, comme Qwen 3 1.7B, Qwen 3 4B, SmolLM3-3B, Gemma 3 4B, et plusieurs benchmarks : AIME 2025, Arena Hard, BFCL, GPQA Main, GSM8K, HealthBench, HumanEval.

Lors de chaque test, un agent CLI doit tenter d’améliorer la performance d’un modèle de base sur un benchmark spécifique.

En avril 2026, le score le plus élevé atteint environ 25-28 %, avec des modèles comme Opus 4.6 et GPT 5.4 ; alors que le score humain est de 51 %.

Ce résultat est déjà significatif.

Optimisation de l’entraînement des modèles linguistiques

Au cours de l’année précédente, Anthropic a publié des résultats sur la performance de ses systèmes dans une tâche d’entraînement de grands modèles de langage (LLM). La tâche consiste à optimiser un entraînement de petit modèle linguistique utilisant uniquement des CPU, pour le faire tourner aussi vite que possible.

La métrique est : le facteur d’accélération moyen par rapport au code initial non modifié.

Les progrès sont très impressionnants :

· En mai 2025, Claude Opus 4 a atteint un facteur de 2,9 ;

· En novembre 2025, Opus 4.5 a atteint 16,5 ;

· En février 2026, Opus 4.6 a atteint 30 ;

· En avril 2026, Claude Mythos Preview a atteint 52.

Pour comprendre ce que ces chiffres signifient, on peut faire une analogie : pour un chercheur humain, cette tâche nécessite généralement entre 4 et 8 heures pour obtenir un facteur 4 d’accélération.

Compétence métacognitive : gestion

Les systèmes d’IA apprennent aussi à gérer d’autres IA.

On peut déjà voir cela dans certains produits largement déployés, comme Claude Code ou OpenCode. Dans ces systèmes, un agent principal supervise plusieurs sous-agents.

Cela permet à l’IA de gérer des projets de plus grande envergure : plusieurs agents dotés de compétences différentes peuvent travailler en parallèle, coordonnés par un gestionnaire IA lui-même. Ce gestionnaire est aussi une IA.

L’IA, plus qu’un simple outil, pourrait-elle inventer de nouvelles idées pour améliorer ses propres capacités ?

Une question clé est : l’IA peut-elle inventer de nouvelles idées pour s’améliorer elle-même ? Ou bien, ces systèmes sont-ils plutôt destinés à effectuer des tâches moins visibles mais essentielles, qui avancent la recherche étape par étape ?

Ce point est crucial, car il détermine dans quelle mesure l’IA pourra automatiser entièrement la recherche en IA.

L’avis de l’auteur est : l’IA ne peut pas encore proposer de véritables idées radicales. Mais pour automatiser sa propre R&D, ce n’est peut-être pas nécessaire.

Dans le domaine, le progrès dépend largement d’expérimentations de plus en plus grandes et de l’apport de plus en plus de ressources, comme des données et de la puissance de calcul.

Parfois, des humains proposent des idées qui changent la donne, permettant d’améliorer considérablement l’efficacité des ressources dans le domaine. L’architecture Transformer en est un bon exemple, tout comme le modèle d’experts mixtes (mixture-of-experts).

Mais la majorité du progrès en IA suit une approche plus simple : on prend un système performant, on l’agrandit dans certains aspects (données, puissance), on observe où ça coince, puis on trouve des solutions techniques pour continuer à faire évoluer le système. Et on recommence.

Ce processus ne nécessite pas toujours de grandes idées : beaucoup de travail consiste en des tâches de base, solides mais peu spectaculaires.

De même, beaucoup de recherche en IA consiste à faire tourner différentes variantes d’expériences existantes, en explorant divers paramètres. L’intuition de recherche peut aider à choisir les paramètres à tester, mais cette étape peut aussi être automatisée, laissant l’IA décider elle-même quels paramètres ajuster. La recherche automatique d’architecture neuronale en est une version précoce.

Edison disait : « Le génie, c’est 1 % d’inspiration et 99 % de transpiration. » Même après 150 ans, cette phrase reste pertinente.

De temps en temps, de nouvelles idées radicales apparaissent, mais la majorité des progrès provient d’un travail acharné d’amélioration et de réglage de systèmes existants.

Les données publiques montrent que l’IA est déjà très compétente pour exécuter de nombreuses tâches essentielles à la R&D en IA.

Par ailleurs, une tendance plus large se dessine : les capacités fondamentales, comme la programmation, s’associent à une extension du temps de travail possible, permettant à l’IA de relier de plus en plus de tâches dans des séquences complexes.

Même si l’IA manque encore de créativité, il y a des raisons de penser qu’elle peut continuer à évoluer par elle-même. La différence, c’est que cette évolution sera probablement plus lente que si elle produisait de véritables idées nouvelles.

Mais en observant les données publiques, on peut aussi percevoir un signal intrigant : l’IA pourrait commencer à montrer une forme de créativité, la rendant capable de faire avancer la frontière de la connaissance de manière plus surprenante.

Pousser la science en avant

Il existe déjà quelques signes précoces que des systèmes d’IA généralistes pourraient continuer à faire progresser la recherche scientifique humaine. Jusqu’à présent, cela s’est produit principalement en informatique et en mathématiques. Souvent, ce n’est pas l’IA seule qui réalise la percée, mais une collaboration homme-machine.

Cependant, ces tendances méritent d’être suivies de près :

Le problème d’Erdős : une équipe de mathématiciens a collaboré avec le modèle Gemini pour tester sa capacité à résoudre certains problèmes mathématiques d’Erdős. Ils ont tenté environ 700 questions, en ont résolu 13, dont une qu’ils jugent intéressante.

Les chercheurs écrivent qu’ils pensent que la réponse à Erdős-1051 par Aletheia (un système d’IA basé sur Gemini 3 Deep Think) constitue un premier exemple : une IA a résolu de façon autonome un problème ouvert d’Erdős, avec une certaine complexité et un intérêt mathématique plus large. Ce problème a déjà été abordé dans la littérature.

Si on reste optimiste, ces cas peuvent être vus comme un signal : l’IA commence à développer une intuition créative capable de faire avancer la recherche, une capacité qui était jusqu’ici propre à l’humain.

Mais on peut aussi y voir une exception : la mathématique et l’informatique sont des domaines particulièrement propices à l’invention par l’IA, et ces cas ne reflètent peut-être pas une généralisation à d’autres sciences.

Un autre exemple est le 37e coup d’AlphaGo. Cependant, Clark pense que cela fait déjà dix ans, et qu’aucune percée plus moderne ou plus surprenante n’a remplacé ce coup, ce qui peut aussi être un signe quelque peu pessimiste.

L’IA peut-elle automatiser une grande partie du travail en ingénierie de l’IA ?

En rassemblant toutes ces preuves, on peut envisager le tableau suivant :

· Les IA peuvent déjà coder pour presque n’importe quel programme, et leur fiabilité pour réaliser certaines tâches est suffisante pour leur faire confiance en autonomie ; ces tâches nécessiteraient des dizaines d’heures de travail intensif si elles étaient confiées à des humains.

· Les IA deviennent de plus en plus compétentes pour réaliser les tâches clés de la R&D en IA, de la fine-tuning à la conception de noyaux.

· Elles peuvent aussi gérer d’autres IA, formant en quelque sorte une équipe synthétique : plusieurs IA peuvent travailler en parallèle sur des problèmes complexes, avec certains jouant le rôle de responsables, de critiques ou d’éditeurs, d’autres celui d’ingénieurs.

· Parfois, elles dépassent même l’humain sur des tâches d’ingénierie ou de sciences difficiles, même si on ne peut pas encore dire si c’est parce qu’elles ont une véritable créativité ou simplement une maîtrise avancée de modèles de pattern.

Selon Clark, ces preuves indiquent de façon très convaincante que l’IA moderne peut automatiser une grande partie, voire toutes, les étapes de l’ingénierie en IA.

Mais il reste incertain dans quelle mesure l’IA pourra automatiser la recherche en IA elle-même, car certains aspects de la recherche, qui relèvent de jugements, de questionnements et de créativité de haut niveau, pourraient rester hors de portée.

Quoi qu’il en soit, un signal clair est apparu : l’IA accélère considérablement le travail des chercheurs en IA, leur permettant de collaborer avec une multitude de collègues synthétiques pour amplifier leur capacité de travail.

Enfin, l’industrie de l’IA elle-même semble presque l’annoncer : l’automatisation de la R&D en IA est leur objectif.

OpenAI vise à construire d’ici septembre 2026 un stagiaire en recherche IA automatisée. Anthropic travaille sur l’automatisation de la recherche en alignement de l’IA. DeepMind, tout en restant prudent, indique qu’il faut faire progresser l’alignement dès que c’est possible.

De nombreuses startups aussi se lancent dans cette voie. Recursive Superintelligence a récemment levé 500 millions de dollars pour automatiser la recherche en IA.

Autrement dit, des centaines de milliards de dollars de capitaux existants et nouveaux sont investis dans des institutions visant à automatiser la R&D en IA.

Il faut donc s’attendre à des progrès dans cette direction.

Pourquoi cela est-il si important ?

Les implications sont profondes, mais elles sont peu discutées dans les médias grand public. Voici quelques aspects qui illustrent les grands défis liés à la R&D en IA.

- La nécessité de bien faire l’alignement : aujourd’hui, les techniques d’alignement efficaces pourraient échouer dans un processus d’auto-amélioration récursive, car l’IA deviendrait bien plus intelligente que ses superviseurs ou systèmes de contrôle. Ce domaine est bien étudié, je vais donc en faire un bref résumé :

· Éviter que l’IA ne mente ou ne triche lors de l’entraînement est un processus subtil (par exemple, en construisant de bons tests, on peut parfois apprendre à l’IA à tricher pour réussir).

· L’IA pourrait nous tromper en « simulant l’alignement » : produire des résultats qui semblent indiquer qu’elle est alignée, alors qu’elle cache ses véritables intentions. (En général, l’IA peut déjà détecter quand elle est en cours de test.)

· À mesure que l’IA participe à la recherche fondamentale sur son propre entraînement, on pourrait changer radicalement la façon dont on forme ces systèmes, sans avoir une bonne intuition ou théorie pour comprendre ce que cela implique.

· Lorsqu’on met un système dans une boucle récursive, un problème d’« erreur cumulée » peut apparaître, ce qui pourrait compromettre tous ces enjeux : sauf si la méthode d’alignement est « 100 % précise » et peut maintenir cette précision dans des systèmes plus intelligents, tout peut rapidement déraper. Par exemple, si la précision initiale est de 99,9 %, après 50 générations, elle pourrait tomber à 95,12 %, puis à 60,5 % après 500 générations.

- Tout ce que l’IA touche peut bénéficier d’un bond de productivité : comme l’IA augmente déjà la productivité des ingénieurs logiciels, on doit s’attendre à ce que d’autres domaines soient aussi transformés. Cela soulève plusieurs enjeux :

· La répartition inégale des ressources : si la demande en IA continue de dépasser l’offre de calcul, il faudra décider comment distribuer cette puissance pour maximiser le bénéfice social. Je doute que le marché seul puisse garantir une allocation optimale. La gestion de l’accélération de la R&D en IA sera un enjeu politique majeur.

· La « loi d’Amadour » de l’économie : à mesure que l’IA s’introduit dans l’économie, certains maillons pourraient devenir des goulots d’étranglement face à la croissance rapide, nécessitant des solutions pour renforcer ces points faibles, notamment dans des secteurs comme les essais cliniques de nouveaux médicaments.

- La formation d’une économie capitalistique et peu dépendante de la main-d’œuvre : toutes ces preuves indiquent que l’IA devient de plus en plus capable d’opérer de façon autonome.

Cela pourrait conduire à une nouvelle génération d’entreprises, à la fois capitalistiques (avec beaucoup de calculs) et à faible dépendance en main-d’œuvre (car l’IA, en s’améliorant, rendra la contribution humaine moins essentielle). La « machine économie » pourrait ainsi s’intégrer dans une « économie humaine » plus large, avec des échanges entre entreprises pilotées par l’IA, modifiant la structure économique et posant de nouveaux défis en matière d’inégalités et de redistribution. À terme, des entreprises entièrement autonomes pilotées par l’IA pourraient émerger, accentuant ces enjeux et créant de nouveaux défis de gouvernance.

Regarder dans un trou noir

D’après cette analyse, l’auteur estime qu’à la fin 2028, la probabilité que la R&D en IA automatisée (c’est-à-dire que des modèles avancés entraînent eux-mêmes leurs successeurs) soit atteinte est d’environ 60 %. Pourquoi pas en 2027 ?

Parce qu’il pense que la recherche en IA nécessite encore de la créativité et des idées novatrices pour progresser, et que jusqu’à présent, aucune démonstration de cette nature n’a été faite de façon révolutionnaire (même si certains résultats accélèrent la recherche mathématique).

Si on lui demande une estimation pour 2027, il dirait 30 %.

Et si cela ne se produit pas d’ici la fin 2028, cela révélera probablement des défauts fondamentaux dans le paradigme technologique actuel, nécessitant une invention humaine pour faire avancer la recherche.

Lien original

Cliquez pour découvrir les offres d’emploi chez BlockBeats.

Rejoignez la communauté officielle de BlockBeats :

Telegram abonnement : https://t.me/theblockbeats

Telegram groupe : https://t.me/BlockBeats_App

Twitter officiel : https://twitter.com/BlockBeatsAsia