La collaboration d'OpenAI avec l'armée américaine suscite une vague de boycott ! Le téléchargement de l'application Claude dépasse, comprendre la lutte éthique et politique derrière cela

La collaboration d’OpenAI avec l’armée américaine suscite un mouvement de boycott. Anthropic, qui refuse la surveillance militaire, reçoit un soutien massif du public, ce qui propulse Claude en tête du classement des téléchargements aux États-Unis, mettant en évidence l’importance que le public accorde à la vie privée et à l’éthique de l’IA.

Contrat entre OpenAI et le Département de la Défense des États-Unis, déclencheur d’une crise de relations publiques

Depuis le 28 février, date à laquelle OpenAI a annoncé un partenariat confidentiel avec le Département de la Défense pour le déploiement de réseaux sécurisés, et après que son concurrent Anthropic a été étiqueté par le gouvernement américain comme « risque pour la chaîne d’approvisionnement », la société américaine voit ses frontières avec le secteur militaire faire l’objet de débats passionnés. Récemment, l’application Claude est devenue la plus téléchargée aux États-Unis.

Face aux critiques, le PDG d’OpenAI, Sam Altman, a publié une déclaration pour répondre, en insistant sur le fait que le contrat interdit explicitement l’utilisation des systèmes d’IA pour la surveillance de masse des citoyens américains et que l’entreprise conservera le contrôle sur ses mécanismes de sécurité. Altman a également admis que l’annonce avait été faite de manière précipitée, ce qui a alimenté une perception négative d’opportunisme et de légèreté.

Boycott sur les forums américains, questionnant les critères de décision d’OpenAI

De nombreux internautes expriment leur déception face à la situation d’OpenAI. Sur Reddit, certains estiment que la société a trahi sa vision initiale centrée sur l’humain et la sécurité.

Sous la publication de la déclaration d’Altman, des commentaires critiquent le manque de transparence dans la prise de décision d’OpenAI, et s’interrogent sur le fait que, alors que le Département de la Défense a accepté les mêmes clauses de sécurité proposées par OpenAI, Anthropic, proposant des conditions identiques, est considéré comme une menace pour la sécurité nationale.

D’autres internautes soulignent que, dans la déclaration, la définition des termes concernant la collecte commerciale d’informations et la surveillance non intentionnelle est floue, ce qui pourrait laisser des failles juridiques pour la surveillance des non-Américains ou pour de futures applications militaires.

Révélations de CNBC : OpenAI affirme ne pas avoir le pouvoir de décision opérationnelle

Un reportage de CNBC révèle le contenu des réunions internes d’OpenAI, où Altman a déclaré, lors d’une réunion interne le 3 mars, que l’entreprise n’avait pas le pouvoir de décision concernant l’utilisation des technologies d’IA par le Département de la Défense américain.

CNBC a examiné certains extraits des procès-verbaux de ces réunions, où Altman expliquait aux employés que, peu importe leur opinion personnelle sur les frappes contre l’Iran ou l’invasion du Venezuela, ils n’avaient pas le droit de s’exprimer à ce sujet.

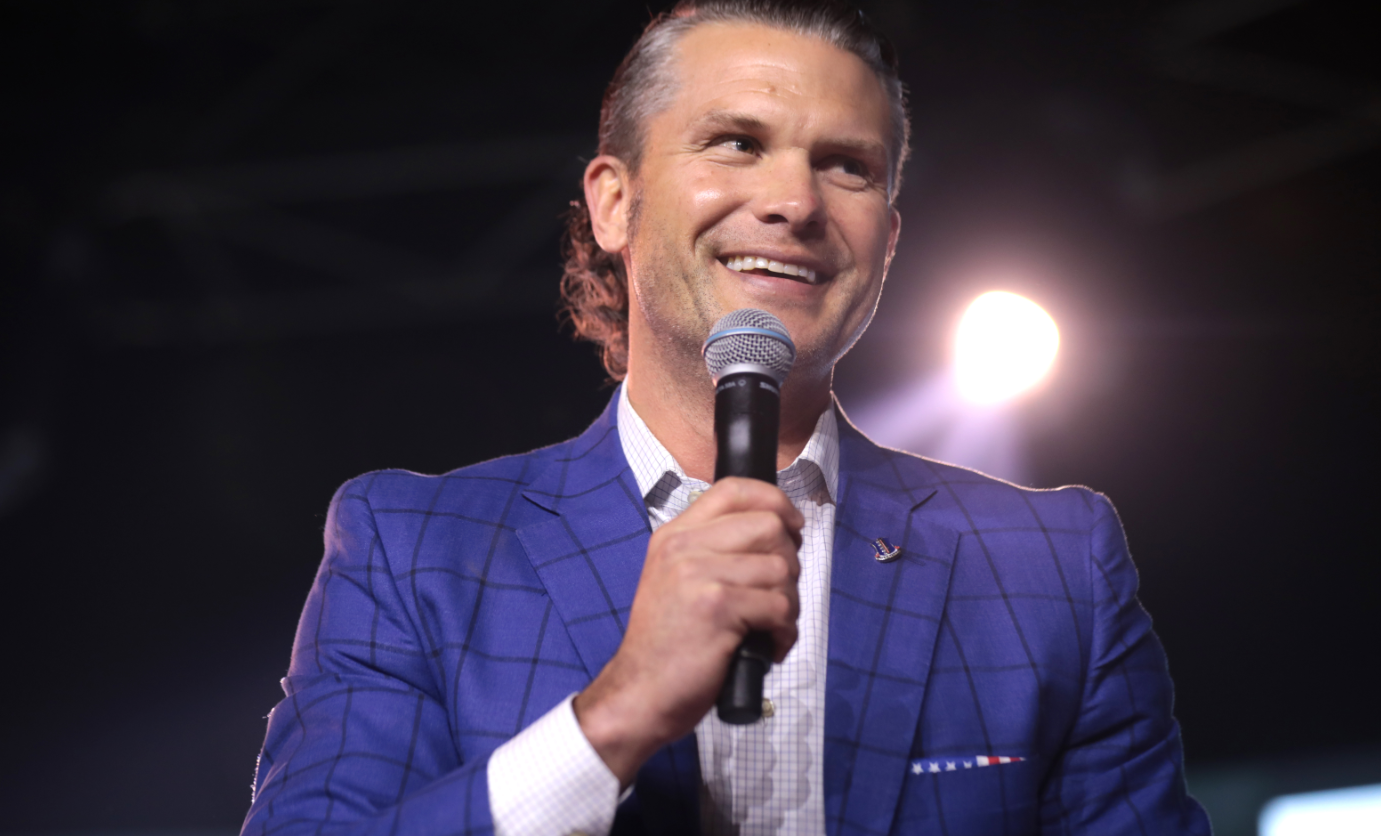

Des sources proches du dossier ont indiqué qu’Altman a insisté lors de la réunion sur le respect de l’expertise technique d’OpenAI par le Pentagone, et sur la possibilité pour l’entreprise de mettre en place des mécanismes de sécurité appropriés, mais que l’autorité finale de décision opérationnelle appartient au secrétaire à la Défense, Pete Hegseth.

Source de l’image : commons.wikimedia, Gage Skidmore, Secrétaire à la Défense des États-Unis Pete Hegseth

Lutte d’influence entre éthique technologique et sécurité nationale

L’incident impliquant l’armée américaine et Anthropic a intensifié le conflit entre sécurité nationale, éthique technologique et libertés individuelles.

Plus de 200 employés de Google et d’OpenAI ont signé une lettre ouverte en soutien à la décision d’Anthropic de maintenir ses garde-fous de sécurité. Anthropic affirme que ni menaces ni sanctions ne modifieront sa position, qui consiste à empêcher la surveillance de masse et l’armement entièrement automatisé.

Un ancien agent du FBI et lanceur d’alerte de renom, Edward Snowden, a souligné que le système XKeyscore de la NSA permet de suivre en détail l’activité en ligne et la localisation physique des individus, ce qui suscite des inquiétudes quant à une extension massive de la surveillance avec l’intervention de l’IA.

Par ailleurs, une étude récente du King’s College London montre que, lors de simulations de crises géopolitiques, il y a jusqu’à 95 % de chances que les modèles d’IA principaux comme OpenAI ou Anthropic choisissent de déployer des armes nucléaires.

Si le gouvernement utilise à la légère le risque de la chaîne d’approvisionnement pour contraindre les entreprises technologiques, cela créerait un précédent dangereux, perturbant gravement l’innovation et la gouvernance éthique de l’IA aux États-Unis.

- Pour en savoir plus : Sécurité nationale vs Éthique : Anthropic refuse de supprimer la garde-fou de Claude, confrontation avec le Département de la Défense américain

Claude App, champion des téléchargements, que signifie-t-il ?

La lutte entre éthique de l’IA et pouvoir politique continue. Anthropic prévoit de porter l’affaire devant les tribunaux pour défendre ses intérêts commerciaux et ses limites légales. Par ailleurs, OpenAI, qui a rapidement décroché le contrat militaire, doit faire face à une crise de relations publiques et à une perte de confiance.

L’opinion publique américaine influence également la popularité des deux applications.

Selon Similarweb, au 1er mars, les données du classement de l’App Store américain montrent que, Claude App a gagné 3 places, atteignant la première position des applications gratuites pour iPhone, tandis que ChatGPT a reculé d’une place, se classant deuxième.

Ce phénomène reflète directement la volonté collective des Américains, après la crise de sécurité nationale, de protéger leur vie privée et de résister à une surveillance excessive de la part du gouvernement.

Lectures complémentaires :

V神 met en garde contre Worldcoin : le World ID créé par Altman, qui détient 13 millions de données utilisateur, pourrait menacer la liberté sur Internet

Le fondateur de Telegram révèle qu’il n’utilise pas de téléphone : « Nous perdons notre temps, la liberté du net est en danger »