La Nueva Herramienta de IA de Google Predice Inundaciones Repentinas Hasta 24 Horas de Anticipación

En resumen

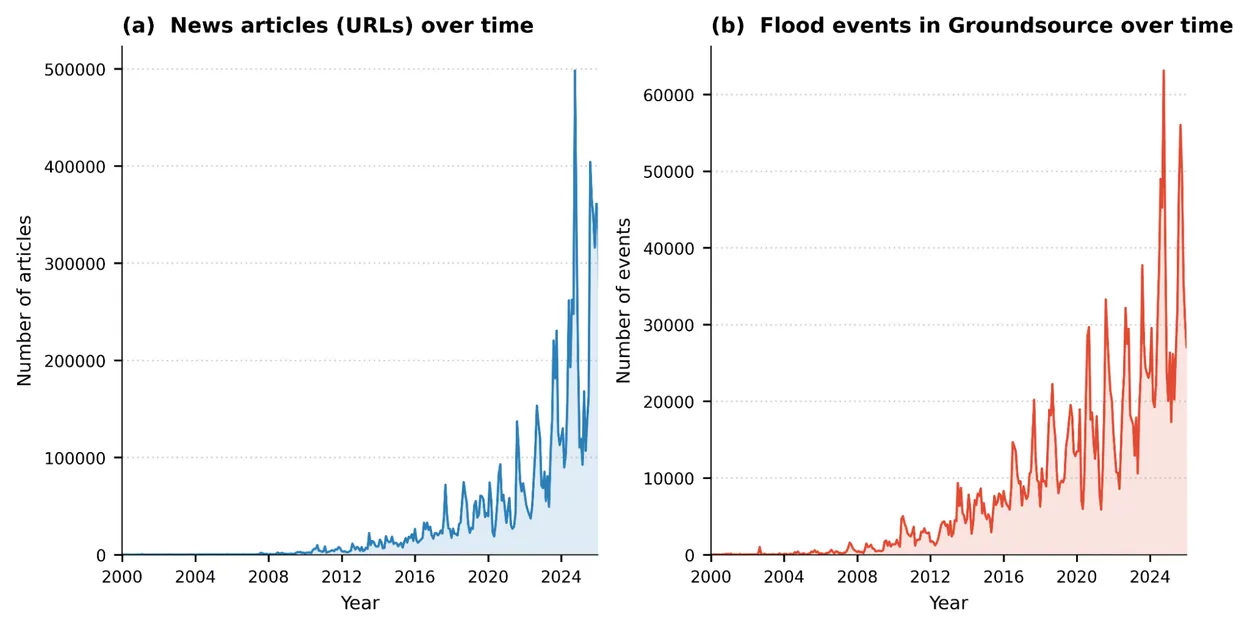

- Google creó el conjunto de datos de inundaciones repentinas más grande de la historia utilizando Gemini para analizar dos décadas de informes de noticias globales.

- El conjunto de datos ahora alimenta un modelo de IA que predice inundaciones urbanas repentinas con hasta 24 horas de antelación.

- El sistema llena una importante brecha de datos que durante mucho tiempo bloqueó la predicción de inundaciones repentinas.

Las inundaciones repentinas matan a miles de personas cada año. Son rápidas, afectan principalmente a las ciudades y, durante décadas, casi no había nada que los científicos pudieran hacer para anticiparlas, porque simplemente no existían los datos necesarios para entrenar modelos de predicción. El jueves, Google anunció que encontró una solución a ese problema—leyendo las noticias. La compañía presentó Groundsource, un sistema que usa Gemini AI para revisar millones de artículos de noticias publicados desde 2000, extraer referencias a eventos de inundación y vincular cada uno a una ubicación y una fecha. El resultado es un conjunto de datos de 2.6 millones de inundaciones repentinas históricas en más de 150 países, y ahora disponible para que cualquiera pueda descargar y usar.

Ese conjunto de datos se utilizó para entrenar un nuevo modelo de IA capaz de predecir si una inundación repentina es probable en un área urbana en las próximas 24 horas. Las predicciones ya están disponibles en Flood Hub de Google, la misma plataforma que la compañía usa para alertar a aproximadamente 2 mil millones de personas sobre inundaciones relacionadas con ríos en todo el mundo. El problema que Groundsource está resolviendo es sorprendentemente básico. Los ríos tienen medidores físicos—sensores en el agua que han registrado niveles durante décadas. Así es como los pronosticadores aprendieron a predecir cuándo un río se desbordaría. Las calles de la ciudad no tienen algo así. Cuando la lluvia intensa golpea el pavimento y sobrecarga los sistemas de drenaje, la inundación sucede demasiado rápido y de manera demasiado local para ser rastreada con instrumentos tradicionales. Sin registros históricos, no se puede entrenar un modelo de IA para reconocer el patrón. La solución de Google fue tratar los artículos de noticias como el sensor faltante.

“Al convertir la información pública en datos accionables, no solo analizamos el pasado—estamos construyendo un futuro más resiliente para todos, en línea con nuestro objetivo de que nadie se sorprenda por un desastre natural,” dijo Google.

Fuente: Google

Después de filtrar anuncios, menús de navegación y duplicados, y traducir artículos de otros idiomas al inglés, el equipo convirtió millones de descripciones de texto desordenadas en datos limpios, geolocalizados y en series temporales. El modelo entrenado con esos datos usa una red neuronal LSTM—un tipo de IA diseñada para procesar secuencias a lo largo del tiempo—para analizar pronósticos meteorológicos horarios junto con factores locales como densidad de urbanización, tasas de absorción del suelo y topografía. Luego, produce una señal simple: riesgo medio o alto de inundación en las próximas 24 horas, para cualquier área urbana con una densidad de población superior a 100 personas por kilómetro cuadrado. El sistema tiene limitaciones reales. Solo cubre áreas de aproximadamente 20 kilómetros cuadrados a la vez, no puede decir qué tan grave será una inundación y no funcionará bien en regiones con poca cobertura de noticias. Aún así, los resultados preliminares son reveladores. Una autoridad regional de desastre en África Austral recibió una alerta de Flood Hub durante la fase beta, confirmó la inundación en el terreno y envió a un trabajador humanitario para gestionar la respuesta. Según Juliet Rothenberg, directora de resiliencia ante crisis de Google, “esa cadena de eventos desde una predicción en Flood Hub hasta la presencia en el terreno es exactamente para lo que fue creado Flood Hub.”