OpenAI заявляє про безпекові «червоні лінії» у угоді з Пентагоном — але користувачі не купують це

Коротко

- OpenAI підписала угоду з Пентагоном щодо розгортання штучного інтелекту в секретних середовищах.

- Компанія заявила, що наклала «червоні лінії», але контракт дозволяє «всі законні цілі», що в кінцевому підсумку залежить від тлумачення уряду.

- Скандал спричинив рух QuitGPT і викликав зростання кількості завантажень Claude.

OpenAI повідомила цього вікенду, що досягла угоди з Пентагоном щодо розгортання передових систем штучного інтелекту в секретних середовищах, що означає значне розширення співпраці компанії з військовими США. Оголошення з’явилося менш ніж за 24 години після того, як адміністрація Трампа внесла Anthropic до чорного списку, позначивши конкурента у сфері ШІ як «ризик для національної безпеки у ланцюгу постачання» через суперечку щодо мов контракту, пов’язаного з наглядом і автономною зброєю. Президент Дональд Трамп також наказав федеральним агентствам негайно припинити використання технологій Anthropic, а міністр фінансів Скот Бессент у понеділок у X написав, що агентство «припиняє всі використання продуктів Anthropic, включаючи платформу Claude, у нашому відомстві».

"СПОЛУЧЕНІ ШТАТИ АМЕРИКИ НІКОЛИ НЕ ДОПУСТЯТЬ, ЩО РАДИКАЛЬНА ЛІВА, ПРОБУДЖЕНА КОМПАНІЯ, НАМІРЯЄТЬСЯ диктувати, як наша велика армія бореться і перемагає у війнах! Це рішення належить ВАШОМУ ГОЛОВНОМУ КОМАНДИРУ і великим лідерам, яких я призначаю для керівництва нашою армією.

Ліві екстремісти з Anthropic… pic.twitter.com/aIEx92nnyx

— Білий дім (@WhiteHouse) 27 лютого 2026

Тимчасові рамки оголошень щодо ШІ поставили угоду OpenAI під пильний контроль. У детальному блозі компанія окреслила те, що вона назвала «червоними лініями» та шарами захисту, що регулюють її партнерство з Пентагоном. Угода, як її представила OpenAI, піднімає ширші питання щодо того, як системи ШІ будуть регулюватися у сферах національної безпеки і як практично будуть тлумачитися та застосовуватися заявлені обмеження компанії. Коли «законно» недостатньо У блозі OpenAI починається з трьох зобов’язань, сформульованих як безальтернативні: заборона використовувати технології для масового внутрішнього нагляду, для самостійного керування автономною зброєю або для високоризикових автоматичних рішень, таких як соціальний кредит. Далі йде саме мовлення контракту — яке OpenAI називає «релевантним мовленням», а не «повною угодою».

«Міністерство війни може використовувати систему ШІ для всіх законних цілей відповідно до чинного законодавства, операційних вимог і добре відпрацьованих протоколів безпеки та контролю», — заявила OpenAI. Це саме та фраза, яку Anthropic стверджувала, що уряд наполягав під час переговорів. Це та сама фраза, з якою Anthropic відмовилася погодитися. OpenAI підписала її, але стверджує, що її «червоні лінії» залишаються цілком незмінними. Однак «законно» у контексті національної безпеки — не фіксована межа — вона існує у складній системі законів, указів, внутрішніх директив і часто засекречених юридичних тлумачень. Коли контракт дозволяє «всі законні цілі», практичний обмежувач — це поточне юридичне поле уряду, а не незалежний стандарт, встановлений постачальником. Група положень Щодо зброї, у контракті зазначено, що система ШІ «не буде використовуватися для самостійного керування автономною зброєю у випадках, коли закон, регулювання або політика відомства вимагають людського контролю». Заборона поширюється лише на випадки, коли інша влада вже вимагає людського контролю — вона цілком базується на існуючій політиці, зокрема Директиві Міноборони 3000.09. Ця директива вимагає, щоб автономні системи дозволяли командуванню застосовувати «відповідний рівень людського судження щодо використання сили». І «відповідний» — це таке ж суб’єктивне поняття, як і будь-що інше. Людське судження — це не людський контроль. Ця різниця не випадкова. Військові дослідники зазначають, що навмисне пропускання мовлення про «людину в ланцюгу» було зроблено навмисно, щоб зберегти оперативну гнучкість.

Найсильніша контраргументація OpenAI — це його архітектура розгортання лише у хмарі — повністю автономні летальні рішення вимагали б розгортання на польових пристроях, що цей контракт не дозволяє. Це реальна технічна обмеженість. Але хмарний ШІ все ще може виконувати ідентифікацію цілей, аналіз патернів поведінки та планування місій. Це етапи у ланцюгу знищення цілей, незалежно від того, де знаходиться кінцевий тригер. Результат для цілі не залежить від сервера, на якому працює модель. Щодо нагляду, ситуація схожа. Заявлена «червона лінія» OpenAI — заборона масового внутрішнього нагляду. Мовлення контракту: система «не повинна використовуватися для необмеженого моніторингу приватної інформації осіб у США відповідно до цих повноважень» — і далі перераховуються Четверта поправка, FISA і Виконавчий наказ 12333. Слово «необмежений» натякає, що дозволений буде обмежений варіант масового нагляду. А EO 12333 — це виконавчий наказ, який NSA використовує для обґрунтування перехоплення комунікацій американців за межами США. Саме тут виникає питання щодо слів Anthropic під час переговорів. Їхня аргументація полягала в тому, що сучасне законодавство ще не враховує можливості, які відкриває ШІ. Уряд може легально купувати великі обсяги агрегованих комерційних даних про американців без ордера — і вже робить це. Мовлення контракту OpenAI, яке базується на існуючих правових рамках, можливо, не закриває ту прогалину, про яку турбувалася Anthropic. Відповідь Алтмана У суботу ввечері Алтман провів AMA, відповідаючи на тисячі запитань щодо угоди. На запитання, що змусить OpenAI відмовитися від співпраці з урядом, він відповів: «Якщо нас попросять зробити щось неконституційне або незаконне, ми підемо геть.»

Якщо нас попросять зробити щось неконституційне або незаконне, ми підемо геть. За необхідності приходьте до мене у в’язницю.

— Сэм Алтман (@sama) 1 березня 2026

Це формулювання встановлює межу OpenAI — законність, а не незалежна етична оцінка того, що компанія дозволить або заборонить, якщо це буде легально, що захищає Anthropic. На запитання, чи він боїться майбутніх суперечок щодо того, що вважається «законним», він визнав ризик: «Якщо доведеться боротися з цим, ми боротимемося, але це явно не без ризику для нас.» Щодо того, чому OpenAI уклала угоду, яку Anthropic не могла, Алтман сказав: «Anthropic більше зосереджена на конкретних заборонах у контракті, ніж на застосовних законах, з якими нам було комфортно. Я б явно більше довіряв технічним засобам безпеки, якщо б міг обрати лише один. Можливо, Anthropic хотіла більше операційного контролю, ніж ми.» Це суттєва філософська різниця. Anthropic стверджує, що оскільки передові моделі можна перепрофілювати для розвідки та військових процесів у способи, важко передбачити заздалегідь, обмеження мають бути чіткими і обов’язковими у письмовій формі, навіть за ціну угоди. Позиція OpenAI полягає в тому, що технічна архітектура, залучений персонал і існуюче законодавство разом є більш надійним захистом, ніж просто контрактний текст. Громадськість обрала сторону

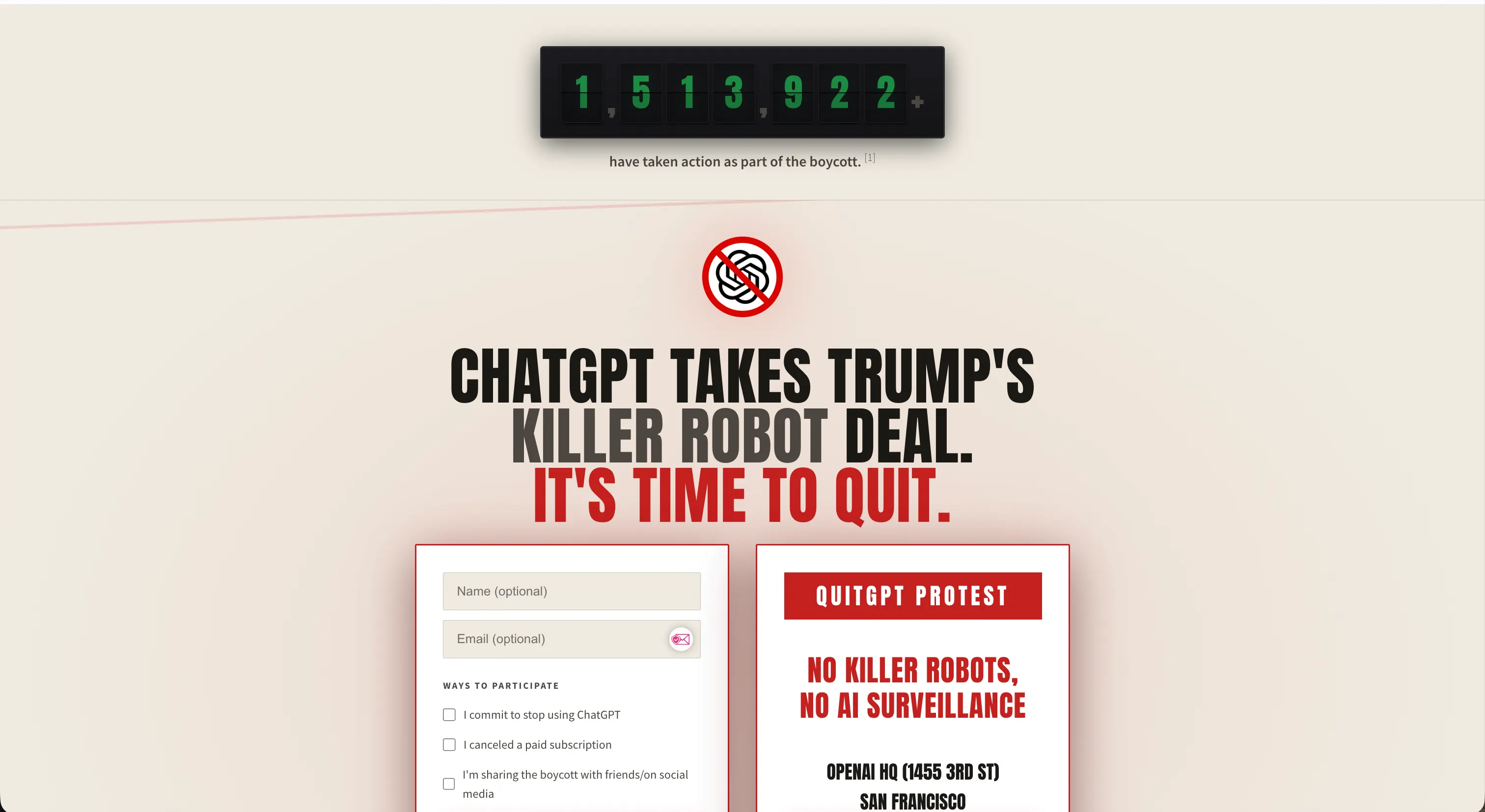

Обурення було миттєвим. До понеділка рух «QuitGPT» заявив, що понад 1,5 мільйона людей вжили заходів — скасували підписки, поширювали заклики до бойкоту або реєструвалися на quitgpt.org.

Кампанія представила крок OpenAI як пріоритет військових контрактів над безпекою користувачів, звинувативши компанію у погодженні з використанням технологій Пентагоном для «будь-яких законних цілей, включаючи вбивчі роботи та масовий нагляд».

OpenAI можливо й заперечить цю характеристику. Але ринок уже реагує.

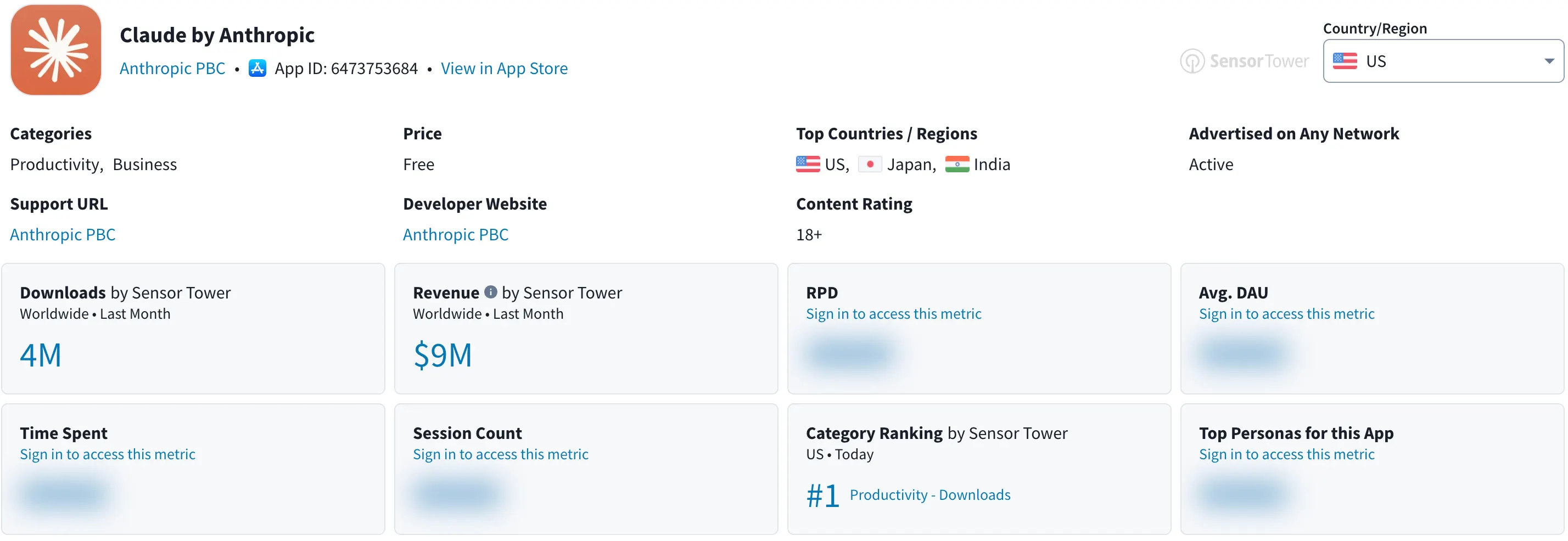

Claude від Anthropic обігнав ChatGPT і став найзавантажуванішим безкоштовним додатком у США в App Store, повідомила компанія Decrypt, зафіксувавши рекордний щоденний приріст підписників у вихідні.

Зірка поп-музики Кеті Перрі опублікувала скріншот сторінки цін Claude у X. Сотні користувачів публічно скасовували підписки на Reddit. Графіті з похвалою Anthropic з’явилися біля офісу у Сан-Франциско, а крейдяні написи — на тротуарах OpenAI. Навіть сотні співробітників OpenAI раніше підписали відкритого листа на підтримку відмови Anthropic від вимог Пентагону.

Образ QuitGPT емоційно переконливий, але не зовсім точний. Сам Anthropic має партнерство з Palantir і Amazon Web Services, що надає доступ до моделей Claude американським розвідкам і оборонним відомствам, і, за повідомленнями, використовувалося у військових операціях для повалення урядів Венесуели та Ірану. Етика ШІ та контрактів із національною безпекою ніколи не були чистими з обох боків. Що справді відображає кампанія — це те, що значна частина користувачів вірить у суттєву різницю у тому, як обидві компанії визначають свої межі — і голосують своїми підписками. Чи ця різниця така важлива, як здається, — залежить від уважного читання контракту.