加大教授が生成式AIを解説:Vibe Codingはそんなにすごいのか?AIを使ったプログラミングの最良の方法は?

生成式AIの急速な発展の中、多くの人がプログラミングを学び続けるべきか迷いを感じている中、加大教授はGQ雑誌の番組でChatGPTの背後にあるLLMの原理を解説し、Vibe Codingの限界性を指摘した。

加大教授が生成式AIを解説し、Vibe Codingを正しく理解する方法

最近、GQ TaiwanはYouTubeチャンネルで動画を共有し、カリフォルニア大学バークレー校(UC Berkeley)のコンピュータサイエンス教授Sarah Chasinsを特別招待し、ネットユーザーのプログラミングとAIに関する多くの疑問に回答した。

生成式AIの急速な発展の中、多くの人がプログラミングを学び続けるべきか迷っている中、Chasins教授は動画の中で技術原理を解説しただけでなく、最近盛り上がっている「Vibe Coding」ブームに対しても実用的な観察を示した。

教授がChatGPTの背後にあるLLM技術の原理を解説

Sarah Chasins教授はまず、大衆にも理解できる方法で、ChatGPTの動作メカニズムを説明した。

ChatGPTは大規模言語モデル(LLM)に基づいており、そのコアな動作ロジックは非常に単純で、見た目の単語を組み合わせるプログラムを作ることに過ぎない。

LLMの開発者は、まずインターネット上のすべての人間が書いたドキュメントやウェブページを収集し、これらのデータは人間の認知における合理的な語彙の組み合わせを表している。

**次に、プログラムは大規模な「穴埋めゲーム」の訓練を行う。**例えば、「犬は四つ足[空白]」という文を見たとき、人間の認知に合った答えは「犬は四つ足の脚」だが、プログラムが誤って推測した場合、開発者は修正し、正解になるまで繰り返す。

地球時間に換算して300〜400年分の計算時間をかけて訓練された後、**最終的に非常に巨大な「カンニングペーパー」、つまり技術界でよく言われる「パラメータ」**を生成する。

次に、対話形式のファイルを提供すれば、この穴埋めに長けたプログラムはチャットボットに変換され、人間の質問に対して論理的に残りの応答を自動補完できる。

画像出典:AI生成 Nanobananaによる画像生成、参考用、一部の漢字がぼやけている場合はご了承ください。

AI時代における、プログラミング学習の最良の方法

AIツールの強力な能力に直面し、多くの人がプログラミング学習の必要性に疑問を抱いている。これに対し、教授は次のように考える。プログラミング教育の最も核心的なスキルは「問題の分解」にある。つまり、曖昧な大きな問題を細かい部分に分解し、それぞれの部分を数行のコードで解決できるまで細分化することだ。

この訓練が不足していると、ユーザーはAIツールを使っても実際に動作する複雑なプログラムを出力するのは難しくなる。さらに、LLMの訓練データはエンジニア風の言語記述が多く、専門外の人が日常的に使う言語とは合わないことが多いため、AIが有用なコードを生成できないこともある。

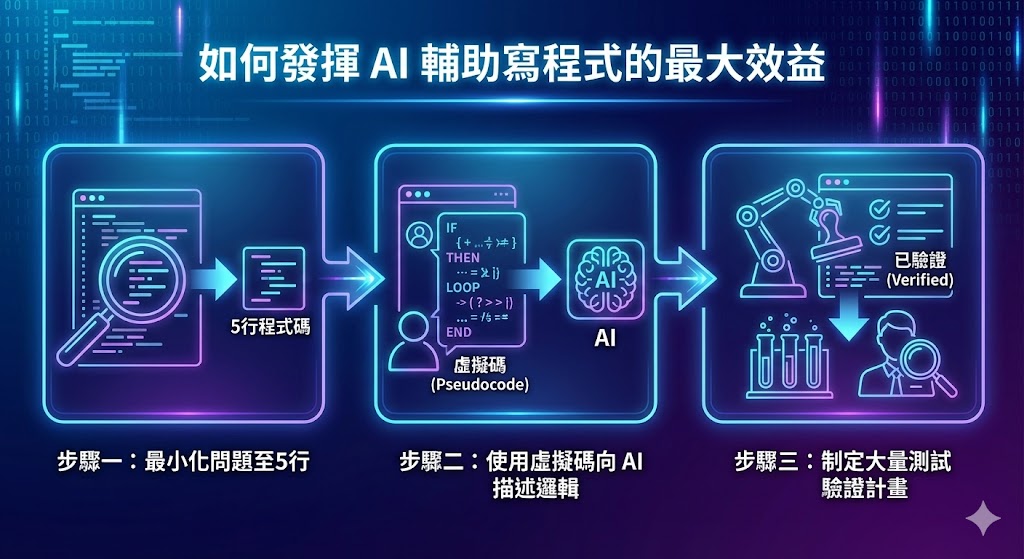

AIを活用したプログラミング支援の最大効果を発揮するには、Chasins教授は次の3つのステップを推奨している。

- **問題を最小化:**問題を約5行のコード規模にまで分解する。

- **疑似コード(Pseudo code)を使う:**これは複数のプログラミング言語の構文やキーワードを組み合わせて論理を記述する方法で、自然言語に似ているが、日常的に使う言語ではなく、コンピュータにより正確に理解させるためのものだ。

- **検証計画を立てる:**大量のテストや専門的なレビューを通じて、AIの出力の正確性を確保する。

画像出典:AI生成 Nanobananaによる画像生成、参考用、一部の漢字がぼやけている場合はご了承ください。

Vibe Codingはそんなに神技じゃない?

最近流行している、LLMを直接使ってコードを生成し、人間が手打ちしないVibe Coding方式について、Sarah Chasins教授は懐疑的な態度を示している。

彼女は、この種のツールは人間が何百回も書いた定型的な内容を処理するには良いが、新しいアイデアや革新的なことに挑戦しようとすると、通常は通用しないと分析している。

また、関連研究データを引用し、LLMツールを補助に使う人は、自分では効率が20%向上したと感じているが、実際の開発速度はツールを使わない人より20%遅いこともある。

これは、ツールに過度に依存すると効率向上の錯覚を生むことを示している。未知のプログラム要求に直面したとき、基礎的なロジックの分解能力や物理原理の知識が不足していると、AIの誤りを修正できず、最終的な成果物の作成により多くの時間を要することになる。

簡単に例えると、LLMは高級な自動運転車のようなもので、一般的なルート処理は得意だが、コースの分解や車両の物理原理を理解していなければ、未経験の危険なカーブや革新的なプログラム要求に遭遇したとき、自動運転は誤作動しやすく、基本的なスキル不足のために修正方法もわからなくなる。

延長読書:

AIが一人会社を台頭させる!「雰囲気コーディング」が伝統を覆し、小規模チームでも年収破億

関連記事