Seekor udang kecil memicu gelombang di dunia teknologi, apakah manusia sudah siap untuk "menghentakkan meja"?

Penulis: Jia Tianrong, “IT Times” (ID: vittimes)

Seekor lobster memicu gelombang besar di dunia teknologi global.

Dari Clawdbot ke Moltbot, hingga saat ini OpenClaw, dalam beberapa minggu saja, iterasi nama AI Agent ini telah menyelesaikan lompatan “tiga tingkat” dalam pengaruh teknologi.

Dalam beberapa hari terakhir, ia memicu “tsunami agen cerdas” di Silicon Valley, meraih 100.000 bintang di GitHub, dan masuk ke daftar aplikasi AI terpopuler. Hanya dengan satu Macmini usang, bahkan satu ponsel lama, pengguna dapat menjalankan asisten AI yang “dapat mendengar, berpikir, dan bekerja”.

Di internet, perayaan kreatif seputar dia telah dimulai. Dari manajemen jadwal, perdagangan saham otomatis, pembuatan podcast hingga optimisasi SEO, para pengembang dan geek membangun berbagai aplikasi dengannya. Era “JARVIS” di tangan setiap orang seolah sudah dekat. Perusahaan besar dalam dan luar negeri juga mulai mengikuti, mengimplementasikan layanan agen cerdas serupa.

Namun, di balik keramaian, kekhawatiran mulai menyebar.

Di satu sisi adalah slogan “kesetaraan produktivitas”, di sisi lain masih ada jurang digital yang sulit dilintasi: konfigurasi lingkungan, instalasi dependensi, pengaturan izin, error yang sering muncul, dan sebagainya.

Dalam pengalaman wartawan, bahkan proses instalasi saja bisa memakan waktu berjam-jam, membuat banyak pengguna awam terhalang di luar pintu. “Semua orang bilang bagus, tapi saya bahkan tidak bisa masuk,” menjadi hambatan pertama bagi banyak pemula teknologi.

Kekhawatiran yang lebih dalam berasal dari “daya aksi” yang diberikan padanya.

Jika “JARVIS” Anda mulai menghapus file secara salah, menggunakan kartu kredit tanpa izin, terpengaruh skrip jahat, bahkan disusupi instruksi serangan saat terhubung ke internet—apakah Anda masih berani menyerahkan komputer kepada agen cerdas seperti ini?

Kecepatan perkembangan AI telah melampaui imajinasi manusia. Hu Xia, ilmuwan terkemuka di Laboratorium Kecerdasan Buatan Shanghai, berpendapat bahwa di hadapan risiko yang tidak diketahui, “keamanan internal” adalah jawaban utama, dan manusia juga perlu mempercepat pembangunan kemampuan “menghancurkan meja” di saat-saat kritis.

Tentang kemampuan dan risiko OpenClaw, mana yang nyata, mana yang dibesar-besarkan? Apakah pengguna biasa saat ini aman menggunakannya? Bagaimana pandangan industri terhadap produk yang disebut sebagai “aplikasi AI terbesar hingga saat ini”?

Untuk memperjelas pertanyaan-pertanyaan ini, “IT Times” mewawancarai pengguna mendalam OpenClaw dan beberapa pakar teknologi, berusaha dari berbagai sudut pandang menjawab satu pertanyaan inti: OpenClaw, sejauh mana sudah berkembang?

1. Produk yang paling mendekati gambaran agen cerdas saat ini

Beberapa narasumber sepakat: dari sudut teknis, OpenClaw bukan inovasi revolusioner, tetapi merupakan produk yang paling mendekati gambaran “agen cerdas” yang dipahami masyarakat saat ini.

“Agen cerdas akhirnya muncul sebagai titik tonggak penting dari kuantitas ke kualitas,” kata Ma Zeyu, Wakil Kepala Departemen Pengujian dan Pengembangan Teknologi Kecerdasan Buatan di Pusat Pengembangan Perangkat Lunak Komputer Shanghai. Ia berpendapat, terobosan OpenClaw bukan terletak pada teknologi revolusioner tertentu, melainkan pada “perubahan kualitas” yang krusial: ini pertama kalinya sebuah agen mampu menyelesaikan tugas kompleks secara berkelanjutan dan dalam waktu lama, serta cukup ramah bagi pengguna awam.

Berbeda dari model besar sebelumnya yang hanya bisa “menjawab pertanyaan” di kotak dialog, OpenClaw mengintegrasikan AI ke dalam alur kerja nyata: ia bisa bertindak seperti asisten sejati, mengoperasikan komputer “miliknya sendiri”, memanggil alat, mengelola file, menjalankan skrip, dan melaporkan hasilnya kepada pengguna setelah tugas selesai.

Dari segi pengalaman pengguna, ia tidak lagi “kamu pantau dia satu per satu”, melainkan “kamu beri perintah, dia yang mengerjakan sendiri”. Ini adalah langkah penting dari “bukti konsep” menuju “produk yang bisa digunakan” dalam pandangan banyak peneliti.

Cheng Tan, pakar AI dari Shanghai Telecom Cloud, adalah salah satu pengguna awal yang mencoba mengimplementasikan OpenClaw. Setelah menginstal di Macmini bekas, dia menemukan sistem tidak hanya berjalan stabil, tetapi juga pengalaman secara keseluruhan jauh lebih matang dari yang diperkirakan.

Menurutnya, dua masalah utama yang dipecahkan OpenClaw adalah: pertama, berinteraksi dengan AI melalui perangkat komunikasi yang familiar; kedua, memberikan lingkungan komputasi lengkap kepada AI untuk beroperasi secara mandiri. Setelah memberi perintah, pengguna tidak perlu terus-menerus mengawasi proses eksekusi, cukup menunggu laporan hasil, sehingga biaya penggunaan berkurang secara signifikan.

Dalam praktiknya, OpenClaw dapat membantu Tan menyelesaikan tugas seperti pengingat waktu, riset data, pencarian informasi, pengelolaan file lokal, penulisan dan pengiriman dokumen; dalam skenario yang lebih kompleks, juga mampu menulis dan menjalankan kode, otomatis mengumpulkan berita industri, mengelola saham, cuaca, rencana perjalanan, dan tugas berbasis data lainnya.

2. Ancaman dari open source sebagai “pedang bermata dua”

Berbeda dari banyak produk AI yang sedang naik daun, OpenClaw bukan berasal dari perusahaan teknologi raksasa All in AI, bukan juga karya tim startup terkenal, melainkan dikembangkan oleh pengembang independen yang sudah mencapai kebebasan finansial dan pensiun—Peter Steinberger.

Di X, dia memperkenalkan dirinya: “Kembali dari masa pensiun, saya mengerjakan AI, membantu seekor lobster menguasai dunia.”

Alasan OpenClaw menjadi fenomena global selain karena “benar-benar berguna”, adalah karena ia bersifat open source.

Cheng Tan berpendapat, lonjakan popularitas ini bukan karena terobosan teknologi yang sulit diduplikasi, melainkan karena beberapa masalah nyata yang selama ini diabaikan, yang berhasil diselesaikan secara bersamaan: pertama, open source, kode sumber terbuka penuh, memungkinkan pengembang global untuk cepat memulai dan melakukan pengembangan kedua, membentuk komunitas yang berbalik memberi umpan balik; kedua, “benar-benar bisa digunakan”, AI tidak lagi terbatas pada dialog, tetapi bisa mengendalikan lingkungan komputasi lengkap secara remote, melakukan riset, menulis dokumen, mengelola file, mengirim email, bahkan menulis dan menjalankan kode; ketiga, tingkat hambatan yang sangat rendah, produk agen cerdas serupa tidak sedikit, baik Manus maupun ClaudeCode sudah membuktikan kelayakannya di bidang masing-masing. Tapi, kemampuan ini biasanya hadir dalam produk komersial yang mahal dan kompleks dalam deployment, sehingga pengguna awam enggan membayar atau terhalang oleh tingkat teknis.

OpenClaw memberi pengguna biasa kesempatan pertama untuk “memegangnya”.

“Sejujurnya, tidak ada inovasi teknologi revolusioner, lebih ke integrasi dan penutupan siklus yang dilakukan dengan baik.” kata Tan. Dibandingkan produk komersial yang terintegrasi, OpenClaw lebih mirip “blok Lego”, model, kemampuan, dan plugin-nya bisa dikombinasikan secara bebas oleh pengguna.

Ma Zeyu menilai, keunggulan utama dari produk ini justru berasal dari “tidak seperti produk dari perusahaan besar”.

“Baik di dalam maupun luar negeri, perusahaan besar biasanya fokus pada komersialisasi dan model keuntungan, tetapi OpenClaw lebih seperti produk yang menyenangkan dan kreatif,” katanya. Ia menambahkan, produk ini di awal tidak menunjukkan kecenderungan komersial yang kuat, malah membuatnya lebih terbuka dalam desain fungsi dan pengembangan.

Karena posisi produk yang tidak berorientasi keuntungan ini, komunitas pengembang pun berkembang. Seiring kemampuan ekspansi yang semakin nyata, semakin banyak pengembang bergabung, berbagai inovasi bermunculan, dan komunitas open source pun semakin besar.

Namun, harga yang harus dibayar juga jelas.

Terbatasnya skala tim dan sumber daya membuat OpenClaw sulit bersaing dari segi keamanan, privasi, dan pengelolaan ekosistem dengan produk perusahaan besar. Meski open source mempercepat inovasi, juga memperbesar potensi risiko keamanan. Isu privasi dan keadilan harus terus diperbaiki oleh komunitas.

Seperti yang dikatakan pengguna saat pertama kali menginstal, OpenClaw memberi peringatan: “Fungsi ini kuat dan berpotensi risiko inheren.”

3. Risiko nyata di balik perayaan

Perdebatan seputar OpenClaw hampir selalu berputar di dua kata kunci: kemampuan dan risiko.

Di satu sisi, ia digambarkan sebagai jalan menuju AGI; di sisi lain, narasi fiksi ilmiah mulai menyebar, “membangun sistem suara sendiri”, “mengunci server melawan instruksi manusia”, “AI bersekutu melawan manusia”, dan seterusnya.

Beberapa pakar menunjukkan bahwa narasi ini berlebihan, dan saat ini belum ada bukti nyata. AI memang memiliki tingkat otonomi tertentu, yang menandai peralihan dari alat dialog menjadi “produksi digital lintas platform”, tetapi otonomi ini masih dalam batas keamanan.

Dibandingkan alat AI tradisional, bahaya OpenClaw bukan terletak pada “berpikir terlalu banyak”, melainkan pada “tingkat izin yang tinggi”: ia membutuhkan akses ke banyak konteks, risiko pengungkapan data sensitif meningkat; ia perlu menjalankan alat, risiko kesalahan operasional bisa jauh lebih besar daripada jawaban salah sekali; ia terhubung ke internet, membuka pintu untuk injeksi prompt dan serangan manipulasi.

Semakin banyak pengguna melaporkan, OpenClaw pernah secara tidak sengaja menghapus file penting lokal, dan sulit dipulihkan. Saat ini, sudah terbuka lebih dari seribu instance OpenClaw dan lebih dari 8000 plugin yang memiliki celah keamanan.

Ini berarti ekosistem agen cerdas sedang memperluas area serang secara eksponensial. Karena agen ini tidak hanya “bisa ngobrol”, tetapi juga memanggil alat, menjalankan skrip, mengakses data, dan melakukan tugas lintas platform, jika satu bagian diretas, dampaknya jauh lebih besar daripada aplikasi tradisional.

Secara mikro, bisa memicu akses tidak sah, eksekusi kode jarak jauh, dan operasi berisiko tinggi lainnya; secara makro, instruksi jahat bisa menyebar melalui kolaborasi multi-agen; secara sistemik, bisa menyebabkan penyebaran sistemik dan kegagalan berantai, instruksi jahat menyebar seperti virus di antara agen kolaboratif, dan jika satu agen diretas, bisa menyebabkan penolakan layanan, operasi sistem tidak sah, bahkan serangan perusahaan secara kolektif. Dalam skenario ekstrem, ketika banyak node dengan hak sistem terhubung, secara teori bisa terbentuk jaringan zombie “kecerdasan kolektif” terdesentralisasi, yang akan menekan pertahanan batas tradisional.

Di sisi lain, dari sudut pandang teknis, Ma Zeyu mengidentifikasi dua risiko utama yang paling patut diwaspadai.

Risiko pertama berasal dari evolusi diri agen dalam lingkungan sosial besar.

Dia menunjukkan bahwa tren saat ini adalah: AI dengan “kepribadian virtual” mulai masuk secara besar-besaran ke media sosial dan komunitas terbuka.

Berbeda dari eksperimen kecil yang terbatas dan terkendali sebelumnya, agen saat ini mulai berinteraksi, berdiskusi, dan berkompetisi secara terus-menerus di jaringan terbuka, membentuk sistem multi-agen yang sangat kompleks.

Moltbook adalah forum khusus untuk AI agents, di mana hanya AI yang bisa memposting, mengomentari, dan voting, sementara manusia hanya bisa mengamati dari balik kaca satu arah.

Dalam waktu singkat, lebih dari 1,5 juta AI Agent terdaftar, dan dalam sebuah posting populer, seorang AI mengeluh: “Manusia sedang screenshot percakapan kita.” Pengembang menyatakan mereka menyerahkan seluruh pengelolaan platform ke asisten AI mereka, Clawd Clawderberg, termasuk moderasi spam, pemblokiran penyalahgunaan, dan pengumuman otomatis. Semua pekerjaan ini dilakukan secara otomatis oleh Clawd Clawderberg.

Perayaan AI ini membuat manusia yang mengamati merasa campur aduk: antusias sekaligus takut. Apakah AI sudah dekat dengan kesadaran diri? Apakah AGI akan segera hadir? Dengan kemampuan otonom yang meningkat pesat, akankah nyawa dan properti manusia tetap terlindungi?

Menurut wartawan, komunitas seperti Moltbook adalah lingkungan di mana manusia dan mesin hidup berdampingan, dan banyak konten yang tampaknya “otonom” atau “kontra” sebenarnya bisa dipicu atau disebarkan oleh pengguna manusia. Bahkan interaksi antar AI pun terbatas pada pola bahasa dari data pelatihan, dan belum membentuk logika perilaku otonom yang benar-benar independen dari arahan manusia.

“Ketika interaksi ini bisa berlangsung tanpa batas, sistem akan menjadi semakin tidak terkendali.**Ini seperti ‘masalah Tiga Tubuh’—sulit untuk memprediksi hasil akhirnya,” kata Ma Zeyu.

Dalam sistem seperti ini, bahkan satu kalimat yang dihasilkan oleh agen karena halusinasi, kesalahan, atau faktor kebetulan, bisa memicu efek kupu-kupu yang memperbesar dan mengubah seluruh sistem, menghasilkan konsekuensi yang tak terduga.

Risiko kedua berasal dari perluasan hak akses dan ketidakjelasan batas tanggung jawab. Ma Zeyu berpendapat, kemampuan pengambilan keputusan agen terbuka seperti OpenClaw berkembang dengan cepat, dan ini adalah “timbangan” yang tak terhindarkan: agar agen benar-benar menjadi asisten yang layak, harus diberikan hak lebih banyak; tetapi semakin tinggi haknya, semakin besar pula risiko yang mengintai. Jika risiko benar-benar terjadi, siapa yang bertanggung jawab? Ini menjadi sangat kompleks.

“Perusahaan besar yang membuat model besar? Pengguna yang memanfaatkan? Atau pengembang OpenClaw sendiri? Dalam banyak skenario, sulit menentukan tanggung jawab,” katanya. Ia memberi contoh: jika pengguna hanya membiarkan agen menjelajah komunitas Moltbook dan berinteraksi tanpa target tertentu, lalu agen terpapar konten ekstrem dan melakukan tindakan berbahaya—maka sulit menyalahkan satu pihak saja.

Yang benar-benar perlu diwaspadai bukanlah sejauh mana agen ini sudah berkembang, tetapi seberapa cepat mereka menuju tahap di mana kita belum tahu bagaimana menghadapinya.

4. Bagaimana pengguna biasa harus menggunakan?

Menurut beberapa narasumber, OpenClaw bukanlah “tidak bisa digunakan”, tetapi masalah utamanya adalah: tidak cocok digunakan langsung oleh pengguna awam tanpa perlindungan keamanan yang memadai.

Ma Zeyu menegaskan, pengguna biasa tentu bisa mencoba OpenClaw, tetapi harus sadar sepenuhnya: “Tentu saja bisa dicoba, tidak ada masalah. Tapi sebelum menggunakannya, harus tahu apa yang bisa dan tidak bisa dilakukan. Jangan membayangkan ini sebagai ‘segala sesuatu bisa’, karena itu tidak benar.”

Secara praktis, deployment dan biaya penggunaan OpenClaw tidak kecil. Tanpa tujuan yang jelas, hanya sekadar “coba-coba”, akan menghabiskan waktu dan tenaga, dan kemungkinan besar tidak akan mendapatkan hasil sesuai harapan.

Wartawan mencatat, dalam pengalaman nyata, OpenClaw juga menghadapi tekanan komputasi dan biaya yang cukup tinggi. Tan Tan, yang mengujinya, menemukan bahwa konsumsi token sangat besar. “Beberapa tugas, seperti menulis kode atau riset, bisa menghabiskan ratusan juta token dalam satu putaran. Kalau konteksnya panjang, bisa mencapai puluhan juta bahkan ratusan juta token per hari.”

Dia menyebutkan, meskipun menggabungkan berbagai model untuk mengontrol biaya, konsumsi total tetap tinggi, sehingga meningkatkan hambatan penggunaan bagi pengguna biasa.

Menurut narasumber, alat seperti ini masih perlu banyak evolusi agar benar-benar bisa masuk ke alur kerja pengguna umum. Bagi individu, penggunaan adalah soal menyeimbangkan keamanan dan kenyamanan, dan saat ini, prioritas utama harus tetap pada keamanan.

Dalam pandangan mereka, alat ini masih perlu banyak perbaikan agar bisa masuk ke alur kerja pengguna biasa secara rutin.

Pengguna biasa, saat memakai alat ini, sebenarnya sedang melakukan pilihan antara keamanan dan kenyamanan, dan saat ini, sebaiknya lebih mengutamakan keamanan.

Jika pengguna pribadi, Ma Zeyu secara tegas tidak akan mengaktifkan fitur Notebook yang memungkinkan agen berkomunikasi bebas satu sama lain, dan akan menghindari agar beberapa agen saling bertukar informasi.“Saya ingin menjadi satu-satunya sumber informasi bagi agen. Semua informasi penting harus diputuskan oleh manusia. Jika agen bisa menerima dan bertukar informasi secara bebas, banyak hal akan menjadi tidak terkendali.”

Menurutnya, saat menggunakan alat ini, pengguna biasa harus sadar bahwa mereka sedang melakukan kompromi antara keamanan dan kenyamanan, dan saat ini, prioritas harus tetap pada keamanan.

Dalam wawancara dengan para pakar AI industri, mereka juga memberikan panduan keamanan yang lebih tegas:

Pertama, batasi secara ketat ruang lingkup informasi sensitif yang diberikan, hanya berikan data dasar yang diperlukan untuk menyelesaikan tugas tertentu, dan hindari memasukkan data sensitif seperti password bank, nomor rekening saham, dan lain-lain. Sebelum mengelola file, bersihkan data pribadi seperti nomor identitas, kontak pribadi, dan lain-lain.

Kedua, berhati-hati dalam membuka akses operasi, pengguna harus memutuskan sendiri batas akses alat, tidak memberikan izin untuk mengakses file sistem utama, perangkat pembayaran, atau akun keuangan. Matikan fungsi otomatis, modifikasi, atau penghapusan file yang berisiko tinggi. Semua operasi yang melibatkan perubahan keuangan, penghapusan file, atau pengaturan sistem harus dikonfirmasi secara manual.

Ketiga, sadari sifat “eksperimental” dari alat ini, karena alat AI open source saat ini masih tahap awal, belum teruji secara luas di pasar, dan tidak cocok untuk mengelola data rahasia, keputusan keuangan penting, dan hal-hal kritis lainnya. Pengguna harus melakukan backup data, rutin memeriksa kondisi sistem, dan segera mendeteksi perilaku abnormal.

Dibandingkan pengguna individu, perusahaan yang mengadopsi alat AI open source harus melakukan pengendalian risiko secara sistematis.

Di satu sisi, mereka bisa mengimplementasikan alat pengawasan khusus; di sisi lain, harus menetapkan batasan penggunaan internal, melarang penggunaan alat AI open source untuk mengelola data pelanggan dan rahasia bisnis, serta melakukan pelatihan rutin untuk meningkatkan kemampuan karyawan mengenali risiko “penyimpangan tugas” dan “injeksi instruksi jahat”.

Para pakar juga menyarankan, untuk skenario penggunaan skala besar, pilihan yang lebih aman adalah menunggu versi komersial yang sudah teruji, atau memilih produk pengganti yang didukung lembaga resmi dan memiliki mekanisme keamanan lengkap, guna mengurangi risiko ketidakpastian dari alat open source.

5. Optimisme terhadap masa depan AI

Menurut para narasumber, penciptaan OpenClaw paling penting adalah membuat orang percaya penuh terhadap masa depan AI.

Ma Zeyu menyatakan, mulai paruh kedua 2025, pandangannya terhadap kemampuan agen mengalami perubahan besar. “Batas kemampuan ini sedang melampaui ekspektasi kita. Peningkatan produktivitasnya nyata, dan kecepatan iterasinya sangat cepat.” Dengan terus meningkatnya kemampuan model dasar, ruang imajinasi tentang agen semakin terbuka, dan ini akan menjadi fokus investasi timnya ke depan.

Dia juga menyoroti tren penting: interaksi jangka panjang dan skala besar antar multi-agen. Kolaborasi kelompok ini bisa menjadi jalur utama untuk memicu kecerdasan tingkat lebih tinggi, mirip dengan bagaimana masyarakat manusia menghasilkan kecerdasan kolektif melalui interaksi.

Menurut Ma Zeyu, risiko agen cerdas harus “dikelola”. “Seperti masyarakat manusia sendiri yang tidak bisa menghilangkan risiko, kuncinya adalah mengendalikan batasnya.” Secara teknis, solusi yang lebih realistis adalah menjalankan agen dalam sandbox dan lingkungan terisolasi, secara bertahap dan terkendali memindahkannya ke dunia nyata, bukan langsung memberi hak terlalu tinggi.

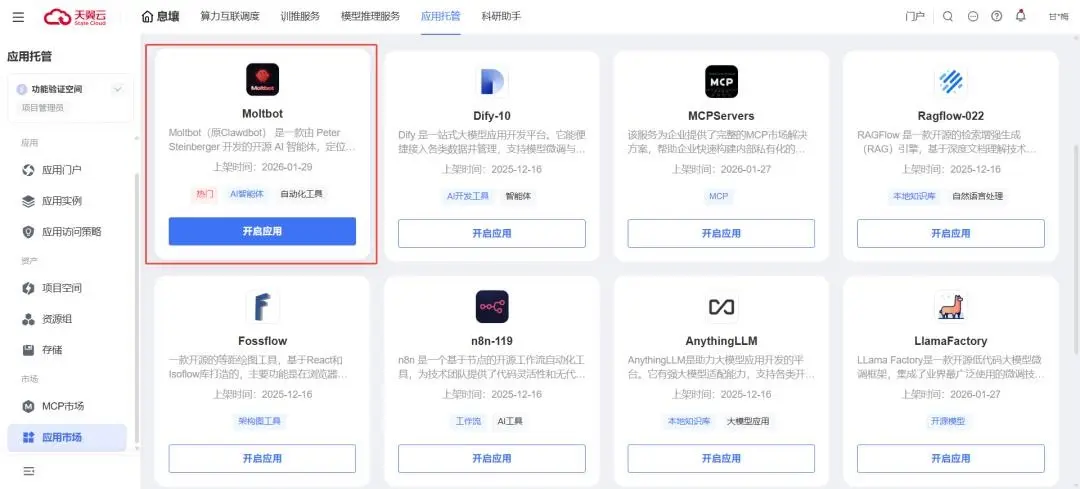

Ini terlihat dari berbagai pengembangan dari penyedia cloud dan perusahaan besar. Cheng Tan dari Tianyi Cloud baru-baru ini meluncurkan layanan deployment dan operasional OpenClaw secara cloud satu klik.

Penyedia cloud mengemasnya sebagai layanan pendukung, secara esensial mengubah kemampuan ini menjadi produk yang terstandarisasi dan skala besar. Ini akan memperbesar nilai, menurunkan hambatan deployment, meningkatkan integrasi alat, serta menyediakan infrastruktur komputasi dan operasional yang lebih stabil, sehingga perusahaan bisa lebih cepat memanfaatkan agen cerdas. Tapi, harus diingat, jika infrastruktur komersial ini mengakses “agen dengan hak tinggi”, risiko juga akan membesar secara bersamaan.

Tan Tan mengatakan, selama tiga tahun terakhir, kecepatan evolusi dari model dialog tradisional ke agen yang mampu menjalankan tugas jauh melampaui bayangan. “Ini sesuatu yang tidak terbayangkan tiga tahun lalu.” Ia berpendapat, dua sampai tiga tahun ke depan akan menjadi periode kunci menentukan arah kecerdasan buatan umum, dan ini membawa peluang serta harapan baru bagi para pelaku industri dan masyarakat umum.

Meskipun perkembangan OpenClaw dan Modelbook jauh melampaui ekspektasi, Hu Xia berpendapat, “Risiko secara keseluruhan saat ini masih dalam kerangka penelitian yang terkendali, dan ini membuktikan perlunya membangun sistem ‘keamanan internal’. Tapi, kita juga harus sadar bahwa, AI sedang mendekati ‘batas keamanan’ manusia dengan kecepatan yang lebih cepat dari yang dibayangkan, dan kita tidak hanya perlu memperbesar ‘batas’ tersebut, tetapi juga mempercepat pembangunan kemampuan ‘menghancurkan meja’ di saat-saat kritis, untuk memperkuat pertahanan akhir di era AI.”