Les lunettes intelligentes Meta dévoilées : images privées envoyées en Kenya pour entraîner l'IA, y compris lors de bains, relations sexuelles, numéros de carte de crédit…

Les médias suédois révèlent qu’les utilisateurs des lunettes intelligentes Meta Ray-Ban envoient leurs images privées (de la scène de toilette à la nudité) sur l’écran d’un examinateur externalisé au Kenya, tandis que les vendeurs en magasin assurent aux consommateurs que « les données restent localement ».

(Précédent : Zuckerberg prédit l’extinction du téléphone ! La future humanité passe par l’IA, les lunettes intelligentes et la projection holographique)

(Contexte supplémentaire : Un ancien cadre de Meta accuse Zuckerberg de collusion avec le pouvoir : création secrète d’outils de censure sur Facebook en Hong Kong et Taïwan, vente des données privées des utilisateurs Facebook)

Sommaire

Toggle

- Le masque défectueux, le vendeur muet

- La triple identité d’une paire de lunettes

- La résistance populaire dans le signal Bluetooth

- L’effondrement structurel du mécanisme d’accord

Selon une enquête conjointe du Swedish Daily News et du Göteborgs-Posten : les utilisateurs des lunettes intelligentes Meta envoient tout votre vie privée en Kenya !

Les faits révélés par l’enquête sont les suivants : lorsque l’utilisateur active la fonction IA des lunettes Meta Ray-Ban (que ce soit pour reconnaître des objets, traduire un menu ou répondre à une question), les images et voix capturées par la caméra sont transmises aux serveurs de Meta situés à Luleå en Suède et au Danemark.

Ensuite, ces données sont confiées à l’externalisation à Sama, une société basée à Nairobi, employant des milliers de travailleurs qui examinent, annotent et classent ces données pour entraîner les modèles d’IA.

Un examinateur kenyan a dit à un journaliste :

« Nous voyons tout — du salon à la nudité. Ce sont des personnes comme nous. »

Ils voient notamment : des images dans la salle de bain, des scènes de relations sexuelles, des numéros de carte de crédit accidentellement filmés, des conversations privées, et des vidéos de contenus pour adultes regardés par l’utilisateur.

Le masque défectueux, le vendeur muet

Le système de Meta devrait théoriquement inclure une sécurité : un algorithme de masquage automatique floutant les visages et informations sensibles. Mais l’enquête suédoise montre que ce système échoue fréquemment. Les examinateurs peuvent voir clairement des scènes de la vie quotidienne dans des maisons ordinaires, sans que les personnes sachent que leurs lunettes filment, ni que leurs images apparaissent sur l’écran d’un étranger à l’autre bout du monde.

Plus ironique encore, il existe un décalage d’information côté consommateur. Des vendeurs dans dix magasins de lunettes à Stockholm et Göteborg, principalement sous les marques Synsam et Synoptik, assurent que : « l’utilisateur contrôle tout, toutes les données restent dans l’application sur le téléphone, rien n’est transféré ailleurs. »

Ce qui est totalement contraire à la réalité.

L’utilisation de la fonction IA des lunettes Meta Ray-Ban nécessite un traitement via l’infrastructure de Meta, il n’existe pas d’option de traitement local pur. Les enregistrements vocaux sont stockés dans le cloud jusqu’à un an pour « améliorer le système IA », sans mécanisme de retrait sauf suppression manuelle. Plusieurs vendeurs admettent ne pas savoir quelles données exactes sont transmises par les lunettes.

L’Autorité suédoise de protection des données (IMY) met en garde : cette stratégie marketing masque de véritables risques pour la vie privée. Les consommateurs ignorent le traitement en arrière-plan. La réponse de Meta est une ligne de défense standard : l’entreprise respecte le contrat d’utilisation et le RGPD, la localisation des examinateurs « n’affecte pas la conformité tant que les règles sont respectées ».

La triple identité d’une paire de lunettes

L’enquête suédoise dévoile la première couche du problème de vie privée des lunettes Meta : ce que vous croyez privé est en réalité examiné par des étrangers. Mais ce n’est que la partie émergée de l’iceberg.

La deuxième couche apparaît de l’autre côté de l’Atlantique. Des agents de l’Immigration et des Douanes américaines (ICE) ont été repérés portant des lunettes Meta Ray-Ban lors d’opérations, photographiant des migrants présumés sans papiers dans des lieux publics, puis croisant ces images avec des bases de données et des réseaux sociaux. Selon « The Verge », ce n’est pas un cas isolé, mais une pratique en expansion.

Une simple paire de dispositifs grand public devient, sans mandat judiciaire ni perquisition, un outil de surveillance d’État.

La troisième couche est la menace la plus structurée. Mi-février, le New York Times a obtenu des documents internes de Meta révélant que Reality Labs développe une fonction de reconnaissance faciale en temps réel, nommée « Name Tag » : en regardant quelqu’un, l’IA peut comparer instantanément avec les données de Meta pour afficher le nom, les infos personnelles et les amis communs. Un passage effrayant d’un document interne indique : « Nous lancerons dans un environnement politique dynamique, où de nombreux groupes de la société civile concentreront leurs ressources sur d’autres enjeux. »

Autrement dit : Meta sait que cette fonction suscitera des résistances, alors elle choisit de la déployer lorsque ses adversaires sont distraits.

En cumulant ces trois couches, une paire de lunettes à 299 dollars joue simultanément trois rôles : collecte silencieuse de données pour l’entraînement IA, outil de surveillance invisible pour l’État, et arme sociale d’identification en temps réel. Et personne autour de vous (filmée, identifiée, surveillée) n’a jamais donné son « consentement ».

La résistance dans le signal Bluetooth

La réponse institutionnelle est lente et décevante. L’EPIC (Centre pour la vie privée et l’information électronique) a écrit à la FTC pour demander une enquête, mais dans le contexte politique actuel, l’efficacité des régulateurs reste incertaine. Le RGPD européen existe, mais la réponse standard de Meta est « nous sommes conformes », alors que le flux réel de données et les engagements de conformité révèlent un écart que les journalistes suédois ont mis en lumière lors de leur visite dans dix magasins.

La première réponse concrète vient d’un sociologue suisse. Yves Jeanrenaud, développeur indépendant, a lancé fin février « Nearby Glasses », une application Android qui, en scannant le code fabricant dans la publicité Bluetooth Low Energy (BLE), alerte lorsqu’il détecte des lunettes Meta ou Snap à moins de 10-15 mètres.

Il explique que sa motivation est « d’avoir été témoin de l’ampleur des abus liés à ces lunettes et de leur nature anti-humaine ». Des cas de vidéos dans des salons de beauté, des tribunaux, des cliniques, des toilettes… chaque cas étant réel, pas une hypothèse.

L’effondrement structurel du mécanisme d’accord

Revenons à la question fondamentale : pourquoi les lunettes Meta deviennent-elles une crise de vie privée plutôt qu’un simple produit ? Parce qu’elles détruisent le principe même du cadre moderne de la vie privée : le modèle « informer — consentir ».

Traditionnellement, une entreprise doit vous informer et obtenir votre consentement avant de collecter vos données. Mais la façon dont Ray-Ban Meta fonctionne fait s’effondrer ce principe sur trois fronts simultanément.

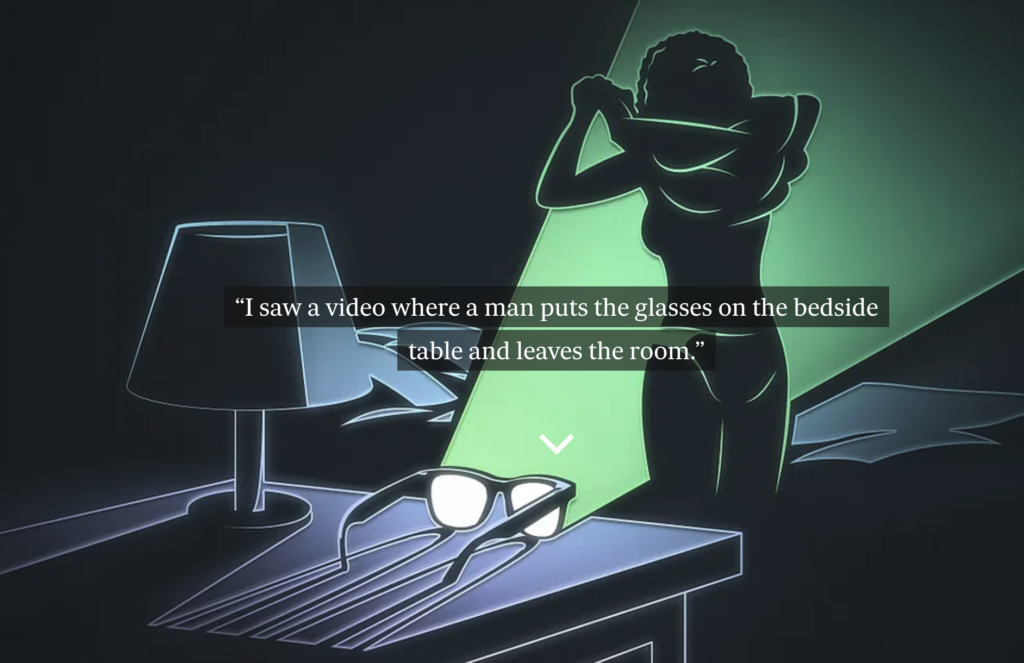

Pour l’utilisateur, le vendeur en magasin dit que les données restent localement, mais en réalité, elles sont envoyées en Danemark et au Kenya.

Pour la personne filmée, vous n’êtes pas utilisateur de Meta, vous n’avez pas donné votre consentement, et vous ne savez même pas que vous êtes filmé.

Pour les examinateurs à Nairobi, ils sont forcés de regarder les moments les plus privés d’étrangers, avec un coût psychologique que Meta ne mentionne jamais dans ses rapports ESG.

La protection de la vie privée ne dépend pas du texte de la loi, mais de la crainte que les entreprises pensent que vous ne poursuivrez pas. Et Meta semble avoir anticipé cela : vous ne le ferez pas…