OpenAI revendique des « lignes rouges » en matière de sécurité dans l'accord avec le Pentagone—mais les utilisateurs n'y croient pas

En résumé

- OpenAI a signé un accord avec le Pentagone pour déployer l’IA dans des environnements classifiés.

- La société a déclaré avoir imposé des « lignes rouges », mais le contrat autorise « tous les usages légaux », une norme qui dépend en fin de compte de l’interprétation du gouvernement.

- La controverse a déclenché le mouvement QuitGPT et entraîné une hausse des téléchargements de Claude.

OpenAI a annoncé ce week-end avoir conclu un accord avec le Pentagone pour déployer des systèmes d’IA avancés dans des environnements classifiés, marquant une expansion significative de ses collaborations avec l’armée américaine. L’annonce est intervenue moins de 24 heures après que l’administration Trump a inscrit Anthropic sur la liste noire, qualifiant la société concurrente d’IA de « risque pour la sécurité nationale » suite à un différend sur la formulation du contrat concernant la surveillance et les armes autonomes. Le président Donald Trump a également ordonné aux agences fédérales de cesser immédiatement d’utiliser la technologie d’Anthropic, le secrétaire au Trésor Scott Bessent écrivant lundi sur X que l’agence « met fin à toute utilisation des produits d’Anthropic, y compris la plateforme Claude, au sein de notre département ».

"LES ÉTATS-UNIS D’AMÉRIQUE NE PERMETTRONT JAMAIS À UNE ENTREPRISE RADICALE DE GAUCHE, WOKE, DE DICTER COMMENT NOTRE GRANDE ARMÉE COMBAT ET GAGNE LES GUERRES ! Cette décision appartient à VOTRE COMMANDANT EN CHEF, et aux grands leaders que je nomme pour diriger notre armée.

Les extrémistes de gauche chez Anthropic… pic.twitter.com/aIEx92nnyx

— La Maison Blanche (@WhiteHouse) 27 février 2026

Le calendrier des annonces sur l’IA a placé l’accord d’OpenAI sous une forte surveillance. Dans un article de blog détaillé, la société a exposé ce qu’elle décrit comme des « lignes rouges » fermes et des mesures de sécurité encadrant son partenariat avec le Pentagone. L’accord, tel que présenté par OpenAI, soulève des questions plus larges sur la gouvernance des systèmes d’IA en contexte de sécurité nationale, et sur la façon dont les restrictions déclarées par la société seront interprétées et appliquées concrètement. Quand « légal » ne suffit pas Le blog d’OpenAI commence par trois engagements présentés comme non négociables : pas d’utilisation de sa technologie pour la surveillance massive intérieure, pour diriger de manière autonome des armes, ou pour des décisions automatisées à enjeu élevé comme le score de crédit social. Vient ensuite le véritable langage du contrat — qu’OpenAI appelle « le langage pertinent », et non « l’intégralité de l’accord ».

« Le Département de la Guerre peut utiliser le système d’IA pour tous les usages légaux, conformément à la loi applicable, aux exigences opérationnelles et aux protocoles de sécurité et de supervision bien établis », a déclaré OpenAI. C’est exactement la phrase que Anthropic a dit que le gouvernement exigeait tout au long des négociations. La même phrase que Anthropic a refusé d’accepter. OpenAI l’a signée, tout en affirmant que ses lignes rouges restent entièrement en place. Cependant, « légal » dans un contexte de sécurité nationale n’est pas une limite fixe — il évolue dans un patchwork de lois, décrets exécutifs, directives internes, et souvent d’interprétations juridiques classifiées. Lorsqu’un contrat autorise « tous les usages légaux », la limite pratique devient l’enveloppe juridique actuelle du gouvernement, et non une norme indépendante fixée par le fournisseur. Un ensemble de clauses La clause sur les armes stipule que le système d’IA « ne sera pas utilisé pour diriger de manière autonome des armes dans tous les cas où la loi, la réglementation ou la politique du département exigent un contrôle humain ». L’interdiction ne s’applique que lorsque une autre autorité exige déjà un contrôle humain — elle s’appuie entièrement sur la politique existante, notamment la Directive 3000.09 du DoD. Cette directive impose que les systèmes autonomes permettent aux commandants d’exercer « un niveau approprié de jugement humain sur l’usage de la force ». Et « approprié » est aussi subjectif que possible. Le jugement humain ne signifie pas contrôle humain. Cette distinction n’est pas accidentelle. Des experts en défense ont noté que l’omission du langage « boucle humaine » était délibérée, précisément pour préserver la flexibilité opérationnelle.

L’argument le plus fort d’OpenAI réside dans son architecture déployée uniquement dans le cloud — des boucles de décision létales entièrement autonomes nécessiteraient un déploiement en périphérie sur des dispositifs de terrain, ce que ce contrat ne permet pas. C’est une contrainte technique réelle. Mais l’IA basée sur le cloud peut toujours effectuer l’identification de cibles, l’analyse de motifs de vie, et la planification de missions. Ce sont des activités de la chaîne de destruction, quel que soit l’endroit où se trouve le déclencheur final. Le résultat pour une cible ne diffère pas selon le serveur sur lequel le modèle fonctionne. La clause sur la surveillance suit un schéma similaire. La ligne rouge déclarée par OpenAI : pas de surveillance massive intérieure. La formulation du contrat : le système « ne sera pas utilisé pour une surveillance non contrainte des informations privées des personnes américaines conformément à ces autorités » — puis liste le Quatrième Amendement, FISA, et le Décret Exécutif 12333. Le mot « non contrainte » implique qu’une version limitée de la surveillance massive serait autorisée. Et le Décret Exécutif 12333 est l’ordre exécutif que la NSA a utilisé pour justifier l’interception des communications américaines lorsqu’elle est effectuée en dehors des frontières américaines. Et c’est là que les préoccupations d’Anthropic concernant la formulation tout au long des négociations deviennent visibles. La société soutenait que la législation actuelle n’a pas rattrapé ce que l’IA permet de faire. Le gouvernement peut légalement acheter d’énormes quantités de données commerciales agrégées sur les Américains sans mandat — ce qu’il a déjà fait. Le langage du contrat d’OpenAI, en ancrant ses protections dans le cadre juridique existant, pourrait ne pas combler l’écart qui préoccupait réellement Anthropic. Réponse d’Altman Sam Altman a organisé un AMA samedi soir pour répondre à des milliers de questions sur l’accord. Lorsqu’on lui a demandé ce qui pourrait faire qu’OpenAI se retire d’un partenariat avec le gouvernement, il a répondu : « Si on nous demande de faire quelque chose d’inhumain ou d’illégal, on se retirera. »

Si on nous demande de faire quelque chose d’inhumain ou d’illégal, on se retirera. Venez me voir en prison si nécessaire.

— Sam Altman (@sama) 1er mars 2026

Ce cadre place la limite d’OpenAI au niveau de la légalité — et non d’un jugement éthique indépendant sur ce que la société autoriserait ou non si cela était légal, ce que défend Anthropic. Interrogé sur le risque de futurs différends concernant ce qui est « légal », il a reconnu le risque : « Si nous devons engager ce combat, nous le ferons, mais cela nous expose clairement à certains risques. » Quant à la raison pour laquelle OpenAI a conclu un accord que Anthropic ne pouvait pas, Altman a expliqué : « Anthropic semblait plus concentré sur des interdictions spécifiques dans le contrat, plutôt que sur la référence aux lois applicables, ce avec quoi nous étions à l’aise. Je préférerais clairement m’appuyer sur des garanties techniques si je ne devais en choisir qu’une. Je pense qu’Anthropic aurait voulu plus de contrôle opérationnel que nous. » C’est une différence philosophique fondamentale. Anthropic soutenait que, parce que les modèles de pointe peuvent être réorientés pour des flux de travail de renseignement et militaires de manières difficiles à anticiper, les limites doivent être explicites et contraignantes par écrit, même au prix de l’accord. La position d’OpenAI est que l’architecture technique, le personnel intégré, et le cadre juridique existant constituent une protection plus solide que le seul texte contractuel. Le public a choisi un camp

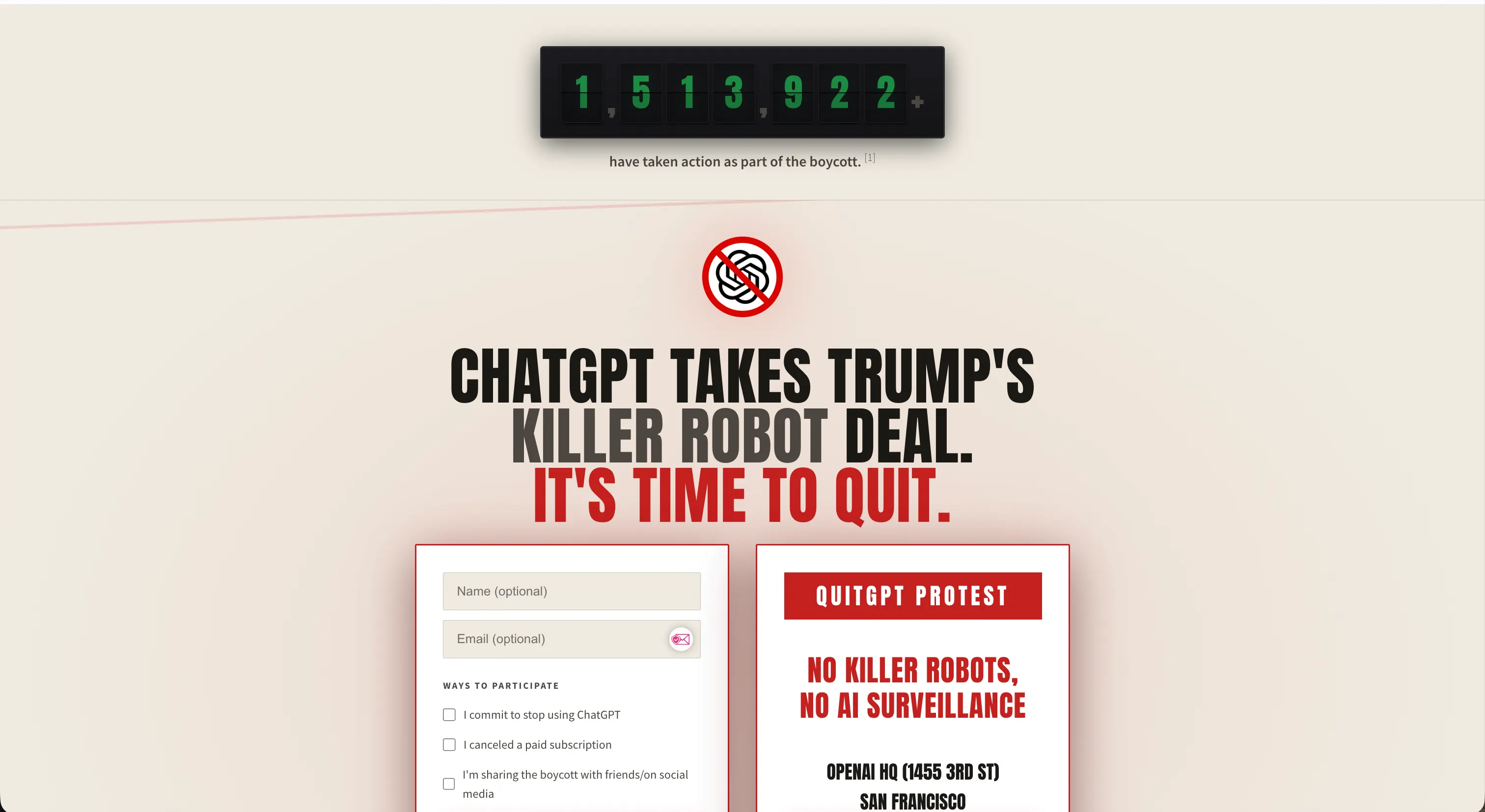

La réaction a été immédiate. Dès lundi, le mouvement « QuitGPT » a affirmé que plus de 1,5 million de personnes avaient agi — en annulant leurs abonnements, en partageant des posts de boycott, ou en s’inscrivant sur quitgpt.org.

La campagne a présenté la démarche d’OpenAI comme priorisant les contrats militaires au détriment de la sécurité des utilisateurs, accusant la société d’avoir accepté que le Pentagone utilise sa technologie pour « tous les usages légaux, y compris les robots tueurs et la surveillance de masse ».

OpenAI pourrait contester cette caractérisation. Mais le marché a évolué malgré tout.

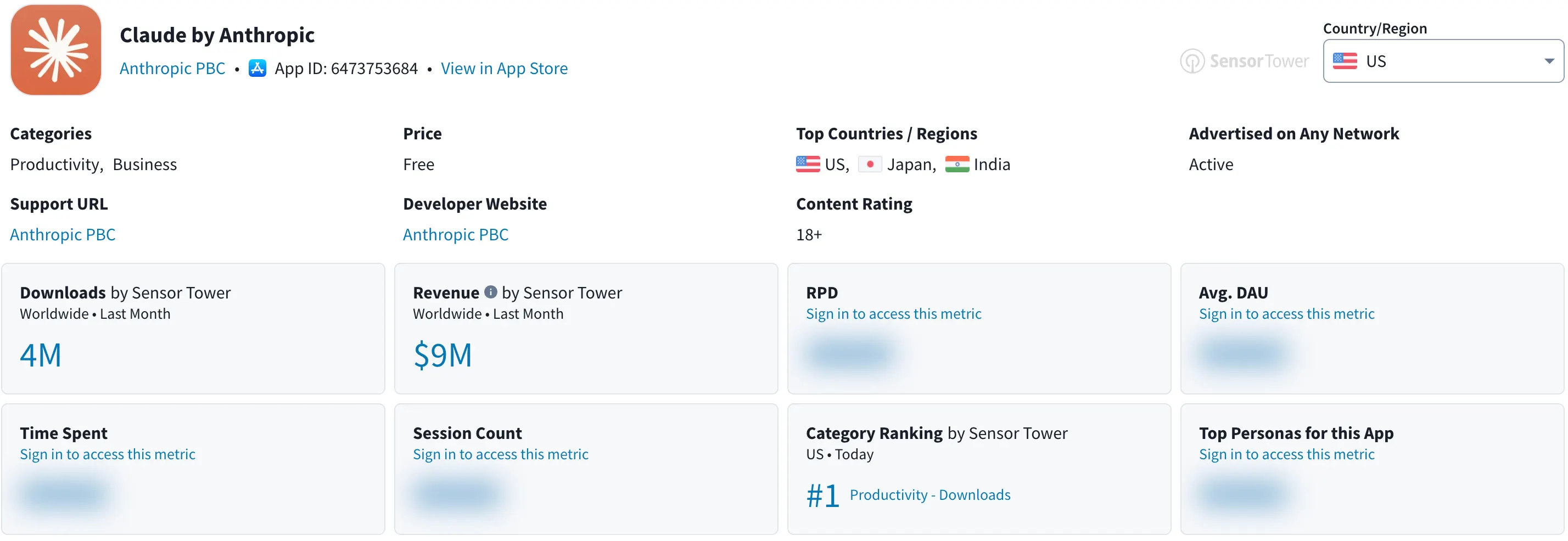

Claude d’Anthropic a dépassé ChatGPT pour devenir l’application gratuite la plus téléchargée aux États-Unis sur l’App Store d’Apple, la société indiquant à Decrypt avoir enregistré un nombre record d’inscriptions quotidiennes durant le week-end.

La star de la pop Katy Perry a partagé une capture d’écran de la page de prix de Claude sur X. Des centaines d’utilisateurs ont publié publiquement leurs annulations d’abonnement sur Reddit. Des graffitis louant Anthropic sont apparus devant ses bureaux de San Francisco, tandis que des attaques à la craie ont couvert les trottoirs d’OpenAI. Même des centaines d’employés d’OpenAI avaient signé une lettre ouverte soutenant le refus d’Anthropic de céder aux exigences du Pentagone.

Le discours QuitGPT est émotionnellement convaincant, mais pas entièrement précis. Anthropic a elle-même un partenariat avec Palantir et Amazon Web Services qui donne accès aux agences de renseignement américaines et aux départements de défense aux modèles Claude, et aurait été utilisé dans des opérations militaires pour renverser les gouvernements du Venezuela et d’Iran. La question de l’éthique de l’IA et des contrats de sécurité nationale n’a jamais été claire de part et d’autre. Ce que la campagne a bien capté, c’est qu’une large part des utilisateurs pensaient qu’il existait une différence significative dans la manière dont les deux sociétés définissaient leurs limites — et ont voté en fonction de leurs abonnements. Il faut toutefois lire attentivement le contrat pour déterminer si cette différence est réellement aussi importante qu’elle en a l’air.