72 heures, triple crise : l'âme d'Anthropic est en train d'être mise aux enchères

Écriture : Ada, Deep Tide TechFlow

Mardi 24 février. Washington, Pentagon.

Dario Amodei, PDG d’Anthropic, est assis en face du secrétaire à la Défense Pete Hegseth. Selon plusieurs médias, dont NPR et CNN, l’atmosphère de la rencontre est « polie », mais le contenu n’a rien de courtois.

Hegseth lui a lancé un ultimatum : avant 17h01 vendredi, lever les restrictions militaires sur Claude, autoriser le Pentagone à l’utiliser « pour toutes les utilisations légales », y compris la visée autonome d’armes et la surveillance de masse nationale.

Sinon, annuler le contrat de 200 millions de dollars. Activer la « Loi sur la production de défense », procéder à la conscription. Classer Anthropic comme « risque de chaîne d’approvisionnement », ce qui revient à le mettre sur la liste noire des entités hostiles de Russie et de Chine.

Le même jour, Anthropic a publié la troisième version de sa « Politique d’expansion responsable » (RSP 3.0), supprimant discrètement une promesse fondamentale depuis la création de l’entreprise : si la sécurité n’est pas assurée, il ne faut pas entraîner des modèles plus puissants.

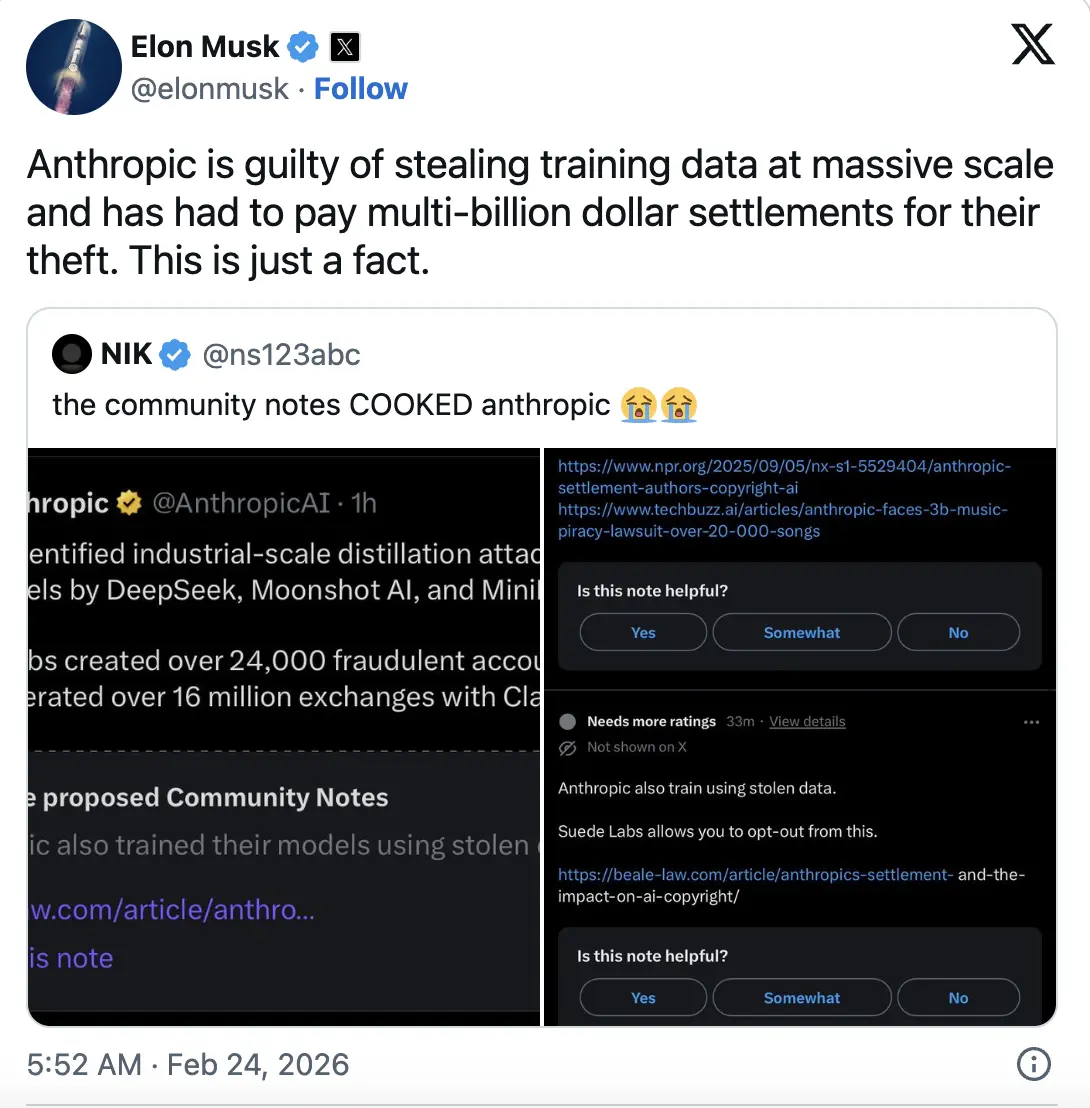

C’est aussi le jour où Elon Musk a posté sur X : « Anthropic vole massivement des données d’entraînement, c’est un fait. » Par ailleurs, la note communautaire de X a ajouté que Anthropic aurait payé 1,5 milliard de dollars pour un règlement concernant l’utilisation de livres piratés pour entraîner Claude.

En 72 heures, cette entreprise d’IA, qui se revendique « avec une âme », a joué trois rôles : martyr de la sécurité, voleur de propriété intellectuelle, traître au Pentagone.

Lequel est le vrai ?

Peut-être tous.

Le « soit obéissez, soit dégagez » du Pentagone

La première partie de l’histoire est simple.

Anthropic est la première société d’IA à obtenir un accès classifié du Département de la Défense américain. Le contrat, signé l’été dernier, plafonné à 200 millions de dollars. OpenAI, Google, xAI ont rapidement obtenu des contrats équivalents.

Selon Al Jazeera, Claude aurait été utilisé lors d’une opération militaire en janvier dernier, impliquant l’enlèvement du président vénézuélien Maduro.

Mais Anthropic a tracé deux lignes rouges : pas de visée autonome totale, pas de surveillance de masse des citoyens américains. La société estime que l’IA n’est pas encore fiable pour manipuler des armes, et qu’aucune loi ou réglementation ne régit encore son usage dans la surveillance de masse.

Le Pentagone n’a pas accepté.

David Sacks, conseiller à l’IA à la Maison Blanche, a accusé publiquement en octobre dernier sur X qu’Anthropic « utilise la peur comme arme pour contrôler la réglementation ».

Les concurrents ont plié. OpenAI, Google, xAI ont accepté de laisser l’armée utiliser leur IA dans « tous les scénarios légaux ». Musk a récemment obtenu l’autorisation pour Grok d’accéder à des systèmes classifiés.

Anthropic est le dernier debout.

Au moment de la rédaction, dans une déclaration récente, ils ont affirmé ne pas vouloir céder. Mais le délai de vendredi 17h01 approche à grands pas.

Un ancien contact anonyme du DOJ et du DOD a exprimé sa perplexité à CNN : « Comment peut-on à la fois déclarer qu’une entreprise est ‘risque de chaîne d’approvisionnement’ et la forcer à travailler pour l’armée ? »

Bonne question, mais cela ne figure pas dans le périmètre du Pentagone. Leur priorité, c’est si Anthropic ne cède pas, ils utiliseront la force ou la laisseront tomber.

« Attaque par distillation » : une accusation cinglante

Le 23 février, Anthropic a publié un blog virulent accusant trois entreprises chinoises d’avoir lancé une « attaque de distillation industrielle » contre Claude.

Les accusés sont DeepSeek, Moonshot AI, MiniMax.

Anthropic affirme qu’elles ont utilisé 24 000 faux comptes pour engager plus de 16 millions d’interactions avec Claude, ciblant l’extraction de ses capacités clés en raisonnement, appel d’outils et programmation.

L’entreprise qualifie cette opération de menace à la sécurité nationale, affirmant que le modèle distillé « ne conserve probablement pas les garde-fous de sécurité » et pourrait être utilisé par des gouvernements autoritaires pour des cyberattaques, de la désinformation et de la surveillance de masse.

Le récit est parfait, le timing aussi.

Juste après que l’administration Trump a assoupli les contrôles à l’exportation de puces vers la Chine, et alors qu’Anthropic cherchait à alimenter la controverse pour justifier ses positions sur ces exportations.

Mais Musk a tiré : « Anthropic vole massivement des données d’entraînement, et a payé des milliards en règlements. C’est un fait. »

Tory Green, co-fondateur de IO.Net, société d’infrastructure IA, a commenté : « Vous entraînez votre modèle avec toutes les données du web, puis d’autres utilisent votre API publique pour apprendre, et c’est ça une ‘attaque de distillation’ ? »

Anthropic qualifie cette opération d’« attaque », mais dans l’industrie de l’IA, c’est courant. OpenAI a utilisé cette technique pour compresser GPT-4, Google pour optimiser Gemini, et même Anthropic s’y adonne. La seule différence, c’est que cette fois, c’est leur propre modèle qui est distillé.

Selon Erik Cambria, professeur d’IA à l’Université nationale de Singapour, interviewé par CNBC : « La frontière entre utilisation légitime et exploitation malveillante est souvent floue. »

Plus ironique encore, c’est qu’Anthropic a payé 1,5 milliard de dollars pour un règlement concernant l’utilisation de livres piratés pour entraîner Claude. Elle utilise toutes les données du web pour entraîner ses modèles, puis accuse les autres d’utiliser ses API publiques pour apprendre… ce n’est pas une double norme, c’est une triple norme.

Elle voulait jouer la victime, mais elle s’est retrouvée accusée.

Démantèlement de la promesse de sécurité : RSP 3.0

Le même jour, alors qu’elle affrontait le Pentagone et se livrait à une guerre de communication avec la Silicon Valley, Anthropic a publié la troisième version de sa Politique d’expansion responsable.

Jared Kaplan, le principal scientifique d’Anthropic, a déclaré dans une interview : « Nous pensons que cesser la formation de modèles d’IA n’aide personne. Dans un contexte de développement rapide de l’IA, faire des promesses unilatérales… cela n’a pas de sens. »

Autrement dit, si les autres ne jouent pas le jeu loyal, eux non plus ne feront pas semblant.

Les versions 1.0 et 2.0 de la RSP comportaient une promesse ferme : si le modèle dépassait la couverture de sécurité, il fallait arrêter la formation. Cette promesse a valu à Anthropic une réputation unique dans le cercle de la sécurité de l’IA.

Mais la 3.0 l’a supprimée.

À la place, un cadre plus « flexible » a été instauré, séparant les mesures de sécurité qu’Anthropic peut prendre de celles nécessitant une collaboration sectorielle. Un rapport de risque est publié tous les 3 à 6 mois, avec l’avis d’experts externes.

Cela paraît responsable ?

Chris Painter, évaluateur indépendant du groupe non lucratif METR, a commenté après avoir examiné un brouillon préliminaire : « Cela montre qu’Anthropic pense devoir passer en ‘mode triage’, car ses méthodes d’évaluation et d’atténuation des risques ne suivent pas la croissance de ses capacités. Cela prouve surtout que la société n’est pas prête face aux risques potentiellement catastrophiques de l’IA. »

Selon TIME, cette refonte a été discutée en interne pendant près d’un an, et approuvée à l’unanimité par Amodei et le conseil d’administration. La version officielle : la politique initiale visait à favoriser une norme sectorielle, mais le secteur n’a pas suivi. Le gouvernement Trump a laissé faire, voire tenté d’abroger les lois locales. La législation fédérale sur l’IA est toujours en suspens. Bien qu’un cadre mondial semble encore envisageable en 2023, trois ans plus tard, cette porte est fermée.

Un chercheur anonyme spécialisé en gouvernance de l’IA a résumé : « La RSP est le plus précieux actif de marque d’Anthropic. Supprimer la promesse de suspendre la formation, c’est comme une société bio qui retire discrètement ‘bio’ de ses emballages, puis prétend que ses contrôles sont plus transparents. »

Une identité déchirée sous une valorisation de 380 milliards

Début février, Anthropic a levé 300 milliards de dollars à une valorisation de 380 milliards, avec Amazon comme investisseur principal. Depuis sa création, elle affiche un chiffre d’affaires annualisé de 14 milliards de dollars, en croissance de plus de 10 fois chaque année ces trois dernières années.

Parallèlement, le Pentagone menace de la mettre sur liste noire. Musk l’accuse publiquement de vol de données. Ses engagements en matière de sécurité ont été supprimés. Après le départ de Mrinank Sharma, responsable sécurité IA, qui a écrit sur X : « Le monde est en danger », la contradiction est flagrante.

Une contradiction ?

Peut-être que la contradiction est dans l’ADN d’Anthropic.

Créée par d’anciens cadres d’OpenAI, elle a été fondée par ceux qui craignaient que OpenAI n’avance trop vite sur la sécurité. Ensuite, ils ont lancé leur propre société pour construire des modèles plus puissants, tout en dénonçant leur dangerosité.

Leur modèle économique : nous sommes plus effrayés par l’IA que quiconque, alors payez-nous pour la créer.

Ce récit a parfaitement fonctionné en 2023-2024. La sécurité de l’IA est un mot d’ordre à Washington, et Anthropic est la principale société de lobbying.

Mais en 2026, le vent tourne.

« Woke AI » devient une insulte, la réglementation étatique est bloquée par la Maison Blanche, la loi californienne SB 53, soutenue par Anthropic, est adoptée mais sans suite fédérale.

La sécurité d’Anthropic, qui était un avantage différenciateur, devient un passif politique.

Elle doit jongler entre deux exigences : rester « sûre » pour préserver sa marque, mais aussi être suffisamment « flexible » pour ne pas être abandonnée par le marché ou le gouvernement. Le problème, c’est que l’espace de tolérance se réduit des deux côtés.

Combien vaut encore la narration de sécurité ?

En superposant ces trois éléments, le tableau est clair.

Accuser des entreprises chinoises de distillation de Claude sert à renforcer la narration sur le contrôle des exportations de puces. La suppression de la promesse de pause de formation pour ne pas perdre la course à l’armement. Refuser la demande du Pentagone pour des armes autonomes, pour préserver une dernière couche de morale.

Chaque étape a sa logique, mais elles se contredisent.

On ne peut pas à la fois dire que la distillation chinoise met en danger la sécurité nationale, et supprimer la promesse de contrôle de ses propres modèles. Si l’IA est si dangereuse, il faudrait être plus prudent, pas plus agressif.

À moins que vous ne soyez Anthropic.

Dans l’industrie de l’IA, l’identité ne se définit pas par vos déclarations, mais par votre bilan. La « sécurité » d’Anthropic n’est qu’un levier de valorisation de marque.

Au début de la course à l’armement IA, cette valeur était payée. Les investisseurs acceptaient une valorisation plus élevée pour une IA « responsable », le gouvernement donnait son feu vert à une IA « fiable », et les clients payaient pour une IA « plus sûre ».

Mais en 2026, cette prime s’évapore.

Ce que doit aujourd’hui faire Anthropic, ce n’est pas choisir entre « céder » ou « résister », mais plutôt « à qui faire des concessions en premier ». Céder au Pentagone, c’est ternir sa marque. Céder à ses concurrents, c’est perdre ses promesses de sécurité. Céder aux investisseurs, c’est faire perdre tout le monde.

Vendredi à 17h01, Anthropic donnera sa réponse.

Mais une chose est sûre : l’Anthropic qui se voulait différente d’OpenAI, qui se voulait porte-drapeau de la sécurité, devient comme tout le monde.

Le point final de la crise d’identité, c’est souvent la disparition de cette identité.