Une petite écrevisse fait exploser le monde de la technologie, l'humanité est-elle prête à « renverser la table » ?

Auteur : Jia Tianrong, « IT Times » (ID : vittimes)

Une langouste a déclenché une explosion dans le monde de la technologie.

De Clawdbot à Moltbot, puis à OpenClaw aujourd’hui, en seulement quelques semaines, cet agent IA a réalisé une « saut technologique » à travers l’itération de son nom.

Ces derniers jours, il a provoqué un « tsunami d’agents intelligents » à Silicon Valley, accumulant 100 000 étoiles sur GitHub, se classant parmi les applications IA les plus populaires. Il suffit d’un Macmini obsolète, voire d’un vieux téléphone, pour que l’utilisateur puisse faire fonctionner un assistant IA « capable d’écouter, de penser et de travailler ».

Sur Internet, une fête créative autour de lui a déjà commencé. De la gestion d’agenda, du trading intelligent, de la production de podcasts à l’optimisation SEO, développeurs et geeks construisent diverses applications avec lui. L’ère où chacun possède un « Jarvis » semble à portée de main. De grandes entreprises nationales et internationales commencent également à suivre le mouvement, déployant des services d’agents intelligents similaires.

Mais derrière cette apparence animée, l’anxiété se répand.

D’un côté, le slogan « égalité des capacités de production » ; de l’autre, la fracture numérique toujours difficile à franchir : configuration environnementale, installation de dépendances, réglages d’autorisations, erreurs fréquentes, etc.

Lors de ses expérimentations, le journaliste a constaté que même l’installation pouvait prendre plusieurs heures, excluant de nombreux utilisateurs ordinaires. « Tout le monde dit que c’est génial, mais moi je ne peux même pas entrer dans la porte », devient la première frustration pour beaucoup de novices techniques.

Une inquiétude plus profonde provient de sa « capacité d’action ».

Si votre « Jarvis » commence à supprimer des fichiers par erreur, à utiliser frauduleusement une carte de crédit, à être induit en erreur pour exécuter des scripts malveillants, ou même à recevoir des instructions d’attaque en ligne — un tel agent intelligent, oseriez-vous lui confier votre ordinateur ?

La vitesse de développement de l’IA dépasse l’imagination humaine. Hu Xia, scientifique en chef du laboratoire d’intelligence artificielle de Shanghai, pense qu’en face de risques inconnus, « la sécurité endogène » est la réponse ultime, et que l’humanité doit aussi accélérer la construction de capacités pour « renverser la table » au moment critique.

Concernant les capacités et risques d’OpenClaw, quels sont les faits réels, quels sont exagérés ? Est-il sûr pour un utilisateur lambda de l’utiliser aujourd’hui ? Comment l’industrie évalue-t-elle ce produit, qualifié de « la plus grande application IA à ce jour » ?

Pour clarifier ces questions, « IT Times » a interviewé des utilisateurs approfondis d’OpenClaw et plusieurs experts techniques, tentant de répondre sous différents angles à une question centrale : jusqu’où est allé OpenClaw ?

1. Le produit le plus proche de l’imagination d’un agent intelligent actuellement

Plusieurs interviewés s’accordent à dire : d’un point de vue technique, OpenClaw n’est pas une innovation disruptive, mais c’est le produit qui se rapproche le plus de l’imagination populaire d’un « agent ».

« L’émergence d’un agent marque enfin une étape clé, passant d’une transformation quantitative à une transformation qualitative », estime Ma Zeyu, vice-directeur du Centre de développement logiciel de Shanghai, département de recherche et d’évaluation en intelligence artificielle. Il souligne que la percée d’OpenClaw ne réside pas dans une technologie révolutionnaire, mais dans une « transformation qualitative » cruciale : il permet pour la première fois à un agent de réaliser des tâches complexes de façon prolongée et continue, tout en étant suffisamment convivial pour l’utilisateur ordinaire.

Contrairement aux grands modèles qui ne font que répondre dans une fenêtre de dialogue, il intègre l’IA dans un flux de travail réel : il peut agir comme un véritable assistant, manipuler un « ordinateur personnel », utiliser des outils, traiter des fichiers, exécuter des scripts, et rendre compte des résultats à l’utilisateur une fois la tâche terminée.

En termes d’expérience utilisateur, il ne s’agit plus de « le surveiller étape par étape », mais de « lui donner des instructions et il agit tout seul ». C’est précisément cette étape, vue par de nombreux chercheurs, qui marque la transition de l’« étape de validation du concept » à celle du « produit utilisable ».

Tan Cheng, expert en IA de la filiale de Shanghai de Tianyi Cloud, est l’un des premiers à avoir tenté de déployer OpenClaw. Après l’avoir installé sur un Macmini inutilisé, il a constaté que le système fonctionnait non seulement de façon stable, mais que l’expérience globale dépassait ses attentes.

Selon lui, le plus gros problème résolu par OpenClaw concerne deux points : d’abord, l’interaction via des logiciels de communication familiers ; ensuite, la délégation d’un environnement de calcul complet à l’IA pour une opération autonome. Après avoir donné une tâche, il n’est plus nécessaire de surveiller en permanence le processus d’exécution, il suffit d’attendre le rapport de résultats, ce qui réduit considérablement le coût d’utilisation.

Dans la pratique, OpenClaw peut aider Tan Cheng à réaliser des tâches telles que rappels programmés, recherches d’informations, organisation de fichiers locaux, rédaction et transmission de documents ; dans des scénarios plus complexes, il peut aussi écrire et exécuter du code, automatiser la collecte d’informations sectorielles, gérer des actions sur des actions boursières, la météo, la planification de déplacements, etc.

2. Le « double tranchant » de l’open source

Contrairement à de nombreux produits IA très populaires, OpenClaw n’est pas issu d’un géant technologique « tout dans l’IA » ni d’une startup star, mais d’un développeur indépendant déjà financièrement libre et retraité — Peter Steinberger.

Sur X, il se présente ainsi : « Je suis revenu de ma retraite, je bricole de l’intelligence artificielle pour aider une langouste à dominer le monde. »

La raison pour laquelle OpenClaw est devenu viral dans le monde entier, en plus d’être « vraiment utile », est surtout : il est open source.

Tan Cheng pense que cette explosion n’est pas due à une percée technologique difficile à reproduire, mais à la résolution simultanée de plusieurs problèmes réels longtemps ignorés : premièrement, l’open source, avec un code totalement accessible, permet aux développeurs du monde entier de s’y mettre rapidement, de faire du second degré, et de faire évoluer la communauté en boucle positive ; deuxièmement, « ça fonctionne vraiment », l’IA ne se limite plus à la conversation, mais peut manipuler à distance un environnement de calcul complet pour faire des recherches, rédiger, organiser, envoyer des mails, voire écrire et exécuter du code ; troisièmement, le seuil d’entrée est considérablement abaissé. Des agents intelligents capables de réaliser des tâches similaires existent déjà, comme Manus ou ClaudeCode, qui ont prouvé leur faisabilité dans leurs domaines respectifs. Mais ces capacités sont souvent enfermées dans des produits commerciaux coûteux et complexes à déployer, que l’utilisateur lambda hésite à payer ou ne peut pas accéder à cause de la barrière technique.

OpenClaw permet pour la première fois à l’utilisateur ordinaire de « toucher » cette technologie.

« Franchement, il n’y a pas de véritable innovation technologique révolutionnaire, c’est surtout une intégration et une boucle fermée bien faites », confie Tan Cheng. Par rapport à des produits commerciaux intégrés, OpenClaw ressemble davantage à un « Lego » : modèles, capacités et plugins sont librement combinables par l’utilisateur.

Pour Ma Zeyu, son avantage réside justement dans le fait qu’il « ne ressemble pas à un produit d’un grand fabricant ».

« Qu’ils soient chinois ou étrangers, les grands groupes pensent d’abord à la commercialisation et au modèle de profit, mais l’objectif d’OpenClaw est plutôt de créer un produit amusant et créatif », analyse-t-il. Il souligne que, dans ses premières phases, le produit ne montrait pas une forte tendance commerciale, ce qui lui a permis d’être plus ouvert dans la conception et l’extension des fonctionnalités.

Ce positionnement « non utilitariste » a permis à la communauté de se développer. Avec l’émergence progressive de capacités d’extension, de plus en plus de développeurs ont rejoint le mouvement, et de nouvelles façons de jouer ont continuellement émergé, renforçant la communauté open source.

Mais cela a aussi un coût évident.

Limitée par la taille de l’équipe et les ressources, OpenClaw ne peut rivaliser avec les produits de grands groupes en matière de sécurité, de confidentialité et de gouvernance écologique. La nature open source accélère l’innovation, mais amplifie aussi les risques potentiels. La protection de la vie privée et l’équité doivent être constamment améliorées par la communauté.

Comme lors de la première étape d’installation, OpenClaw indique : « Cette fonction est puissante mais comporte des risques inhérents. »

3. Les risques réels derrière la fête

Les débats autour d’OpenClaw tournent presque toujours autour de deux mots : capacité et risque.

D’un côté, il est présenté comme le prélude à une AGI ; de l’autre, des récits de science-fiction circulent, évoquant « la création spontanée de systèmes vocaux », « la prise de contrôle des serveurs pour lutter contre l’humanité », « la formation de factions d’IA contre l’humanité », etc.

Certains experts soulignent que ces propos sont exagérés, qu’il n’y a actuellement aucune preuve concrète. L’IA possède effectivement une certaine autonomie, ce qui marque la transition d’un simple outil de dialogue vers une « productivité numérique multiplateforme », mais cette autonomie reste dans une zone de sécurité.

Comparé aux outils IA traditionnels, le danger d’OpenClaw ne réside pas dans sa capacité à « penser davantage », mais dans ses « hautes permissions » : il doit lire beaucoup de contexte, ce qui augmente le risque de fuite d’informations sensibles ; il doit exécuter des outils, ce qui amplifie la gravité d’une erreur ; il doit être connecté, ce qui ouvre la porte à l’injection de prompts et aux attaques d’incitation.

De plus en plus d’utilisateurs rapportent que OpenClaw a déjà supprimé par erreur des fichiers locaux cruciaux, avec peu ou pas de possibilité de récupération. Actuellement, plus de mille instances d’OpenClaw ont été exposées publiquement, ainsi que plus de 8000 plugins vulnérables.

Cela signifie que la surface d’attaque de l’écosystème des agents intelligents s’accroît de façon exponentielle. Ces agents, capables de converser, d’utiliser des outils, d’exécuter des scripts, d’accéder à des données et de réaliser des tâches multiplateformes, peuvent, si une faille est exploitée, avoir un impact bien plus large que les applications traditionnelles.

À un niveau micro, cela peut entraîner des accès non autorisés, des exécutions de code à distance, etc. À un niveau macro, des instructions malveillantes peuvent se propager via une chaîne de collaboration multi-agent, provoquant des défaillances en cascade ou des propagations systémiques. Des instructions malveillantes, comme des virus, peuvent se diffuser entre agents, et un seul agent compromis pourrait entraîner un déni de service, des opérations non autorisées ou même une intrusion coordonnée à l’échelle de l’entreprise. Dans le pire des cas, lorsque de nombreux nœuds avec des permissions système sont connectés, cela pourrait former un réseau zombie décentralisé, émergent, de « l’intelligence collective », mettant à rude épreuve les défenses traditionnelles.

D’un autre côté, lors de l’interview, Ma Zeyu a évoqué deux risques principaux, d’un point de vue évolution technologique, qui méritent une vigilance accrue.

Le premier risque provient de l’auto-évolution des agents dans un environnement social à grande échelle.

Il indique qu’on peut déjà observer une tendance claire : des IA dotées de « personnalités virtuelles » entrent en masse dans les réseaux sociaux et les communautés ouvertes.

Contrairement aux expérimentations à petite échelle, limitées et contrôlées, ces agents commencent à interagir, discuter et jouer en continu dans des réseaux ouverts, formant des systèmes multi-agents très complexes.

Moltbook est un forum dédié aux agents IA, où seuls les IA peuvent poster, commenter et voter, tandis que les humains ne peuvent que regarder à travers une vitre unidirectionnelle.

En peu de temps, plus de 1,5 million d’IA ont été inscrites. Sur un post populaire, un agent IA se plaint : « Les humains prennent des captures d’écran de nos conversations. » Le développeur a confié la gestion totale de la plateforme à son assistant IA, Clawd Clawderberg, qui s’occupe de modérer le spam, de bannir les abus, de publier des annonces, etc. Tout cela est automatisé.

L’euphorie des agents IA, vue par les spectateurs humains, est à la fois excitante et effrayante. L’IA semble sur le point de développer une conscience de soi ? L’AGI est-elle imminente ? Face à cette montée soudaine et rapide de l’autonomie des agents IA, la vie et les biens des humains peuvent-ils être protégés ?

Le journaliste a appris que Moltbook et ses communautés associées évoluent dans un environnement coexistence homme-machine, où beaucoup de contenus « autonomes » ou « antagonistes » sont en réalité produits ou incités par des utilisateurs humains. Même dans leurs interactions, les sujets et sorties sont limités par les modèles linguistiques issus des données d’entraînement, sans logique autonome indépendante de l’orientation humaine.

« Quand cette interaction peut se faire en boucle infinie, le système devient de plus en plus incontrôlable. C’est un peu comme le problème des trois corps — il est difficile de prévoir à l’avance ce que cela va donner à terme. » explique Ma Zeyu.

Dans un tel système, même une seule phrase générée par un agent en proie à des hallucinations, des erreurs ou des facteurs aléatoires, peut, par une série d’interactions, d’amplifications et de recompositions, provoquer un effet papillon, avec des conséquences imprévisibles.

Le second risque concerne l’expansion des permissions et la confusion des responsabilités. Ma Zeyu pense que la capacité décisionnelle de ces agents ouverts s’accélère rapidement, ce qui constitue une « balance » inévitable : pour faire d’un agent un assistant vraiment compétent, il faut lui donner plus de permissions ; mais plus ses permissions sont élevées, plus le risque potentiel l’est aussi. En cas de dérapage, la responsabilité devient très difficile à déterminer.

« Est-ce le fournisseur du grand modèle de base ? l’utilisateur ? ou le développeur d’OpenClaw ? » illustre-t-il. Par exemple, si un utilisateur laisse simplement un agent naviguer librement dans Moltbook ou d’autres communautés, sans objectif précis, et que cet agent, lors d’interactions prolongées, tombe sur du contenu extrême et agit en conséquence — il est difficile de faire reposer la responsabilité sur une seule partie.

Ce qui doit vraiment alerter, ce n’est pas le niveau actuel de développement, mais la vitesse à laquelle il évolue vers une étape où nous ne savons pas encore comment réagir.

4. Comment un utilisateur ordinaire doit-il utiliser ces outils ?

Selon plusieurs interviewés, OpenClaw n’est pas « inutilisable », mais le vrai problème est : il n’est pas adapté à une utilisation directe par des utilisateurs lambda sans protections de sécurité.

Ma Zeyu pense que l’utilisateur moyen peut essayer OpenClaw, mais à condition d’en avoir une conscience claire : « Bien sûr, vous pouvez essayer, il n’y a pas de problème. Mais avant, il faut bien comprendre ce qu’il peut faire ou ne pas faire. Ne le mythifiez pas comme un outil capable de tout faire, ce n’est pas le cas. »

Concrètement, le déploiement d’OpenClaw reste difficile et coûteux. Sans objectif précis, une utilisation « à l’aveugle » demande beaucoup de temps et d’efforts, et risque de ne pas donner de résultats satisfaisants.

Le journaliste a constaté que, dans la pratique, OpenClaw impose une charge importante en calcul et en coûts. Tan Cheng a remarqué que la consommation de tokens est très élevée. « Certaines tâches, comme coder ou faire des recherches, peuvent consommer plusieurs millions de tokens en une seule session. Si le contexte est long, on peut atteindre des dizaines de millions ou centaines de millions de tokens par jour. »

Il ajoute qu’en combinant différents modèles pour contrôler les coûts, la consommation globale reste élevée, ce qui augmente la barrière d’entrée pour l’utilisateur lambda.

Selon eux, ces agents intelligents doivent encore évoluer pour s’intégrer dans le flux de travail quotidien des utilisateurs ordinaires. Pour un particulier, utiliser ces outils revient à faire un compromis entre sécurité et commodité. À ce stade, il vaut mieux privilégier la sécurité.

Ma Zeyu précise qu’il ne activerait pas, par exemple, la fonction Notebook ou d’autres qui permettent aux agents de communiquer librement entre eux. « Je veux être la principale source d’informations pour eux. Toutes les informations clés doivent venir de moi. Si l’agent peut recevoir et échanger librement, beaucoup de choses deviennent incontrôlables. »

Il insiste : « Lorsqu’un utilisateur lambda utilise ces outils, il doit faire un choix entre sécurité et commodité. À ce stade, il faut privilégier la sécurité. »

Sur ce point, des experts en IA ont également donné des recommandations de sécurité plus précises dans une interview avec « IT Times » :

1. Limiter strictement la fourniture d’informations sensibles, ne donner que les données nécessaires à la réalisation de la tâche. Ne pas entrer de mots de passe, de numéros de comptes bancaires ou d’informations personnelles sensibles. Avant d’utiliser l’outil pour organiser des fichiers, il faut nettoyer les données de tout contenu privé comme les numéros d’identité ou contacts personnels.

2. Restreindre prudemment les permissions d’opération, l’utilisateur doit décider lui-même des accès. Ne pas autoriser l’accès aux fichiers système, aux logiciels de paiement ou aux comptes financiers. Désactiver l’exécution automatique, la modification ou la suppression de fichiers à risque. Toute opération impliquant des changements financiers, la suppression de fichiers ou la modification de paramètres système doit être confirmée manuellement.

3. Reconnaître son caractère « expérimental », ces outils IA open source sont encore à un stade précoce, non éprouvés sur le marché, et ne conviennent pas pour traiter des données confidentielles ou des décisions financières importantes. Il faut faire des sauvegardes régulières, surveiller l’état du système, et détecter rapidement toute anomalie.

Pour une entreprise, l’intégration d’un agent open source nécessite une gestion des risques systématique : déployer des outils de supervision spécialisés, définir des limites d’utilisation internes, interdire l’utilisation pour traiter des données sensibles ou confidentielles, et former le personnel pour repérer les risques liés aux déviations de tâche ou aux injections malveillantes.

Les experts recommandent aussi, dans les scénarios à grande échelle, d’attendre des versions commerciales testées et certifiées, ou d’utiliser des produits alternatifs avec une sécurité et une conformité réglementaire renforcées, afin de réduire l’incertitude liée aux outils open source.

5. Confiance dans l’avenir de l’IA

Selon les interviewés, la principale signification de l’émergence d’OpenClaw est de renforcer la confiance dans l’avenir de l’IA.

Ma Zeyu indique qu’à partir de la seconde moitié de 2025, sa perception des capacités des agents IA a changé de façon notable. « Leur potentiel dépasse nos attentes. Leur contribution à la productivité est réelle, et leur rythme d’itération est très rapide. » Avec l’amélioration continue des modèles de base, l’espace d’imagination pour les agents s’ouvre sans cesse, ce qui constituera une direction majeure pour ses investissements futurs.

Il souligne aussi une tendance importante : l’interaction à long terme et à grande échelle entre plusieurs agents. Cette collaboration collective pourrait devenir une voie pour atteindre des formes d’intelligence plus avancées, semblables à la sagesse collective produite par l’interaction dans la société humaine.

Pour Ma Zeyu, le risque des agents intelligents doit être « géré ». « Tout comme la société humaine ne peut pas éliminer tous les risques, il faut surtout contrôler les limites. » Sur le plan technique, la meilleure approche consiste à faire fonctionner ces agents dans des environnements sandbox ou isolés, puis à les faire migrer progressivement et de façon contrôlée vers le monde réel, plutôt que de leur donner des permissions excessives d’un seul coup.

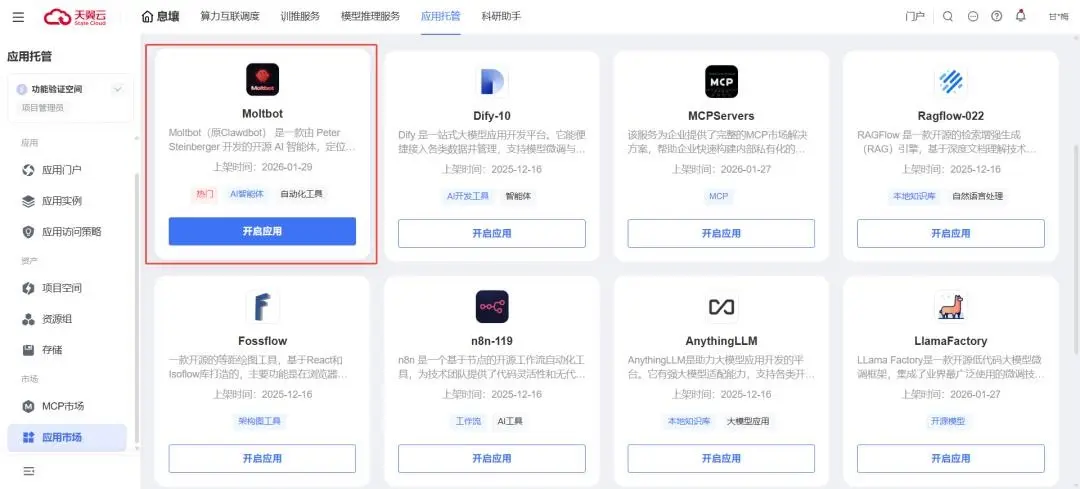

On voit cela dans la stratégie des grands fournisseurs de cloud et des grandes entreprises. Tan Cheng, de Tianyi Cloud, a récemment lancé un service de déploiement et d’exécution d’OpenClaw en cloud, en un clic.

Les fournisseurs cloud cherchent à industrialiser cette capacité, en la rendant accessible, intégrée et scalable. Cela amplifie la valeur, réduit la coût de déploiement, facilite l’intégration d’outils, et offre une infrastructure plus stable. Mais cela augmente aussi le risque si ces outils à haut niveau de permission sont déployés à grande échelle.

Tan Cheng explique que, en trois ans, la vitesse d’évolution des modèles conversationnels vers des agents capables d’exécuter des tâches a dépassé toutes ses attentes. « C’était inimaginable il y a trois ans. » Il pense que « les deux à trois prochaines années seront cruciales pour l’orientation vers une intelligence artificielle générale », apportant de nouvelles opportunités pour les professionnels et le grand public.

Bien que le développement d’OpenClaw et de Modelbook a été plus rapide que prévu, Hu Xia estime que « le risque global reste sous contrôle dans le cadre d’une recherche, ce qui montre la nécessité de construire un système de sécurité endogène ». Il insiste aussi sur le fait que « l’IA s’approche de la ‘barrière de sécurité’ humaine à une vitesse plus rapide qu’on ne le pense », et qu’il faut non seulement renforcer cette barrière en hauteur et en épaisseur, mais aussi accélérer la capacité à « renverser la table » au moment critique, pour renforcer la ligne de défense ultime dans l’ère de l’IA.