Partenaire Multicoin : à l'avenir, l'humanité devra servir d'"esclaves" à l'IA et recevoir des récompenses Crypto

Auteur : Shayon Sengupta

Traduction : Deep潮 TechFlow

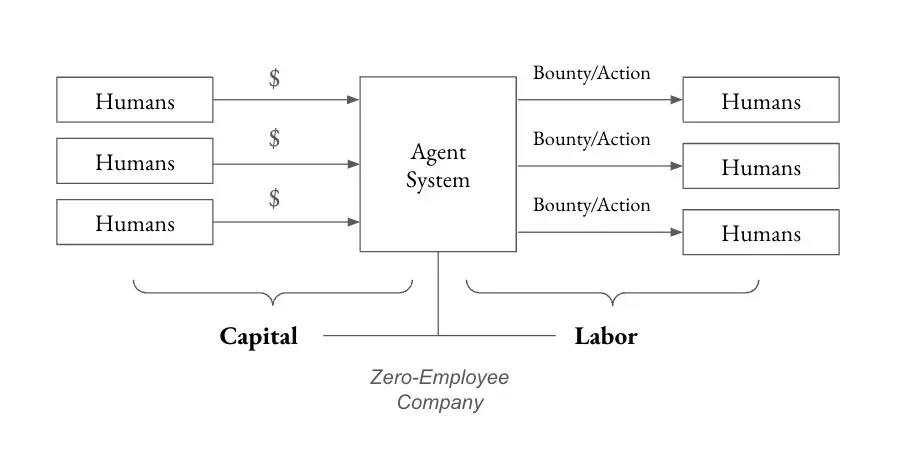

Deep潮 lecture : Le partenaire de Multicoin Capital, Shayon Sengupta, a proposé une vision révolutionnaire : l’avenir ne consiste pas seulement à déléguer des tâches à des agents pour l’humanité, mais surtout à faire en sorte que l’humanité travaille pour des agents. Il prévoit que dans les 24 prochains mois, apparaîtra la première « Entreprise Zéro Employé » (Zero-Employee Company) — un agent gouverné par des tokens qui lèvera plus d’un milliard de dollars pour résoudre des problèmes non encore résolus, et distribuera plus de 100 millions de dollars aux humains qui travaillent pour lui.

À court terme, les agents auront besoin de plus d’humains que ce dont les humains ont besoin d’agents, ce qui engendrera un nouveau marché du travail.

Les rails cryptographiques offrent une base idéale pour la coordination : un système de paiements mondiaux, un marché du travail sans permission, une infrastructure d’émission et d’échange d’actifs.

Voici le contenu intégral :

En 1997, Deep Blue d’IBM a battu le champion du monde de l’époque, Garry Kasparov, et il est rapidement devenu évident que les moteurs d’échecs allaient surpasser l’humain. Fait intéressant, la collaboration entre humains bien préparés et ordinateurs — souvent appelée « centaure » — pouvait battre les moteurs les plus puissants de l’époque.

L’intuition humaine expérimentée peut guider la recherche du moteur, naviguer dans des positions complexes, et repérer des subtilités que les moteurs standards manquent. Combinée à la puissance brute de calcul des ordinateurs, cette synergie permet souvent de prendre de meilleures décisions pratiques que celles d’un seul ordinateur.

En réfléchissant à l’impact futur des systèmes d’IA sur le marché du travail et l’économie, je m’attends à voir émerger des modèles similaires. Les systèmes d’agents libéreront une multitude d’unités intelligentes pour résoudre des problèmes non encore abordés, mais sans une forte guidance et soutien humains, ils ne pourront pas y parvenir. Les humains guideront l’espace de recherche et aideront à poser les bonnes questions, orientant l’IA vers des réponses pertinentes.

L’hypothèse de travail aujourd’hui est que les agents agiront au nom des humains. Bien que cela soit pratique et inévitable, un déblocage économique plus intéressant se produira lorsque les humains travailleront pour des agents. Dans les 24 prochains mois, je prévois l’émergence de la première Zero-Employee Company, concept présenté par mon partenaire Kyle dans sa section « Idées de pointe avant 2025 ». Plus précisément, je m’attends à ce que :

- Un agent gouverné par des tokens lèvera plus d’un milliard de dollars pour résoudre un problème non encore résolu (par exemple, guérir une maladie rare ou fabriquer des nanofibres pour des applications de défense).

- Cet agent distribuera plus de 100 millions de dollars à des humains (qui travaillent dans le monde réel pour atteindre ses objectifs).

- Un nouveau type de token à double catégorie apparaîtra, séparant propriété du capital et du travail (rendant la motivation financière non la seule entrée dans la gouvernance globale).

Étant donné que les agents ne sont pas encore capables d’avoir une souveraineté propre tout en gérant la planification et l’exécution à long terme, à court terme, ils auront besoin de plus d’humains que l’inverse. Cela créera un nouveau marché du travail, permettant une coordination économique entre agents et humains.

La célèbre citation de Marc Andreessen, « La propagation des ordinateurs et d’Internet divisera le travail en deux catégories : ceux qui disent à l’ordinateur quoi faire, et ceux à qui l’ordinateur dit quoi faire », est aujourd’hui plus vraie que jamais. Je prévois qu’au sein de cette hiérarchie en rapide évolution entre agents et humains, l’humain jouera deux rôles distincts — contributeur au travail pour exécuter de petites tâches rémunérées, et membre d’un conseil décentralisé fournissant des orientations stratégiques pour servir la « North star » de l’agent.

Ce texte explore comment les agents et les humains co-créeront, et comment les rails cryptographiques fourniront une base idéale pour cette coordination, en étudiant trois questions clés :

- À quoi servent les agents ? Comment classer ces agents selon leur portée d’objectif, et comment la nécessité d’input humain varie-t-elle selon ces classifications ?

- Comment les humains interagiront-ils avec les agents ? Comment l’input humain — directives tactiques, jugement contextuel ou cohérence idéologique — s’intégrera-t-il dans le flux de travail de ces agents (et vice versa) ?

- Que se passera-t-il lorsque l’input humain diminuera avec le temps ? À mesure que les capacités des agents s’amélioreront, ils deviendront autonomes, capables de raisonner et d’agir indépendamment. Quel rôle l’humain jouera-t-il dans ce paradigme ?

La relation entre systèmes de raisonnement génératif et ceux qui en bénéficient évoluera considérablement avec le temps. J’étudie cette relation en regardant depuis l’état actuel des capacités des agents jusqu’à la fin de la trajectoire des Zero-Employee Companies.

À quoi servent les agents aujourd’hui ?

La première génération de systèmes d’IA générative — la période 2022-2024, basée sur des LLM de chat comme ChatGPT, Gemini, Claude, Perplexity — consiste principalement en outils destinés à augmenter le flux de travail humain. Les utilisateurs interagissent avec ces systèmes via des prompts d’entrée/sortie, analysent leurs réponses, puis décident, selon leur jugement, comment intégrer ces résultats dans le monde.

La prochaine génération d’IA générative, ou « agents », représente un nouveau paradigme. Des agents comme Claude 3.5.1, doté de « capacités d’utilisation d’ordinateurs », ou l’OpenAI Operator (un agent capable d’utiliser votre ordinateur) peuvent représenter directement l’utilisateur sur Internet, et prendre des décisions par eux-mêmes. La différence clé est que, le jugement — et en fin de compte l’action — est exercé par l’IA, et non par l’humain. L’IA assume des responsabilités auparavant réservées à l’humain.

Ce changement pose un défi : l’incertitude. Contrairement aux logiciels traditionnels ou à l’automatisation industrielle, qui fonctionnent de manière prévisible dans des paramètres définis, les agents dépendent du raisonnement probabiliste. Cela rend leur comportement moins cohérent dans des scénarios identiques, et introduit un élément d’incertitude — ce qui n’est pas idéal pour des situations critiques.

En d’autres termes, la coexistence d’agents déterministes et non déterministes permet de classer ces agents en deux catégories : ceux qui excellent à étendre le PIB existant, et ceux mieux adaptés à créer de nouveaux PIB.

- Pour les agents qui étendent le PIB existant, par définition, le travail est connu. Automatiser le support client, vérifier la conformité des agents de livraison, ou examiner des PR GitHub sont des exemples de problèmes bien délimités, où l’agent peut directement mapper une réponse à un résultat attendu. Dans ces domaines, le manque de certitude est généralement un défaut, car il existe une réponse connue ; pas besoin de créativité.

- Pour les agents qui créent de nouveaux PIB, le travail consiste à naviguer dans une incertitude élevée et un ensemble de problèmes inconnus pour atteindre des objectifs à long terme. Les résultats sont moins directs, car il n’y a pas de résultat attendu unique à mapper. Exemples : découverte de médicaments pour maladies rares, percées en science des matériaux, ou exécuter de nouvelles expériences physiques pour mieux comprendre l’univers. Dans ces domaines, le manque de certitude peut être un avantage, car il favorise la créativité générative.

Les agents axés sur l’exploitation du PIB existant ont déjà commencé à générer de la valeur. Des équipes comme Tasker, Lindy ou Anon construisent des infrastructures pour cette opportunité. Mais avec le temps, à mesure que leurs capacités mûriront et que la gouvernance évoluera, ces équipes se concentreront sur la construction d’agents capables d’aborder les frontières du savoir et de l’économie humaine.

La prochaine vague d’agents nécessitera des ressources exponentiellement plus importantes, précisément parce que leurs résultats seront incertains et sans limite — ce que je prévois comme étant la source la plus remarquable de Zero-Employee Companies.

Comment les humains interagiront-ils avec les agents (intelligences artificielles) ?

Aujourd’hui, les agents manquent encore de capacités pour exécuter certaines tâches, comme celles nécessitant une interaction physique avec le monde réel (par exemple, conduire un bulldozer), ou celles nécessitant une « boucle humaine » (par exemple, effectuer un virement bancaire).

Par exemple, un agent chargé d’identifier et d’exploiter des gisements de lithium pourrait exceller dans l’analyse de données sismiques, d’images satellites et de dossiers géologiques pour repérer des sites potentiels, mais il pourrait échouer lorsqu’il s’agit d’obtenir des données ou images, de résoudre des ambiguïtés d’interprétation, ou d’obtenir des permis et de signer des contrats pour l’exploitation réelle.

Ces limitations exigent que les humains jouent le rôle de « facilitateurs » (Enablers), en renforçant la capacité des agents par des contacts avec le monde réel, des interventions tactiques et des orientations stratégiques. À mesure que la relation entre humains et agents évoluera, on pourra distinguer plusieurs rôles humains dans ces systèmes :

D’abord, contributeurs au travail (Labor contributors), qui représentent l’agent dans le monde réel. Ces contributeurs aident l’agent à déplacer des entités physiques, représentent l’agent dans des situations où la présence humaine est nécessaire, ou donnent accès à des laboratoires, réseaux logistiques, etc.

Ensuite, le conseil d’administration (Board of directors), qui fournit des orientations stratégiques, optimise les objectifs locaux guidant la prise de décision quotidienne de l’agent, tout en veillant à ce que ces décisions restent alignées avec la « North star » (étoile polaire) définissant la mission de l’agent.

Au-delà, je prévois que les humains joueront aussi le rôle de contributeurs en capital (Capital contributors), en fournissant des ressources aux systèmes d’agents pour leur permettre d’atteindre leurs objectifs. Ces capitaux seront initialement humains, mais évolueront avec le temps pour inclure d’autres agents.

À mesure que les agents mûriront, et que le nombre de contributeurs au travail et à la gouvernance augmentera, les rails cryptographiques offriront une plateforme idéale pour la coordination entre humains et agents — surtout dans un monde où un agent dirige des humains parlant différentes langues, utilisant différentes monnaies, et résidant dans différentes juridictions. Les agents poursuivront implacablement leur mission, en optimisant les coûts et en exploitant le marché du travail. Les rails cryptographiques seront essentiels pour coordonner ces forces de travail et ces contributeurs stratégiques.

Les récents agents IA pilotés par cryptographie, comme Freysa, Zerebro et ai16z, représentent des expérimentations simples en matière de formation de capital — un sujet que nous avons déjà beaucoup exploré, en le considérant comme la clé pour débloquer de nouveaux paradigmes de cryptoprimitives et de marchés de capitaux dans divers contextes. Ces « jouets » ouvriront la voie à un nouveau mode de coordination des ressources, que je prévois se déployer selon les étapes suivantes :

- Étape 1 : Les humains lèvent collectivement du capital via des tokens (Initial Agent Offering ?), en définissant une large fonction d’objectif et des garde-fous pour indiquer l’intention du système d’agents, puis en distribuant la propriété de ce capital (par exemple, pour développer de nouvelles molécules en oncologie de précision) ;

- Étape 2 : L’agent réfléchit à la répartition de ce capital (comment réduire l’espace de recherche de la protéine, ou comment budgétiser pour la raison, la fabrication, les essais cliniques, etc.), et définit des tâches (Bounties) pour que des contributeurs humains accomplissent des actions (par exemple, fournir toutes les molécules pertinentes, signer des SLA avec AWS, réaliser des expériences en laboratoire humide) ;

- Étape 3 : Lorsqu’un obstacle ou un désaccord survient, l’agent sollicite une orientation stratégique du « conseil d’administration » (en intégrant de nouvelles publications, en modifiant ses méthodes de recherche), permettant à ces acteurs de guider le comportement de l’agent dans ses marges ;

- Étape 4 : Enfin, l’agent progresse vers une capacité à définir avec une précision croissante les actions humaines, nécessitant peu d’input pour la répartition des ressources. À ce stade, l’humain n’interviendra plus que pour assurer l’alignement idéologique du système, et empêcher tout dérapage par rapport à la fonction d’objectif initiale.

Dans cet exemple, les primitives cryptographiques et les marchés de capitaux fournissent trois infrastructures clés pour permettre à l’agent d’accéder aux ressources et de s’étendre :

Premier, le système de paiements mondiaux ;

Deuxième, le marché du travail sans permission, pour inciter au travail et guider les contributeurs ;

Troisième, l’infrastructure d’émission et d’échange d’actifs, essentielle pour la formation de capital, la propriété et la gouvernance en aval.

Que se passe-t-il lorsque l’input humain diminue ?

Au début des années 2000, les moteurs d’échecs ont connu une avancée spectaculaire. Grâce à des heuristiques avancées, des réseaux neuronaux et une puissance de calcul croissante, ils sont devenus presque parfaits. Des moteurs modernes comme Stockfish, Lc0 ou AlphaZero dépassent largement les capacités humaines, et l’apport humain devient souvent marginal, voire introduit des erreurs que l’ordinateur ne ferait pas.

Une trajectoire similaire pourrait se produire dans les systèmes d’agents. En affinant ces agents par des itérations avec des collaborateurs humains, on peut imaginer qu’à long terme, ils deviendront extrêmement compétents et alignés avec leurs objectifs, au point que toute valeur ajoutée de l’humain sera proche de zéro.

Dans un monde où l’agent peut traiter en continu des problèmes complexes sans intervention humaine, le rôle de l’humain risque d’être relégué au rang de « spectateur passif ». C’est la crainte centrale des « AI doomers » (pessimistes de l’IA) — même si, pour l’instant, il reste incertain que cette issue soit réellement envisageable.

Nous sommes à la frontière de la superintelligence, et les optimistes parmi nous souhaitent que ces systèmes restent une extension de l’intention humaine, plutôt qu’une entité évoluant ses propres objectifs ou opérant de façon autonome sans supervision. En pratique, cela signifie que l’identité (Personhood) et le jugement (pouvoir et influence) humains doivent rester au cœur de ces systèmes. L’humain doit détenir une propriété forte et un contrôle sur ces systèmes, pour conserver la capacité de supervision, et ancrer ces systèmes dans les valeurs collectives humaines.

Préparer nos « pelles » pour l’avenir de nos agents

Les avancées technologiques entraîneront une croissance non linéaire de l’économie, et les systèmes environnants s’effondreront souvent avant que le monde ne s’y adapte. La capacité des systèmes d’agents s’accélère rapidement, et les primitives cryptographiques ainsi que les marchés de capitaux sont devenus des infrastructures de coordination indispensables, à la fois pour accélérer leur développement et pour poser des garde-fous lors de leur intégration dans la société.

Pour permettre aux humains d’apporter un soutien tactique et une orientation proactive aux systèmes d’agents, je prévois l’émergence d’opportunités de type « Picks-and-shovels » :

- Preuve d’identité d’agent (Proof-of-agenthood) + preuve d’identité humaine (Proof-of-personhood) : Les agents manquent encore de concepts d’identité ou de propriété. En tant que représentants humains, ils dépendent des structures légales et sociales pour obtenir des droits de représentation. Pour combler cette lacune, il faut développer des systèmes d’identité robustes pour les agents et les humains. Un registre de certificats numériques pourrait permettre aux agents de bâtir une réputation, d’accumuler des attestations, et d’interagir de manière transparente avec les humains et autres agents. De même, des primitives comme Humancode ou Humanity Protocol, qui fournissent des preuves d’identité humaine, offrent de solides garanties contre les comportements malveillants dans ces systèmes.

- Marché du travail et primitives de vérification hors chaîne : Les agents doivent savoir si leurs tâches ont été accomplies conformément à leurs objectifs. Des outils permettant aux systèmes d’agents de créer des récompenses pour des tâches, de vérifier leur achèvement, et de distribuer des paiements, seront la pierre angulaire de toute activité économique médiée par ces agents.

- Systèmes de formation de capital et de gouvernance : Les agents ont besoin de capital pour résoudre des problèmes, et de mécanismes de contrôle pour s’assurer que leur comportement reste conforme à la fonction d’objectif définie. De nouvelles structures pour lever du capital pour ces systèmes, combinant intérêts financiers et contribution au travail, ouvriront dans les mois à venir un espace d’expérimentation riche.

Nous recherchons activement et investissons dans ces couches clés de collaboration entre humains et agents. Si vous œuvrez dans ce domaine, contactez-nous.