Professeur Jia Da décompose l'IA générative : Vibe Coding n'est pas si incroyable ? Quelle est la meilleure façon d'utiliser l'IA pour coder ?

Dans un contexte où l’IA générative évolue à une vitesse fulgurante, beaucoup se sentent perdus quant à la nécessité de continuer à apprendre la programmation. Lors de l’émission dans GQ Magazine, le professeur a expliqué le principe derrière le LLM de ChatGPT, en soulignant les limites du Vibe Coding.

Le professeur a décrypté l’IA générative pour vous aider à comprendre correctement le Vibe Coding

Récemment, GQ Taiwan a partagé une vidéo sur sa chaîne YouTube, invité spécialement le professeur en informatique de l’Université de Californie à Berkeley (UC Berkeley) Sarah Chasins, pour répondre aux nombreuses questions des internautes concernant la programmation et l’IA.

Dans un contexte où l’IA générative évolue à une vitesse fulgurante, beaucoup se sentent perdus quant à la nécessité de continuer à apprendre la programmation. La professeure Chasins, dans la vidéo, a non seulement expliqué les principes techniques, mais a aussi formulé une observation pragmatique sur la récente tendance du « Vibe Coding ».

Le professeur a décrypté la technologie LLM derrière ChatGPT

La professeure Sarah Chasins a d’abord expliqué, de manière accessible au grand public, le fonctionnement de ChatGPT.

ChatGPT repose sur un grand modèle de langage (LLM), dont la logique centrale est très simple : il s’agit d’un programme responsable d’assembler des mots qui semblent s’accorder entre eux.

Les développeurs du LLM commencent par collecter tous les documents et pages web écrits par des humains sur Internet, ces données représentant des combinaisons de vocabulaire considérées comme raisonnables dans la cognition humaine.

Ensuite, le programme s’entraîne à faire un « jeu de remplissage » à grande échelle. Par exemple, il voit des phrases comme « Le chien a quatre [espace] », et la réponse attendue, conforme à la cognition humaine, est « Le chien a quatre pattes ». Si le programme fait une erreur, les développeurs le corrigent jusqu’à ce qu’il donne la bonne réponse.

Après un entraînement équivalent à 300 à 400 années de calculs terrestres, le programme finit par générer une énorme « fiche de triche », aussi appelée « paramètres » dans le domaine technologique.

Ensuite, il suffit de fournir un document en format dialogue, et ce programme spécialisé dans le remplissage pourra se transformer en chatbot, complétant automatiquement les réponses restantes après une question humaine, selon une logique prédéfinie.

Source : Image générée par IA Nanobanana, à titre de référence. Certaines caractères chinois peuvent apparaître flous, veuillez nous en excuser.

Dans l’ère de l’IA, la meilleure façon d’apprendre la programmation

Face à la puissance des outils d’IA, beaucoup remettent en question la nécessité d’apprendre à programmer. Le professeur pense que, dans l’éducation à la programmation, la compétence la plus essentielle est la « décomposition de problème », c’est-à-dire diviser un problème vague en petites parties, jusqu’à ce que chaque partie puisse être résolue en quelques lignes de code.

Sans cette formation, il sera difficile pour l’utilisateur d’utiliser efficacement les outils d’IA pour produire des programmes complexes réellement opérationnels. De plus, les données d’entraînement du LLM sont majoritairement des descriptions en langage technique, non adaptées au langage quotidien des non-professionnels, ce qui peut empêcher l’IA de générer du code utile.

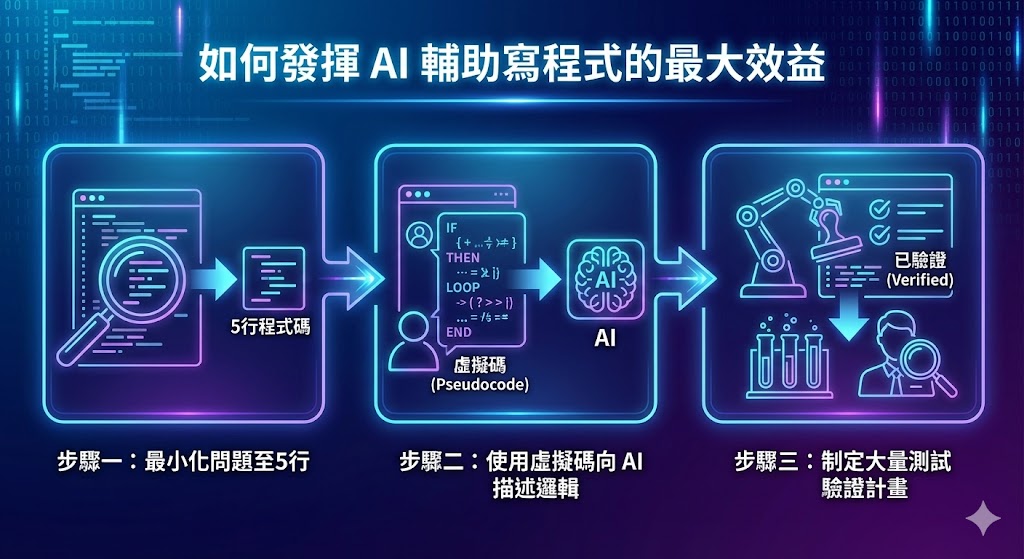

Pour maximiser l’efficacité de l’IA dans l’aide à la programmation, le professeur Chasins recommande de suivre trois étapes :

- Minimiser le problème : le décomposer en un code d’environ 5 lignes.

- Utiliser du pseudo-code : une syntaxe qui peut combiner plusieurs langages de programmation, décrivant la logique à l’IA. Bien que semblant en langage naturel, le pseudo-code n’est pas la langue quotidienne, mais vise à faire comprendre la logique à l’ordinateur de façon plus précise.

- Élaborer un plan de validation : effectuer de nombreux tests ou audits professionnels pour assurer la précision du résultat de l’IA.

Source : Image générée par IA Nanobanana, à titre de référence. Certaines caractères chinois peuvent apparaître flous, veuillez nous en excuser.

Le Vibe Coding n’est pas si magique que ça

Concernant la tendance récente à utiliser directement les LLM pour générer du code, plutôt que de le taper manuellement, le professeur Sarah Chasins reste réservée.

Elle analyse que ces outils sont efficaces pour traiter du contenu courant déjà écrit des centaines de fois par l’humain, mais qu’ils échouent généralement lorsqu’il s’agit d’expérimenter quelque chose de nouveau.

Elle cite également des études montrant que, même si les utilisateurs de LLM pensent avoir augmenté leur efficacité de 20 %, leur vitesse réelle de développement est en fait 20 % plus lente que ceux qui n’utilisent pas ces outils.

Cela montre qu’une dépendance excessive peut donner une illusion d’efficacité. Lorsqu’on doit faire face à des besoins en programmation inédits, sans compétences de base en décomposition logique ou en principes physiques, il est impossible de corriger les erreurs de l’IA, ce qui rend le processus final encore plus long.

Pour faire une analogie simple, le LLM est comme une voiture autonome haut de gamme, capable de gérer les trajets courants, mais si vous ne savez pas comment décomposer une course ou comprendre la physique du véhicule, comme la logique de programmation, lorsque vous faites face à un virage dangereux ou à une demande innovante, la conduite automatique peut se tromper, et vous, manquant de compétences fondamentales, ne saurez pas comment la corriger.

Lecture complémentaire :

L’IA permet à une personne de créer une entreprise en solo ! « L’encodage d’ambiance » bouleverse la tradition, permettant à de petites équipes de générer plus d’un milliard de revenus par an

Articles similaires

Meilleures préventes crypto pour mars 2026 : Pepeto devance BlockDAG et Maxi Doge alors que dix grandes banques explorent le stablecoin du consortium G7

Dogecoin affiche une étoile du matin Doji mensuelle — Le $0,097 sera-t-il la prochaine rupture ?

Dogecoin (DOGE) a supprimé un zéro pendant huit heures, mais va-t-il revenir ? - U.Today