Arquitectura y funcionamiento interno

La arquitectura de los coprocesadores de conocimiento cero (ZK Coprocessors) refleja su papel como motores computacionales que operan off-chain, pero permanecen criptográficamente vinculados a los sistemas on-chain. Este módulo examina cómo se estructuran estos sistemas, el flujo de datos y cálculos dentro de ellos, y los primitivos criptográficos que permiten la verificación trustless (sin confianza). Comprender esta arquitectura es esencial tanto para desarrolladores que buscan integrar coprocesadores en sus aplicaciones como para analistas que desean evaluar su fiabilidad y seguridad.

Componentes clave de un coprocesador ZK

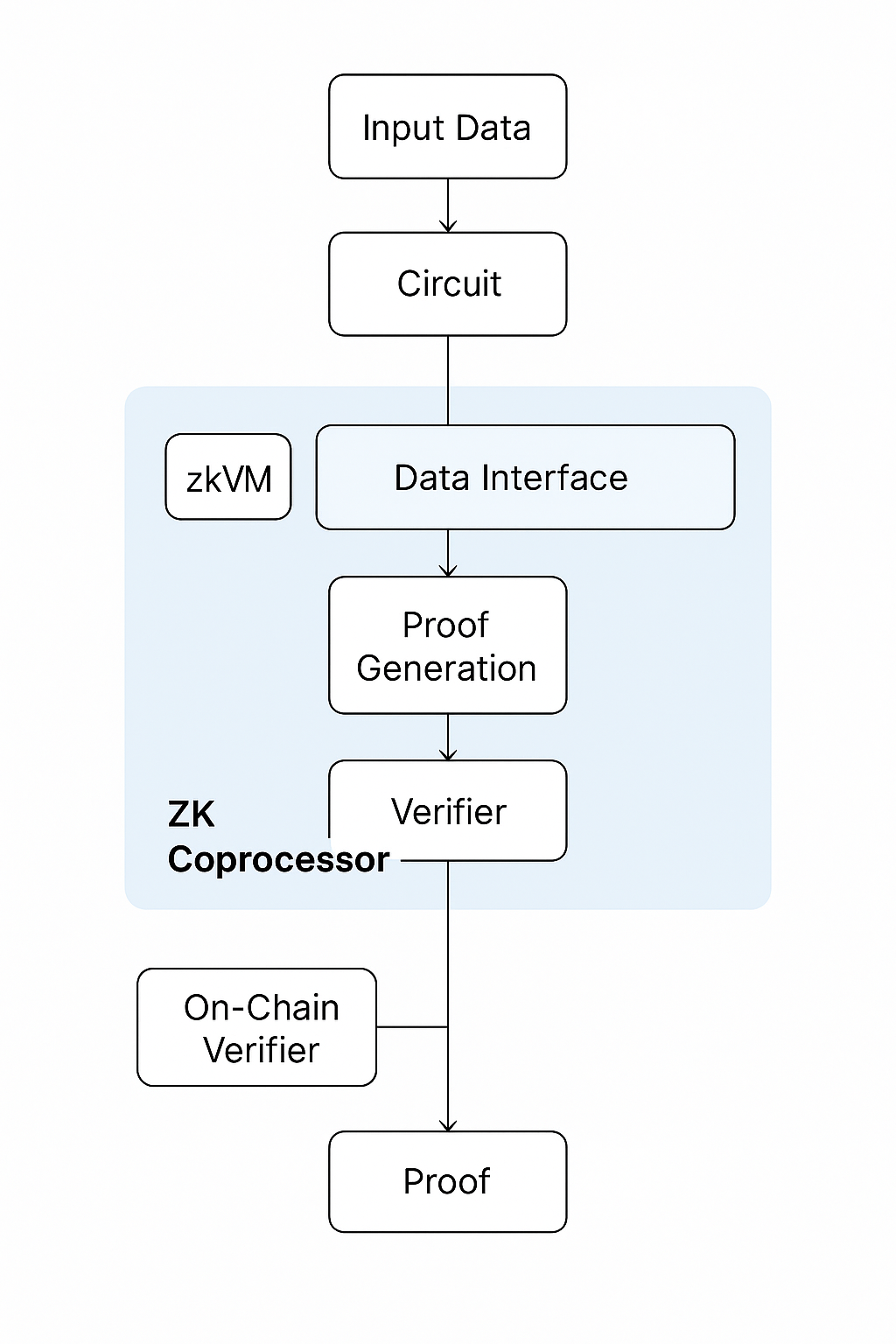

Un coprocesador ZK consta de varios componentes fundamentales que trabajan juntos para descargar cálculos mientras preservan la verificabilidad. En el corazón del sistema se encuentra el entorno de ejecución, a menudo implementado como una máquina virtual de conocimiento cero (zkVM) o un compilador de circuitos de dominio específico. Este entorno interpreta el código o las tareas computacionales y los convierte en un circuito aritmético adecuado para la generación de pruebas de conocimiento cero.

El demostrador o “prover” es la entidad que realiza el cálculo y genera la prueba criptográfica. Toma los datos de entrada, ejecuta la lógica requerida fuera de la cadena y construye una prueba concisa que certifica la corrección del cálculo sin revelar detalles confidenciales. El verificador, normalmente un contrato inteligente implementado en la blockchain de destino, comprueba esta prueba mediante recursos mínimos. Por diseño, la verificación es mucho menos exigente desde el punto de vista computacional que el cálculo original, lo que permite una validación on-chain eficiente.

Un componente de soporte es la interfaz de datos, que gestiona cómo el coprocesador accede a información de diferentes fuentes. Algunos coprocesadores consultan datos directamente on-chain, mientras que otros agregan conjuntos de datos históricos o externos, como redes de almacenamiento descentralizado o API off-chain. La integridad de estos datos también debe ser verificable, normalmente mediante pruebas de Merkle u otros compromisos criptográficos similares.

Flujo de computación

El funcionamiento de un coprocesador ZK sigue una secuencia clara que separa la computación pesada de la verificación ligera. El proceso comienza cuando una aplicación descentralizada o un contrato inteligente solicita un cálculo que no puede realizarse eficientemente de manera on-chain. Esta solicitud se envía al coprocesador, que recopila los datos necesarios, ya sea del estado de la blockchain, de fuentes de datos externas o de entradas proporcionadas por el usuario.

Una vez reunidos los datos, el coprocesador ejecuta la computación dentro de su zkVM o entorno de circuito. Durante este paso, el cálculo se transforma en un circuito aritmético estructurado, lo que permite la generación de una prueba de conocimiento cero. Esta prueba resume todo el proceso de ejecución de manera que pueda ser verificada sin necesidad de volver a ejecutar el cálculo.

Después de generar la prueba, esta se transmite nuevamente a la blockchain. El contrato inteligente verificador valida la prueba utilizando claves de verificación públicas conocidas. Si la prueba es válida, el resultado de la computación se acepta y puede usarse para actualizar el estado on-chain, activar la lógica de un contrato inteligente o servir como entrada para otros procesos descentralizados. Este flujo asegura que la integridad computacional se mantenga sin sacrificar eficiencia.

Técnicas de generación de pruebas

La generación de pruebas es el aspecto más intensivo en cómputo de la arquitectura de un coprocesador ZK. Se basa en métodos criptográficos avanzados, como compromisos polinómicos y multiplicaciones multiescalares, que transforman un cálculo en un conjunto de restricciones algebraicas. Estas restricciones se resuelven para producir una prueba concisa.

Los sistemas modernos optimizan este proceso mediante varias técnicas. Las transformadas rápidas de Fourier (FFT) o las transformadas numéricas teóricas (NTT) se utilizan para acelerar operaciones polinómicas, centrales en las construcciones zk‑SNARK y zk‑STARK. La recursividad es otra técnica en auge, que permite que las pruebas se aniden dentro de otras pruebas.Los sistemas de prueba recursivos permiten la verificación incremental, en la que los cálculos grandes se dividen en pruebas más pequeñas que posteriormente se agregan en una única verificación concisa.

Estas optimizaciones son cruciales para escalar los coprocesadores ZK a cargas de trabajo del mundo real. Sin ellas, la generación de pruebas podría volverse demasiado lenta o intensiva en recursos, debilitando las ventajas de la computación off-chain.

Verificación on-chain

La fase de verificación ocurre en la blockchain objetivo y está diseñada intencionadamente para requerir un coste computacional mínimo. Una vez que el coprocesador envía una prueba, el contrato verificador ejecuta un algoritmo de verificación utilizando parámetros precomputados. En los sistemas zk‑SNARK, esto suele implicar una verificación de pares en tiempo constante, mientras que los verificadores zk‑STARK se basan en compromisos mediante funciones hash (resúmenes seguros de datos) y en protocolos FRI (Fast Reed‑Solomon Interactive Oracle Proofs of Proximity, que permiten comprobar grandes cálculos de manera eficiente).

La concisión de las pruebas de conocimiento cero significa que la verificación generalmente requiere solo unos pocos kilobytes de datos y puede ejecutarse utilizando una fracción del gas que se necesitaría para un cálculo equivalente on-chain. Esta eficiencia es lo que hace que los coprocesadores ZK sean viables en entornos de producción. La prueba confirma no solo la corrección del cálculo, sino también la integridad de los datos de entrada y el determinismo del resultado.

Modelo de seguridad y amenazas

La seguridad de los coprocesadores ZK se basa tanto en la solidez criptográfica como en el diseño del sistema. Criptográficamente, sus garantías dependen de la dificultad de los problemas subyacentes, como los emparejamientos de curvas elípticas o los compromisos basados en hash. Mientras estos primitivos sigan siendo seguros, las pruebas que generan no se pueden falsificar.

Sin embargo, pueden surgir vulnerabilidades en la implementación del coprocesador o en la forma en que se obtienen los datos. Un demostrador con malas intenciones podría intentar eludir las restricciones del circuito o introducir datos incorrectos en el cálculo. Para mitigar esto, los coprocesadores suelen depender de compromisos de entrada pública, raíces de Merkle o fuentes de datos confiables para demostrar que los datos utilizados son legítimos. La auditoría de los circuitos y la verificación formal rigurosa también son esenciales para prevenir errores en el diseño.

El sistema más amplio también debe abordar la vitalidad y la disponibilidad. Si el coprocesador está centralizado o controlado por un solo operador, introduce posibles suposiciones de confianza o riesgos de censura. Los diseños emergentes buscan descentralizar las redes de coprocesadores, permitiendo que múltiples demostradores compitan o colaboren en la generación de pruebas, reduciendo así la dependencia de una sola entidad.