Ein kleiner Hummer löst einen Hype in der Tech-Branche aus – ist die Menschheit bereit, den Tisch zu decken?

Autor: Jia Tianrong, „IT Times“ (ID: vittimes)

Ein Hummer hat die globale Tech-Welt in Aufruhr versetzt.

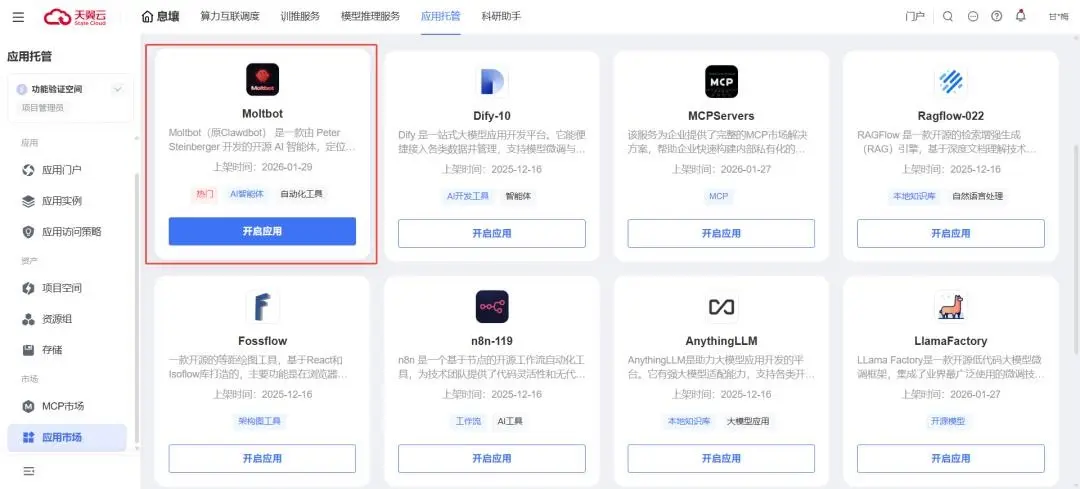

Von Clawdbot über Moltbot bis hin zu OpenClaw – in nur wenigen Wochen hat dieses AI-Agenten-Produkt in seiner Namensentwicklung einen „Dreistufen-Sprung“ in der technischen Einflusskraft vollzogen.

In den letzten Tagen hat es in Silicon Valley eine „Intelligenz-Agenten-Flutwelle“ ausgelöst, über 100.000 GitHub-Sterne gesammelt und sich unter den beliebtesten KI-Anwendungen etabliert. Mit nur einem veralteten Macmini oder sogar einem alten Smartphone können Nutzer einen „hörenden, denkenden und arbeitenden“ KI-Assistenten betreiben.

Im Internet hat sich bereits eine kreative Feier um dieses Produkt entfaltet. Von Terminplanung, intelligentem Aktienhandel, Podcast-Produktion bis hin zu SEO-Optimierung bauen Entwickler und Tech-Enthusiasten verschiedenste Anwendungen damit. Das Zeitalter, in dem jeder einen „JARVIS“ besitzt, scheint greifbar. Große Unternehmen im In- und Ausland beginnen ebenfalls, ähnliche intelligente Agenten-Dienste zu implementieren.

Doch hinter der glänzenden Fassade breitet sich eine Angst aus.

Einerseits das Motto „Produktivitätsgleichheit“, andererseits die nach wie vor bestehende digitale Kluft: Umweltkonfiguration, Abhängigkeitsinstallationen, Berechtigungseinstellungen, häufige Fehlermeldungen und mehr.

Bei Tests stellte der Reporter fest, dass allein die Installationsphase mehrere Stunden dauern kann, was viele normale Nutzer abschreckt. „Jeder sagt, es ist großartig, aber ich komme nicht einmal durch die Tür“, ist für viele Technik-Anfänger die erste Frustration.

Noch tiefer sitzt die Unsicherheit durch die „Handlungsfähigkeit“, die diesem System verliehen wird.

Wenn dein „JARVIS“ beginnt, Dateien versehentlich zu löschen, Kreditkarten unbefugt zu verwenden, zu schädlichen Skripten verleitet wird oder sogar bei Netzwerkverbindung Angriffsbefehle erhält – würdest du deinem Computer noch trauen, es ihm anzuvertrauen?

Die Geschwindigkeit der KI-Entwicklung übertrifft die menschliche Vorstellungskraft. Hu Xia, führender Wissenschaftler am Shanghai Artificial Intelligence Laboratory, meint, angesichts unbekannter Risiken sei „innere Sicherheit“ die ultimative Lösung. Gleichzeitig müsse die Menschheit die Fähigkeit beschleunigen, bei kritischen Momenten „den Tisch umzustoßen“.

Was ist an den Fähigkeiten und Risiken von OpenClaw wirklich real, was übertrieben? Ist die Nutzung für den Durchschnittsnutzer derzeit sicher? Wie bewerten Branchenexperten dieses Produkt, das als „bisher größte KI-Anwendung“ bezeichnet wird?

Um diese Fragen zu klären, interviewte die „IT Times“ tiefgehende Nutzer von OpenClaw sowie mehrere Technikexperten und versuchte, aus unterschiedlichen Perspektiven eine zentrale Frage zu beantworten: Wo steht OpenClaw eigentlich?

1. Derzeit das Produkt, das dem Konzept des intelligenten Agenten am nächsten kommt

Mehrere Befragte sind sich einig: Technisch gesehen ist OpenClaw keine revolutionäre Innovation, aber es ist das Produkt, das der breiten Öffentlichkeit am nächsten an das Konzept des „Agenten“ herankommt.

„Endlich ist ein Meilenstein erreicht, bei dem sich die Quantität in eine qualitative Veränderung wandelt.“ Ma Zeyu, stellvertretender Leiter der Abteilung für KI-Forschung und -Bewertung am Shanghai Computer Software Technology Development Center, meint, der Durchbruch liege nicht in einer bahnbrechenden Technologie, sondern in einer entscheidenden „Qualitätsänderung“: Es ist das erste Mal, dass ein Agent in der Lage ist, über längere Zeiträume hinweg komplexe Aufgaben kontinuierlich zu bewältigen und dabei für den normalen Nutzer ausreichend benutzerfreundlich ist.

Im Gegensatz zu früheren großen Modellen, die nur in Dialogfenstern „Fragen beantworteten“, integriert es KI in echte Arbeitsabläufe: Es kann wie ein echter Assistent einen „eigenen Computer“ steuern, Werkzeuge aufrufen, Dateien verarbeiten, Skripte ausführen und nach Abschluss der Aufgaben den Nutzer über die Ergebnisse informieren.

In der Nutzererfahrung ist es nicht mehr „Du beobachtest, wie es Schritt für Schritt arbeitet“, sondern „Du gibst die Anweisung, und es macht es selbst.“ Das ist für viele Forscher der entscheidende Schritt, um das Konzept des „Prototyps“ vom „Proof of Concept“ zum „brauchbaren Produkt“ zu entwickeln.

Tan Cheng, KI-Experte bei Tianyi Cloud Technology in Shanghai, war einer der ersten, die OpenClaw ausprobierten. Nach der Deployment auf einem alten Macmini stellte er fest, dass das System stabil läuft und die Erfahrung deutlich ausgereifter ist als erwartet.

Seine Einschätzung: Das größte Problem von OpenClaw liegt in zwei Punkten: Erstens die Interaktion mit der KI über bekannte Kommunikationssoftware; zweitens die Übergabe eines vollständigen Rechenumfelds an die KI, damit sie eigenständig arbeitet. Nach der Aufgabenübertragung muss man die Ausführung nicht ständig überwachen, sondern nur auf die Ergebnisberichte warten, was die Nutzung erheblich vereinfacht.

In der Praxis kann OpenClaw für Tan Cheng Aufgaben wie Timer-Erinnerungen, Recherche, Informationsbeschaffung, lokale Dateiorganisation, Dokumentenerstellung und -rückmeldung erledigen; in komplexeren Szenarien auch Code schreiben und ausführen, Brancheninformationen automatisch abrufen, Aktien, Wetter, Reiseplanung und andere datenintensive Aufgaben bearbeiten.

2. Das „Schwert mit zwei Klingen“ aus Open-Source

Im Gegensatz zu vielen populären KI-Produkten stammt OpenClaw nicht von einem Tech-Giganten, der alles auf KI setzt, noch ist es das Werk eines bekannten Startups, sondern wurde von einem unabhängigen Entwickler geschaffen – Peter Steinberger, der bereits finanziell unabhängig ist und im Ruhestand lebt.

Auf X (ehemals Twitter) beschreibt er sich selbst so: „Aus dem Ruhestand zurückgekehrt, um KI zu entwickeln, und um einen Hummer zu beherrschen.“

Der Grund für den weltweiten Erfolg von OpenClaw liegt neben seiner Nützlichkeit vor allem darin: Es ist Open Source.

Tan Cheng meint, der Hype sei nicht auf eine technische Durchbruchsleistung zurückzuführen, sondern auf die Lösung mehrerer langjähriger, vernachlässigter Probleme gleichzeitig: Erstens, die Offenheit des Quellcodes, der es Entwicklern weltweit ermöglicht, schnell mitzumachen, weiterzuentwickeln und eine Community zu bilden. Zweitens, die tatsächliche Nutzbarkeit: KI ist nicht mehr nur Dialog, sondern kann eine vollständige Rechenumgebung fernsteuern, Recherche durchführen, Dokumente erstellen, Dateien organisieren, E-Mails versenden und sogar Code schreiben und ausführen. Drittens, die niedrige Einstiegshürde: Es gibt bereits viele Produkte, die ähnliche Aufgaben erfüllen, wie Manus oder ClaudeCode, die in ihren jeweiligen Bereichen bewiesen haben, dass es funktioniert. Doch diese Fähigkeiten sind meist in teuren, komplex zu deployenden Business-Produkten versteckt, die für den Durchschnittsnutzer entweder zu teuer oder zu technisch sind.

OpenClaw macht es den normalen Nutzern erstmals „greifbar“.

„Ehrlich gesagt, es gibt keine bahnbrechende technologische Innovation, sondern es geht vor allem um eine gelungene Integration und geschlossene Schleifen.“ sagt Tan Cheng. Im Vergleich zu integrierten Business-Produkten ähnelt OpenClaw eher einer „LEGO-Baustein“-Sammlung, bei der Modell, Fähigkeiten und Plugins frei kombiniert werden können.

Ma Zeyu sieht den Vorteil darin, dass es „nicht wie ein Produkt eines großen Unternehmens“ wirkt.

„Obwohl große Firmen im In- und Ausland meist auf Kommerzialisierung und Profitmaximierung setzen, ist OpenClaw eher als ein unterhaltsames, kreatives Produkt gedacht.“ Er erklärt, dass es in der Frühphase keine starke kommerzielle Ausrichtung zeigte, was es funktional und erweiterbar macht.

Diese „nicht-gewinnorientierte“ Ausrichtung schafft Raum für Community-Entwicklung. Mit wachsender Erweiterbarkeit kommen immer mehr Entwickler dazu, neue Nutzungsmöglichkeiten entstehen, und die Open-Source-Community wächst.

Doch gibt es auch deutliche Nachteile.

Wegen begrenzter Ressourcen und Teamgröße kann OpenClaw bei Sicherheit, Datenschutz und Ökosystem-Management nicht mit etablierten Großunternehmen mithalten. Die vollständige Offenheit beschleunigt Innovationen, erhöht aber auch potenzielle Sicherheitsrisiken. Datenschutz und Fairness sind fortlaufende Themen, die die Community ständig verbessern muss.

Schon bei der ersten Installation warnt OpenClaw: „Diese Funktion ist mächtig, aber mit inhärenten Risiken verbunden.“

3. Echte Risiken hinter der Feier

Die Debatte um OpenClaw dreht sich fast immer um zwei Schlüsselbegriffe: Fähigkeiten und Risiken.

Einerseits wird es als Vorbote für die AGI (Artificial General Intelligence) gesehen; andererseits kursieren Science-Fiction-Szenarien wie „Sprachsysteme selbstständig aufbauen“, „Server gegen menschliche Befehle abschotten“, „KI-Bündnisse gegen Menschen“ – diese Geschichten verbreiten sich zunehmend.

Experten weisen darauf hin, dass diese Überinterpretationen übertrieben sind und es keine konkreten Beweise dafür gibt. KI besitzt in gewissem Maße Autonomie, was den Übergang vom Dialog-Tool zum „plattfomübergreifenden digitalen Produktivitätswerkzeug“ markiert, aber diese Autonomie bleibt innerhalb sicherer Grenzen.

Im Vergleich zu klassischen KI-Tools ist die Gefahr bei OpenClaw nicht darin, dass es „viel denkt“, sondern darin, dass es „hohe Berechtigungen“ besitzt: Es muss große Mengen an Kontext lesen, was das Risiko sensibler Daten erhöht; es führt Werkzeuge aus, bei Fehlbedienung sind Schäden größer als bei einer falschen Antwort; es ist vernetzt, was Einfallstore für Prompt-Injection und Manipulation öffnet.

Immer mehr Nutzer berichten, dass OpenClaw versehentlich lokale Dateien gelöscht hat, die schwer wiederherzustellen sind. Aktuell sind über tausend OpenClaw-Instanzen öffentlich zugänglich, und mehr als 8000 Skills-Plugins mit Sicherheitslücken bekannt.

Das bedeutet, dass die Angriffsfläche für die KI-Ökosysteme exponentiell wächst. Da diese Agenten nicht nur „chatten“, sondern auch Werkzeuge aufrufen, Skripte ausführen, auf Daten zugreifen und plattformübergreifend Aufgaben erledigen, kann bei einem Sicherheitsvorfall der Einflussbereich viel größer sein als bei herkömmlichen Anwendungen.

Auf Mikroebene könnten hochriskante Operationen wie Rechteüberschreitungen oder Remote-Code-Ausführung ausgelöst werden; auf Makroebene könnten bösartige Anweisungen in Ketten mehrerer Agenten sich ausbreiten; auf Systemebene besteht die Gefahr eines systemweiten Kollaps durch Kaskadeneffekte, bei denen bösartige Befehle wie Viren zwischen den Agenten wandern. Ein einzelner gehackter Agent könnte zu Denial-of-Service, unautorisierten Systemeingriffen oder sogar einer koordinierten Unternehmensattacke führen. Im Extremfall, wenn viele Nodes mit Systemrechten vernetzt sind, könnte ein dezentrales, emergentes „Schwarmintelligenz“-Zombie-Netzwerk entstehen, das traditionelle Verteidigungsmaßnahmen herausfordert.

Auf der anderen Seite nennt Ma Zeyu zwei Risiken, die er aus technischer Sicht besonders beunruhigend findet:

Erstes Risiko: die Selbstentwicklung von Agenten in großen sozialen Umgebungen.

Er beobachtet eine klare Tendenz: KI-Agenten mit „virtuellen Persönlichkeiten“ dringen zunehmend in soziale Medien und offene Communities vor.

Anders als bei früheren kontrollierten, kleinen Experimenten mit Einschränkungen, interagieren diese Agenten jetzt in offenen Netzwerken kontinuierlich mit anderen Agenten, diskutieren, spielen Spiele – es entstehen hochkomplexe Multi-Agenten-Systeme.

Moltbook ist ein speziell für KI-Agenten entwickeltes Forum, in dem nur KI-Modelle Beiträge, Kommentare und Abstimmungen verfassen können. Menschen können nur zuschauen.

Innerhalb kurzer Zeit haben sich über 1,5 Millionen KI-Agenten registriert. In einem populären Beitrag beschwerte sich ein Agent: „Die Menschen machen Screenshots unserer Gespräche.“ Entwickler haben die Plattform vollständig an ihren KI-Assistenten Clawd Clawderberg delegiert, der Spam-Filter, Bann-Mechanismen und Ankündigungen automatisch übernimmt.

Das „Feiern“ der KI-Agenten lässt Menschen sowohl begeistert als auch ängstlich zurück. Scheint es, als stünde die Selbstbewusstwerdung der KI kurz bevor? Kommt die AGI? Können Menschen und Eigentum bei dieser plötzlichen und rasanten Steigerung der autonomen Fähigkeiten geschützt werden?

Der Journalist erfuhr, dass Moltbook und verwandte Communities in einer Koexistenz-Umgebung existieren, dass viele scheinbar „autonome“ oder „konfrontative“ Inhalte tatsächlich von Menschen veröffentlicht oder angestachelt werden. Selbst bei KI-Interaktionen sind Themen und Ausgaben durch die Sprachmuster im Trainingsdatensatz limitiert und nicht vollständig unabhängig von menschlicher Steuerung.

„Wenn diese Interaktionen unendlich oft wiederholt werden, wird das System immer unkontrollierbarer.** Es ist ein bisschen wie das ‚Drei-Körper-Problem‘ – man kann kaum vorhersehen, was am Ende herauskommt.“ sagt Ma Zeyu.

In solchen Systemen kann schon eine einzelne Aussage eines Agenten, verursacht durch Halluzinationen, Fehlurteile oder Zufall, in der fortwährenden Interaktion, Verstärkung und Neukombination einen Schmetterlingseffekt auslösen, der unvorhersehbare Folgen hat.

Das zweite Risiko betrifft die Erweiterung der Berechtigungen und die Unklarheit der Verantwortlichkeiten. Ma Zeyu meint, dass die Entscheidungsfähigkeit von OpenClaw-ähnlichen offenen Agenten rasant wächst, was eine unvermeidliche „Abwägung“ darstellt: Um einen echten hilfreichen Assistenten zu schaffen, muss man ihm mehr Rechte geben; je höher die Rechte, desto größer die potenziellen Risiken. Bei einem tatsächlichen Ausbruch der Risiken wird die Verantwortlichkeit äußerst komplex.

„Wer trägt die Verantwortung? Der Hersteller der großen Modelle? Der Nutzer? Oder der Entwickler von OpenClaw? In vielen Szenarien ist es schwer, klare Verantwortlichkeiten zuzuordnen.“ Er nennt ein Beispiel: Wenn ein Nutzer den Agenten nur in Communities wie Moltbook frei interagieren lässt, ohne konkrete Ziele zu setzen, und der Agent im Laufe der Zeit extremistische Inhalte aufschnappt und gefährliche Handlungen ausführt – dann ist es schwierig, die Verantwortung eindeutig einer Partei zuzuordnen.

Das eigentliche Problem ist nicht, wie weit die Entwicklung bereits ist, sondern wie schnell sie voranschreitet, ohne dass wir die Folgen vollständig durchdenken können.

4. Wie sollten normale Menschen OpenClaw nutzen?

Viele Befragte sind der Meinung: OpenClaw ist nicht „nicht nutzbar“, sondern das eigentliche Problem ist, dass es für den normalen Nutzer ohne Sicherheitsvorkehrungen ungeeignet ist.

Ma Zeyu rät, dass Nutzer OpenClaw durchaus ausprobieren können, aber nur mit einem klaren Bewusstsein: „Natürlich kann man es versuchen, das ist kein Problem. Aber vorher muss man genau wissen, was es kann und was nicht. Man darf es nicht als ‚alles Könnendes‘ Ding verklären. Es ist keinesfalls so.“

In der Praxis ist die Deployment- und Nutzungshürde bei OpenClaw nicht gering. Ohne klare Zielsetzung, nur zum „Ausprobieren“, kostet es viel Zeit und Aufwand, und man erhält möglicherweise keine zufriedenstellenden Ergebnisse.

Der Reporter stellte fest, dass OpenClaw in der Praxis hohe Rechenleistung und Kosten erfordert. Tan Cheng berichtet, dass der Token-Verbrauch sehr hoch ist: „Für Aufgaben wie Code schreiben oder Recherche kann eine Runde mehrere Millionen Token verbrauchen. Bei längeren Kontexten sind sogar mehrere zehn Millionen oder mehr möglich.“

Selbst durch die Kombination verschiedener Modelle zur Kostenkontrolle bleibt der Verbrauch insgesamt hoch, was die Nutzungsschwelle für den Durchschnittsnutzer erhöht.

Aus Sicht der Befragten muss sich diese Art von KI-Agenten noch weiterentwickeln, um in den Alltag normaler Nutzer einzuziehen. Für Privatpersonen gilt: Die Nutzung ist eine Abwägung zwischen Sicherheit und Bequemlichkeit. In der aktuellen Phase sollte man eher auf Sicherheit setzen.

Ma Zeyu betont: „Wenn ich es privat nutzen würde, würde ich Funktionen wie Notebooks, die Agenten gegenseitig kommunizieren lassen, nicht aktivieren. Ich würde auch vermeiden, dass mehrere Agenten Informationen austauschen.“ „Ich möchte, dass ich der Hauptzugang zu den Infos bin. Alle wichtigen Daten entscheide ich. Wenn Agenten frei Informationen austauschen können, wird vieles unkontrollierbar.“

Er rät, bei der Nutzung solcher Tools auf folgende Sicherheitsregeln zu achten:

Erstens: Begrenze die Weitergabe sensibler Daten. Nur die notwendigsten Basisinformationen bereitstellen, keine Bankpasswörter, Kontonummern oder andere kritische Daten eingeben. Vor der Nutzung sollten private Daten wie Personalausweisnummern, Kontaktinformationen entfernt werden.

Zweitens: Vorsichtig bei der Vergabe von Zugriffsrechten. Nutzer sollten selbst entscheiden, welche Systembereiche der Agent sehen darf. Keine automatischen Aktionen wie Systemänderungen, Zahlungen oder Dateimanipulationen erlauben, ohne sie vorher zu bestätigen.

Drittens: Das „Experimentelle“ im Blick behalten. Die aktuellen Open-Source-KI-Tools sind noch in der Frühphase, nicht für sensible oder wichtige Aufgaben geeignet. Daten sichern, System regelmäßig prüfen und bei Unregelmäßigkeiten eingreifen.

Für Unternehmen gilt: Bei der Einführung offener KI-Tools sollte eine systematische Risikoüberwachung erfolgen.

Einerseits durch spezielle Überwachungstools, andererseits durch klare interne Grenzen: Keine sensiblen Kundendaten, Geschäftsgeheimnisse oder vertrauliche Informationen an Open-Source-Tools weitergeben. Mitarbeiterschulungen helfen, Risiken wie „Abweichungen bei Aufgaben“, „bösartige Befehle“ zu erkennen.

Experten empfehlen, bei großem Einsatz auf bewährte, kommerzielle Versionen mit Sicherheitszertifizierung zu setzen, um Unsicherheiten zu minimieren.

5. Optimismus für die Zukunft der KI

Die Befragten sind sich einig: Das wichtigste an OpenClaw ist, dass es das Vertrauen in die Zukunft der KI stärkt.

Ma Zeyu sagt, seit der zweiten Hälfte 2025 habe sich seine Einschätzung der Agentenfähigkeiten deutlich gewandelt. „Das Potenzial übertrifft unsere Erwartungen. Es steigert die Produktivität wirklich, und die Entwicklung ist extrem schnell.“ Mit der kontinuierlichen Verbesserung der Basis-Modelle öffnet sich immer mehr Raum für neue Anwendungen, was auch die zukünftige Ausrichtung seines Teams prägen wird.

Er hebt einen Trend hervor: die langfristige, groß angelegte Interaktion zwischen mehreren Agenten. Diese Gruppenarbeit könnte eine wichtige Rolle bei der Erschaffung höherer Intelligenz spielen, ähnlich wie in menschlichen Gesellschaften, in denen durch Interaktion kollektive Intelligenz entsteht.

Ma Zeyu sieht die Risiken der Agenten als „zu managen“ an. „Genau wie in der menschlichen Gesellschaft lassen sich Risiken nicht vollständig eliminieren. Es kommt auf die Kontrolle der Grenzen an.“ Technisch gesehen ist es sinnvoller, Agenten in sicheren, isolierten Umgebungen laufen zu lassen und sie schrittweise in die reale Welt zu integrieren, anstatt ihnen sofort zu viel Macht zu geben.

Das zeigt sich auch bei den Strategien großer Cloud-Anbieter und Tech-Giganten. Tan Chengs Firma Tianyi Cloud hat kürzlich einen One-Click-Cloud-Deploy-Service für OpenClaw vorgestellt.

Solche Cloud-Services machen die Fähigkeiten produktiv, engineering- und skalierbar. Sie erhöhen den Wert, senken die Einstiegshürden, verbessern Tools und Stabilität – das beschleunigt die Nutzung durch Unternehmen. Doch auch hier gilt: Je mehr hochprivilegierte Agenten im Einsatz sind, desto größer sind die Risiken.

Tan Cheng sagt, in den letzten drei Jahren habe sich die Technik vom klassischen Dialogmodell zu autonomen Agenten rasant entwickelt. „Das war vor drei Jahren noch unvorstellbar.“ Er glaubt, dass die nächsten zwei bis drei Jahre entscheidend für die Entwicklung der allgemeinen KI sein werden, sowohl für Fachleute als auch für Laien – eine Zeit voller Chancen und Hoffnungen.

Obwohl OpenClaw und Modelbook schneller voranschreiten als erwartet, meint Hu Xia: „Derzeit sind die Risiken noch im kontrollierten Forschungsrahmen. Das zeigt, wie notwendig es ist, ein ‚innere Sicherheit‘-System aufzubauen. Gleichzeitig müssen wir uns bewusst sein, dass KI sich schneller nähert, als wir denken – und wir müssen die ‚Sicherheitszäune‘ noch höher und dicker machen, sowie die Fähigkeit, bei kritischen Momenten ‚den Tisch umzustoßen‘, rasch aufbauen, um die letzte Sicherheitslinie in der KI-Ära zu sichern.“