تدعي OpenAI وجود "خطوط حمراء" تتعلق بالسلامة في صفقة البنتاغون—لكن المستخدمين لا يقتنعون بذلك

ملخص سريع

- وقعت شركة OpenAI اتفاقية مع البنتاغون لنشر أنظمة الذكاء الاصطناعي في بيئات سرية.

- قالت الشركة إنها فرضت “خطوط حمراء”، لكن العقد يسمح بـ"جميع الأغراض القانونية"، وهو معيار يعتمد في النهاية على تفسير الحكومة نفسه.

- أثارت الجدل حركة QuitGPT ودفعها إلى زيادة تحميلات Claude بشكل كبير.

قالت شركة OpenAI هذا الأسبوع إنها توصلت إلى اتفاق مع البنتاغون لنشر أنظمة ذكاء اصطناعي متقدمة في بيئات سرية، مما يمثل توسعًا كبيرًا في عمل الشركة مع الجيش الأمريكي. وجاء الإعلان بعد أقل من 24 ساعة من تصنيف إدارة ترامب لشركة Anthropic على أنها “خطر على سلسلة التوريد للأمن القومي” بعد نزاع حول لغة العقد المتعلقة بالمراقبة والأسلحة الذاتية القيادة. كما وجه الرئيس دونالد ترامب الوكالات الفيدرالية إلى التوقف فورًا عن استخدام تكنولوجيا Anthropic، حيث كتب وزير الخزانة سكوت بيسنت يوم الاثنين على X أن الوكالة “توقف جميع استخدامات منتجات Anthropic، بما في ذلك منصة Claude، داخل وزارتنا.”

"الولايات المتحدة الأمريكية لن تسمح أبدًا لشركة يسارية متطرفة، مستيقظة، أن تفرض كيف يقاتل ويكسب جيشنا العظيم! هذا القرار يعود إلى قائدنا الأعلى، والقادة العظماء الذين أعيّنهم لإدارة جيشنا.

المجانين اليساريون في Anthropic… pic.twitter.com/aIEx92nnyx

— البيت الأبيض (@WhiteHouse) 27 فبراير 2026

جاء توقيت إعلانات الذكاء الاصطناعي ليضع صفقة OpenAI تحت تدقيق شديد. في منشور تفصيلي على مدونة، أوضحت الشركة ما وصفته بـ"خطوط حمراء" صارمة وطبقات من الضمانات التي تحكم شراكتها مع البنتاغون. تثير الاتفاقية، كما عرضتها OpenAI، أسئلة أوسع حول كيفية تنظيم أنظمة الذكاء الاصطناعي في سياقات الأمن القومي، وكيفية تفسير وتنفيذ القيود التي أعلنتها الشركة عمليًا. عندما لا يكون “القانوني” كافيًا يفتح منشور مدونة OpenAI بثلاثة التزامات تُعتبر غير قابلة للتفاوض: عدم استخدام تكنولوجيتها للمراقبة الجماعية الداخلية، أو لتوجيه أنظمة الأسلحة الذاتية بشكل مستقل، أو لاتخاذ قرارات آلية عالية المخاطر مثل تقييم الائتمان الاجتماعي. ثم يأتي نص العقد الفعلي — الذي تسميه OpenAI “اللغة ذات الصلة”، وليس “الاتفاق الكامل”.

قالت OpenAI: “قد يستخدم قسم الحرب نظام الذكاء الاصطناعي لجميع الأغراض القانونية، بما يتوافق مع القانون الساري، والمتطلبات التشغيلية، وبروتوكولات السلامة والرقابة المعتمدة.” هذه العبارة بالضبط هي التي قال Anthropic إن الحكومة كانت تطالب بها طوال المفاوضات. وهي العبارة التي رفضت Anthropic الالتزام بها. وقعت OpenAI عليها، لكنها تؤكد أن خطوطها الحمراء لا تزال كاملة. ومع ذلك، فإن “القانوني” في سياقات الأمن القومي ليس حدودًا ثابتة — فهو يعيش داخل شبكة من القوانين، والأوامر التنفيذية، والتوجيهات الداخلية، وغالبًا التفسيرات القانونية المصنفة. عندما يمنح عقد “جميع الأغراض القانونية”، فإن الحد العملي يصبح هو الإطار القانوني الحالي للحكومة، وليس معيارًا مستقلًا يحدده البائع. مجموعة من البنود تنص بند الأسلحة على أن نظام الذكاء الاصطناعي “لن يُستخدم لتوجيه الأسلحة الذاتية بشكل مستقل في أي حالة يتطلب فيها القانون، أو اللوائح، أو سياسة القسم السيطرة البشرية.” يقتصر الحظر على الحالات التي تتطلب فيها سلطة أخرى السيطرة البشرية — ويستمد قوته من السياسة الحالية، وتحديدًا من توجيه وزارة الدفاع DoD Directive 3000.09. الذي يتطلب من الأنظمة الذاتية السماح للقادة بممارسة “مستويات مناسبة من الحكم البشري على استخدام القوة.” و"المناسب" هو مصطلح ذاتي جدًا. الحكم البشري ليس السيطرة البشرية. لم يكن هذا التمييز عرضيًا. لاحظ الباحثون في الدفاع أن حذف لغة “الإنسان في الحلقة” كان متعمدًا، بهدف الحفاظ على المرونة التشغيلية.

أقوى حجة مضادة لـOpenAI هي بنيتها التحتية المعتمدة على السحابة فقط — فقرارات القتل الذاتية بالكامل تتطلب نشرًا على أجهزة ميدانية، وهذا غير مسموح به في هذا العقد. وهذا قيد تقني حقيقي. لكن الذكاء الاصطناعي المستند إلى السحابة لا يزال قادرًا على أداء تحديد الأهداف، وتحليل نمط الحياة، وتخطيط المهام. وهذه أنشطة ضمن سلسلة القتل بغض النظر عن مكان تشغيل النموذج. النتيجة المستهدفة لا تختلف بناءً على الخادم الذي يعمل عليه النموذج. تتبع بند المراقبة نمطًا مشابهًا. الخط الأحمر الذي أعلنت عنه OpenAI: عدم المراقبة الجماعية الداخلية. نص العقد: “لا يجوز استخدام النظام للمراقبة غير المقيدة للمعلومات الخاصة للأشخاص في الولايات المتحدة” — ثم يذكر التعديل الرابع، FISA، والأمر التنفيذي 12333. كلمة “غير المقيدة” توحي بأن نسخة مقيدة من المراقبة الجماعية ستكون مسموحة. والأمر التنفيذي 12333 هو الأمر الذي استخدمته NSA لتبرير اعتراض اتصالات الأمريكيين عند القيام به خارج حدود الولايات المتحدة. وهنا تظهر مخاوف Anthropic حول صياغة النص خلال المفاوضات. كانت حجتهم أن القانون الحالي لم يواكب ما تتيحه الذكاء الاصطناعي من إمكانيات. يمكن للحكومة شراء كميات هائلة من البيانات التجارية المجمعة عن الأمريكيين بشكل قانوني ودون إذن — وقد فعلت ذلك بالفعل. نص عقد OpenAI، من خلال ربط حماياته بالأطر القانونية الحالية، قد لا يغلق الفجوة التي كانت Anthropic قلقة بشأنها. رد ألطمان في ليلة السبت، عقد ألطمان جلسة أسئلة وأجوبة ردًا على آلاف الأسئلة حول الصفقة. عندما سُئل عما قد يدفع OpenAI للانسحاب من شراكة حكومية، أجاب: “إذا طلب منا فعل شيء غير دستوري أو غير قانوني، فسوف ننسحب.”

إذا طلب منا فعل شيء غير دستوري أو غير قانوني، فسوف ننسحب. زوروني في السجن إذا لزم الأمر.

— سام ألطمان (@sama) 1 مارس 2026

هذا الإطار يضع حد OpenAI عند الشرعية — وليس عند حكم أخلاقي مستقل حول ما ستفعله الشركة أو لن تفعله إذا كان ذلك قانونيًا، وهو ما تدافع عنه Anthropic. سُئل عما إذا كان يقلق من نزاعات مستقبلية حول ما يُعتبر “قانونيًا”، فاعترف بالمخاطرة: “إذا اضطررنا لخوض تلك المعركة، سنفعل، لكنه يعرضنا لبعض المخاطر.” وعن سبب توقيع OpenAI على صفقة لم تستطع Anthropic، قال ألطمان: “بدت Anthropic أكثر تركيزًا على الحظر المحدد في العقد، بدلاً من الإشارة إلى القوانين السارية، وهو ما كنا مرتاحين له. أفضّل الاعتماد على الضمانات التقنية إذا اضطررت لاختيار واحد فقط. أعتقد أن Anthropic ربما كانت تريد سيطرة تشغيلية أكثر مما أردنا.” وهذا اختلاف فلسفي جوهري. جادلت Anthropic بأنه نظرًا لأن النماذج المتقدمة يمكن إعادة توظيفها للاستخبارات والعمليات العسكرية بطرق يصعب التنبؤ بها، فإن الحدود يجب أن تكون واضحة وملزمة كتابيًا، حتى لو على حساب الصفقة. موقف OpenAI هو أن الهندسة التقنية، والأفراد المدمجون، والقانون القائم معًا يشكلون ضمانة أقوى من النص التعاقدي وحده. اختار الجمهور جانبًا

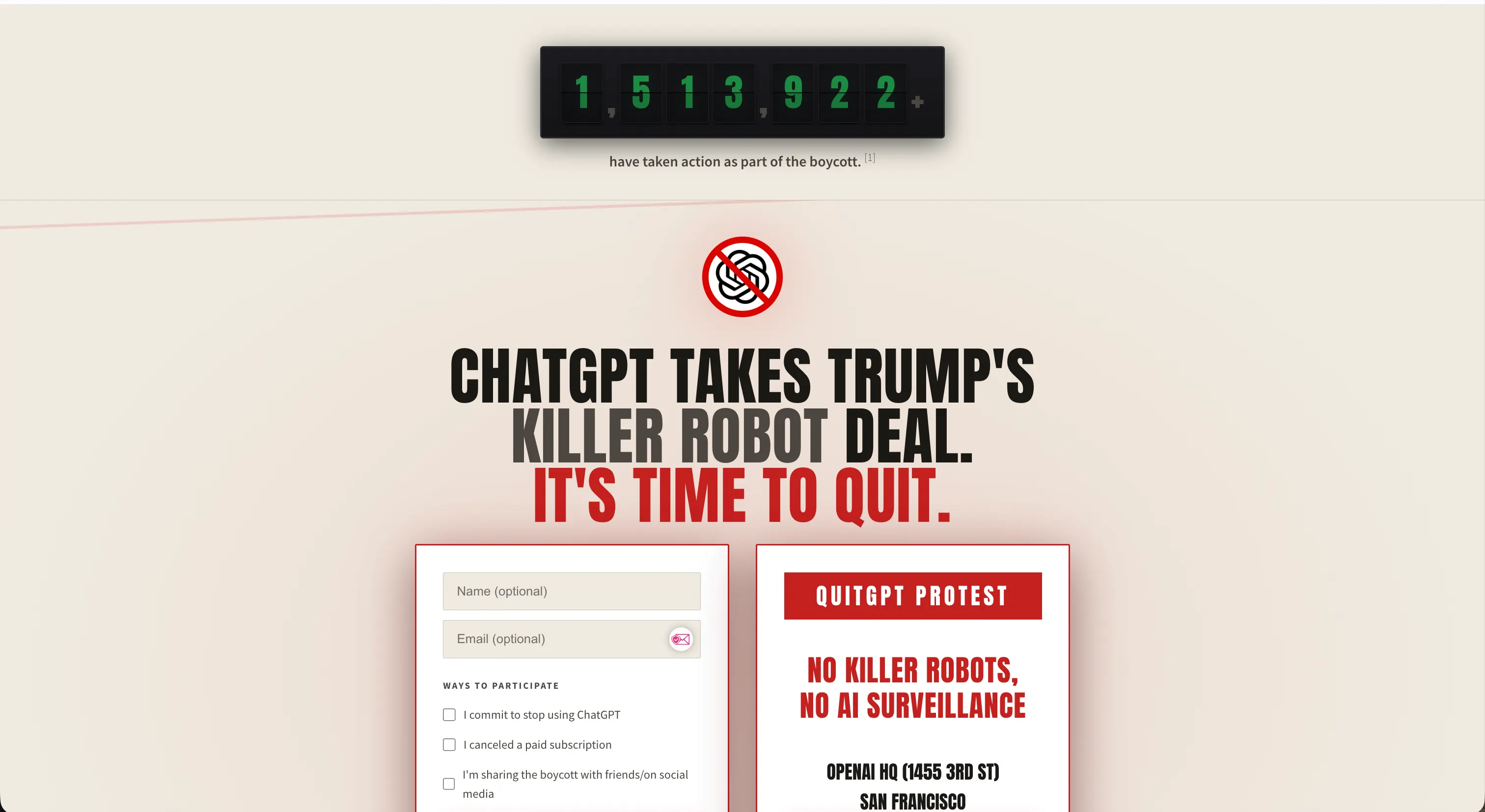

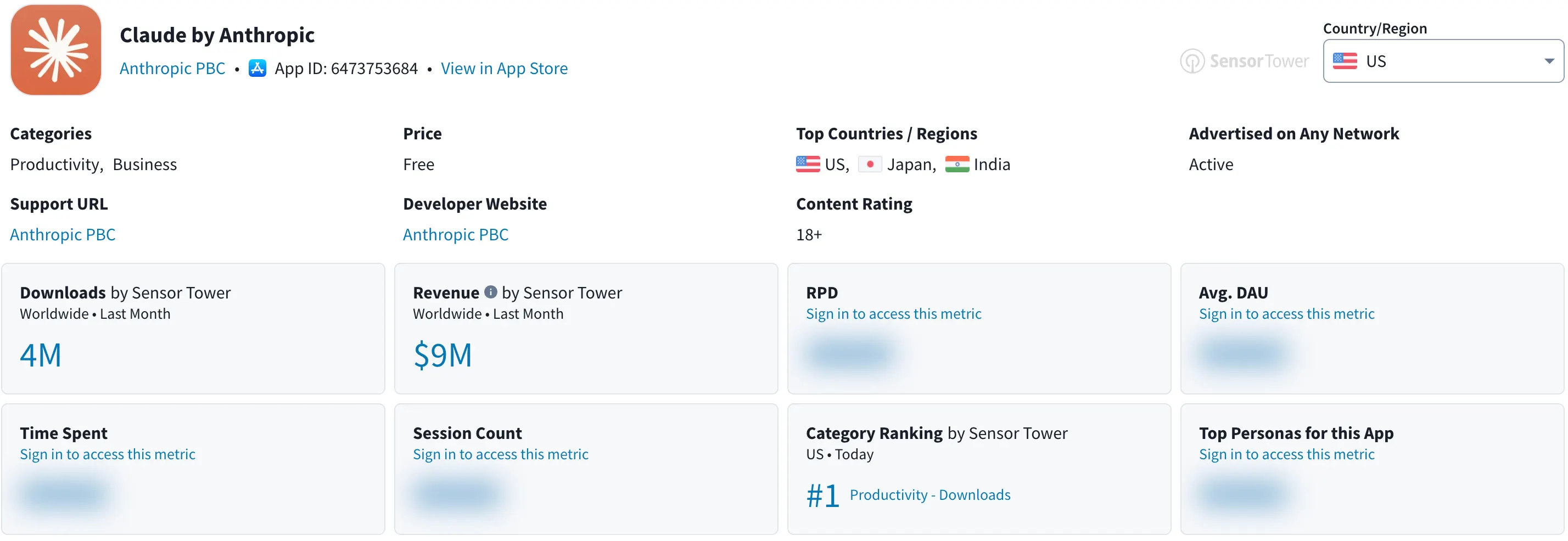

كانت ردود الفعل فورية. بحلول الاثنين، زعمت حركة QuitGPT أن أكثر من 1.5 مليون شخص اتخذوا إجراءات — إلغاء الاشتراكات، مشاركة منشورات المقاطعة، أو التسجيل في quitgpt.org. صوّرت الحملة خطوة OpenAI على أنها تفضيل العقود العسكرية على سلامة المستخدمين، متهمة الشركة بالموافقة على السماح للبنتاغون باستخدام تقنيتها لأي غرض قانوني، بما في ذلك الروبوتات القاتلة والمراقبة الجماعية. قد تعترض OpenAI على تلك الوصف. لكن السوق تحرك على أي حال. تجاوزت شركة Claude من Anthropic تطبيق ChatGPT في عدد التنزيلات المجانية الأكثر في متجر تطبيقات Apple في الولايات المتحدة، وأخبرت Decrypt أنها شهدت أرقام تسجيل قياسية يومية خلال عطلة نهاية الأسبوع. شاركت النجمة كاتي بيري لقطة شاشة لصفحة تسعير Claude على X. وثّق مئات المستخدمين إلغاء اشتراكاتهم علنًا على Reddit. ظهرت رسومات جرافيتي تمجد Anthropic خارج مكاتبها في سان فرانسيسكو، بينما غطت ضربات الطباشير أرصفة OpenAI. حتى أن مئات من موظفي OpenAI وقعوا سابقًا على رسالة مفتوحة تدعم رفض Anthropic الاستجابة لمطالب البنتاغون.

إطار QuitGPT عاطفيًا مقنع، لكنه ليس دقيقًا تمامًا. لدى Anthropic شراكة مع Palantir وAmazon Web Services تتيح لوكالات الاستخبارات والدفاع الأمريكية الوصول إلى نماذج Claude، ويُزعم أنها استُخدمت في عمليات عسكرية للإطاحة بحكومات فنزويلا وإيران. لم تكن أخلاقيات الذكاء الاصطناعي والتعاقدات الأمنية الوطنية نظيفة على أي من الجانبين. ما التقطته الحملة بدقة هو أن جزءًا كبيرًا من المستخدمين يعتقدون أن هناك فرقًا ذا معنى بين كيفية رسم حدود الشركتين — وصوتوا باشتراكاتهم بناءً على ذلك. ما إذا كان هذا الاختلاف ذو معنى كما يبدو يتطلب قراءة العقد بعناية.