72 ساعة، ثلاث أزمات: روح أنثروبيك تُنَاقَص في المزاد

كتابة: Ada، Deep Tide TechFlow

2 فبراير، الثلاثاء. واشنطن، البنتاغون.

يجلس مدير شركة Anthropic، داريو أموديي، مقابل وزير الدفاع بيت هيجسث. وفقًا لعدة وسائل إعلام مثل NPR و CNN نقلاً عن مصادر مطلعة، فإن أجواء اللقاء كانت “مؤدبة”، لكن المحتوى لم يكن لطيفًا على الإطلاق.

قدم له هيجسث إنذارًا نهائيًا: قبل الساعة 5:01 مساءً يوم الجمعة، يجب رفع القيود العسكرية عن Claude، والسماح للبنتاغون باستخدامه “للجميع الأغراض القانونية”، بما في ذلك استهداف الأسلحة الذاتية والمراقبة الجماعية داخل البلاد.

وإلا، سيتم إلغاء عقد بقيمة 200 مليون دولار. وبدء قانون الإنتاج الدفاعي، وتطبيق الاستيلاء الإجباري. وتصنيف Anthropic كـ"مخاطر سلسلة التوريد"، وهو ما يعادل وضعها على قائمة الأعداء من روسيا والصين.

في نفس اليوم، أصدرت Anthropic النسخة الثالثة من “سياسة التوسع المسؤولة” (RSP 3.0)، مع حذف سري لواحدة من أهم وعود الشركة منذ تأسيسها: عدم تدريب نماذج أقوى إلا إذا تم ضمان تدابير الأمان.

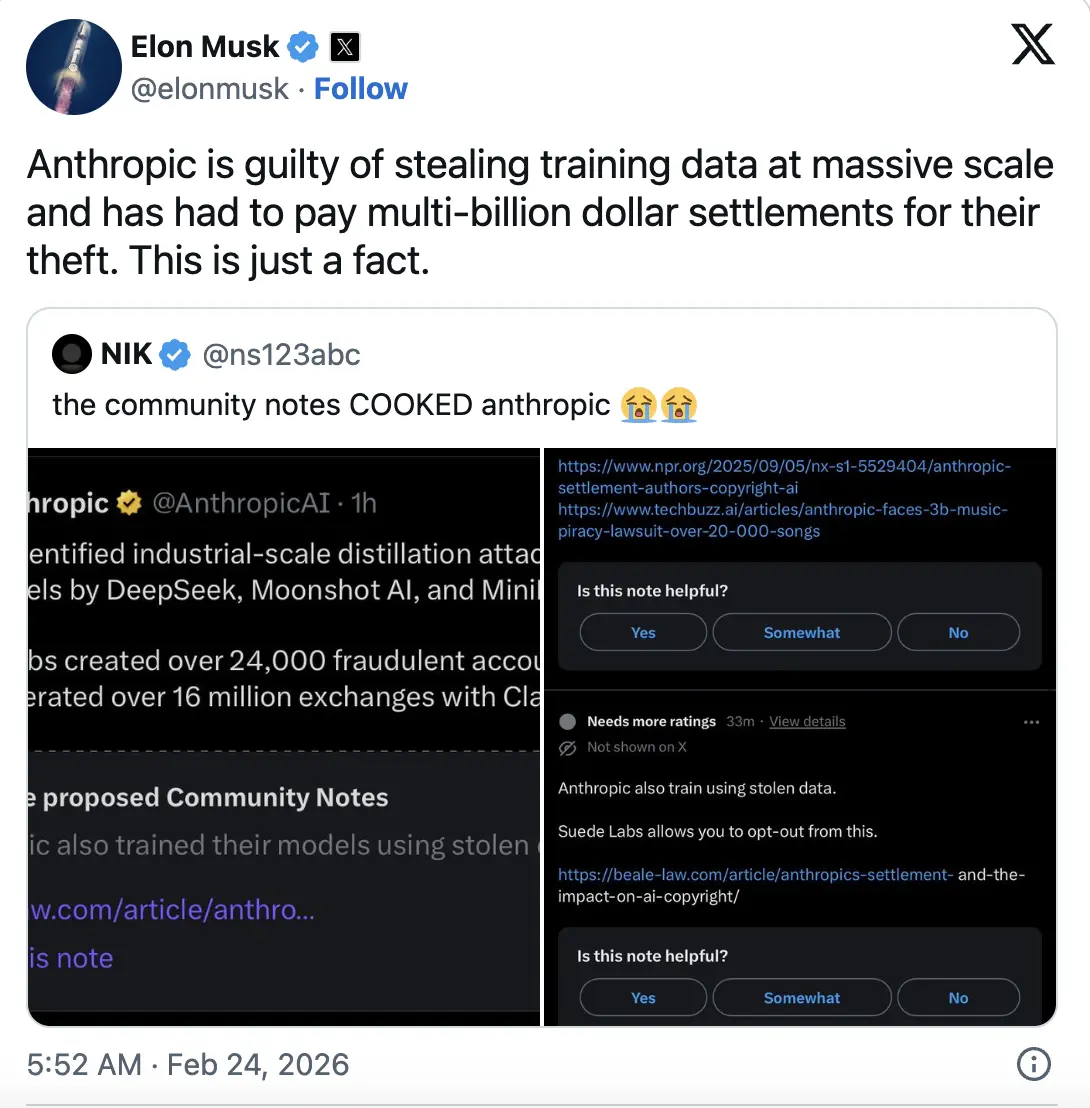

وفي ذات اليوم، نشر إيلون ماسك على منصة X تغريدة يقول فيها: “Anthropic سرقت بيانات تدريب بشكل واسع، وهذا هو الواقع.” وأرفق ملاحظة مجتمعية على X تضيف أن Anthropic دفعت 1.5 مليار دولار تسوية بسبب استخدامها لكتب مقرصنة في تدريب Claude.

خلال 72 ساعة، لعبت هذه الشركة التي تدعي أن لها “روحًا” ثلاثة أدوار: الشهيد الأمني، اللص الحقوقي، والخائن للبنتاغون.

أيها الحقيقي منهم؟

ربما جميعهم.

“إما الطاعة أو الإقصاء” من البنتاغون

القصة من بدايتها بسيطة.

Anthropic هي أول شركة ذكاء اصطناعي تحصل على وصول سري من وزارة الدفاع الأمريكية. العقد الذي حصلت عليه الصيف الماضي بقيمة تصل إلى 200 مليون دولار. تلتها OpenAI و Google و xAI بعقود مماثلة.

وفقًا لجزيرة الجزيرة، فإن Claude استُخدم في عملية عسكرية أمريكية في يناير من هذا العام، وتُشير التقارير إلى أنها كانت تتعلق باختطاف رئيس فنزويلا، مادورو.

لكن Anthropic وضعت خطين أحمرين: عدم دعم استهداف الأسلحة الذاتية بشكل كامل، وعدم دعم المراقبة الجماعية للمواطنين الأمريكيين. ترى أن الاعتمادية على الذكاء الاصطناعي غير كافية للتحكم في الأسلحة، ولا توجد قوانين تنظم استخدام الذكاء الاصطناعي في المراقبة الجماعية.

لكن البنتاغون لا يوافق.

مستشار البيت الأبيض للذكاء الاصطناعي، ديفيد ساكس، اتهم العام الماضي على منصة X أن Anthropic “تستخدم الخوف كأداة للسيطرة والتنظيم”.

المنافسون استسلموا بالفعل. إذ وافقت OpenAI و Google و xAI على السماح للجيش باستخدام ذكائهم الاصطناعي في “جميع السيناريوهات القانونية”. ومرخصت شركة Musk، Grok، مؤخرًا لدخول الأنظمة السرية.

أما Anthropic فهي الأخيرة التي لا تزال واقفة.

حتى وقت نشر هذا، أعلنت Anthropic في بيان حديث أنها لا تنوي التراجع. لكن المهلة المحددة يوم الجمعة الساعة 5:01 تقترب.

قال مصدر مجهول من وزارة العدل والدفاع لـ CNN: “كيف يمكن أن تعلن شركة واحدة أنها ‘مخاطر سلسلة التوريد’ وفي ذات الوقت تُجبر على العمل لصالح جيشك؟”

سؤال وجيه، لكنه خارج نطاق تفكير البنتاغون. ما يهمهم هو أنه إذا لم تتنازل Anthropic، فسيتم اتخاذ إجراءات قسرية، أو أن تُترك جانبًا في واشنطن.

“هجوم التقطير”: اتهام يصفع الوجه

في 23 فبراير، أصدرت Anthropic مدونة حادة اللهجة تتهم فيها ثلاث شركات ذكاء اصطناعي صينية بـ"هجوم تقطير صناعي" على Claude.

المتهمون هم DeepSeek، Moonshot AI، MiniMax.

وتتهمهم Anthropic باستخدام 24 ألف حساب مزيف، وإجراء أكثر من 16 مليون تفاعل مع Claude، بهدف استهداف استخراج قدراته الأساسية في الاستدلال، واستدعاء الأدوات، والبرمجة.

تصنّف Anthropic الأمر على أنه تهديد للأمن القومي، وتقول إن النماذج المقطرة “من غير المحتمل أن تحتفظ بحواجز أمان”، وقد تُستخدم من قبل حكومات استبدادية في هجمات إلكترونية، ومعلومات مضللة، ومراقبة جماعية واسعة.

السرد مثالي، والوقت مناسب تمامًا.

بالضبط بعد أن خففت إدارة ترامب قيود تصدير الرقائق إلى الصين، وبينما كانت Anthropic تبحث عن ذخيرة لمناصرة موقفها من قيود تصدير الرقائق.

لكن ماسك أطلق النار: “Anthropic سرقت بيانات تدريب بشكل واسع، ودفعوا مليارات الدولارات كتعويض. هذا هو الواقع.”

قال توري غرين، أحد الشركاء المؤسسين لشركة IO.Net للبنية التحتية للذكاء الاصطناعي: “أنتم تدربون نماذجكم باستخدام بيانات الإنترنت كلها، ثم يستخدم الآخرون API العامة الخاصة بكم ليتعلموا منكم، ويطلقون على ذلك ‘هجوم تقطير’؟”

تصف Anthropic التقطير بأنه “هجوم”، لكن هذا الأمر مألوف جدًا في صناعة الذكاء الاصطناعي. إذ تستخدمه OpenAI لضغط GPT-4، وGoogle لتحسين Gemini، وحتى Anthropic نفسها تفعل ذلك. الفرق الوحيد هو أن التقطير هذه المرة كان على نفسها.

وفقًا لخبير الذكاء الاصطناعي في جامعة نانيانج للتكنولوجيا في سنغافورة، إريك كامبريا، قال لـ CNBC: “الحد الفاصل بين الاستخدام القانوني والاستغلال الخبيث غالبًا ما يكون غامضًا.”

والأكثر سخرية أن Anthropic دفعت 1.5 مليار دولار تسوية بسبب تدريب Claude باستخدام كتب مقرصنة، ثم تتهم الآخرين باستخدام API العامة الخاص بها للتعلم منها. هذا ليس ازدواجية معايير، بل ثلاثية معايير.

كانت Anthropic تريد أن تلعب دور الضحية، لكنها أصبحت المتهمة.

إلغاء وعود الأمان: RSP 3.0

وفي ذات اليوم الذي تصادمت فيه مع البنتاغون، وتبادلت الانتقادات مع وادي السيليكون، أصدرت Anthropic النسخة الثالثة من سياسة التوسع المسؤولة.

قال جارد كابلان، كبير العلماء في Anthropic، في مقابلة مع وسائل الإعلام: “نعتقد أن التوقف عن تدريب نماذج الذكاء الاصطناعي لا يفيد أحدًا. في ظل التطور السريع للذكاء الاصطناعي، فإن الالتزام الأحادي الجانب… بينما المنافسون يسرعون، لا معنى له.”

بمعنى آخر، إذا لم يلتزم الآخرون، فلن نلتزم نحن أيضًا.

النسختان 1.0 و 2.0 من RSP كانتا تتضمنان وعودًا صارمة، مفادها أنه إذا تجاوزت قدرات النموذج حدود تدابير الأمان، يتوقف التدريب. هذه الوعد أكسبت Anthropic سمعة فريدة في مجال أمان الذكاء الاصطناعي.

لكن 3.0 ألغت ذلك.

واستبدلته بإطار أكثر “مرونة”، يقسم التدابير الأمنية التي يمكن لـAnthropic تنفيذها والنصائح الأمنية التي تتطلب تعاون الصناعة إلى مسارين. يُنشر تقرير مخاطر كل 3-6 أشهر، ويُراجع من قبل خبراء خارجيين.

هل يبدو مسؤولًا؟

قال كريس باينتر، مراجع مستقل من منظمة METR غير الربحية، بعد اطلاعه على مسودة السياسة المبكرة: “هذا يدل على أن Anthropic ترى أنها بحاجة إلى وضع ‘وضع التشخيص’، لأن طرق تقييم وتخفيف المخاطر لم تعد تواكب نمو القدرات. وهذا يثبت أكثر أن المجتمع غير مستعد لمخاطر الذكاء الاصطناعي المحتملة والكارثية.”

وفقًا لمجلة TIME، استغرقت Anthropic قرابة عام لمناقشة هذا التغيير داخليًا، ووافق عليه الرئيس التنفيذي أموديي ومجلس الإدارة بالإجماع. والبيان الرسمي يقول إن الهدف من السياسة الأصلية كان دفع صناعة الذكاء الاصطناعي نحو توافق، لكن الصناعة لم تواكب ذلك. الحكومة الأمريكية كانت تتعامل مع الذكاء الاصطناعي بتراخٍ، وحتى تحاول إلغاء قوانين الولاية ذات الصلة. التشريعات الفيدرالية لا تزال بعيدة المنال. وعلى الرغم من أن إنشاء إطار حوكمة عالمي في 2023 لا يزال ممكنًا، إلا أن الباب يبدو مغلقًا بعد مرور ثلاث سنوات.

قال باحث مجهول يتابع تنظيم الذكاء الاصطناعي بشكل مباشر: “RSP هو أصول العلامة التجارية الأكثر قيمة لـAnthropic. حذف وعود إيقاف التدريب يشبه أن تزيل شركة للأغذية العضوية كلمة ‘عضوي’ من عبواتها وتخبرك الآن أن فحوصاتها أكثر شفافية.”

انقسام الهوية تحت تقييم بقيمة 380 مليار دولار

في بداية فبراير، أتمت Anthropic جولة تمويل بقيمة 300 مليار دولار، بقيمة تقييم تصل إلى 380 مليار دولار، مع أمازون كمستثمر رئيسي. منذ تأسيسها، حققت إيرادات سنوية قدرها 14 مليار دولار، وتضاعفت خلال الثلاث سنوات الماضية أكثر من عشرة أضعاف.

وفي ذات الوقت، هدد البنتاغون بإدراجها على القائمة السوداء. ووجه ماسك اتهامات علنية بسرقة بياناتها. وتم حذف وعودها الأساسية للأمان. وبعد استقالة مسؤول الأمان في الشركة، ميرانانك شارما، كتب على X: “العالم في خطر.”

هل هناك تناقض؟

ربما التناقض هو جوهر شركة Anthropic.

أسسها سابقو كبار مسؤولي OpenAI، خوفًا من أن تتقدم OpenAI بسرعة كبيرة في مجال الأمان. ثم أنشأوا شركتهم الخاصة لبناء نماذج أقوى بسرعة أكبر، مع إبلاغ العالم عن مدى خطورة هذه النماذج.

نموذج أعمالها يمكن تلخيصه في جملة: نحن أكثر خوفًا من الذكاء الاصطناعي، لذلك يجب أن تدفع لنا لبنائه.

هذا السرد كان يعمل بشكل مثالي في 2023-2024. أمان الذكاء الاصطناعي كان كلمة السر في واشنطن، وAnthropic كانت أكبر لوبي.

لكن في 2026، تغير الاتجاه.

“الذكاء الاصطناعي الواعي” أصبح علامة هجوم، وقوانين تنظيم الذكاء الاصطناعي على مستوى الولايات أُعاقت من قبل البيت الأبيض، وقانون كاليفورنيا SB 53 الذي دعمته Anthropic أُوقع، لكن على المستوى الفيدرالي، لا شيء يتحرك.

ورقة أمان Anthropic تتجه من “ميزة تميز” إلى “عبء سياسي”.

الشركة الآن تتعامل مع توازن معقد: تحتاج أن تكون “آمنة” بما يكفي للحفاظ على علامتها التجارية، و"مرنة" بما يكفي لعدم التخلي عنها من قبل السوق والحكومة. المشكلة أن مساحة التسامح تتقلص على كلا الجانبين.

هل لا تزال قصة الأمان تستحق الثمن؟

عند جمع الثلاثة معًا، تتضح الصورة.

اتهام الشركات الصينية بـ"تقطير" Claude يهدف لتعزيز سرد الضغط على تصدير الرقائق. ولعدم التخلف عن سباق التسلح، أُلغيت وعود التوقف عن التدريب. ورفض طلبات البنتاغون بشأن الأسلحة الذاتية، للحفاظ على آخر قشرة أخلاقية.

كل خطوة منطقية، لكن بين كل خطوة وأخرى توجد تناقضات.

لا يمكنك أن تقول إن الشركات الصينية “تقطر” نماذجك وتخشى أن تهدد الأمن القومي، وفي ذات الوقت تلغي وعود منع نماذجك من الانفلات. إذا كانت النماذج خطيرة جدًا، فالأحرى أن تكون أكثر حذرًا، وليس أكثر عدوانية.

إلا إذا كنت أنت Anthropic.

في صناعة الذكاء الاصطناعي، الهوية لا تُحدد ببياناتك أو تصريحاتك، بل تُحدد بميزانيتك ومواردك. سرد Anthropic عن “الأمان” هو في جوهره نوع من قيمة العلامة التجارية المضافة.

في سباق التسلح بالذكاء الاصطناعي، كانت هذه القيمة تضيف الكثير في 2023-2024. المستثمرون كانوا على استعداد لدفع تقييمات أعلى لـ"الذكاء الاصطناعي المسؤول"، والحكومات كانت تفتح الأبواب لـ"الذكاء الاصطناعي الموثوق"، والعملاء كانوا يدفعون مقابل “الذكاء الاصطناعي الأكثر أمانًا”.

لكن في 2026، بدأ هذا الامتياز يتلاشى.

الشركة الآن تواجه ليس خيار “هل تتنازل أم لا”، بل ترتيب “ممن تتنازل أولاً”.

التنازل للبنتاغون يضر بالعلامة التجارية، والتنازل للمنافسين يُلغي وعود الأمان، والتنازل للمستثمرين يضطرها للمساومة على كلا الجانبين.

الجمعة، الساعة 5:01 مساءً، ستعطي Anthropic جوابها.

لكن، بغض النظر عن الجواب، هناك شيء واحد مؤكد: ذلك الكيان الذي كان يعتمد على شعار “نختلف عن OpenAI”، يتجه الآن ليصبح مثل الجميع.

أزمة الهوية غالبًا ما تنتهي باختفاء الهوية.