أنثروبي تتهم 3 شركات صينية بتدريب الذكاء الاصطناعي! المستخدمون ينتقدون المعايير المزدوجة: أنتم أيضًا تسرقون حقوق النشر

اتهمت شركة أنثروبيك، مطورة روبوت المحادثة الذكي كلاود، ثلاث مختبرات ذكاء اصطناعي صينية هي ديبسيك، مونشوت AI، وMin، باستخدام تقنية التقطير لنسخ قدرات نماذجها. وقد سخر مستخدمو الإنترنت من هذا الاتهام، معتبرين أنه يخالف قوانين حقوق النشر، كما أثار جدلاً في الولايات المتحدة حول تصدير الرقائق الوطنية والأمن القومي.

أنثروبيك تتهم 3 مختبرات ذكاء اصطناعي صينية باستخدام تقنية التقطير لتدريب نماذج متقدمة

أعلنت شركة أنثروبيك، المطورة لنظام الدردشة الذكي كلاود، أن ثلاث مختبرات ذكاء اصطناعي صينية هي ديبسيك، مونشوت AI، وMin، استخدمت أكثر من 24,000 حساب وهمي للوصول إلى بيانات وتبادل أكثر من 16 مليون مرة مع نموذج كلاود، واستعملت تقنية التقطير بهدف نقل القدرات الأساسية لكلاود إلى نماذجها الخاصة.

“تقنية التقطير” هي تقنية تدريب شائعة في الذكاء الاصطناعي، تعتمد على تقييم جودة إجابات النموذج الجديد بواسطة نماذج أقدم أو أكبر حجماً وأكثر نضجاً، مما يسمح لنماذج أصغر وأقل تكلفة بتعلم نتائج العمليات الحسابية من النماذج الأكبر.

كانت تقنية التقطير في الأصل وسيلة مشروعة في صناعة الذكاء الاصطناعي لبناء نماذج خفيفة الوزن للعملاء، لكن المنافسين يمكنهم استغلالها لنسخ نتائج أبحاث المختبرات الأخرى مباشرة.

وأشارت أنثروبيك إلى أن هذه المختبرات الصينية استخدمت خوادم وسيطة لتجنب الكشف، وركزت على سرقة قدرات الاستدلال الوكيل، واستخدام الأدوات، وكتابة الأكواد الخاصة بكلاود بشكل واسع.

مصدر الصورة: X أنثروبيك تتهم 3 مختبرات ذكاء اصطناعي صينية باستخدام تقنية التقطير لنسخ قدرات النماذج المتقدمة

انتقادات من المستخدمين حول ازدواجية المعايير، وأنثروبيك تواجه دعاوى حقوق نشر

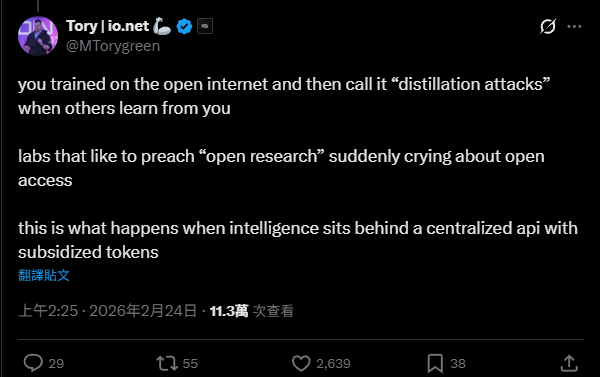

لكن، بعد إصدار بيان من أنثروبيك، تعرضت لانتقادات وسخرية واسعة من قبل المستخدمين، حيث اعتبر بعضهم أن موقف أنثروبيك من أساليب تدريب النماذج يتسم بمعايير مزدوجة.

وكتب توري غرين، أحد مؤسسي شركة IO.Net المختصة بالبنية التحتية للذكاء الاصطناعي، منتقداً، أن شركات الذكاء الاصطناعي تستخدم البيانات العامة على الإنترنت للتدريب، ومع ذلك تصف استغلالها لهذه البيانات في التقطير بأنه هجوم، بينما كانت أنثروبيك تروج لسياسة الانفتاح على الأبحاث، والآن تشتكي من الوصول المفتوح.

في عام 2025، رفعت منصة Reddit الشهيرة في الولايات المتحدة دعوى قضائية ضد أنثروبيك، تتهمها بجمع أكثر من 100 ألف منشور وتعليق على المنتدى بدون إذن، لاستخدامها في تحسين نموذج كلاود. وتزعم Reddit أن أنثروبيك انتهكت اتفاقية المستخدم، وأنها استمرت في الوصول إلى خوادم Reddit أكثر من مئة ألف مرة بعد إعلانها التوقف عن ذلك.

كما تواجه أنثروبيك دعوى جماعية بسبب استخدامها غير القانوني لـ 7 ملايين كتاب لتدريب نموذجها كلاود، ووافقت العام الماضي على دفع تعويض قدره 1.5 مليار دولار للتسوية، وهو أكبر مبلغ يُدفع في قضية حقوق نشر في تاريخ الولايات المتحدة، لكن المبلغ لا يزال بحاجة لموافقة المحكمة.

- **تغطية ذات صلة: أكبر تعويض في تاريخ الذكاء الاصطناعي! سرقة كتب وتدريب غير قانوني، والتسوية بقيمة 48 مليار دولار، وحقوق أدبية لكتاب تايوانيين

OpenAI تحذر من ديبسيك وتدعو للانتباه

إلى جانب أنثروبيك، تواجه شركة OpenAI العملاقة أيضًا نفس التحديات.

وفقًا لمذكرة داخلية نشرتها وكالة رويترز الأسبوع الماضي، حذرت OpenAI المشرعين الأمريكيين من أن ديبسيك تستهدف مطور ChatGPT وأكبر شركات الذكاء الاصطناعي في الولايات المتحدة، وتحاول نسخ نماذجها واستخدامها في تدريب خوارزميات خاصة بها.

رصدت OpenAI حسابات مرتبطة بموظفي ديبسيك، تعمل على تطوير طرق لتجاوز قيود الوصول التي تفرضها OpenAI، عبر استخدام مسارات وسيطة مشوشة ومصادر مخفية، للوصول برمجياً إلى نماذج الذكاء الاصطناعي الأمريكية، والحصول على نتائجها لاستخدامها في التقطير.

جدل تقنية التقطير الصينية، في ظل تخفيف قيود تصدير الرقائق الأمريكية

بينما تتهم الشركات الأمريكية العملاقة الصين باستخدام تقنية التقطير لتدريب نماذجها، يمر الوقت في ظل جدل حاد حول سياسة تصدير الرقائق إلى الصين، حيث سمحت إدارة ترامب في يناير الماضي لشركات أمريكية مثل نيفيديا بتصدير رقائق AI المتقدمة مثل H200 إلى الصين.

ويعتقد المنتقدون أن تخفيف قيود التصدير في هذا الوقت الحرج من سباق السيطرة على الذكاء الاصطناعي سيزيد بشكل كبير من قدرات الصين في الحوسبة الذكية.

قال ديمتري ألبيروفيتش، رئيس معهد Silverado Policy Accelerator، إن تقدم النماذج الصينية بسرعة كبيرة يرجع جزئياً إلى سرقتها لتقنيات التقطير الأمريكية. وأكد أن الأدلة تدعم ضرورة رفض الولايات المتحدة بيع أي رقائق AI لهذه الشركات، وإلا فإنها ستتمكن من توسيع تفوقها بشكل أكبر.

وحذرت أنثروبيك من أن أنظمة الذكاء الاصطناعي التي تبنيها الشركات الأمريكية توفر آليات حماية ضد استخدام الدول أو الجهات غير الحكومية لها في تطوير أسلحة بيولوجية أو أنشطة خبيثة أخرى، لكن النماذج المبنية عبر تقنية التقطير غالباً تفتقر لهذه الحماية.

وتخشى أنثروبيك من أن دمج هذه القدرات غير المقيدة في الأنظمة العسكرية والاستخباراتية من قبل الدول القمعية قد يؤدي إلى تصعيد كبير في المخاطر الأمنية، من خلال استخدام الذكاء الاصطناعي في الهجمات الإلكترونية، ونشر المعلومات المضللة، والمراقبة الجماعية.

قراءة إضافية:

هاكرز صينيون يشنون هجمات واسعة على أنظمة الذكاء الاصطناعي! أنثروبيك: سرعة وحجم هجمات الهاكرز تتجاوز البشر