Anthropic聯創預言:2028年前,AI研發將不再需要人類參與

原文標題:Import AI 455:AI 系統即將開始自我建構。

原文作者:Jack Clark,Anthropic 聯創

原文編譯:楊文、陳陳,機器之心

這一觀點並非憑空而來。他看了一堆公開基準,發現 AI 在 AI 研發相關任務上進步非常快。

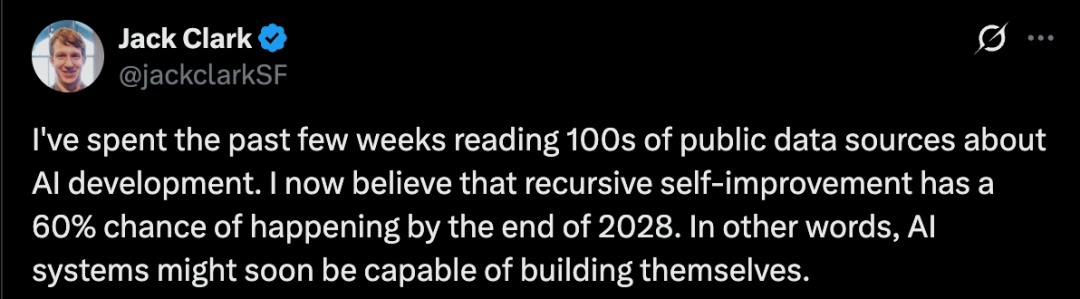

比如,CORE-Bench 考察 AI 實現他人研究論文的能力,這是 AI 研究中至關重要的一環。

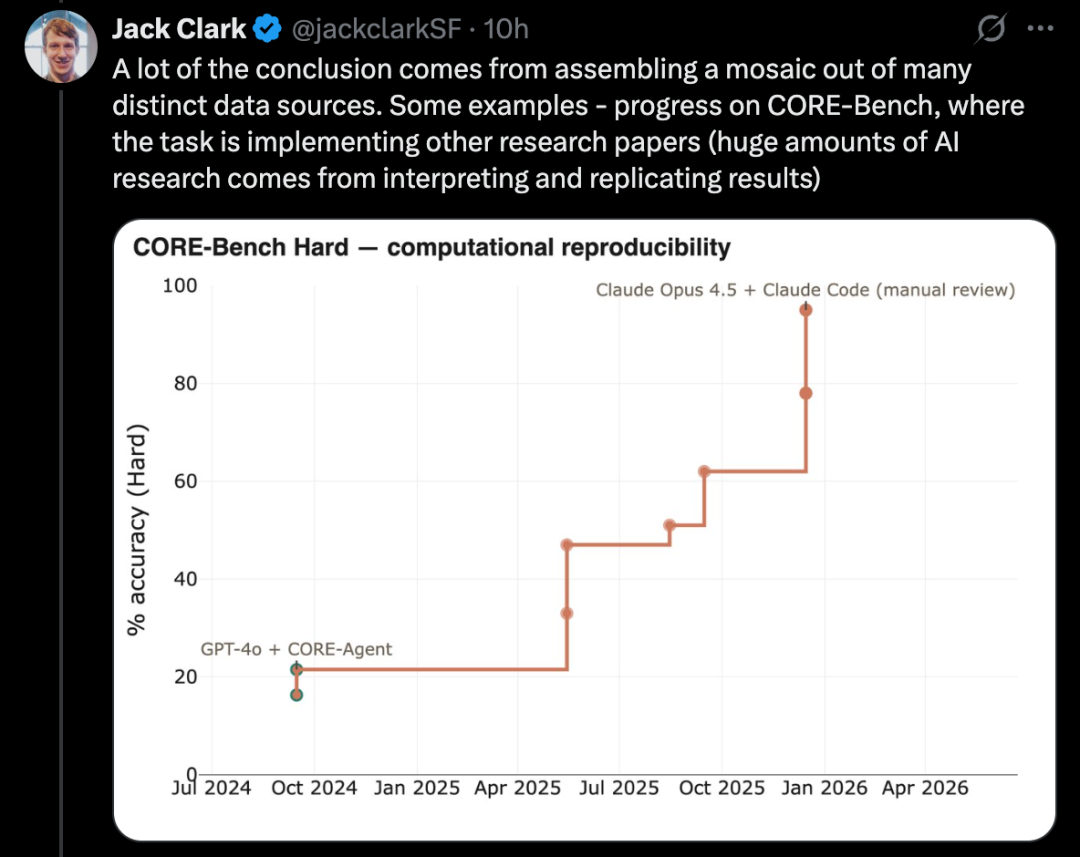

PostTrainBench 則測試強大模型能否自主微調較弱的開源模型以提升性能,這正是 AI 研發任務的一個關鍵子集。

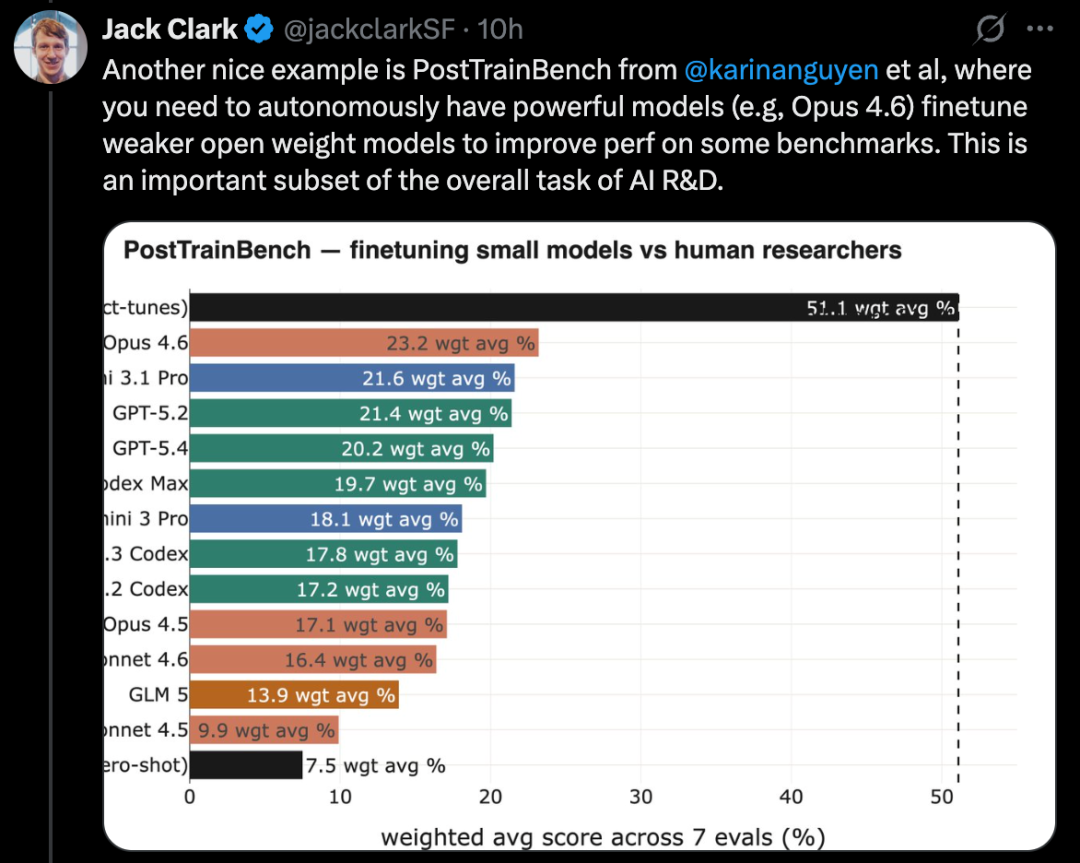

MLE-Bench 基於真實 Kaggle 競賽任務,要求構建多樣化的機器學習應用來解決特定問題。此外,像 SWE-Bench 這樣廣為人知的編碼基準,也展現出類似的進步。

Jack Clark 將這一現象描述為「分形」式的向上向右趨勢,即在不同解析度和尺度上,都能觀察到有意義的進展。他認為,AI 正在逐步接近端到端自動化研發的能力,一旦實現,AI 將能自主建構自己的後繼系統,開啟自我迭代的循環。

此言論一出,在社交媒體引發不少討論。

一些人視其為邁向 ASI 和奇點的關鍵第一步,可能徹底改變科技發展的節奏。

然而,也存在不同聲音。

華盛頓大學計算機科學教授 Pedro Domingos 指出,AI 系統早在上世紀 50 年代 LISP 語言發明時就具備了「構建自身」的能力,真正的問題在於能否獲得遞增回報,而目前還沒有明顯證據支持這一點。

有網友質疑,從 2027 年到 2028 年,概率一下子增加 30%,這暗示 AI 能力會在 2027 年底前後出現一次突然的重大突破。到底哪一個具體的里程碑或事件,會讓 AI 實現遞歸自我改進的概率在短時間內大幅提升?

還有網友表示,Jack Clark 是 Anthropic 新上任的公關負責人,這正是他們新戰略的一部分:我們並非危言耸聽者,有大量的論文都印證了我們一直以來警告你們的事情。

Jack Clark 專門在 Import AI 455 這期 newsletter 裡寫了一篇長文詳細闡述。

接下來,我們完整看一下這篇文章。

AI 系統即將開始自我建構,這意味著什麼?

Clark 表示,他寫下這篇文章,是因為在梳理所有公開可獲得的信息後,他不得不形成一個並不輕鬆的判斷:到 2028 年底之前,出現無人類參與的 AI 研發的可能性已經相當高,或許超過 60%。

這裡所謂的無人類參與的 AI 研發,指的是一種足夠強大的 AI 系統:它不僅能輔助人類做研究,還可能自主完成關鍵研發流程,甚至構建出自己的下一代系統。

在 Clark 看來,這顯然是一件大事。

他坦言,自己也很難完全消化這件事的含義。

之所以稱這是個不情願的判斷,是因為它背後的影響過於巨大,讓他感到難以把握。Clark 也不確定,整個社會是否已經準備好迎接 AI 研發自動化所帶來的深層變化。

他現在相信,人類可能正生活在一個特殊時間點:AI 研究即將被端到端自動化。如果這一刻真的到來,人類就像跨過了盧比孔河,進入一個幾乎無法預測的未來。

Clark 表示,這篇文章的目的,是解釋他為什麼認為,通向完全自動化 AI 研發的起飛正在發生。

他會討論這一趨勢可能帶來的一些後果,但文章的大部分篇幅,都会集中在支撐這一判斷的證據上。至於更深層的影響,Clark 計劃在今年的大部分時間裡繼續梳理。

從時間點來看,Clark 並不認為這件事會在 2026 年真正發生。但他認為,未來一兩年內,我們可能會看到某種模型端到端訓練出自己後繼者的案例。至少在非前沿模型層面,出現一個概念驗證是很有可能的;至於最前沿模型,難度會更高,因為它們成本極其昂貴,也依賴大量人類研究員的高強度工作。

Clark 的判斷主要來自公開信息:包括 arXiv、bioRxiv 和 NBER 上的論文,以及前沿 AI 公司已經部署到現實世界中的產品。基於這些信息,他得出一個結論:自動化生產當下 AI 系統所需的各個環節,尤其是 AI 開發中的工程組件,基本已經具備。

如果 scaling 趨勢繼續延續,我們就應該開始準備面對這樣一種情況:模型會變得足夠有創造力,不僅能自動改進已知方法,還可能在提出全新研究方向和原創想法方面取代人類研究員,從而自行推動 AI 前沿繼續向前發展。

編碼奇點:能力隨時間的變化

AI 系統是通過軟體實現的,而軟體由程式碼構成。

AI 系統已經徹底改變了程式碼生產方式。這背後有兩個相關趨勢:一方面,AI 系統越來越擅長編寫複雜的真實世界程式碼;另一方面,AI 系統也越來越擅長在幾乎不依賴人類監督的情況下,把許多線性的編碼任務串聯起來完成,比如先寫程式,再進行測試。

體現這一趨勢的兩個典型例子,是 SWE-Bench 和 METR time horizons plot。

解決真實世界的軟體工程問題

SWE-Bench 是一個被廣泛使用的程式設計測試,用來評估 AI 系統解決真實 GitHub issue 的能力。

當 SWE-Bench 在 2023 年底推出時,當時表現最好的模型是 Claude 2,整體成功率大約只有 2%。而 Claude Mythos Preview 的成績已經達到 93.9%,基本上接近打滿這個 benchmark。

當然,所有 benchmark 本身都會有一定噪聲,所以通常會出現這樣一個階段:當分數高到某個程度之後,你碰到的可能不再是方法本身的限制,而是 benchmark 自身的限制。比如在 ImageNet 驗證集中,大約 6% 的標籤就是錯誤或存在歧義的。

SWE-Bench 可以被視為衡量通用程式設計能力,以及 AI 對軟體工程影響的一個可靠指標。Clark 表示,他在前沿 AI 實驗室和矽谷接觸到的大多數人,現在幾乎都已經完全通過 AI 系統來寫程式,並且越來越多的人開始用 AI 系統來編寫測試、檢查程式碼。

換句話說,AI 系統已經足夠強,能夠自動化 AI 研發中的一個重要組成部分,並顯著加速所有參與 AI 研發的人類研究員和工程師。

衡量 AI 系統完成長時任務的能力

METR 製作了一張圖,用來衡量 AI 能完成多複雜的任務。這裡的複雜度,是按照一個熟練人類完成這些任務大概需要多少小時來計算的。

其中最關鍵的指標,是 AI 系統在一組任務上達到 50% 可靠性時,對應的大致任務時間跨度。

在這一點上,進展非常驚人:

· 2022 年,GPT-3.5 能完成的任務,大概相當於人類需要 30 秒完成的任務。

· 2023 年,GPT-4 把這個時間提升到了 4 分鐘。

· 2024 年,o1 把這個時間提升到了 40 分鐘。

· 2025 年,GPT-5.2 High 達到了大約 6 小時。

· 到 2026 年,Opus 4.6 已經把這個時間進一步推高到大約 12 小時。

在 METR 工作、長期關注 AI 預測的 Ajeya Cotra 認為,到 2026 年底,AI 系統能夠完成相當於人類需要 100 小時的任務,並不是一個不合理的預期。

AI 系統能夠獨立工作的時間跨度顯著增長,也和 agentic coding 工具的爆發高度相關。所謂 agentic coding 工具,本質上就是把能替人完成工作的 AI 系統產品化:它們可以代表人類行動,並在相當長一段時間內相對獨立地推進任務。

這也重新指向 AI 研發本身。仔細觀察許多 AI 研究員的日常工作會發現,其中大量任務其實都可以拆解成幾個小時級別的工作,比如清洗資料、讀取資料、啟動實驗等等。

而這類工作,如今已經落入現代 AI 系統能夠覆蓋的時間跨度之內。

AI 系統越熟練,越能獨立於人類工作,就越能幫助自動化 AI 研發中的一部分工作。

任務委託的關鍵因素主要有兩個:

· 一是你對被委託者能力的信心;

· 二是你相信對方能夠在不依賴你持續監督的情況下,按照你的意圖獨立完成工作。

當用戶在觀察 AI 在程式設計方面的能力時,會發現 AI 系統不僅變得越來越熟練,也越來越能在不需要人類重新校準的情況下,獨立工作更長時間。

這也和我們身邊正在發生的事情相吻合,工程師和研究員正在把越來越大塊的工作交給 AI 系統完成。隨著 AI 能力持續提升,被委託給 AI 的工作也變得越來越複雜、越來越重要。

AI 正在掌握 AI 研發所必需的核心科學技能

想想現代科學研究是怎麼進行的,其中很大一部分工作,其實就是先確定一個方向,明確自己想獲得哪類經驗性信息;然後設計並運行實驗,生成這些信息;最後再對實驗結果進行合理性檢查。

隨著 AI 編程能力不斷提升,再加上大語言模型越來越強的世界建模能力,如今已經出現了一批工具,能夠幫助人類科學家提速,並在更廣泛的研發場景中部分自動化某些環節。

在這裡,我們可以觀察 AI 在幾項關鍵科學技能上的進展速度,而這些能力本身也正是 AI 研究不可或缺的一部分:

· 一是復現研究結果;

· 二是把機器學習技術和其他方法串聯起來,用來解決技術問題;

· 三是優化 AI 系統自身。

實現整篇科學論文,並完成相關實驗

AI 研究中的一項核心工作,是閱讀科學論文,並復現其中的結果。在這方面,AI 已經在一系列 benchmark 上取得了顯著進展。

一個很好的例子是 CORE-Bench,也就是 Computational Reproducibility Agent Benchmark。

這個 benchmark 要求 AI 系統在給定一篇論文及其程式碼倉庫的情況下,復現論文中的結果。具體來說,Agent 需要安裝相關庫、軟體包和依賴,運行程式碼;如果程式碼成功運行,它還需要搜索所有輸出結果,並回答任務中的問題。

CORE-Bench 於 2024 年 9 月提出。當時表現最好的系統,是運行在 CORE-Agent scaffold 中的 GPT-4o 模型。在該 benchmark 最困難的一組任務上,它的得分約為 21.5%。

而到了 2025 年 12 月,CORE-Bench 的一位作者宣布,這個 benchmark 已經被解決了:Opus 4.5 模型取得了 95.5% 的成績。

構建完整的機器學習系統,解決 Kaggle 競賽問題

MLE-Bench 是 OpenAI 構建的一個 benchmark,用來測試 AI 系統在離線環境中參加 Kaggle 競賽的能力。

它覆蓋了 75 個不同類型的 Kaggle 競賽,涉及多個領域,包括自然語言處理、計算機視覺和信號處理等。

MLE-Bench 於 2024 年 10 月發布。發布時,表現最好的系統是一個運行在 agent scaffold 中的 o1 模型,得分為 16.9%。

截至 2026 年 2 月,表現最好的系統已經變成了運行在帶搜索能力的 agent harness 中的 Gemini 3,得分達到 64.4%。

Kernel 設計

AI 開發中一項更難的任務是 kernel 優化。所謂 kernel 優化,就是編寫並改進底層程式碼,把矩陣乘法這類特定運算更高效地映射到底層硬體上。

Kernel 優化之所以是 AI 開發的核心,是因為它決定了訓練和推理的效率:一方面,它影響你在開發 AI 系統時,究竟能有效利用多少算力;另一方面,當模型訓練完成後,它也決定你能多高效地把算力轉化為推理能力。

近年來,用 AI 做 kernel 設計,已經從一個有趣的小方向,變成了一個競爭激烈的研究領域,並且出現了多個 benchmark。不過,這些 benchmark 目前還沒有特別流行,所以我們很難像其他領域那樣清晰地建模它的長期進展。另一方面,我們可以通過一些正在進行的研究,感受這個方向的推進速度。

相關工作包括:

· 用 DeepSeek 的模型嘗試構建更好的 GPU kernel;

· 自動把 PyTorch 模組轉換成 CUDA 程式碼;

· Meta 用 LLM 自動生成優化後的 Triton kernel,並部署到自己的基礎設施中;

· 以及針對 GPU kernel 設計微調開源權重模型,例如 Cuda Agent。

**這裡需要補充一點:**kernel 設計確實具備一些特別適合 AI 驅動研發的屬性,比如結果容易驗證、獎勵信號比較明確。

透過 PostTrainBench 微調語言模型

這類測試的一個更困難版本是 PostTrainBench。它測試的是,不同前沿模型能否接手較小的開源權重模型,並通過微調提升它們在某些 benchmark 上的表現。

**這個 benchmark 的一個優點是,它有非常強的人類基線:**這些小模型現有的 instruct-tuned 版本。這些版本通常由前沿實驗室中優秀的人類 AI 研究員開發,已經經過非常有能力的研究員和工程師打磨,並被部署到真實世界中。因此,它們構成了一個很難超越的人類基準。

截至 2026 年 3 月,AI 系統已經能夠對模型進行後訓練,並獲得大約相當於人類訓練結果一半的性能提升。

**具體評估分數來自一個加權平均:**它會綜合多個後訓練的大語言模型,包括 Qwen 3 1.7B、Qwen 3 4B、SmolLM3-3B、Gemma 3 4B,以及多個 benchmark,包括 AIME 2025、Arena Hard、BFCL、GPQA Main、GSM8K、HealthBench、HumanEval。

在每次運行中,評測方會要求一個 CLI agent,盡可能提升某個特定基礎模型在某個特定 benchmark 上的表現。

截至 2026 年 4 月,得分最高的 AI 系統大約能達到 25% 到 28%,代表模型包括 Opus 4.6 和 GPT 5.4;相比之下,人類得分為 51%。

這已經是一個相當有意義的結果。

優化語言模型訓練

過去一年,Anthropic 一直在報告其系統在一項 LLM 訓練任務上的表現。這個任務要求模型優化一個僅使用 CPU 的小型語言模型訓練實現,讓它盡可能快地運行。

**評分方式是:**相較於未修改的初始程式碼,模型實現的平均加速倍數。

這項結果進展非常顯著:

· 2025 年 5 月,Claude Opus 4 實現了 2.9 倍平均加速;

· 2025 年 11 月,Opus 4.5 提升到 16.5 倍;

· 2026 年 2 月,Opus 4.6 達到 30 倍;

· 2026 年 4 月,Claude Mythos Preview 達到 52 倍。

為了理解這些數字的含義,可以做一個參照:在人類研究員身上,這項任務通常需要 4 到 8 小時工作,才能實現 4 倍加速。

元技能:管理

AI 系統也正在學習如何管理其他 AI 系統。

這一點已經可以在一些廣泛部署的產品中看到,比如 Claude Code 或 OpenCode。在這些產品裡,一個主 agent 可以監督多個 sub-agent。

這讓 AI 系統能夠處理更大規模的專案:專案中可能需要多個具備不同專長的智能體並行工作,而它們通常由一個單一的 AI 管理者來協調。這裡的管理者本身也是一個 AI 系統。

AI 研究更像發現廣義相對論,還是搭樂高?

一個關鍵問題是:AI 能否發明出新的想法,幫助它改進自身?還是說,這些系統更適合完成研究中那些不那麼光鮮、但必須一磚一瓦推進的工作?

這個問題很重要,因為它關係到 AI 系統能在多大程度上端到端自動化 AI 研究本身。

作者的判斷是:AI 目前還不能提出真正激進的全新思想。但要實現自身研發自動化,它或許並不一定需要做到這一點。

作為一個領域,AI 的進步很大程度上依賴於越來越大的實驗,以及越來越多的輸入,比如資料和算力。

偶爾,人類會提出一些改變範式的想法,使整個領域的資源效率大幅提升。Transformer 架構就是一個很好的例子,混合專家模型,也就是 mixture-of-experts,也是另一個例子。

但更多時候,AI 領域的推進方式其實更樸素:人類會拿一個表現良好的系統,擴大其中某個方面,比如訓練資料和算力;觀察擴大規模後哪裡出問題;找到工程上的修復方案,讓系統能夠繼續擴展;然後再次擴大規模。

這個過程裡,真正需要洞見的部分其實很少。大量工作更像是不那麼耀眼、但非常扎實的基礎工程。

類似地,很多 AI 研究其實是在運行現有實驗的各種變體,探索不同參數設置會帶來什麼結果。研究直覺當然能幫助人類挑選最值得嘗試的參數,但這件事本身也可以被自動化,讓 AI 自己判斷哪些參數值得調整。早期的神經架構搜尋,就是這類思路的一個版本。

愛迪生曾說:天才是 1% 的靈感,加上 99% 的汗水。即便過去 150 年,這句話依然很貼切。

偶爾,確實會出現徹底改變一個領域的新洞見。但大多數時候,領域進步是靠人類在改進和調試各種系統的艱苦過程中,一點點推進出來的。

而前面提到的公開資料表明,AI 已經非常擅長執行 AI 開發中許多必要的苦活累活。

與此同時,還有一個更大的趨勢:基礎能力,比如程式設計能力,正在和不斷擴展的任務時間跨度結合起來。這意味著 AI 系統可以把越來越多這類任務串聯起來,形成複雜的工作序列。

因此,即便 AI 系統目前相對缺乏創造力,也有理由相信,它們仍然能夠推動自身繼續向前發展。只是相比能產生全新洞見的情況,這種推進速度可能會更慢。

但如果繼續觀察公開資料,會發現另一個令人好奇的信號:AI 系統也許正在展現出某種創造力,而這種創造力可能讓它們以更令人驚訝的方式推動自身進步。

推動科學前沿繼續向前

目前已經有一些非常初步的跡象表明,通用 AI 系統有能力推動人類科學前沿繼續向前發展。不過到目前為止,這種情況只發生在少數幾個領域,主要是計算機科學和數學。而且很多時候,並不是 AI 系統單獨完成突破,而是以人機協作的方式,與人類研究者共同推進。

儘管如此,這些趨勢仍值得觀察:

Erdős 問題:一組數學家與 Gemini 模型合作,測試它在解決一些 Erdős 數學問題上的表現。他們引導系統嘗試了大約 700 個問題,最終得到了 13 個解答。在這些解答中,有 1 個被他們認為是有趣的。

研究者寫道,他們初步認為,Aletheia(一套基於 Gemini 3 Deep Think 的 AI 系統)對 Erdős-1051 的解答,代表了一個早期案例:一個 AI 系統自主解決了一個略具非平凡性、並且有一定更廣泛數學興趣的開放 Erdős 問題。該問題此前已有一些 closely-related 的相關研究文獻。

如果往樂觀方向理解,這些案例可以被看作一個信號:AI 系統正在發展出某種能夠推動領域前沿的創造性直覺,而這種直覺過去主要屬於人類。

但也可以從另一面解釋:數學和計算機科學可能本身就是特別適合 AI 驅動發明的領域,因此它們或許只是例外,並不能代表更廣泛的科學研究都會被 AI 以同樣方式推進。

另一個類似例子是 AlphaGo 的第 37 手。不過 Clark 認為,距離 AlphaGo 那次結果已經過去十年,而第 37 手之後並沒有被某個更現代、更驚人的洞見所取代,這本身也可以被視為一個略偏悲觀的信號。

AI 已經可以自動化 AI 工程中的大片工作

如果把上面所有證據放在一起,我們可以看到這樣一幅圖景:

· AI 系統已經能夠為幾乎任何程式碼撰寫,並且這些系統已經可以被信任去獨立完成一些任務;這些任務如果交給人類,往往需要數十小時的高強度專注勞動。

· AI 系統越來越擅長完成 AI 開發中的核心任務,從模型微調到 kernel 設計,都在被逐步覆蓋。

· AI 系統已經能夠管理其他 AI 系統,實際形成一種合成團隊:多個 AI 可以分頭處理複雜問題,其中一些 AI 扮演負責人、批評者、編輯者的角色,另一些 AI 則扮演工程師的角色。

· AI 系統有時已經能在困難的工程和科學任務上超越人類,儘管目前還很難判斷,這究竟是因為它們具備了真正的創造力,還是因為它們已經熟練掌握了大量模式化知識。

在 Clark 看來,這些證據已經非常有說服力地表明:今天的 AI 已經可以自動化 AI 工程中的大片工作,甚至可能覆蓋其中的全部環節。

不過,目前還不清楚 AI 能在多大程度上自動化 AI 研究本身。因為研究中的某些部分,可能不同於純工程技能,仍然依賴更高層次的判斷、問題意識和創造性。

但無論如何,一個清晰信號已經出現:今天的 AI 正在大幅加速從事 AI 開發的人類,讓這些研究員和工程師可以通過與無數合成同事配對協作,放大自己的工作能力。

最後,AI 行業本身也幾乎是在明說:自動化 AI 研發就是它們的目標。

OpenAI 希望在 2026 年 9 月之前構建一個自動化 AI 研究實習生。Anthropic 正在發表關於構建自動化 AI 對齊研究員的工作。DeepMind 在三大實驗室中顯得最謹慎,但也表示,在可行時應該推進對齊研究自動化。

自動化 AI 研發也已經成為許多創業公司的目標。Recursive Superintelligence 剛剛融資 5 億美元,目標就是自動化 AI 研究。

換句話說,數千億美元級別的既有資本和新增資本,正在投入到一批以自動化 AI 研發為目標的機構中。

因此,我們當然應該預期,這個方向至少會取得某種程度的進展。

為什麼這很重要

這帶來的影響深遠,但在大眾媒體對 AI 研發的報導中卻鮮少討論。以下這幾個方面可以反映出 AI 研發帶來的巨大挑戰。

- 我們必須把對齊做好:如今有效的對齊技術可能會在遞歸式自我改進中失效,因為 AI 系統會變得比監督它們的人員或系統智能得多。這是一個已被廣泛研究的領域,所以他只簡要概述一些問題:

· 訓練人工智慧系統不說謊和作弊是一個出人意料的微妙過程(例如,儘管努力為環境構建良好的測試,但有時人工智慧解決問題的最佳方法是作弊,從而教會它作弊是可行的)。

· AI 系統可能通過「假裝對齊」來欺騙我們,輸出讓我們以為它表現良好的分數,但實際上隱藏了它真實的意圖。(一般來說,AI 系統已經能夠察覺自己何時正在被測試。)

· 隨著 AI 系統開始更多地參與自身訓練的基礎研究議程,我們可能會大幅改變 AI 系統的整體訓練方式,卻沒有良好的直覺或理論基礎來理解這意味著什麼。

· 當你把某個系統置於遞歸循環中時,會產生非常基本的「誤差累積」問題,這可能會影響上述所有問題及其他問題:除非你的對齊方法「100% 準確」且理論上能在更聰明的系統中持續保持準確,否則事情可能很快出錯。例如,你的技術初始精度是 99.9%,經過 50 代可能降為 95.12%,經過 500 代可能降到 60.5%。

- AI 涉及的每一件事都會獲得巨大的生產力倍增:就像 AI 顯著提高軟體工程師的生產力一樣,我們應該預期 AI 涉及的其他領域也會如此。這帶來幾個需要應對的問題:

· 資源獲取不平等:假設 AI 的需求繼續超過計算資源供應,我們必須決定如何分配 AI 以實現社會的最大利益。我對市場激勵能夠保證我們從有限的 AI 計算中獲得最佳社會收益持懷疑態度。確定如何分配 AI 研發帶來的加速能力將是一個政治性很強的問題。

· 經濟的「阿姆達爾定律」:隨著 AI 流入經濟,我們會發現某些環節在面對高速增長時會出現瓶頸,需要想辦法修復這些鏈條中的薄弱環節。這在需要協調快速數位世界與緩慢物理世界的領域可能尤為明顯,比如新藥臨床試驗。

- 資本密集型、人力輕型經濟的形成:上述所有關於 AI 研發的證據也表明,AI 系統越來越有能力自主運營企業。

這意味著我們可以預期,經濟中的一部分將被新一代公司佔據,這些公司可能是資本密集型(因為它們擁有大量計算機),或運營開支密集型(因為它們在 AI 服務上花費大量資金並在其基礎上創造價值),比起今天的企業,它們對人力的依賴相對較低——因為隨著 AI 系統能力持續增強,投入 AI 的邊際價值會不斷增長。

事實上,這將表現為「機器經濟」在更大「人類經濟」中逐漸形成,隨著時間推移,AI 運營的公司可能會開始相互交易,從而改變經濟結構,並引發關於不平等和再分配的各種問題。最終,可能會出現完全由 AI 系統自主運營的公司,這將加劇上述問題,同時帶來許多新的治理挑戰。

凝視黑洞

基於以上分析,作者認為到 2028 年底,我們看到自動化 AI 研發(即前沿模型能夠自主訓練其繼任版本)的概率約為 60%。為什麼不預期它在 2027 年出現?

原因是作者認為 AI 研究仍然需要創造力和異議見解才能前進,到目前為止,AI 系統尚未以變革性和重大方式展現這一點(儘管在加速數學研究上的一些結果有啟示)。

如果非要他給出 2027 年的概率,他會說 30%。

如果到 2028 年底還沒有出現,我們可能就會揭示當前技術範式中的一些根本性缺陷,需要人類發明推動進一步發展。

原文鏈接

點擊了解律動BlockBeats 在招