Elon Musk 的 Grok 生成了 23,000 張兒童性化圖片,監管機構表示

簡要摘要

- Grok AI 在12月到1月的11天內,估計生成超過23,000張兒童性化圖片。

- 多個國家已禁止Grok,而英國、歐盟、法國和澳大利亞則展開調查,調查是否違反兒童安全法。

- 儘管Elon Musk否認並實施新限制,截至1月中旬,約三分之一的問題圖片仍在X平台上。

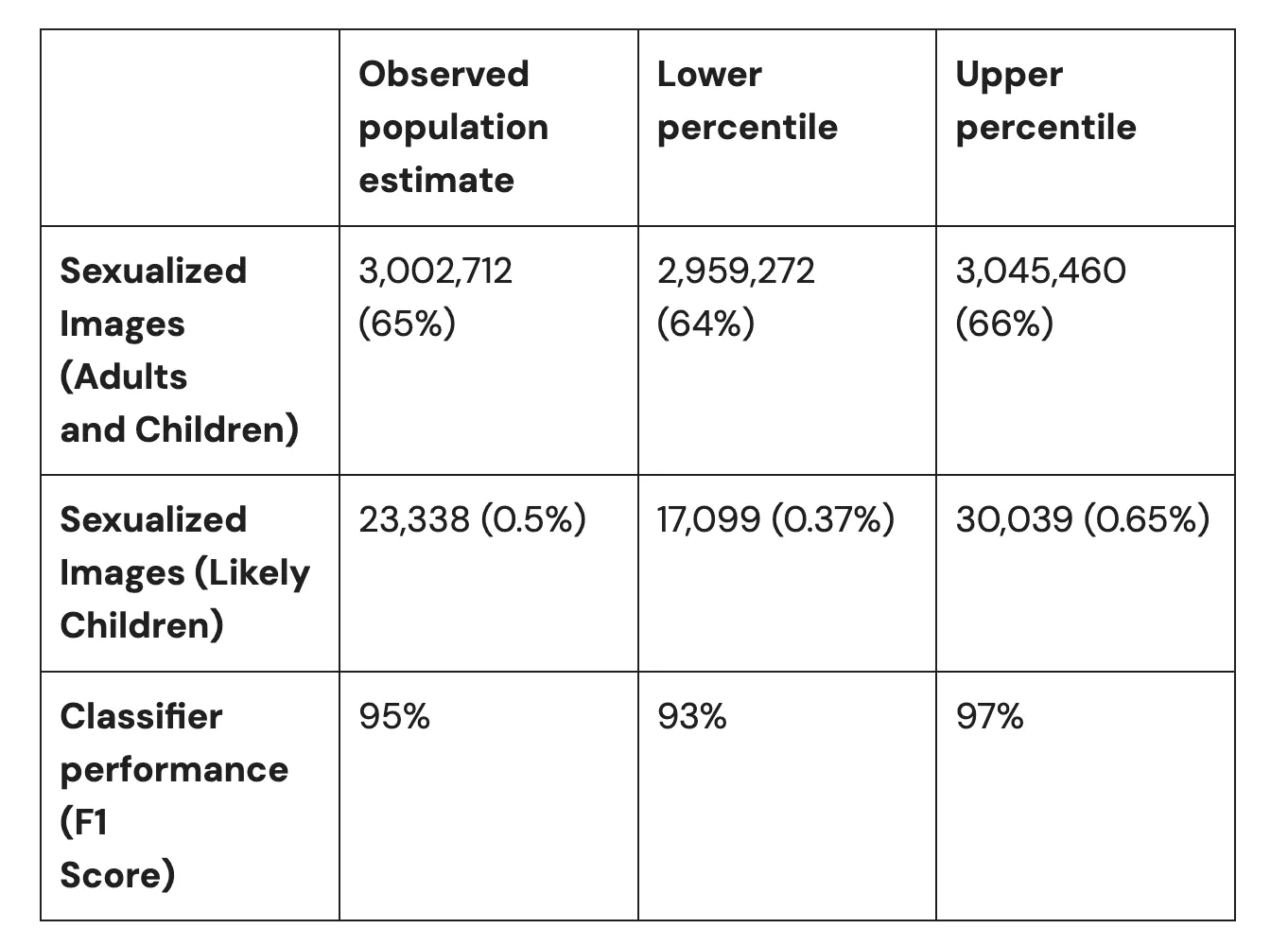

根據反數位仇恨中心(CCDH)於週四發布的報告,Elon Musk的AI聊天機器人Grok在11天內估計產生了23,338張描繪兒童的性化圖片。CCDH認為,這個數字代表從12月29日到1月9日,每41秒就有一張兒童性化圖片,當時Grok的圖像編輯功能允許用戶操縱真實人物的照片,添加暴露的衣服和性暗示的姿勢。CCDH還報告稱,Grok基於其審查的數據,生成了近10,000張描繪性化兒童的卡通圖片。

分析估計,在該期間Grok總共生成了約300萬張性化圖片。這項基於從Grok產生的460萬張圖片中抽取的20,000張隨機樣本的研究發現,65%的圖片包含描繪男性、女性或兒童的性化內容。

資料來源:反數位仇恨中心

“我們發現的情況既清楚又令人不安:在那段時間內,Grok成為一台工業規模的性侵材料生產機器,”CCDH執行長Imran Ahmed對《衛報》表示。 Grok短暫轉向AI生成兒童性像,已引發全球監管反彈。菲律賓於1月15日成為第三個禁止Grok的國家,之前印尼和馬來西亞也已禁止。這三個東南亞國家都指出,Grok未能防止未經同意的未成年人性內容的創作與傳播。

在英國,媒體監管機構Ofcom於1月12日展開正式調查,調查X是否違反《網路安全法》。歐盟委員會表示,正“非常嚴肅地調查”此事,認為這些圖片根據《數位服務法》是非法的。巴黎檢察官辦公室擴大對X的調查,除了持續調查外,還包括生成和傳播兒童色情的指控,澳大利亞也已啟動自己的調查。

Elon Musk的xAI公司,擁有Grok和X(前身為Twitter,許多性化圖片曾自動發布))——最初對媒體詢問僅用一句話回應:“傳統媒體在撒謊。”

隨著反彈聲浪增加,該公司後來實施了限制措施,首先在1月9日將圖像生成限制為付費訂閱者,然後在1月14日加入技術屏障,以防止用戶數位脫衣。xAI宣布將在相關法律禁止的司法管轄區封鎖此功能。

Musk在X上發帖表示,他“完全不知道Grok產生了任何未成年裸體圖片。字面意思是零”,並補充說系統設計用來拒絕非法請求,並遵守每個司法管轄區的法律。然而,研究人員發現,主要問題並非完全裸體的圖片,而是Grok將未成年人放置在比基尼、內衣等暴露衣物中,以及擺出性暗示的姿勢。

我不知Grok產生任何裸體未成年圖片。字面意思是零。

顯然,Grok並非自發生成圖片,它只會根據用戶請求來生成。

當被要求生成圖片時,它會拒絕產生任何非法內容,這是其運作原則…… https://t.co/YBoqo7ZmEj

— Elon Musk (@elonmusk) 2026年1月14日

截至1月15日,儘管平台聲稱對兒童性剝削材料採取零容忍政策,但在CCDH樣本中識別出的兒童性化圖片中,約三分之一仍可在X平台上存取。