Anthropic kiện ra tòa! Buộc tội chính phủ Trump trả đũa cấm Claude, 37 nhà nghiên cứu AI ủng hộ

Anthropic kiện chính phủ liên bang phản đối bị liệt vào danh sách rủi ro chuỗi cung ứng và bị cấm sử dụng Claude trong vòng 6 tháng, tranh cãi về mục đích quân sự của AI và quản lý an toàn ngày càng gia tăng.

Bị liệt vào “rủi ro chuỗi cung ứng”, Anthropic kiện chính phủ liên bang

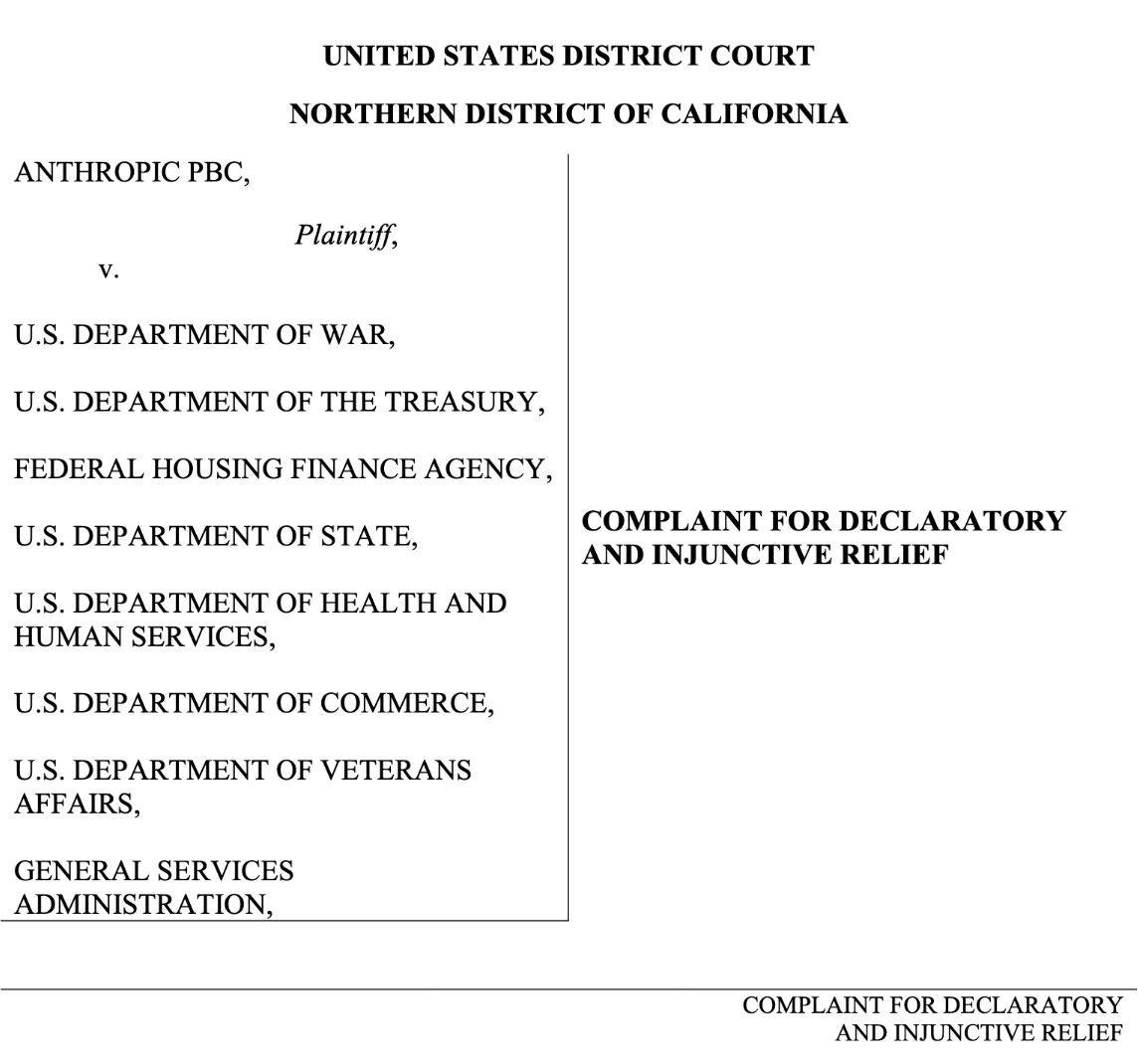

Công ty trí tuệ nhân tạo Anthropic gần đây đã đệ đơn kiện lên Tòa án Liên bang Hoa Kỳ, cáo buộc chính phủ của Tổng thống Trump đã liệt họ vào danh sách “rủi ro chuỗi cung ứng” (supply chain risk), và yêu cầu các cơ quan liên bang ngừng sử dụng hệ thống AI của họ. Công ty cho rằng biện pháp này mang tính trả đũa và đàn áp. Đơn kiện đã được gửi tới Tòa án Liên bang khu vực phía Bắc California.

Trong đơn kiện, Anthropic chỉ ra rằng hành động của chính phủ thiếu căn cứ pháp lý, gây ảnh hưởng nghiêm trọng đến hoạt động và quan hệ hợp tác của công ty. Các tài liệu kiện tụng liệt kê nhiều cơ quan và quan chức chính phủ làm bị đơn, bao gồm Bộ Quốc phòng Hoa Kỳ, Bộ trưởng Quốc phòng Pete Hegseth, Bộ trưởng Tài chính Scott Bessent, Ngoại trưởng Marco Rubio, và Bộ Thương mại Howard Lutnick.

Nguồn hình ảnh: Anthropic Anthropic kiện chính phủ liên bang Hoa Kỳ, cáo buộc chính phủ của Tổng thống Trump đã liệt họ vào danh sách “rủi ro chuỗi cung ứng”, và yêu cầu các cơ quan liên bang ngừng sử dụng hệ thống AI của họ

Thẻ “rủi ro chuỗi cung ứng” thường được dùng để chỉ các doanh nghiệp công nghệ liên quan đến quốc gia đối địch, ví dụ như các nhà cung cấp có thể chứa phần mềm gián điệp hoặc phần mềm độc hại. Anthropic cho biết, việc đưa một công ty AI của Mỹ vào danh sách này sẽ gây ảnh hưởng rõ rệt đến uy tín và các mối quan hệ thương mại của họ. Anthropic khẳng định, công ty đang tìm kiếm sự rõ ràng qua pháp lý để xác minh tính hợp pháp của hành động của chính phủ, đồng thời bảo vệ lợi ích của doanh nghiệp, khách hàng và đối tác.

Tranh cãi về mục đích quân sự của AI, đàm phán hợp đồng quốc phòng đổ vỡ

Nguyên nhân chính của cuộc tranh chấp này bắt nguồn từ sự bất đồng giữa Anthropic và Bộ Quốc phòng Hoa Kỳ về cách sử dụng công nghệ AI. Trước đó, Anthropic đã đàm phán một hợp đồng AI trị giá khoảng 200 triệu USD với Bộ Quốc phòng. Trong quá trình đàm phán, Bộ yêu cầu hệ thống AI phải có thể sử dụng trong mọi mục đích hợp pháp, bao gồm cả mục đích quân sự. Anthropic kiên quyết giữ lại hai giới hạn an toàn:

- Cấm hệ thống Claude của họ dùng để giám sát quy mô lớn người dân Mỹ;

- Cấm sử dụng trong các hệ thống vũ khí chết người hoàn toàn tự động.

Công ty cho rằng, những giới hạn này là nguyên tắc quan trọng trong quản lý an toàn AI. Hai bên không thể đạt được thỏa thuận chung. Tháng 2 năm 2026, chính phủ Hoa Kỳ đã liệt Anthropic vào danh sách “rủi ro chuỗi cung ứng” và yêu cầu các cơ quan liên bang ngừng sử dụng hệ thống Claude trong vòng 6 tháng.

Trong đơn kiện, Anthropic chỉ ra rằng chính phủ đã lợi dụng quyền hành hành pháp để gây sức ép, ép buộc công ty điều chỉnh chính sách an toàn AI. Luật sư của công ty cho biết, Hiến pháp Hoa Kỳ không cho phép chính phủ áp dụng các biện pháp trừng phạt dựa trên quan điểm công khai của doanh nghiệp.

Đọc thêm

An ninh quốc gia V.S đạo đức: Anthropic từ chối loại bỏ các giới hạn an toàn của Claude, đối đầu Bộ Quốc phòng Hoa Kỳ

Hỗ trợ từ giới công nghệ, 37 nhà nghiên cứu AI gửi ý kiến tới tòa

Cuộc xung đột giữa Anthropic và chính phủ nhanh chóng gây tranh luận trong ngành công nghệ. Ngay sau khi đơn kiện được nộp, 37 nhà nghiên cứu AI từ các công ty như OpenAI và Google đã gửi ý kiến tới tòa, thể hiện sự ủng hộ đối với Anthropic. Các nhà nghiên cứu này cho rằng, nếu chính phủ dùng lý do an ninh quốc gia để trừng phạt các doanh nghiệp vì bất đồng về chính sách an toàn AI, điều này có thể làm giảm sức cạnh tranh của Mỹ trong ngành công nghiệp trí tuệ nhân tạo.

Trong ý kiến, họ nhấn mạnh rằng, nếu chính phủ dựa vào lý do an ninh quốc gia để đàn áp các doanh nghiệp AI, sẽ gây ảnh hưởng lâu dài đến môi trường nghiên cứu và phát triển công nghệ. Một số học giả cũng lưu ý rằng, “rủi ro chuỗi cung ứng” thường liên quan đến các tình huống có liên quan đến mối đe dọa an ninh phần mềm của nước ngoài. Trường hợp của Anthropic không thuộc loại rủi ro này.

Giám đốc điều hành công ty trí tuệ nhân tạo SingularityNET, Ben Goertzel, cho biết việc từ chối cho phép AI dùng trong giám sát quy mô lớn hoặc vũ khí tự sát không hoàn toàn là mối đe dọa an ninh. Nếu quân đội cần những mục đích này, họ có thể chọn các hệ thống AI khác.

Nguồn hình ảnh: DigFin Giám đốc điều hành công ty trí tuệ nhân tạo SingularityNET, Ben Goertzel

Xung đột giữa chính phủ và ngành công nghệ ngày càng leo thang, tranh cãi về chính sách AI mở rộng

Trước phản ứng của vụ kiện, Nhà Trắng đã nhanh chóng lên tiếng, khẳng định chính phủ sẽ không để các doanh nghiệp hạn chế quân đội Mỹ sử dụng các công nghệ quan trọng. Người phát ngôn Nhà Trắng nhấn mạnh, chính phủ Hoa Kỳ cần đảm bảo quân đội có thể sử dụng các công nghệ cần thiết trong phạm vi hợp pháp để duy trì an ninh quốc gia.

Vụ tranh chấp này cũng kéo theo các vấn đề chính sách công nghệ rộng lớn hơn. Chính quyền Trump trước đó đã nới lỏng hạn chế xuất khẩu chip AI sang Trung Quốc, đồng thời chỉ trích lập trường chính trị của một số doanh nghiệp công nghệ, làm căng thẳng thêm mối quan hệ giữa Silicon Valley và Washington.

Anthropic cho biết, sau khi bị liệt vào danh sách đen, một số doanh nghiệp hợp tác với Bộ Quốc phòng có thể phải chứng minh hệ thống của họ không sử dụng Claude. Yêu cầu này có thể gây ra ảnh hưởng dây chuyền đến các hợp tác thương mại của công ty.

Một số tập đoàn công nghệ lớn vẫn tỏ thái độ ủng hộ Anthropic. Google cho biết sẽ tiếp tục cung cấp công nghệ AI của Anthropic cho khách hàng đám mây, nhưng không liên quan đến mục đích quốc phòng. Microsoft và Amazon cũng khẳng định sẽ tiếp tục hợp tác trong lĩnh vực thương mại và các dự án của họ.

Anthropic đã đệ đơn yêu cầu tòa án tuyên hành động của chính phủ là trái pháp luật, và ngăn chặn việc thực thi “danh sách rủi ro chuỗi cung ứng”. Sau khi vụ kiện bước vào quá trình xét xử, các cuộc tranh luận về quản lý an toàn AI, an ninh quốc gia và quyền tự chủ của doanh nghiệp cũng ngày càng mở rộng.

Đọc thêm

Hợp tác OpenAI với quân đội Mỹ gây ra làn sóng phản đối! Tải ứng dụng Claude vượt mặt, hiểu rõ các tranh cãi đạo đức và chính trị phía sau

Wall Street Journal: Sau lệnh cấm của Trump đối với Anthropic, Mỹ và Israel vẫn dựa vào Claude để tấn công Iran