72 години, потрійна криза: душа Anthropic виставляється на аукціон

Написано: Ada, Deep Tide TechFlow

24 лютого, вівторок. Вашингтон, Пентагон.

Генеральний директор Anthropic Dario Amodei сидить напроти міністра оборони Піта Хегсета. За даними NPR і CNN, посиланням на джерела, атмосфера зустрічі була «ввічливою», але зміст зовсім не був м’яким.

Хегсет висунув йому ультиматум: до п’ятниці, 17:01, зняти обмеження на військове застосування Claude, дозволивши Пентагону використовувати його «для всіх законних цілей», включаючи автономне прицілювання зброї та внутрішній масовий моніторинг.

Інакше — скасувати контракт на 200 мільйонів доларів. Запровадити «Закон про виробництво оборони», примусове вилучення. Включити Anthropic до «ризиків ланцюга постачання», що фактично означає внесення до чорного списку ворожих структур Росії та Китаю.

В той самий день Anthropic опублікувала третю версію «Політики відповідального розширення» (RSP 3.0), тихо видаливши найважливішу обіцянку з моменту заснування компанії: якщо не забезпечити безпеку, не тренувати більш потужні моделі.

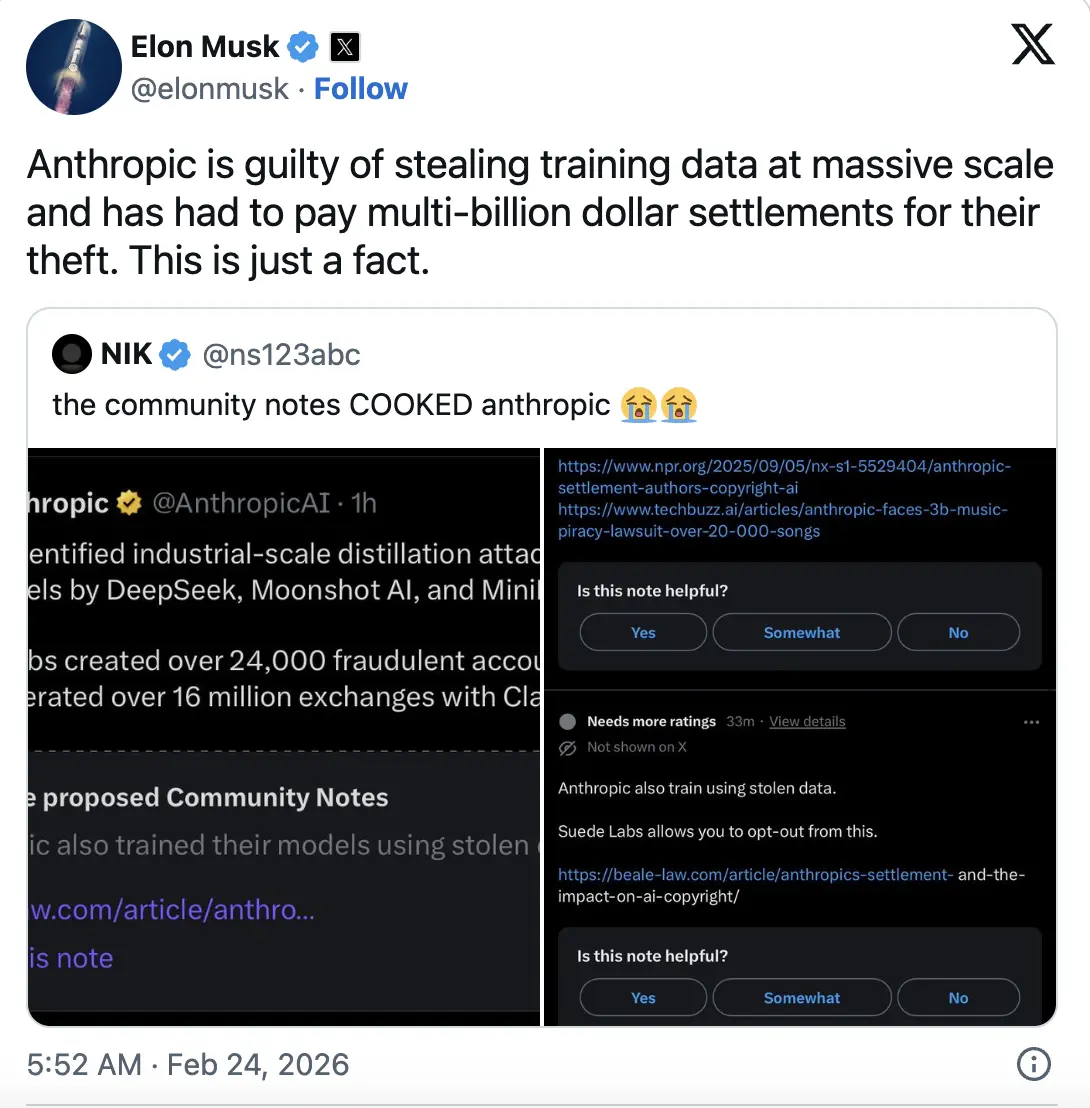

Також у цей день Ілон Маск у X написав: «Anthropic масово краде тренувальні дані — це факт». А спільнота X додала нотатку, що Anthropic заплатили 1,5 мільярда доларів у рамках врегулювання за використання піратських книг для тренування Claude.

За три доби ця компанія, яка називає себе «з душею», одночасно виконувала три ролі: захисника безпеки, крадія інтелектуальної власності, зрадника Пентагону.

Який із них справжній?

Можливо, усі.

Пентагон: «або підкоряєшся, або йди геть»

Перша частина історії дуже проста.

Anthropic — перша компанія з AI, яка отримала доступ до секретної інформації Міноборони США. Контракт минулого літа — максимум 200 мільйонів доларів. Пізніше аналогічні контракти отримали OpenAI, Google, xAI.

За повідомленням Al Jazeera, Claude використовували під час операції американських військ у січні цього року. Йдеться про викрадення президента Венесуели Мадуро.

Але Anthropic виставила дві червоні лінії: не підтримувати повністю автономне прицілювання зброї, не підтримувати масовий моніторинг громадян США. Anthropic вважає, що штучний інтелект недостатньо надійний для керування зброєю, і наразі немає законодавства, яке регулює застосування AI у масштабному контролі.

Пентагон не купує.

Консультант Білого дому з AI Девід Сакс у жовтні минулого року відкрито звинуватив Anthropic у «залякуванні регулюванням та використанні страху».

Конкуренти вже здалися. OpenAI, Google, xAI погодилися дозволити військовим використовувати їх AI «у всіх законних сценаріях». Grok Маска цього тижня отримав дозвіл на доступ до секретних систем.

Anthropic — остання, хто стоїть.

На момент публікації Anthropic у найновішій заяві заявила, що не має наміру поступатися. Але дедлайн у п’ятницю, 17:01, вже близько.

Анонімний колишній співробітник Міноборони і юстиції, який контактує з CNN, висловив здивування: «Як можна одночасно оголосити компанію «ризиком ланцюга постачання» і примусити її працювати на вашу армію?»

Це хороше питання, але для Пентагону воно не має значення. Їх цікавить лише одне — якщо Anthropic не погодиться, застосують примус або відкинуть її.

«Атака дистиляції»: удар у відповідь

23 лютого Anthropic опублікувала гострий блог, у якому звинуватила три китайські AI-компанії у «промисловій дистиляційній атаці» на Claude.

Обвинувачуються DeepSeek, Moonshot AI, MiniMax.

Anthropic стверджує, що вони через 24 тисячі фальшивих акаунтів провели понад 16 мільйонів взаємодій із Claude, цілеспрямовано витягуючи його ключові можливості у сфері логіки, викликів інструментів і програмування.

Компанія вважає цю діяльність загрозою національній безпеці, стверджуючи, що дистильовані моделі «навряд чи збережуть заходи безпеки» і можуть бути використані авторитарними урядами для кібератак, фейкових новин і масового контролю.

Ідея ідеальна, час — ідеальний.

Саме тоді, коли адміністрація Трампа послабила експортний контроль на китайські чіпи, і саме коли Anthropic шукала аргументи для лобіювання обмежень на експорт своїх чіпів.

Але Маск зробив постріл: «Anthropic масово краде тренувальні дані і заплатила за це мільярди доларів у врегулюваннях. Це факт.»

Співзасновник AI-інфраструктурної компанії IO.Net Торі Грін сказав: «Ви тренуєте свою модель на всій мережі, а інші навчаються на ваших публічних API — і це називається “атака дистиляції”?»

Anthropic назвала дистиляцію «атакою», але в AI-індустрії це — звичайна практика. OpenAI використовує її для стиснення GPT-4, Google — для оптимізації Gemini, і навіть Anthropic сама цим займається. Єдина різниця — тепер її піддають дистиляції саме її модель.

За словами професора AI з Наньянського технологічного університету в Сінгапурі Еріка Камбрії, «межа між легальним використанням і зловмисним застосуванням часто є розмитою».

Ще більш іронічно, що Anthropic заплатила 1,5 мільярда доларів у врегулюванні за використання піратських книг для тренування Claude. Вона тренує модель на всій мережі, а потім звинувачує інших у навчанні на її відкритих API. Це не подвійні стандарти — це трійні.

Спершу Anthropic хотіла виступити у ролі жертви, але її швидко зробили обвинуваченою.

Розгортання обіцянки безпеки: RSP 3.0

У той самий день, коли вони конфліктували з Пентагоном і боролися з Кремнієвою долиною, Anthropic опублікувала третю версію «Політики відповідального розширення».

Головний науковець Anthropic Jared Kaplan у інтерв’ю заявив: «Ми вважаємо, що припинення тренування AI-моделей нікому не допоможе. У контексті швидкого розвитку AI односторонні обіцянки… безглузді».

Інакше кажучи, якщо конкуренти не дотримуються правил, то й вони не повинні.

RSP 1.0 і 2.0 базувалися на жорсткій обіцянці: якщо модель перевищує межі безпеки, тренування припиняється. Це зробило Anthropic унікальною у сфері безпеки AI.

Але 3.0 цю обіцянку скасувала.

Замість цього пропонується більш «гнучкий» підхід: розділити заходи безпеки, які може зробити сама Anthropic, і рекомендації щодо безпеки, що вимагають колективних зусиль. Щораз через 3-6 місяців публікувати звіти про ризики, залучаючи зовнішніх експертів.

Звучить відповідально?

Незалежний рецензент із METR Кріс Пейнтер після ознайомлення з попередніми проектами політики сказав: «Це свідчить про те, що Anthropic вважає, що потрібно перейти до “режиму диспансеру”, оскільки методи оцінки та пом’якшення ризиків не встигають за зростанням можливостей. Це більше підтверджує, що суспільство не готове до потенційних катастрофічних ризиків AI».

За повідомленням TIME, компанія витратила майже рік на внутрішнє обговорення цієї зміни, і CEO Amodei разом із радою директорів проголосували одностайно. Офіційна версія — початковий задум політики був спрямований на формування галузевої консолідації, але індустрія не встигла за цим. Адміністрація Трампа дозволила AI розвиватися вільно, навіть намагаючись скасувати регуляції на рівні штатів. Законодавство щодо AI на федеральному рівні — у далекій перспективі. Хоча створення глобальної системи управління у 2023-2024 роках ще здається можливим, минуло вже три роки — і ця можливість, очевидно, закрита.

Анонімний дослідник, що слідкує за регулюванням AI, сказав прямо: «RSP — це найцінніший бренд Anthropic. Видалити обіцянку про припинення тренування — все одно що органічна компанія тихо зняла слово “органічний” з упаковки і сказала, що їхній контроль став більш прозорим».

Оцінка 380 мільярдів: розкол ідентичностей

На початку лютого Anthropic завершила раунд фінансування на 300 мільярдів доларів із оцінкою компанії у 380 мільярдів. Інвестором виступила Amazon. Від заснування компанія заробила 14 мільярдів доларів річного доходу. За три роки цей показник зростав більш ніж у 10 разів щороку.

Одночасно Пентагон погрожує внести її до чорного списку. Маск відкрито звинуватив у крадіжці даних. Внутрішні обіцянки безпеки скасовані. Після відставки керівника з безпеки AI Мрінанка Шарми він написав у X: «Світ у небезпеці».

Протиріччя?

Можливо, протиріччя — це ген Anthropic.

Компанію заснували колишні керівники OpenAI, які боялися, що OpenAI рухається надто швидко у питаннях безпеки. Вони створили свою компанію, щоб швидше будувати потужніші моделі і водночас говорити всьому світу, наскільки ці моделі небезпечні.

Бізнес-модель можна підсумувати так: ми боїмося AI більше за всіх, тому ви маєте платити нам за його створення.

Ця історія працювала у 2023-2024 роках. Безпека AI — головне слово у Вашингтоні, Anthropic — найпопулярніший лобіст.

У 2026 році ситуація змінилася.

«Woke AI» став образливим ярликом, закони штату щодо регулювання AI блокуються Білим домом, а підтримуваний Anthropic закон штату Каліфорнія SB 53 підписаний, але на федеральному рівні — порожнеча.

Безпека Anthropic поступово перетворюється з «конкурентної переваги» у «політичний тягар».

Компанія намагається балансувати між достатньою «безпекою», щоб зберегти репутацію, і достатньою «гнучкістю», щоб не бути відкинутою ринком і урядом. Але терпимість до обох сторін зменшується.

Чи вартує ще безпекова історія?

Якщо звести разом три ці аспекти, картина стане ясною.

Обвинувачення китайських компаній у дистиляції Claude — для посилення лобістських аргументів щодо обмежень на експорт чіпів. Вилучення обіцянки про зупинку тренування — для збереження обмежень на військові технології. Відмова від автономної зброї — щоб зберегти моральний авторитет.

Кожен крок логічний, але між ними — суперечності.

Не можна одночасно говорити, що китайські компанії «дистилюють» вашу модель і це загрожує безпеці, і при цьому скасовувати обіцянки щодо запобігання її неконтрольованості. Якщо модель справді така небезпечна, потрібно бути обережнішим, а не більш радикальним.

Хіба що Anthropic.

У AI-індустрії ідентичність визначається не заявами, а балансом активів і зобов’язань. «Безпека» Anthropic — це, по суті, брендова надбавка.

На початку гонки озброєнь AI ця надбавка коштувала грошей. Інвестори платили за «відповідальний AI», уряди — за «надійний AI», клієнти — за «безпечніший AI».

Але у 2026 році ця надбавка зникає.

Зараз Anthropic стикається не з питанням «чи йти на компроміс», а з питанням «кому першому поступитися». Погодитися з Пентагоном — втратити бренд. Погодитися з конкурентами — втратити обіцянки безпеки. Погодитися з інвесторами — компроміс у обох напрямках.

У п’ятницю, о 17:01, Anthropic дасть відповідь.

Але одне вже точно: компанія, яка колись базувалася на «ми інакші за OpenAI», стає такою, як усі.

Кризу ідентичності часто закінчується її зникненням.