Anthropic звинувачує 3 китайські компанії у AI-навчанні! Користувачі критикують подвійні стандарти: ви також використовуєте захищені авторським правом матеріали

Anthropic звинуватила три китайські компанії з AI DeepSeek, Moonshot AI та Min у використанні дистиляційних методів для копіювання їхніх моделей. Цей крок викликав іронічні зауваження в мережі щодо порушення авторських прав, а також спричинив гостру дискусію в США щодо експорту чіпів та національної безпеки.

Anthropic звинуватила 3 китайські AI-лабораторії у дистиляційному тренуванні, здобутті передових можливостей моделей

Розробник AI-чатботу Claude, компанія Anthropic, офіційно звинуватила три китайські AI-лабораторії DeepSeek, Moonshot AI та MiniMax у тому, що вони створювали понад 24 000 фальшивих акаунтів для доступу до даних та обміну інформацією з моделлю Claude понад 16 мільйонів разів, а також застосовували техніки дистиляції для перенесення основних можливостей Claude до власних моделей.

«Дистиляція» — це поширена техніка тренування AI, яка дозволяє меншій або менш ресурсомісткій моделі оцінювати якість відповідей більшої або більш зрілої моделі, що дозволяє навчити та перенести обчислювальні результати великої моделі до меншої.

Спочатку ця техніка використовувалась у галузі AI для створення легких моделей для клієнтів, але конкуренти також можуть використовувати її для безпосереднього копіювання досліджень інших лабораторій.

Anthropic зазначила, що ці три китайські лабораторії використовували проксі-сервери для обходу виявлення та здійснювали масштабний збір даних щодо найвідмінніших можливостей Claude — таких як агентські розуміння, використання інструментів та програмний код.

Джерело: X Anthropic звинуватила 3 китайські AI у дистиляційному тренуванні, здобутті передових моделей

Користувачі критикують подвійні стандарти, Anthropic стикається з судовими позовами щодо авторських прав

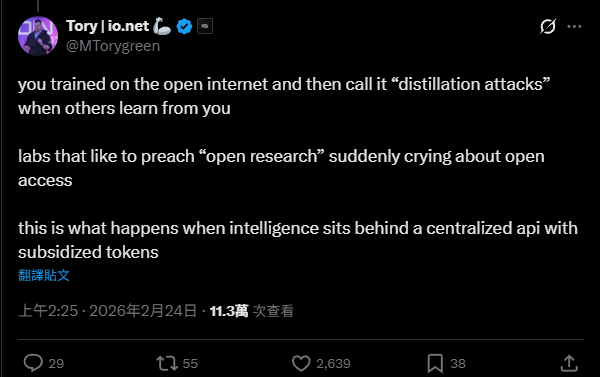

Однак після публікації заяви Anthropic у мережі з’явилися численні саркастичні зауваження та сумніви. Деякі користувачі вважають, що Anthropic застосовує подвійні стандарти щодо методів тренування моделей.

Співзасновник компанії AI-інфраструктури IO.Net Торі Грін написав, що компанії AI використовують відкриті дані для тренування, але називають це «атаками дистиляції», коли інші навчаються у них. Водночас Anthropic, яка раніше активно підтримувала відкриті дослідження, тепер скаржиться на відкритий доступ.

У 2025 році відомий форум Reddit офіційно подає позов проти Anthropic, звинувативши компанію у несанкціонованому зборі понад 100 000 постів та коментарів для доопрацювання моделі Claude. Reddit стверджує, що Anthropic порушила умови користування, і навіть після офіційної зупинки збору даних продовжувала отримувати доступ до серверів Reddit понад 100 000 разів.

Крім того, Anthropic також піддали колективному судовому позову за використання 7 мільйонів книг для тренування моделі Claude, і минулого вересня погодилися виплатити до 1,5 мільярда доларів у рамках мирової угоди — найбільшої в історії США за сумою авторських прав, хоча ця сума ще має бути затверджена судом.

- **Пов’язані матеріали:**Найбільший у історії AI судовий позов! Викрадення книг для тренування Claude, компенсація 48 мільярдів, українські автори також отримали виплати

OpenAI також попередила DeepSeek

Крім Anthropic, великий гравець у галузі AI — OpenAI — також стикається з подібними проблемами.

Згідно з внутрішньою пам’яткою, опублікованою минулого тижня «Рейтер», OpenAI попередила американських законодавців, що DeepSeek намагається копіювати моделі, зокрема ChatGPT, та використовує їх для тренування власних алгоритмів, орієнтуючись на провідні американські AI-компанії.

Спостереження показують, що акаунти, пов’язані з працівниками DeepSeek, розробляють різні способи обходу обмежень доступу OpenAI. За допомогою змішаних сторонніх маршрутизаторів та приховування джерел вони отримують доступ до американських AI-моделей та збирають вихідні дані для дистиляційного тренування.

Проблеми дистиляційних технологій у китайському AI, водночас із послабленням контролю за експортом чіпів у США

Поки американські гіганти AI звинувачують Китай у застосуванні дистиляційних методів для тренування моделей, у США триває гостра дискусія щодо політики експорту чіпів до Китаю. У січні адміністрація Трампа офіційно дозволила компаніям, зокрема NVIDIA, експортувати передові AI-чіпи H200 до Китаю.

Критики вважають, що у вирішальний момент глобальної конкуренції за домінування у AI послаблення експортних обмежень суттєво підвищить можливості Китаю у цій галузі.

Дмітрій Альперовіч, голова аналітичного центру Silverado Policy Accelerator, заявив, що швидкий прогрес китайських AI-моделей частково зумовлений крадіжкою передових американських моделей за допомогою дистиляційних технологій. Ці докази переконують у тому, що США мають відмовитися від продажу будь-яких AI-чіпів цим компаніям, інакше їхня перевага лише зростатиме.

Anthropic попереджає, що системи штучного інтелекту, створені американськими компаніями, мають механізми захисту від використання їх у біологічній зброї або зловмисних кіберопераціях. Однак моделі, створені за допомогою дистиляції, зазвичай позбавлені таких захисних механізмів.

Anthropic висловлює побоювання, що якщо закордонні лабораторії з AI зможуть без обмежень інтегрувати ці можливості у військові та розвідувальні системи, авторитарні режими зможуть використовувати AI для здійснення атак у кіберпросторі, поширення дезінформації та масштабного контролю, що значно підвищить ризики безпеки.

Додаткові матеріали:

Китайські хакери почали масштабну кібератаку на AI! Anthropic: швидкість та масштаб AI-хакерів вже перевищили людських зловмисників