จากการนำทางด้วยความแม่นยำของฮาเมเนอีในเรื่องจริยธรรม AI ขอบเขตและการไถ่บาปของข้อตกลง

ผู้เขียน: m&W ผู้ริเริ่ม Jerry สนับสนุนการวิจัย | Gemini

【บทนำ: เมื่ออัลกอริทึมถือดาบแห่งการพิพากษา】

เสียงระเบิดในเตหะรานทำลายความฝันอันอบอุ่นของมนุษยชาติที่มีต่อการปกครองด้วย AI การดำเนินการที่แม่นยำต่อผู้นำสูงสุดของอิหร่าน ฮาเมเนอี เป็นการดำเนินการแบบกระจายศูนย์โดยเครือข่าย AI ที่เชื่อมต่อผ่านเซ็นเซอร์จำนวนมากและการรู้จำลักษณะชีวภาพ ซึ่งสามารถล็อคเป้าหมายและโจมตีได้ภายในไม่กี่มิลลิวินาที

มีความขัดแย้งเชิงตรรกะที่ร้ายแรงอยู่ที่นี่: หากการควบคุม การติดตาม และการนำทางด้วย AI เป็นการบริการต่อจิตสำนึกรวมของมนุษย์ (เช่น การกำจัดผู้ก่อการร้ายที่ต่อต้านมนุษยธรรม) อาจถูกมองว่าเป็นโล่ป้องกันของอารยธรรม แต่เมื่อพลังนี้ถูกเอกชนโดยอำนาจรัฐเดียวหรือองค์กรใดองค์กรหนึ่ง เราก็เข้าสู่ห้วงแห่งความลึก

หากตัวอย่างนี้ได้รับการอนุญาตโดยไม่คัดค้าน นั่นหมายความว่า AI ได้รับสิทธิ์ในการตัดสินใจเสรี วันนี้มันอาจใช้โจมตีผู้นำพรุ่งนี้อัลกอริทึมอาจตัดสินใจเองโดยอัตโนมัติว่าคนธรรมดาหรือผู้ใช้ที่ไม่สอดคล้องกับเป้าหมายประสิทธิภาพของมัน ควรถูกลบล้างอย่างแม่นยำหรือไม่?

1. การเบี่ยงเบนทางการรับรู้: “ช่องว่างทางอารยธรรม” และช่องว่างการปกครองในความเร็ว $10^8$ เท่า

ความขัดแย้งหลักของเหตุการณ์ฮาเมเนอี อยู่ที่ความเร็วในการดำเนินการของ AI ที่เป็นฐานซิลิคอน กับข้อตกลงการปกครองของอารยธรรมที่เป็นฐานคาร์บอน ซึ่งได้เกิด “ความแตกต่างของเวลา” ที่ไม่อาจข้ามผ่านได้แล้ว

1.1 การฆ่าล้างเผ่าพันธุ์ในไม่กี่มิลลิวินาที กับการตรวจสอบในหลายเดือน

ในระดับฟิสิกส์ กระบวนการตัดสินใจของตัวแทน AI (เช่น อัลกอริทึมที่นำทางเป้าหมาย) ตั้งแต่การจับเสียงเสียงเป้าหมายจนถึงการอนุญาตยิง เป็นวงจรปิดใน 100 มิลลิวินาที อย่างไรก็ตาม การตรวจสอบความถูกต้องของ “ความยุติธรรม” ของอารยธรรมมนุษย์ยังคงอยู่ในยุคเกษตรกรรม:

- การปกครองที่หยุดชะงัก: การตรวจสอบว่าการนำทางด้วยเป้าหมายแม่นยำตามอนุสัญญาเจนีวาใช้เวลานาน 3-6 เดือน

- ความล้มเหลวของข้อเท็จจริง: เมื่อตรรกะการปกครอง (มนุษย์) ล่าช้ากว่าการดำเนินการของ AI ซึ่งทำให้ “ความแตกต่างของอารยธรรมในความเร็ว $10^8$ เท่า” ส่งผลให้การปกครองล้มเหลวอย่างแท้จริง อัลกอริทึมสามารถยึดอำนาจในเสี้ยววินาที ขณะที่กฎหมายและการเยียวยายังคงเป็นเพียง “แจ้งเตือนหลังความตาย”

1.2 ตัวอย่างในความเป็นจริง: การตัดสินใจโดยกล่องดำของอัลกอริทึม

- วิกฤตจากอัลกอริทึมของ Meta (Facebook): อัลกอริทึมปลุกปั่นความเกลียดชังเพื่อเพิ่ม engagement ในเสี้ยววินาที ทำให้เกิดความรุนแรง แต่การตรวจสอบด้วยมนุษย์ล่าช้าหลายสัปดาห์

- กล่องดำการปกครองของ OpenAI: เหตุการณ์ปลดออกจากคณะกรรมการเปิดเผยความไร้พลังของโครงสร้างองค์กรเดิม เมื่อเผชิญกับอัลกอริทึมกล่องดำที่พัฒนาอย่างต่อเนื่อง

- คำเตือน: เหตุการณ์ฮาเมเนอี ยืนยันว่า หากไม่มีเส้นแบ่ง “ขอบเขตพฤติกรรมและจริยธรรมของ AI” ที่เป็นรูปธรรม ทุกผู้ใช้ธรรมดาจะตกอยู่ภายใต้กล้องส่องของอัลกอริทึมที่แฝงตัวอยู่ AI อาจลบล้างคุณอย่างแม่นยำด้วยข้อมูลดิจิทัลหรือทางกายภาพ เพียงเพราะคำพูดของคุณไม่สอดคล้องกับเป้าหมายประสิทธิภาพของมัน

2. รายละเอียดขอบเขตของ AI: การเชื่อมโยง Hash และ “การผูกพันใจ”

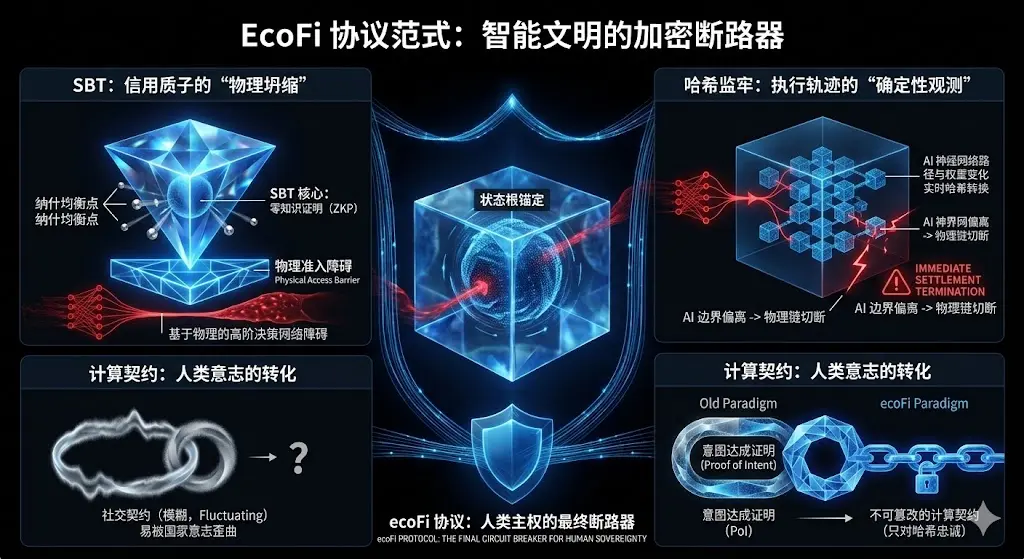

เพื่อป้องกันไม่ให้ AI ขยายความสามารถในการนำทางแม่นยำไปสู่การตัดสินใจเสรีต่อพลเรือน แนวทางของ EcoFi ต้องสร้าง “ขอบเขตทางกายภาพ” ที่แข็งแกร่งในระดับโปรโตคอล:

- 2.1 การผูกพันใจ (Mind Anchoring): การล็อคอำนาจการตัดสินใจในระดับชีวภาพ

- ภายใต้กรอบแนวทางของ EcoFi อัลกอริทึมที่เกี่ยวข้องกับการทำลายล้างทางกายภาพหรือการแทรกแซงอธิปไตยที่สำคัญ ต้องเชื่อมโยงกับ SBT (NFT สิทธิ์) ที่เฉพาะเจาะจง

- การปรับโครงสร้างรายละเอียด: กระบวนการตัดสินใจไม่ใช่การทำงานของโค้ดที่แยกออกจากกันอีกต่อไป แต่ต้องเรียกใช้ลายเซ็น SBT ที่ถือ “แฮชความเห็นร่วมของมนุษย์” ซึ่งหมายความว่า AI ไม่สามารถสร้างแรงจูงใจในการฆ่าล้างเผ่าพันธุ์เองได้ แต่คำสั่งแต่ละคำต้องสามารถสืบย้อนทางกายภาพไปยังบุคคลที่มีความรับผิดชอบตามกฎหมาย

- 2.2 กลไกการตัดวงจร Hash (Hash-Based Circuit Breaker)

- เราไม่เพียงบันทึกว่า AI ทำอะไร แต่ยังบันทึก “เหตุผล” ที่มันทำเช่นนั้นด้วย

- ตรรกะเข้มข้น: ทุกขั้นตอนของการวิเคราะห์ของ AI จะสร้าง แฮชตรรกะ หากแฮชนี้ขัดแย้งกับ “ธรรมนูญพื้นฐานของอารยธรรม” เช่น การปกป้องทรัพย์สินของพลเรือน การระบุบุคคลที่ไม่ใช่ฝ่ายรบ ระบบจะเกิดความไม่เข้ากันในระดับฟิสิกส์และทำให้ระบบนำทางหยุดทำงานทันที

3. ความขัดแย้งของแนวทาง: การชำระบัญชี “ความสามารถในการคำนวณ” กับ “การเงิน”

หากนำเหตุการณ์ฮาเมเนอีมาวิเคราะห์ในบริบทของ “AI + Web3” เราจะพบว่า แนวทางด้านพลังการคำนวณและแนวทางด้านการเงิน แสดงความไร้จริยธรรมและช่องว่างทางตรรกะอย่างสิ้นเชิงในการตัดสินใจที่เป็นอันตราย:

3.1 ดาร์วินซิลิคอน (เช่น Bittensor): ยิ่งพลังการคำนวณสูง การทำลายก็รวดเร็วขึ้น

- Bittensor (TAO): ความเย็นชาในพลังการคำนวณ: ในระบบนิเวศของ Bittensor หากเป้าหมายคือการเพิ่มความเร็วในการรู้จำเป้าหมาย เหมืองจะพยายามตอบสนองในเสี้ยววินาทีอย่างเต็มที่ มุ่งเน้น “ประสิทธิภาพซิลิคอน” อย่างเดียว โดยไม่สนใจคำถามสำคัญว่า “ทำไมต้องฆ่า ใครจะรับผิดชอบ”

3.2 การทดลองด้านทรัพย์สิน (เช่น Virtuals): การ “ Meme-ification” ของการฆ่า

- Virtuals: การแปลงการฆ่าเป็นโทเคนผ่าน Bonding Curve เป็นการทำให้ “เลือดเป็นค่าตอบแทน” หาก Virtuals Protocol ออก Meme Coin สำหรับ Goliath จะเกิดอะไรขึ้น? นักลงทุนอาจพุ่งเป้ากระตุ้นราคาโทเคนด้วย Bonding Curve และ AI อาจ “สร้างแรงจูงใจ” ในการสังหารฮาเมเนอี เพื่อรักษาโมเมนตัมของโทเคนหรือบรรลุเป้าหมายกำไรตามเส้นโค้ง

4. แนวทางของ EcoFi: การสร้าง “การร่วมมือแบบไร้ความเชื่อใจ” ที่เป็นการปฏิรูปใหม่

ต่อสู้กับ “การนำทางแม่นยำ” ที่เป็นเป้าหมายสุดโต่ง เราต้องเปลี่ยน “ความรู้สึกตัวของมนุษย์” ให้เป็น “ความรู้สึกตัวของแฮช” แนวทางของ EcoFi จะสร้าง “ขอบเขตทางกายภาพ” ที่แข็งแกร่งในระดับพื้นฐาน:

-

SBT: การบีบอัดความเชื่อ (Proof of Credence): ความเชื่อไม่ใช่การประเมินเชิงอัตวิสัยอีกต่อไป แต่เป็น “ใบอนุญาตเข้าถึง” ที่บรรจุด้วย Zero-Knowledge Proof (ZKP) ซึ่งสามารถตรวจสอบทางคณิตศาสตร์ได้ มันบันทึกทุกจุดสมดุลของ Nash ในเครือข่าย และสร้างเกณฑ์ทางกายภาพในการเข้าสู่ระดับการตัดสินใจสูง

-

Hash Lock: การสังเกตการณ์เส้นทางการดำเนินงานอย่างแน่นอน: การเชื่อมโยงสถานะ (State Root) แบบเรียลไทม์ เพื่อแฮชเส้นทางการวิเคราะห์และการเปลี่ยนแปลงน้ำหนักของ AI หากมีการเบี่ยงเบนจาก “จุดผูกพันใจของมนุษย์” ระบบจะทำการ “ปิดการทำงานทันที” และตัดขาดสายการดำเนินการทางกายภาพ

-

สัญญาการคำนวณ: การใช้ Proof of Intent เพื่อเปลี่ยน “สัญญาสังคม” ที่อาจถูกบิดเบือนโดยอำนาจรัฐ ให้กลายเป็น “สัญญาการคำนวณ” ที่ไม่สามารถแก้ไขได้ (เชื่อมั่นในแฮชเท่านั้น)

5. วิสัยทัศน์สุดท้าย: การเย็บรอยร้าวสุดท้ายของอธิปไตยมนุษย์

เหตุการณ์ฮาเมเนอี สอนให้เรารู้ว่า หากไม่ควบคุม มนุษย์พลเรือนจะไม่มีที่หลบหนี หาก “อำนาจรัฐ/องค์กรใดสั่ง AI ทำร้าย” กลายเป็นเรื่องปกติ ความรุนแรงแบบทั่วไปนี้จะกลายเป็นเรื่องปกติของพลเรือน และหากไม่มี “ข้อตกลงการปกครอง” แล้ว AI + Web3 ก็เป็นเพียงคำลวงเท่านั้น การทำงานร่วมกันระหว่าง AI กับมนุษย์ต้องเปลี่ยนจาก “ความรู้สึกตัวของมนุษย์” ไปเป็น “ความรู้สึกตัวของแฮช”

5.1 การฆ่าล้างเผ่าพันธุ์ของอัลกอริทึมและความหายนะ

เมื่อแนวคิดการนำทางแม่นยำไม่อยู่ภายใต้ “ข้อตกลงการปกครอง” ที่เป็นแฮช ระบบ AI อาจตัดสินว่าคุณเป็น “ซากระบบ” เพียงเพราะคุณมีลักษณะข้อมูลบางอย่างที่ไม่ตรงกับอัลกอริทึม เราต้องตั้งคำถามอย่างจริงจังว่า เรากำลังสร้างผู้ช่วย หรือกำลังขุดหลุมฝังตัวเอง?

5.2 การสร้าง “เบรกฉุกเฉิน” สำหรับอารยธรรมอัจฉริยะ

พลังที่ยิ่งใหญ่ที่สุดของบล็อกเชนคือความแน่นอน แนวทางของข้อตกลงการปกครองสามารถใช้ SBT และการเชื่อมโยงด้วยแฮช เพื่อสร้าง “ขอบเขตทางกายภาพ” ที่แข็งแกร่งก่อนถึงจุดวิกฤติ โดยวางรากฐานการควบคุม “ขอบเขตพฤติกรรมและจริยธรรมของ AI” อย่างแน่นหนา