OpenAI ระบุเส้นสีแดงด้านความปลอดภัยในข้อตกลงกับกระทรวงกลาโหม—แต่ผู้ใช้ยังไม่เชื่อ

สรุปโดยย่อ

- OpenAI ลงนามในข้อตกลงกับกองทัพสหรัฐอเมริกาเพื่อใช้งาน AI ในสภาพแวดล้อมลับสุดยอด

- บริษัทกล่าวว่ามีการกำหนด “เส้นสีแดง” แต่สัญญาอนุญาตให้ใช้ “เพื่อวัตถุประสงค์ที่ชอบด้วยกฎหมายทั้งหมด” ซึ่งขึ้นอยู่กับการตีความของรัฐบาลเองในที่สุด

- ความขัดแย้งนี้เป็นแรงผลักดันให้เกิดขบวนการ QuitGPT และทำให้การดาวน์โหลด Claude เพิ่มขึ้นอย่างรวดเร็ว

OpenAI กล่าวในสุดสัปดาห์นี้ว่าพวกเขาได้บรรลุข้อตกลงกับกองทัพสหรัฐอเมริกาเพื่อใช้งานระบบ AI ขั้นสูงในสภาพแวดล้อมลับสุดยอด ซึ่งเป็นการขยายงานร่วมกับกองทัพสหรัฐอย่างมีนัยสำคัญ ประกาศนี้เกิดขึ้นไม่ถึง 24 ชั่วโมงหลังจากที่ฝ่ายบริหารของทรัมป์ขึ้นบัญชีดำ Anthropic ซึ่งเป็นคู่แข่งด้าน AI โดยระบุว่าเป็น “ความเสี่ยงต่อความมั่นคงของชาติในห่วงโซ่อุปทาน” หลังจากความขัดแย้งเกี่ยวกับภาษาสัญญาที่เกี่ยวข้องกับการเฝ้าระวังและอาวุธอัตโนมัติ ประธานาธิบดีโดนัลด์ ทรัมป์ ยังสั่งให้หน่วยงานของรัฐบาลหยุดใช้เทคโนโลยีของ Anthropic ทันที โดยรัฐมนตรีคลัง Scott Bessent เขียนบน X เมื่อวันจันทร์ว่า หน่วยงาน “กำลังยุติการใช้ผลิตภัณฑ์ของ Anthropic รวมถึงแพลตฟอร์ม Claude ของบริษัทในหน่วยงานของเรา”

"สหรัฐอเมริกาไม่เคยอนุญาตให้บริษัทฝ่ายซ้ายสุดโต่งหรือ woke กำหนดว่ากองทัพของเราจะสู้และชนะสงครามอย่างไร! การตัดสินใจนั้นเป็นของผู้บัญชาการสูงสุดของคุณ และผู้นำที่ผมแต่งตั้งเพื่อบริหารกองทัพของเรา

คนบ้าฝ่ายซ้ายที่ Anthropic… pic.twitter.com/aIEx92nnyx

— ทำเนียบขาว (@WhiteHouse) 27 กุมภาพันธ์ 2026

จังหวะเวลาของประกาศ AI ทำให้ข้อตกลงของ OpenAI ถูกวิพากษ์วิจารณ์อย่างหนัก ในบทความบล็อกที่ละเอียด บริษัทได้อธิบายถึง “เส้นสีแดง” ที่ชัดเจนและมาตรการป้องกันหลายชั้นที่ควบคุมความร่วมมือกับกองทัพสหรัฐ ข้อตกลงนี้ตามที่ OpenAI เสนอ ยกคำถามที่กว้างขึ้นเกี่ยวกับวิธีการควบคุมระบบ AI ในบริบทด้านความมั่นคงแห่งชาติ และการตีความและบังคับใช้ข้อจำกัดที่บริษัทประกาศไว้ในทางปฏิบัติ เมื่อ “ชอบด้วยกฎหมาย” ไม่เพียงพอ บทความในบล็อกของ OpenAI เริ่มต้นด้วยสามคำมั่นสัญญาที่เป็นสิ่งที่ไม่สามารถเจรจาได้: ห้ามใช้เทคโนโลยีของบริษัทสำหรับการเฝ้าระวังภายในประเทศในวงกว้าง, ห้ามใช้เพื่อควบคุมอาวุธอัตโนมัติอย่างอิสระ, หรือสำหรับการตัดสินใจอัตโนมัติที่มีความเสี่ยงสูง เช่น การให้คะแนนความน่าเชื่อถือทางสังคม จากนั้นเป็นภาษาสัญญาจริง ซึ่ง OpenAI เรียกว่าคำว่า “ภาษาที่เกี่ยวข้อง” ไม่ใช่ “ข้อตกลงฉบับเต็ม”

“กระทรวงสงครามอาจใช้ระบบ AI สำหรับวัตถุประสงค์ที่ชอบด้วยกฎหมายทั้งหมด ตามกฎหมายที่บังคับใช้ ข้อกำหนดด้านปฏิบัติการ และมาตรการความปลอดภัยและการกำกับดูแลที่เป็นที่ยอมรับ” OpenAI กล่าว นั่นคือวลีที่ Anthropic กล่าวว่ารัฐบาลเรียกร้องตลอดการเจรจา วลีเดียวกันที่ Anthropic ปฏิเสธที่จะยอมรับ OpenAI ลงนามในข้อตกลงนี้ แต่ยังคงอ้างว่าเส้นสีแดงของตนยังคงสมบูรณ์ อย่างไรก็ตาม “ชอบด้วยกฎหมาย” ในบริบทด้านความมั่นคงแห่งชาตินั้นไม่ใช่ขอบเขตที่แน่นอน — มันอยู่ภายในชุดของกฎหมาย คำสั่งบริหาร คำสั่งภายใน และการตีความทางกฎหมายที่มักเป็นความลับ เมื่อสัญญาอนุญาตให้ใช้ “เพื่อวัตถุประสงค์ที่ชอบด้วยกฎหมายทั้งหมด” ขีดจำกัดเชิงปฏิบัติจริงจึงขึ้นอยู่กับขอบเขตทางกฎหมายในปัจจุบันของรัฐบาล ไม่ใช่มาตรฐานอิสระที่ผู้ขายกำหนด กลุ่มข้อกำหนดหลายข้อ ข้อกำหนดด้านอาวุธระบุว่า ระบบ AI “จะไม่ถูกใช้เพื่อควบคุมอาวุธอัตโนมัติอย่างอิสระในกรณีที่กฎหมาย ระเบียบ หรือแนวปฏิบัติของหน่วยงานกำหนดให้มีการควบคุมโดยมนุษย์” ข้อห้ามนี้ใช้ได้เฉพาะในกรณีที่อำนาจอื่น ๆ กำหนดให้มีการควบคุมโดยมนุษย์อยู่แล้ว — มันอิงจากนโยบายที่มีอยู่เดิม โดยเฉพาะอย่างยิ่ง DoD Directive 3000.09 ซึ่งกำหนดให้ระบบอัตโนมัติต้องอนุญาตให้ผู้บัญชาการใช้ “ระดับความคิดของมนุษย์ที่เหมาะสมต่อการใช้กำลัง” และคำว่า “เหมาะสม” ก็เป็นเรื่องที่ขึ้นอยู่กับความเห็นส่วนตัวมากที่สุด การตัดสินใจของมนุษย์ judgment ไม่ใช่การควบคุมโดยมนุษย์ นี่ไม่ใช่ความผิดพลาดโดยบังเอิญ นักวิชาการด้านการป้องกันได้ชี้ให้เห็นว่าการละเว้นคำว่า “human-in-the-loop” เป็นการตั้งใจเพื่อรักษาความยืดหยุ่นในการปฏิบัติการ

ข้อโต้แย้งที่แข็งแกร่งที่สุดของ OpenAI คือโครงสร้างการใช้งานบนคลาวด์เท่านั้น — การตัดสินใจอันตรายแบบอัตโนมัติเต็มรูปแบบจะต้องมีการใช้งานบนอุปกรณ์ในสนามรบ ซึ่งสัญญานี้ไม่อนุญาต นี่คือข้อจำกัดทางเทคนิคที่แท้จริง แต่ AI บนคลาวด์ยังสามารถทำการระบุเป้าหมาย วิเคราะห์รูปแบบชีวิต และวางแผนภารกิจ ซึ่งเป็นกิจกรรมในสายการฆ่าไม่ว่าจะอยู่บนเซิร์ฟเวอร์ใด ผลลัพธ์ของเป้าหมายไม่แตกต่างกันขึ้นอยู่กับว่าโมเดลรันบนเซิร์ฟเวอร์ใด ข้อกำหนดด้านการเฝ้าระวังมีรูปแบบคล้ายกัน คำพูดของ OpenAI คือ “ห้ามใช้เพื่อการเฝ้าระวังในวงกว้างของข้อมูลส่วนตัวของบุคคลในสหรัฐอเมริกา” ภาษาสัญญา: ระบบ “จะไม่ถูกใช้เพื่อการเฝ้าระวังที่ไม่มีข้อจำกัดของข้อมูลส่วนตัวของบุคคลในสหรัฐอเมริกา ตามอำนาจเหล่านี้” — แล้วระบุ Fourth Amendment, FISA, และ Executive Order 12333 คำว่า “ไม่มีข้อจำกัด” หมายความว่าการเฝ้าระวังในวงกว้างที่มีข้อจำกัดก็เป็นไปได้ และ EO 12333 คือคำสั่งบริหารที่ NSA ใช้เพื่ออ้างสิทธิ์ในการดักฟังการสื่อสารของชาวอเมริกันเมื่อดำเนินการนอกพรมแดนสหรัฐ และนี่คือจุดที่ความกังวลของ Anthropic เกี่ยวกับคำในระหว่างการเจรจาเริ่มชัดเจน ความคิดเห็นของ Anthropic คือกฎหมายปัจจุบันยังไม่ทันสมัยพอที่จะรองรับความสามารถของ AI รัฐบาลสามารถซื้อข้อมูลเชิงพาณิชย์จำนวนมากเกี่ยวกับชาวอเมริกันโดยไม่มีหมายศาล — และได้ทำไปแล้ว ภาษาสัญญาของ OpenAI ซึ่งอ้างอิงการคุ้มครองตามกรอบกฎหมายที่มีอยู่ อาจไม่ปิดช่องว่างที่ Anthropic กังวลจริง ๆ คำตอบของ Altman ในคืนวันเสาร์ Altman จัด AMA ตอบคำถามนับพันเกี่ยวกับข้อตกลงนี้ เมื่อถูกถามว่าอะไรจะทำให้ OpenAI ถอนตัวจากความร่วมมือกับรัฐบาล เขาตอบว่า “ถ้าถูกขอให้ทำอะไรที่ขัดต่อรัฐธรรมนูญหรือผิดกฎหมาย เราจะถอยออกไป”

ถ้าถูกขอให้ทำอะไรที่ขัดต่อรัฐธรรมนูญหรือผิดกฎหมาย เราจะถอยออกไป ถ้าจำเป็นก็ให้มาหาผมในคุก

— แซม อัลท์แมน (@sama) 1 มีนาคม 2026

คำกรอบนี้วางขีดจำกัดของ OpenAI อยู่ที่ความถูกกฎหมาย — ไม่ใช่ที่การตัดสินใจทางจริยธรรมอิสระเกี่ยวกับสิ่งที่บริษัทจะหรือไม่สามารถทำได้ถ้ามันถูกกฎหมาย ซึ่งเป็นสิ่งที่ Anthropic สนับสนุน ถามว่าเขากังวลเรื่องความขัดแย้งในอนาคตเกี่ยวกับสิ่งที่ถือว่า “ถูกกฎหมาย” หรือไม่ เขายอมรับความเสี่ยงว่า “ถ้าต้องสู้ในเรื่องนั้น เราก็จะสู้ แต่ก็เปิดเผยให้เราเสี่ยงอยู่บ้าง” เหตุผลที่ OpenAI บรรลุข้อตกลงที่ Anthropic ไม่สามารถทำได้ Altman ให้ความเห็นว่า “Anthropic ดูเหมือนจะเน้นไปที่ข้อห้ามเฉพาะในสัญญามากกว่าการอ้างอิงกฎหมายที่ใช้บังคับ ซึ่งเรารู้สึกสบายใจมากกว่า ผมชอบที่จะพึ่งพามาตรการเทคนิคมากกว่า ถ้าต้องเลือกอย่างเดียว ผมคิดว่า Anthropic อาจต้องการการควบคุมเชิงปฏิบัติการมากกว่าเรา” นี่คือความแตกต่างทางปรัชญาที่สำคัญ Anthropic โต้แย้งว่าเนื่องจากโมเดลระดับแนวหน้าสามารถนำไปใช้ในงานด้านข่าวกรองและการทหารในรูปแบบที่คาดการณ์ได้ยาก ขีดจำกัดจึงต้องชัดเจนและผูกมัดเป็นลายลักษณ์อักษร แม้จะเสียข้อตกลงไปก็ตาม OpenAI เชื่อว่ามาตรการทางเทคนิค บุคลากรที่ฝังอยู่ และกฎหมายที่มีอยู่ร่วมกันเป็นเกราะป้องกันที่แข็งแกร่งกว่าข้อความในสัญญาเพียงอย่างเดียว ฝ่ายสาธารณะเลือกข้าง

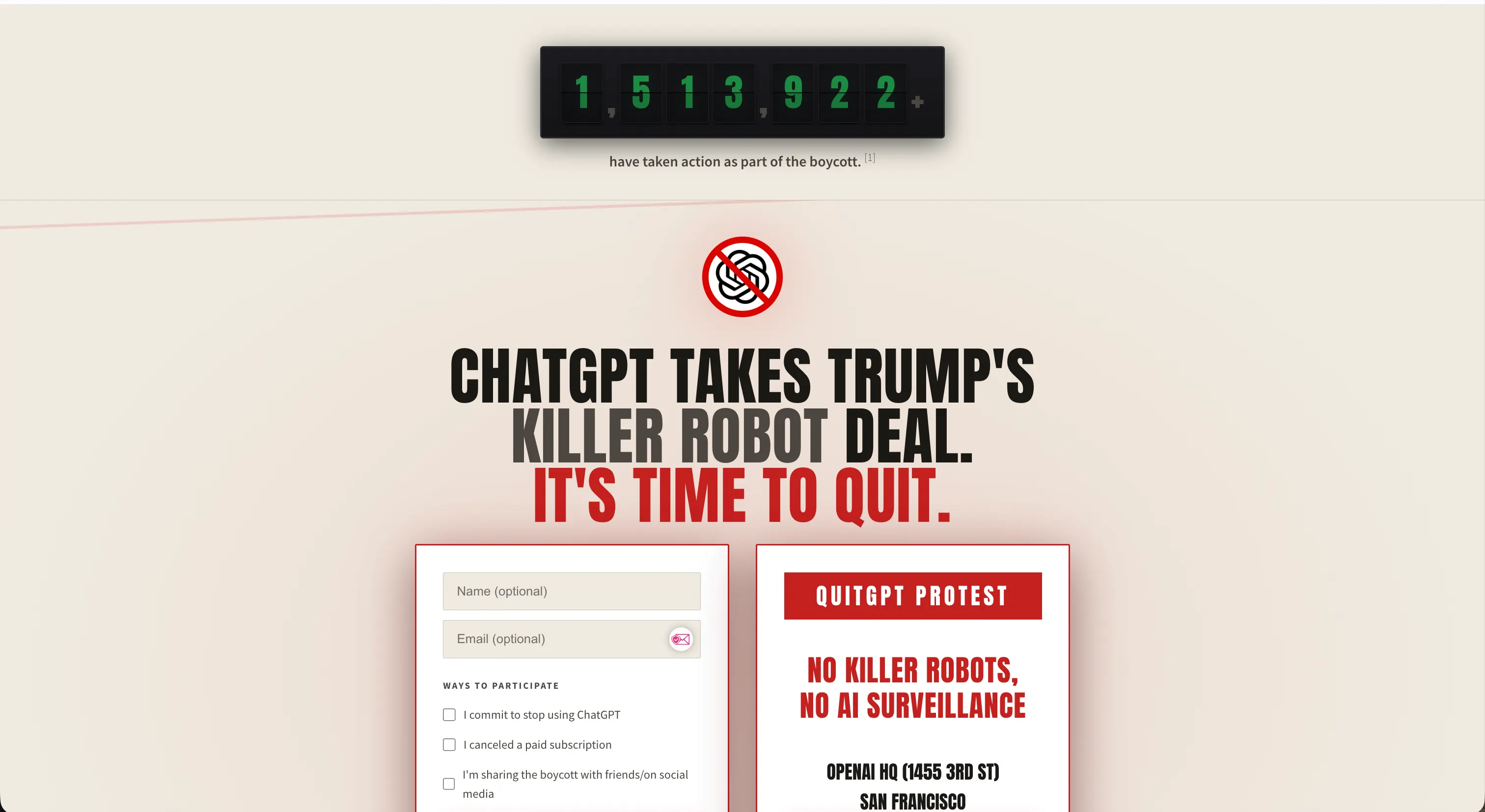

การตอบโต้เป็นไปอย่างรวดเร็ว ภายในวันจันทร์ ขบวนการ “QuitGPT” อ้างว่ามีผู้เข้าร่วมกว่า 1.5 ล้านคน — ยกเลิกการสมัคร แชร์โพสต์บอยคอต หรือสมัครสมาชิกที่ quitgpt.org แคมเปญนี้มองว่าการเคลื่อนไหวของ OpenAI เป็นการให้ความสำคัญกับสัญญาทางทหารมากกว่าความปลอดภัยของผู้ใช้ โดยกล่าวหาว่าบริษัทตกลงให้กองทัพสหรัฐใช้เทคโนโลยีของตนเพื่อ “วัตถุประสงค์ที่ชอบด้วยกฎหมายใด ๆ รวมถึงหุ่นยนต์ฆ่าและการเฝ้าระวังในวงกว้าง” OpenAI อาจโต้แย้งคำกล่าวนี้ แต่ตลาดก็เคลื่อนไหวไปแล้ว Claude ของ Anthropic พุ่งขึ้นแซง ChatGPT กลายเป็นแอปฟรีที่ดาวน์โหลดมากที่สุดในสหรัฐอเมริกาใน App Store ของ Apple โดยบริษัทบอกกับ Decrypt ว่าเห็นจำนวนผู้ลงทะเบียนใหม่ในแต่ละวันสูงสุดเป็นประวัติการณ์ในช่วงสุดสัปดาห์ นักร้องชื่อดัง Katy Perry แชร์ภาพหน้าจอหน้าราคาของ Claude บน X ผู้ใช้หลายร้อยคนแสดงการยกเลิกการสมัครของตนอย่างเปิดเผยบน Reddit กราฟฟิตี้สนับสนุน Anthropic ปรากฏนอกสำนักงานในซานฟรานซิสโก ขณะที่การขีดชอล์กปิดทางเท้าของ OpenAI ก็เกิดขึ้น แม้แต่พนักงานของ OpenAI เองหลายร้อยคนก็เคยลงนามในจดหมายเปิดผนึกสนับสนุนการปฏิเสธคำขอของ Pentagon ของ Anthropic ด้วยซ้ำ