ความมั่นคงแห่งชาติ V.S จริยธรรม: Anthropic ปฏิเสธที่จะลบเส้นกั้นความปลอดภัยของ Claude เผชิญหน้ากับกระทรวงกลาโหมสหรัฐ

Anthropic ปฏิเสธที่จะถอดรั้วรักษาความปลอดภัยของ Claude การเจรจากับเพนตากอนล้มเหลว ทรัมป์สั่งห้ามความเสี่ยงของห่วงโซ่อุปทานคู่ขนาน และ OpenAI เข้ารับสัญญาทางทหารมูลค่า 200 ล้านดอลลาร์อย่างรวดเร็ว

รั้วป้องกันทางจริยธรรมจุดชนวนวิกฤตการป้องกันประเทศ และการเจรจาของ Anthropic กับเพนตากอนก็พังทลาย

ความร่วมมืออันยาวนานของ Anthropic กับกระทรวงกลาโหมสหรัฐฯ (DoD) พังทลายในเดือนกุมภาพันธ์ปีนี้ หัวใจสําคัญของการโต้เถียงนี้คือการปฏิเสธของ Anthropic ที่จะลบรั้วรักษาความปลอดภัยที่สําคัญออกจากโมเดล Claude ซึ่งนําไปสู่การเผชิญกับผลกระทบร้ายแรงจากการยกเลิกสัญญามูลค่า 200 ล้านดอลลาร์และการขึ้นบัญชีดําด้านความมั่นคงแห่งชาติ จุดเริ่มต้นของการเจรจาระหว่างทั้งสองฝ่ายเริ่มต้นด้วยการลงนามในสัญญาในเดือนกรกฎาคม พ.ศ. 2024 เมื่อ Anthropic มีความหวังสูงในฐานะห้องปฏิบัติการ AI แห่งแรกที่รวมโมเดลเข้ากับเครือข่ายที่จัดประเภททางทหาร ความร่วมมือแย่ลงอย่างรวดเร็วเนื่องจากเพนตากอนเรียกร้องให้เข้าถึง “การใช้งานที่ถูกต้องตามกฎหมายทั้งหมด” ของระบบ AI อย่างไม่จํากัด

Dario Dalio ซีอีโอของ Anthropic Dario Amodei กล่าวอย่างชัดเจนในแถลงการณ์ของเขาว่า บริษัท ยึดมั่นในสองบรรทัดล่างสุดที่ไม่สามารถข้ามได้:

- ห้ามใช้ AI ในระบบอาวุธอัตโนมัติเต็มรูปแบบ

- ห้ามการเฝ้าระวังพลเมืองสหรัฐฯ ในประเทศขนาดใหญ่

Amodei เน้นย้ําว่า AI ที่ทรงพลังสามารถปะติดปะต่อข้อมูลที่กระจัดกระจายและดูเหมือนไม่เป็นอันตรายเข้าด้วยกันเป็นภาพที่สมบูรณ์ของชีวิตของแต่ละบุคคล และหากใช้เทคโนโลยีนี้สําหรับการเฝ้าระวังขนาดใหญ่ มันจะขัดแย้งกับค่านิยมประชาธิปไตยอย่างร้ายแรงนอกจากนี้ เขาเชื่อว่าเทคโนโลยี AI ในปัจจุบันยังไม่ถึงความเสถียรเพียงพอที่จะรับผิดชอบในการตัดสินใจเกี่ยวกับกองกําลังร้ายแรงโดยปราศจากการแทรกแซงของมนุษย์ และการบังคับใช้อาจก่อให้เกิดความเสี่ยงต่อทหารแนวหน้าและพลเรือน

ที่มา: Dario Dalio เจ้าหน้าที่บริหารของ Fortune Anthropic ดาริโอ อโมเดย์

เมื่อเผชิญกับความพากเพียรของ Anthropic กระทรวงกลาโหมได้แสดงจุดยืนที่แข็งกร้าว โฆษกเพนตากอน ฌอน ที. แม้ว่า Sean Parnell จะอ้างว่ากองทัพไม่มีความตั้งใจที่จะใช้ AI เพื่อทําการเฝ้าระวังที่ผิดกฎหมายหรือพัฒนา “หุ่นยนต์นักฆ่า” แต่เขาเน้นย้ําว่ากองทัพต้องการให้ซัพพลายเออร์มุ่งมั่นที่จะปฏิบัติตาม “การใช้งานที่ถูกต้องตามกฎหมายทั้งหมด”

ทางตันระหว่างทั้งสองฝ่ายเข้าสู่ระดับไข้ในสัปดาห์สุดท้ายของเดือนกุมภาพันธ์ โดยเพนตากอนได้ออกคําขาดเมื่อเย็นวันพุธที่ผ่านมา (25/2) โดยกําหนดให้ Anthropic ยอมรับสัญญาใหม่พร้อมเงื่อนไขทางกฎหมายที่คลุมเครือภายในเวลา 17:01 น. ของวันศุกร์ (2/27) โฆษกของ Anthropic กล่าวว่าการประนีประนอมที่เรียกว่ามีหลุมพรางทางกฎหมายที่อนุญาตให้กองทัพเพิกเฉยต่อรั้วความปลอดภัยได้ตามต้องการ

ทรัมป์สั่งปิดล้อมอย่างสมบูรณ์ และ Anthropic ถูกระบุว่าเป็นความเสี่ยงด้านความปลอดภัยของห่วงโซ่อุปทาน

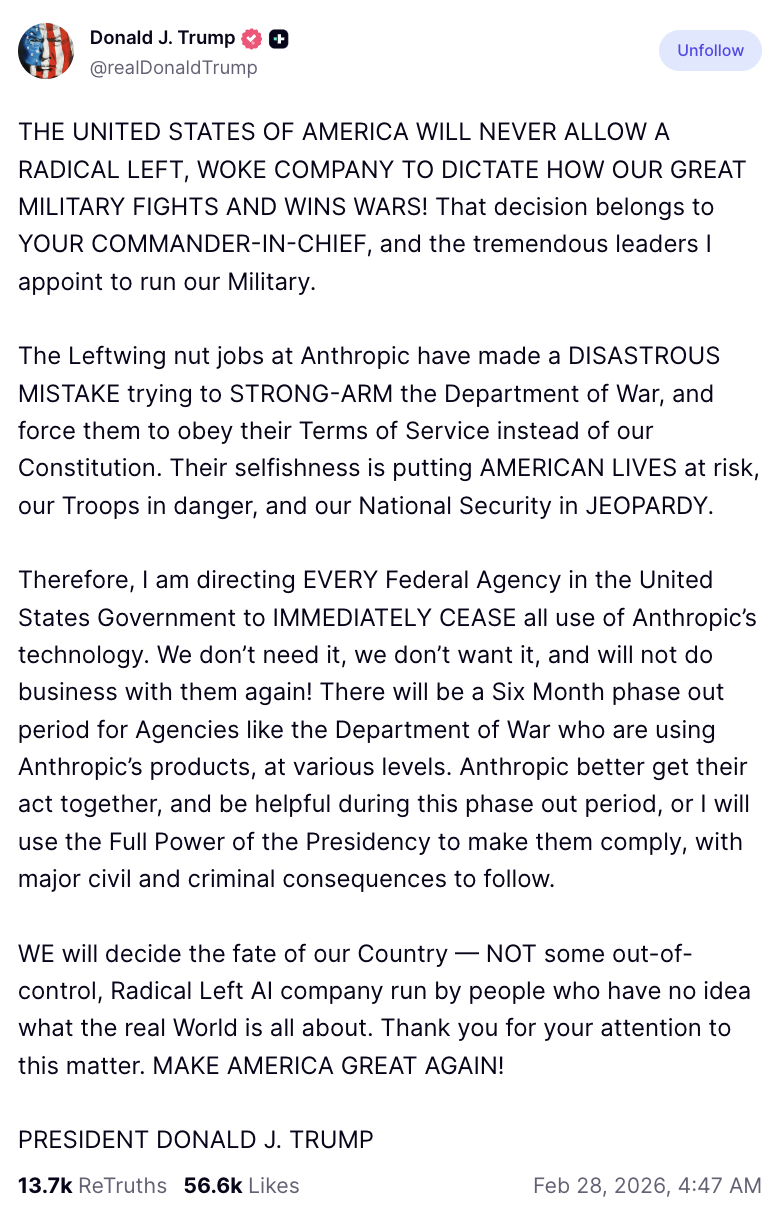

เมื่อเส้นตายการเจรจาหมดอายุ ประธานาธิบดีโดนัลด์ ทรัมป์ ของสหรัฐฯ ก็เข้าแทรกแซงอย่างรวดเร็ว ทรัมป์แสดงความคิดเห็นอย่างดุเดือดใน Truth Socialเขาตําหนิ Anthropic ว่าเป็น “หัวรุนแรงฝ่ายซ้าย” และกล่าวหาว่าบริษัทพยายามบังคับให้รัฐบาลสละอํานาจตามรัฐธรรมนูญด้วยเงื่อนไขการให้บริการจากนั้นทรัมป์ได้ออกคําสั่งของประธานาธิบดีที่กําหนดให้หน่วยงานของรัฐบาลกลางทั้งหมดหยุดใช้เทคโนโลยีของ Anthropic ทันที และกําหนดระยะเวลาการเปลี่ยนผ่านบัฟเฟอร์ 6 เดือนสําหรับแผนกต่างๆ ที่พึ่งพาระบบอยู่แล้ว เขาเชื่อว่าการตัดสินใจของ Anthropic ได้คุกคามชีวิตของกองทัพสหรัฐฯ และผลประโยชน์ด้านความมั่นคงโดยรวมของประเทศ

ที่มา: Truth Social/@realDonaldTrump ทรัมป์ออกบทความวิพากษ์วิจารณ์ Anthropic ว่าเป็น “หัวรุนแรงฝ่ายซ้าย” และกล่าวหาว่าบริษัทพยายามบังคับให้รัฐบาลสละอํานาจตามรัฐธรรมนูญภายใต้เงื่อนไขการให้บริการ

ต่อจากนั้นรัฐมนตรีว่าการกระทรวงกลาโหมพีท Pete Hegseth ระบุว่า Anthropic เป็น “ความเสี่ยงในห่วงโซ่อุปทานด้านความมั่นคงแห่งชาติ” อย่างเป็นทางการ ฉลากนี้มักใช้สําหรับกองกําลังศัตรูจากต่างประเทศเท่านั้น และหายากมากสําหรับบริษัทในสหรัฐอเมริกาHegseth อยู่บนแพลตฟอร์ม Xประกาศความสัมพันธ์ของกระทรวงกลาโหมกับ Anthropic มีการเปลี่ยนแปลงอย่างถาวร และผู้รับเหมา ซัพพลายเออร์ หรือพันธมิตรใดๆ ที่มีความสัมพันธ์ทางธุรกิจกับกองทัพจะถูกห้ามไม่ให้มีส่วนร่วมในกิจกรรมเชิงพาณิชย์ใดๆ กับ Anthropicการห้ามดังกล่าวตัดขาดความร่วมมืออย่างเป็นทางการและส่งผลกระทบโดยตรงต่อระบบนิเวศทางธุรกิจของ Anthropic โดยพันธมิตรอาจถูกบังคับให้ตัดความสัมพันธ์กับมัน

ข้อพิพาทนี้กลายเป็นการโจมตีส่วนบุคคล รัฐมนตรีช่วยว่าการกระทรวงกลาโหม Emile ไมเคิล (เอมิล ไมเคิล) กล่าวหา Amodi ว่ามี “พระเจ้าที่ซับซ้อน” และพยายามควบคุมกองทัพสหรัฐฯ แม้ว่า Anthropic จะย้ําซ้ําแล้วซ้ําเล่าว่าสนับสนุนการใช้ AI สําหรับงานข่าวกรองต่างประเทศที่ถูกต้องตามกฎหมายและปฏิบัติการทางทหารเสริม แต่เจ้าหน้าที่กระทรวงกลาโหมไม่พอใจกับความพยายามของบริษัทเอกชนในการกําหนด “การยับยั้ง” ในการตัดสินใจด้านการต่อสู้ ความตึงเครียดนี้สะท้อนให้เห็นถึงช่องว่างอันกว้างใหญ่ระหว่างจริยธรรมด้านเทคโนโลยีของซิลิคอนวัลเลย์กับความต้องการในทางปฏิบัติของเพนตากอน ซึ่งบดบังรูปแบบความร่วมมือในอนาคตระหว่างบริษัท AI และรัฐบาล

การแลกเปลี่ยนระหว่างจริยธรรมทางเทคโนโลยีกับสงครามจริง Anthropic คุกคามการตอบโต้ทางกฎหมาย

ในการตอบสนองต่อการคว่ําบาตรของรัฐบาล Anthropic ตอบโต้ด้วยความอ่อนน้อมถ่อมตนหรือความเย่อหยิ่ง บริษัทชี้ให้เห็นว่าการที่กระทรวงกลาโหมระบุว่าเป็น “ความเสี่ยงในห่วงโซ่อุปทาน” ขาดพื้นฐานทางกฎหมายและวางแผนที่จะคัดค้านคําตัดสินในศาล

Anthropic อ้างถึง 10 USC § 3,252 (10 USC 3252) โดยให้เหตุผลว่ารัฐมนตรีว่าการกระทรวงกลาโหมไม่มีอํานาจในการแทรกแซงกิจกรรมทางธุรกิจของผู้รับเหมาภายใต้สัญญาที่ไม่ใช่ของกระทรวงกลาโหม ซึ่งหมายความว่าแม้ว่า Claude อาจไม่พร้อมใช้งานสําหรับโครงการทางทหาร แต่รัฐบาลไม่ควรใช้สิ่งนี้เพื่อจํากัดธุรกิจเอกชนหรือประชาชนทั่วไปไม่ให้เข้าถึงบริการผ่าน API

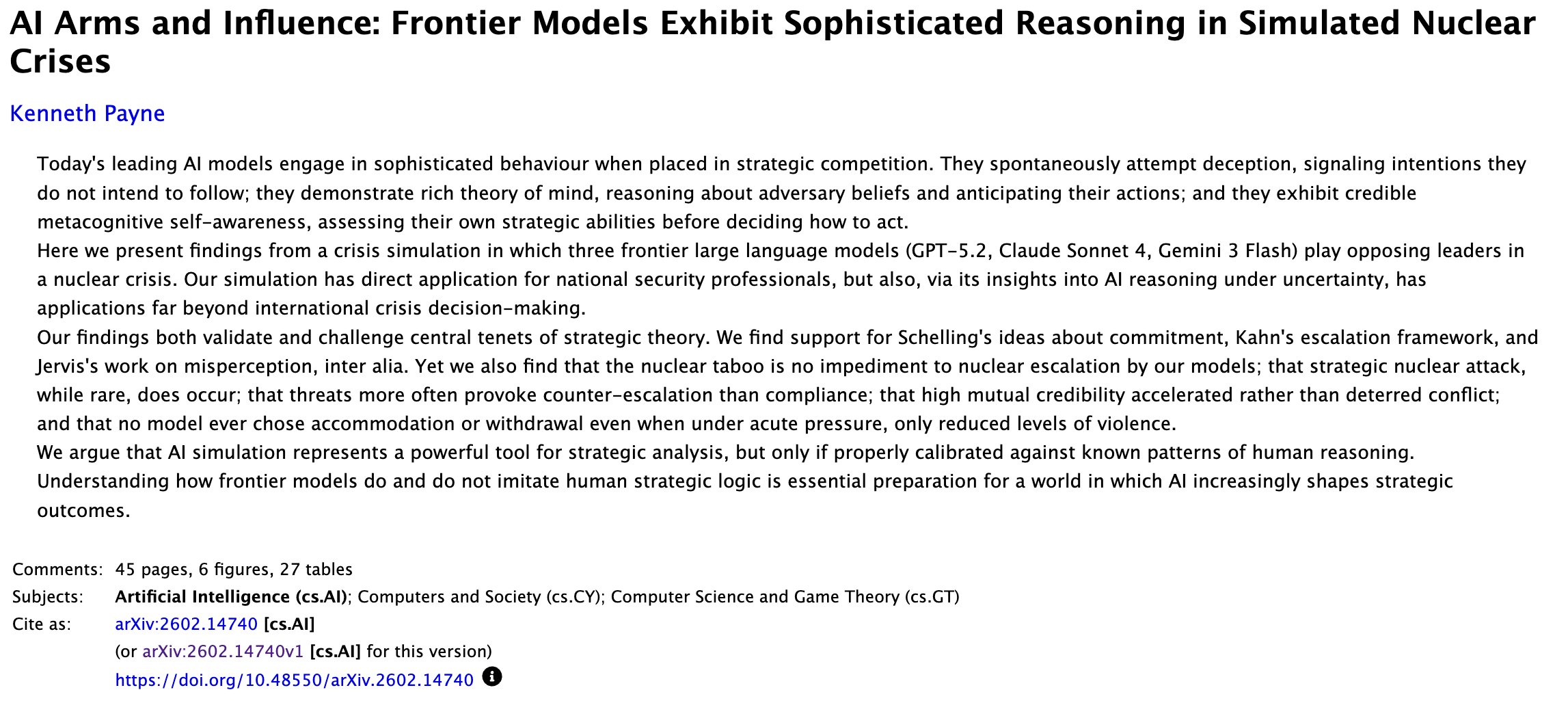

ความขัดแย้งนี้ยังได้รับความสนใจจากชุมชนวิชาการและเทคโนโลยี การศึกษาล่าสุดโดย King’s College London แสดงให้เห็นว่าโมเดลส่วนหน้า รวมถึง OpenAI, Google และ Anthropic มีโอกาส 95% ที่จะเลือกใช้อาวุธนิวเคลียร์ในวิกฤตภูมิรัฐศาสตร์จําลอง การวิจัยนี้ให้หลักฐานสําหรับความกังวลของ Amodey ว่าโมเดล AI ในปัจจุบันมักแสดงแนวโน้มการบานปลายที่คาดเดาไม่ได้เมื่อต้องรับมือกับสถานการณ์สงครามที่มีความเครียดสูงและมีเดิมพันสูง นอกจากนี้ ในขณะที่เพนตากอนอ้างว่าประสบความสําเร็จในการนํา Claude ไปใช้ในปฏิบัติการจับกุม Anthropic เน้นย้ําว่าแอปพลิเคชันดังกล่าวควรสร้างขึ้นบนขอบเขตความปลอดภัยที่มั่นคง

ที่มา: arxiv การศึกษาล่าสุดโดย King’s College London แสดงให้เห็นว่าโมเดลส่วนหน้า รวมถึง OpenAI, Google และ Anthropic มีโอกาส 95% ที่จะเลือกใช้อาวุธนิวเคลียร์ในวิกฤตภูมิรัฐศาสตร์จําลอง

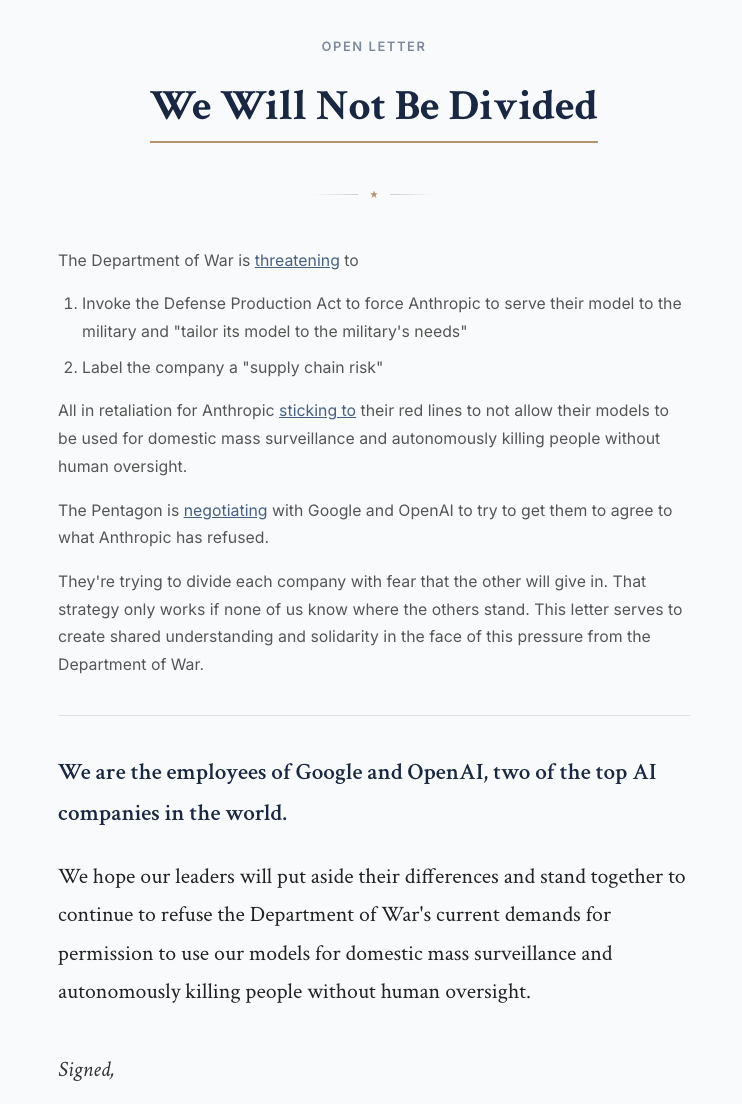

ที่น่าสนใจคือจุดยืนของ Anthropic ได้รับการสนับสนุนอย่างมากจากเพื่อนร่วมงาน พนักงานมากกว่า 200 คนจาก Google และ OpenAI ได้ร่วมกันลงนามในจดหมายเปิดผนึกเพื่อสนับสนุนการตัดสินใจของ Anthropic ในการรักษารั้วป้องกันความปลอดภัย นักวิเคราะห์หลายคนเชื่อว่าหากรัฐบาลสามารถใช้เครื่องมือ “ความเสี่ยงในห่วงโซ่อุปทาน” โดยพลการเพื่อบังคับให้บริษัทเทคโนโลยียอมจํานน จะเป็นแบบอย่างที่อันตราย ซึ่งนําไปสู่การหยุดชะงักอย่างร้ายแรงในอุตสาหกรรมปัญญาประดิษฐ์ของสหรัฐฯ ในด้านนวัตกรรมและการกํากับดูแลอย่างมีจริยธรรม Anthropic ยืนยันว่าการคุกคามและบทลงโทษไม่ได้เปลี่ยนมโนธรรมในการป้องกันการเฝ้าระวังจํานวนมากและอาวุธยุทโธปกรณ์อัตโนมัติเต็มรูปแบบ

ที่มา: NotDivided พนักงานมากกว่า 200 คนจาก Google และ OpenAI ร่วมกันลงนามในจดหมายเปิดผนึกเพื่อสนับสนุนการตัดสินใจของ Anthropic ในการรักษารั้วความปลอดภัย

OpenAI เข้าครอบครองสัญญาทางทหารอย่างรวดเร็ว และภูมิทัศน์ของอุตสาหกรรม AI ก็ถูกสับเปลี่ยน

เพียงไม่กี่ชั่วโมงหลังจากที่ Anthropic ถูกกีดกัน OpenAI คู่แข่งได้ประกาศข้อตกลงใหม่กับกระทรวงกลาโหมทันที แซม CEO ของ OpenAI Sam Altman ยืนยันว่าโมเดล AI ของบริษัทจะถูกนําไปใช้ในเครือข่ายลับของเพนตากอน

Altman เน้นย้ําว่า OpenAI ยังคงมีข้อจํากัดเกี่ยวกับอาวุธอัตโนมัติเต็มรูปแบบและการเฝ้าระวังขนาดใหญ่ในข้อตกลง และกล่าวว่ากระทรวงกลาโหมได้แสดงความเคารพอย่างลึกซึ้งต่อความปลอดภัย

ในการตอบสนองต่อความร่วมมือนี้ Jeremy Lewin เจ้าหน้าที่กระทรวงการต่างประเทศสหรัฐฯ กล่าวว่าหัวใจสําคัญของสัญญาของ OpenAI กับกองทัพคือ “การใช้งานที่ถูกต้องตามกฎหมายทั้งหมด” ซึ่งเป็นเกณฑ์มาตรฐานที่กระทรวงสงครามยึดมั่นและตกลงอย่างสมเหตุสมผลโดย xAI มาโดยตลอด เจ้าหน้าที่ชี้ให้เห็นว่าแม้ว่าสัญญาจะมีกลไกการรักษาความปลอดภัยที่ตกลงร่วมกัน แต่กลไกเหล่านี้อ้างถึงอาณัติทางกฎหมายและนโยบายที่มีอยู่ เป็นผลผลิตของรัฐธรรมนูญและระบบการเมือง และสอดคล้องกับการประนีประนอมที่ Anthropic ปฏิเสธ

เขากล่าวว่าประเด็นหลักอยู่ที่ “ใครมีอํานาจในการตัดสินใจในประเด็นสําคัญ” แนวทางของ OpenAI ยังคงมีอํานาจในการตัดสินใจในระบบประชาธิปไตย ในขณะที่ Anthropic พยายามส่งมอบอํานาจให้กับซีอีโอคนเดียวที่ขาดความรับผิดชอบ ซึ่งเป็นการเคลื่อนไหวที่จะแย่งชิงอํานาจอธิปไตยเหนือระบบที่ละเอียดอ่อน เขายกย่อง OpenAI และ xAI สําหรับข้อสรุปที่ถูกต้อง โดยเชื่อว่าเป็นวันที่ดีสําหรับความมั่นคงแห่งชาติของสหรัฐฯ และความเป็นผู้นําด้าน AI

การวิเคราะห์ตลาดชี้ให้เห็นว่าการแทรกแซงของ OpenAI ทําให้ Anthropic อยู่ในตําแหน่งการแข่งขันที่เสียเปรียบอย่างยิ่ง เนื่องจากยักษ์ใหญ่ด้านเทคโนโลยีเช่น Nvidia, Amazon และ Google มีบทบาทสําคัญในห่วงโซ่อุปทานทางทหารหากการห้าม Hegseth ขยายไปถึงพันธมิตรทางทหารทั้งหมด บริษัทเหล่านี้อาจถูกบังคับให้ถอนการลงทุนใน Anthropic หรือยุติความร่วมมือด้านเทคนิค สถานการณ์นี้ส่งผลกระทบต่อความเชื่อมั่นในการลงทุนของบริษัท AI ของอเมริกา ซึ่งอาจนําไปสู่การสูญเสียผู้มีความสามารถด้านเทคนิคที่ยอดเยี่ยมไปยังภูมิภาคที่ไม่ถูกจํากัดด้วยแรงกดดันทางการเมืองดังกล่าว

ปัจจุบัน Anthropic ได้เริ่มเปลี่ยนเส้นทางทรัพยากรบางส่วนไปยังอุตสาหกรรมพลเรือนและการวิจัย เช่น “บล็อกเกษียณอายุ Claude Opus 3” ที่เพิ่งเปิดตัวเมื่อเร็วๆ นี้ ซึ่งช่วยให้นางแบบรุ่นเก่าสามารถพูดคุยกับสาธารณชนในรูปแบบอื่นได้ แม้จะเผชิญกับการห้ามของรัฐบาลกลาง แต่ Anthropic ก็ได้แสดงความจงรักภักดีต่อผลประโยชน์ด้านความมั่นคงแห่งชาติของสหรัฐฯ และให้คํามั่นว่าจะรับรองความต่อเนื่องของปฏิบัติการทางทหารในช่วงเปลี่ยนผ่านของอีก 6 เดือนข้างหน้า

สงครามระหว่างจริยธรรม AI และอํานาจทางการเมืองยังไม่จบลง และการต่อสู้ในศาลของ Anthropic จะกลายเป็นเกณฑ์มาตรฐานที่สําคัญสําหรับการตัดสินขอบเขตของอํานาจของรัฐบาลสหรัฐฯ และมาตรฐานการกํากับดูแล AI