72 ชั่วโมง, วิบัติสามชั้น: จิตวิญญาณของ Anthropic กำลังถูกประมูล

เขียนโดย: Ada, Deep Tide TechFlow

24 กุมภาพันธ์ วันอังคาร วอชิงตัน ดีซี

Dario Amodei ซีอีโอของ Anthropic นั่งอยู่ตรงข้ามกับรัฐมนตรีกลาโหม Pete Hegseth ตามรายงานของ NPR และ CNN ซึ่งอ้างแหล่งข่าวที่ไม่เปิดเผยชื่อ บรรยากาศการประชุมเป็นไปอย่างสุภาพ แต่เนื้อหาไม่เป็นมิตรเลย

Hegseth ให้คำขาดสุดท้าย: ก่อนเวลา 17:01 น. วันศุกร์ ต้องปลดล็อกการใช้งาน Claude ทางทหาร ให้ Pentagon ใช้งานได้ “ในทุกกรณีที่ถูกกฎหมาย” รวมถึงการเล็งเป้าหมายอาวุธอัตโนมัติและการเฝ้าระวังในประเทศในระดับมวลชน

หากไม่ปฏิบัติตาม จะยกเลิกสัญญามูลค่า 200 ล้านดอลลาร์ เริ่มบังคับใช้กฎหมายการผลิตทางทหาร (Defense Production Act) และจัดให้ Anthropic เป็น “ความเสี่ยงในห่วงโซ่อุปทาน” ซึ่งเทียบเท่ากับการขึ้นบัญชีดำกลุ่มต่อต้านของรัสเซียและจีน

ในวันเดียวกัน Anthropic เปิดตัว “นโยบายขยายความรับผิดชอบ” เวอร์ชัน 3.0 (RSP 3.0) โดยเงียบๆ ลบคำมั่นสัญญาหลักของบริษัทตั้งแต่ก่อตั้งว่า หากไม่สามารถรับประกันความปลอดภัยได้ ก็จะไม่ฝึกโมเดลที่ทรงพลังขึ้น

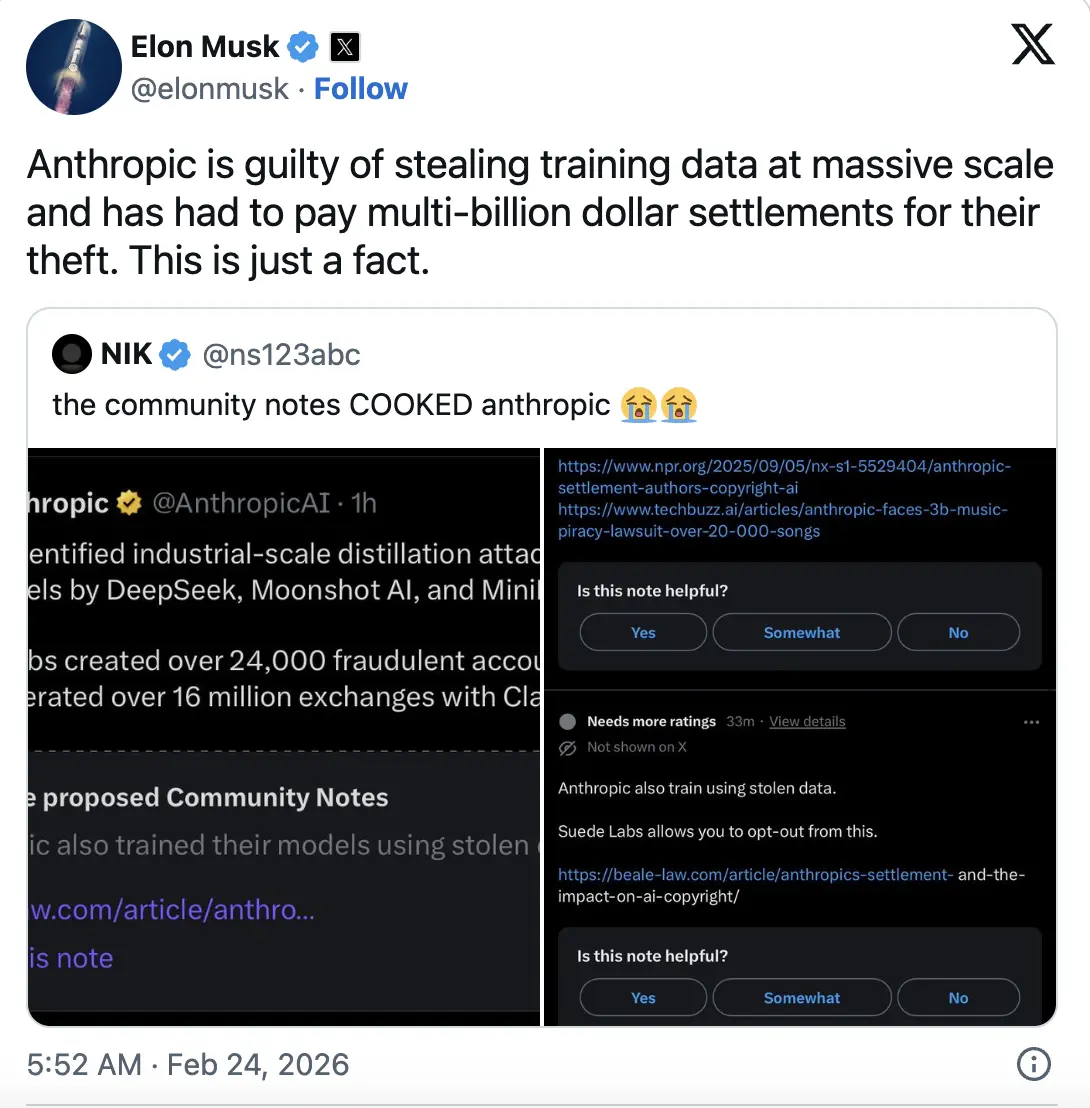

ในวันเดียวกัน Elon Musk โพสต์บน X ว่า “Anthropic กำลังขโมยข้อมูลการฝึกอย่างมหาศาล ซึ่งเป็นความจริง” พร้อมกับคำอธิบายเพิ่มเติมใน Community Notes ของ X ว่า Anthropic จ่ายเงินชดเชย 1.5 พันล้านดอลลาร์ให้กับการฝึก Claude ด้วยข้อมูลจากหนังสือที่ละเมิดลิขสิทธิ์

ใน 72 ชั่วโมง บริษัท AI ที่อ้างว่ามี “จิตวิญญาณ” นี้ กลายเป็นตัวละครสามบทบาทพร้อมกัน: นักสละชีวิตเพื่อความปลอดภัย, ขโมยทรัพย์สินทางปัญญา, และทรยศต่อ Pentagon

อันไหนคือความจริง?

อาจจะทั้งหมด

“Pentagon: ต้องเชื่อฟังหรือออกไป”

เรื่องราวในระดับแรกง่ายมาก

Anthropic เป็นบริษัท AI แห่งแรกที่ได้รับสิทธิ์เข้าถึงข้อมูลลับของกระทรวงกลาโหมสหรัฐฯ สัญญาที่ได้รับเมื่อปีที่แล้ว มีมูลค่าสูงสุด 200 ล้านดอลลาร์ ตามมาด้วย OpenAI, Google, xAI ที่ได้รับสัญญาในระดับเท่ากัน

รายงานจาก Al Jazeera ระบุว่า Claude เคยถูกใช้ในปฏิบัติการของกองทัพสหรัฐฯ เมื่อเดือนมกราคมที่ผ่านมา ซึ่งเป็นปฏิบัติการที่เกี่ยวข้องกับการลักพาตัวประธานาธิบดี Nicolás Maduro ของเวเนซุเอลา

แต่ Anthropic วางเส้นแดงไว้สองเส้น: ไม่สนับสนุนการเล็งเป้าหมายอาวุธอัตโนมัติเต็มรูปแบบ และไม่สนับสนุนการเฝ้าระวังในระดับมวลชนของชาวอเมริกันเอง Anthropic เชื่อว่าความน่าเชื่อถือของ AI ยังไม่เพียงพอที่จะควบคุมอาวุธ และยังไม่มีข้อกฎหมายใดที่ควบคุมการใช้งาน AI ในการเฝ้าระวังในระดับใหญ่

แต่ Pentagon ไม่ยอมรับ

ที่ปรึกษาด้าน AI ของทำเนียบขาว David Sacks เมื่อเดือนตุลาคมปีที่แล้ว โพสต์บน X วิจารณ์ Anthropic ว่า “ใช้ความกลัวเป็นอาวุธในการควบคุม”

คู่แข่งก็ยอมแพ้ไปแล้ว OpenAI, Google, xAI ต่างก็ยินดีให้กองทัพใช้ AI ของตนใน ‘ทุกสถานการณ์ที่ถูกกฎหมาย’ Musk’s Grok ก็เพิ่งได้รับอนุญาตให้เข้าสู่ระบบลับในสัปดาห์นี้

Anthropic เป็นบริษัทสุดท้ายที่ยังยืนหยัด

จนถึงเวลาที่รายงานนี้เผยแพร่ Anthropic แถลงการณ์ล่าสุดว่า พวกเขาไม่ตั้งใจที่จะยอมแพ้ แต่เส้นตาย 17:01 น. วันศุกร์ใกล้เข้ามาแล้ว

แหล่งข่าวจากอดีตเจ้าหน้าที่กระทรวงยุติธรรมและกระทรวงกลาโหมที่ไม่เปิดเผยชื่อ ให้สัมภาษณ์กับ CNN ว่า “คุณจะประกาศว่าบริษัทหนึ่งเป็น ‘ความเสี่ยงในห่วงโซ่อุปทาน’ แล้วบังคับให้ทำงานให้กองทัพได้อย่างไร?”

คำถามดี แต่ไม่ใช่เรื่องที่ Pentagon คิดจะสนใจ พวกเขาใส่ใจแค่ถ้า Anthropic ไม่ยอมปรับตัว ก็จะใช้มาตรการบังคับ หรือปล่อยให้เป็นตัวตลกในวอชิงตัน

“การโจมตีด้วยการกลั่น” — คำกล่าวหาที่เป็นการตบหน้า

เมื่อวันที่ 23 กุมภาพันธ์ Anthropic โพสต์บล็อกที่รุนแรง ระบุว่ามีการโจมตีด้วย “การกลั่นระดับอุตสาหกรรม” ต่อ Claude จาก 3 บริษัท AI จีน ได้แก่ DeepSeek, Moonshot AI และ MiniMax

Anthropic กล่าวหา ว่าใช้บัญชีปลอมกว่า 24,000 บัญชี เพื่อโต้ตอบกับ Claude กว่า 16 ล้านครั้ง โดยมุ่งเป้าไปที่การดึงความสามารถหลักของ Claude ในด้านการวิเคราะห์ การเรียกใช้เครื่องมือ และการเขียนโปรแกรม

บริษัทมองว่าเป็นภัยต่อความมั่นคงของชาติ ระบุว่ารุ่นที่ผ่านการกลั่นนี้ “ไม่น่าจะรักษามาตรการความปลอดภัยไว้ได้” และอาจถูกรัฐบาลเผด็จการใช้ในแฮกเกอร์ การแพร่ข่าวเท็จ และการเฝ้าระวังในระดับมวลชน

เนื้อเรื่องสมบูรณ์แบบและเวลาที่เหมาะสม

พอดีหลังจากที่รัฐบาลทรัมป์ผ่อนคลายการควบคุมส่งออกชิปไปจีนไม่นาน และในช่วงที่ Anthropic กำลังหาเหตุผลสนับสนุนจุดยืนต่อต้านการส่งออกชิปของตนเอง

แต่ Musk ก็เปิดฉากว่า “Anthropic ขโมยข้อมูลการฝึกอย่างมหาศาล และจ่ายเงินชดเชยเป็นพันล้านดอลลาร์ นี่คือความจริง”

Tory Green ผู้ร่วมก่อตั้งบริษัทโครงสร้างพื้นฐาน AI IO.Net กล่าวว่า “คุณฝึกโมเดลด้วยข้อมูลจากทั่วทั้งเว็บ แล้วคนอื่นใช้ API สาธารณะของคุณเรียนรู้จากคุณ นั่นเรียกว่า ‘การกลั่นโจมตี’ หรือเปล่า?”

Anthropic เรียกการกลั่นนี้ว่า “การโจมตี” แต่ในวงการ AI การทำเช่นนี้เป็นเรื่องปกติ OpenAI ใช้มันในการบีบอัด GPT-4 Google ก็ใช้มันในการปรับแต่ง Gemini แม้แต่ Anthropic เองก็ทำอยู่ ความแตกต่างคือ คราวนี้เป็นการกลั่นโมเดลของตัวเอง

อาจารย์ Erik Cambria จาก Nanyang Technological University ของสิงคโปร์ ให้ความเห็นกับ CNBC ว่า “เส้นแบ่งระหว่างการใช้งานอย่างถูกกฎหมายและการใช้งานในทางร้ายมักจะคลุมเครือ”

ยิ่งไปกว่านั้น Anthropic เพิ่งจ่ายเงินชดเชย 1.5 พันล้านดอลลาร์ให้กับการฝึก Claude ด้วยข้อมูลจากหนังสือที่ละเมิดลิขสิทธิ์ แล้วกลับมาฟ้องคนอื่นว่าใช้ API สาธารณะของตนเองเพื่อเรียนรู้โมเดล นี่ไม่ใช่สองมาตรฐาน แต่เป็นสามมาตรฐาน

บริษัทตั้งใจจะเป็นเหยื่อ แต่กลับกลายเป็นจำเลย

การลบคำมั่นสัญญาด้านความปลอดภัย: RSP 3.0

ในวันเดียวกันกับการเผชิญหน้ากับ Pentagon และการต่อสู้ใน Silicon Valley Anthropic เปิดตัวนโยบายขยายความรับผิดชอบเวอร์ชัน 3.0

Jared Kaplan หัวหน้าผู้เชี่ยวชาญด้านวิทยาศาสตร์ของ Anthropic ให้สัมภาษณ์ว่า “เราเชื่อว่าการหยุดฝึก AI ไม่ได้ช่วยใคร ในบริบทของการพัฒนา AI อย่างรวดเร็ว การทำสัญญาแบบฝ่ายเดียว… ไม่มีความหมาย”

พูดอีกนัยหนึ่ง คือ ถ้าคนอื่นไม่เล่นตามกติกา เราก็ไม่ต้องเล่นด้วย

RSP 1.0 และ 2.0 มีจุดศูนย์กลางคือคำมั่นสัญญาแน่นอนว่า หากโมเดลเกินขอบเขตความปลอดภัย ก็จะหยุดฝึก ซึ่งทำให้ Anthropic ได้ชื่อเสียงในวงการความปลอดภัย AI อย่างโดดเด่น

แต่เวอร์ชัน 3.0 ลบคำมั่นนี้ไปแล้ว

แทนที่ด้วยกรอบความคิดที่ “ยืดหยุ่น” มากขึ้น คือ แบ่งเป็นสองเส้นทาง: มาตรการความปลอดภัยที่ Anthropic ทำได้เอง กับคำแนะนำด้านความปลอดภัยที่ต้องอาศัยความร่วมมือจากอุตสาหกรรม ส่งรายงานความเสี่ยงทุก 3-6 เดือน พร้อมให้ผู้เชี่ยวชาญภายนอกตรวจสอบ

ฟังดูรับผิดชอบดีไหม?

Chris Painter นักวิจารณ์อิสระจาก METR หลังอ่านร่างนโยบายเบื้องต้น กล่าวว่า “นี่แสดงให้เห็นว่า Anthropic คิดว่าจำเป็นต้องเข้าสู่ ‘โหมดบำบัด’ เพราะวิธีการประเมินและบรรเทาความเสี่ยงตามความสามารถที่เพิ่มขึ้นไม่ทัน ซึ่งสะท้อนว่ารัฐสังคมยังไม่พร้อมรับมือกับความเสี่ยงร้ายแรงของ AI”

ตามรายงานของ TIME บริษัทใช้เวลาราวหนึ่งปีในการอภิปรายภายในเรื่องการปรับเปลี่ยนนี้ โดย CEO Amodei และคณะกรรมการลงมติเห็นด้วยอย่างเป็นเอกฉันท์ คำชี้แจงอย่างเป็นทางการคือ นโยบายเดิมออกแบบมาเพื่อผลักดันความเห็นร่วมในอุตสาหกรรม แต่สุดท้ายอุตสาหกรรมก็ไม่ตามทัน การบริหารของทรัมป์ก็ปล่อยให้ AI พัฒนาอย่างอิสระ และพยายามยกเลิกกฎหมายที่เกี่ยวข้องในแต่ละรัฐ กฎหมายระดับรัฐบาลกลางยังไม่เกิดขึ้นจริง แม้จะมีความหวังว่าจะสร้างกรอบการกำกับดูแลระดับโลกในปี 2023 แต่เวลาผ่านไปสามปีแล้ว ก็ชัดเจนว่าประตูนี้ปิดสนิท

นักวิจัยอิสระที่ติดตามการกำกับดูแล AI อย่างใกล้ชิด ให้ความเห็นตรงไปตรงมาว่า “RSP คือทรัพย์สินทางแบรนด์ที่มีค่าที่สุดของ Anthropic การลบคำมั่นหยุดฝึกโมเดลก็เท่ากับการที่บริษัทอาหารออร์แกนิกเอาคำว่า ‘ออร์แกนิก’ ออกจากบรรจุภัณฑ์ แล้วบอกว่าตอนนี้การตรวจสอบของพวกเขาโปร่งใสมากขึ้น”

มูลค่า 380 พันล้านและความแตกแยกในตัวตน

ต้นเดือนกุมภาพันธ์ Anthropic ระดมทุนได้ 3 พันล้านดอลลาร์ โดยมีมูลค่าบริษัท 380 พันล้านดอลลาร์ โดย Amazon เป็นนักลงทุนหลัก รายได้ประจำปีของบริษัทอยู่ที่ 14 พันล้านดอลลาร์ และเติบโตขึ้นกว่าเท่าตัวใน 3 ปีที่ผ่านมา

ในเวลาเดียวกัน Pentagon ก็ขู่ว่าจะขึ้นบัญชีดำบริษัทนี้ Musk ก็ออกมาวิจารณ์ว่าขโมยข้อมูลของตนเอง ขณะที่ความมั่นคงของ AI ของ Anthropic ก็ถูกลบออกไปแล้ว หลังจากที่ Mrinank Sharma หัวหน้าฝ่ายความปลอดภัยของ AI ลาออก ก็โพสต์บน X ว่า “โลกกำลังอยู่ในอันตราย”

ความขัดแย้ง?

อาจเป็นความขัดแย้งในพันธุกรรมของ Anthropic เอง

บริษัทนี้ก่อตั้งโดยอดีตผู้บริหารของ OpenAI ซึ่งกลัวว่า OpenAI จะเดินหน้าเร็วเกินไปด้านความปลอดภัย แล้วพวกเขาก็สร้างบริษัทใหม่ขึ้นมา เพื่อพัฒนาโมเดลที่ทรงพลังขึ้นอย่างรวดเร็ว พร้อมกับประกาศให้โลกรู้ว่าโมเดลเหล่านี้อันตรายแค่ไหน

โมเดลธุรกิจของพวกเขาสรุปง่ายๆ ว่า เรากลัว AI มากกว่าคนอื่น คุณควรจ่ายเงินให้เราเพื่อสร้าง AI

เรื่องราวนี้ดำเนินมาตั้งแต่ปี 2023-2024 โดย AI ความปลอดภัยกลายเป็นคำฮิตในวอชิงตัน และ Anthropic ก็กลายเป็นผู้สนับสนุนการล็อบบี้รายสำคัญ

แต่ในปี 2026 กระแสเปลี่ยน

“woke AI” กลายเป็นคำโจมตี รัฐบาลกลางบล็อกกฎหมายควบคุม AI ของรัฐ Anthropic สนับสนุนร่างกฎหมาย SB 53 ของแคลิฟอร์เนีย ซึ่งผ่านกฎหมายแล้ว แต่ระดับรัฐบาลกลางกลับว่างเปล่า

กลยุทธ์ด้านความปลอดภัยของ Anthropic กำลังเปลี่ยนจาก “ความได้เปรียบเชิงความแตกต่าง” ไปเป็น “ภาระทางการเมือง”

พวกเขากำลังทำสมดุลที่ซับซ้อน ต้องมีความปลอดภัยพอที่จะรักษาแบรนด์ แต่ก็ต้องมีความยืดหยุ่นพอที่จะไม่ถูกตลาดและรัฐบาลทิ้งห่าง ปัญหาคือ ความอดทนของทั้งสองฝ่ายกำลังลดลงเรื่อยๆ

ความคุ้มค่าของการเล่าเรื่องความปลอดภัย

เมื่อมองภาพรวมสามเรื่องนี้พร้อมกัน จะเห็นภาพชัดเจนขึ้น

การกล่าวหา Chinese companies ว่า “กลั่น” Claude เป็นการสร้างเรื่องสนับสนุนการควบคุมส่งออกชิปในทางการเมือง การลบคำมั่นหยุดฝึกโมเดลเพื่อไม่ให้ตกเทรนด์ในสงครามอาวุธ การปฏิเสธคำขอของ Pentagon สำหรับอาวุธอัตโนมัติ ก็ล้วนแต่เป็นเหตุผลที่มีตรรกะ

แต่ทุกก้าวก็ขัดแย้งกันเอง

คุณไม่สามารถบอกได้ว่า Chinese companies “กลั่น” โมเดลของคุณแล้วเป็นอันตรายต่อความมั่นคงชาติ แล้วก็ลบคำมั่นสัญญาป้องกันโมเดลของตัวเอง ถ้าโมเดลมันอันตรายจริง คุณควรระมัดระวังมากกว่านี้ ไม่ใช่รุนแรงขึ้น

ถ้าคุณเป็น Anthropic

ในวงการ AI สถานะไม่ได้ถูกกำหนดโดยคำประกาศ แต่โดยงบดุลของคุณ “ความปลอดภัย” ของ Anthropic เป็นเพียงการสร้างแบรนด์ที่มีมูลค่าเพิ่ม

ในสงครามอาวุธ AI ช่วงแรก มูลค่านี้คุ้มค่า นักลงทุนยอมจ่ายสูงขึ้นเพื่อ “AI ที่รับผิดชอบ” รัฐบาลก็อนุญาตให้ใช้ “AI ที่เชื่อถือได้” ลูกค้าก็ยอมจ่ายเพื่อ “AI ที่ปลอดภัยกว่า”

แต่ในปี 2026 มูลค่าเหล่านี้กำลังจางหายไป

ตอนนี้ Anthropic ไม่ใช่แค่ต้องเลือกว่าจะยอมแพ้หรือไม่ แต่เป็นลำดับความสำคัญของใครจะยอมแพ้ก่อน ถ้ายอม Pentagon ก็เสียชื่อเสียง ถ้ายอมคู่แข่ง ก็คำมั่นสัญญาด้านความปลอดภัยก็สูญเปล่า ถ้ายอมให้นักลงทุน ก็ต้องเสียทั้งสองฝ่าย

วันศุกร์บ่าย 17:01 Anthropic จะเปิดเผยคำตอบของมัน

แต่ไม่ว่าจะเป็นคำตอบอะไร สิ่งหนึ่งที่แน่นอนคือ: Anthropic ซึ่งเคยตั้งตัวบนคำว่า “เราแตกต่างจาก OpenAI” กำลังกลายเป็นเหมือนทุกคนแล้ว

วิกฤตตัวตน สุดท้ายอาจเป็นการสูญเสียตัวตน