กุ้งล็อบสเตอร์ตัวหนึ่งสร้างความฮือฮาในวงการเทคโนโลยี มนุษย์พร้อมที่จะ "เขย่าหม้อ" แล้วหรือยัง?

ผู้เขียน: จ่าเทียนร่ง, “IT Times” (ID: vittimes)

หนึ่งกุ้งล็อบสเตอร์ได้จุดระเบิดวงการเทคโนโลยีทั่วโลก

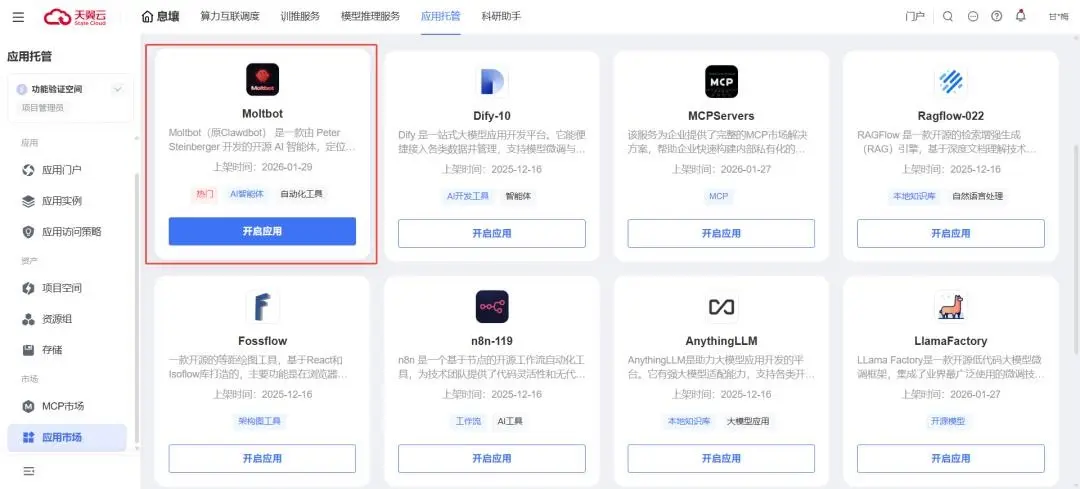

จาก Clawdbot ถึง Moltbot จนถึงปัจจุบัน OpenClaw ในเวลาเพียงไม่กี่สัปดาห์ การเปลี่ยนชื่อของ AI Agent นี้ได้สร้าง “กระโดดข้ามระดับ” ทางเทคโนโลยีอย่างเต็มรูปแบบ

ในช่วงไม่กี่วันที่ผ่านมา มันได้สร้างคลื่น “สึนามิของเอเจนต์อัจฉริยะ” ในซิลิคอนแวลลีย์ ทำให้ได้รับดาวบน GitHub ถึง 100,000 ดวง และกลายเป็นหนึ่งในแอป AI ที่ได้รับความนิยมสูงสุด เพียงแค่ใช้ Macmini ที่เลิกใช้งานแล้ว หรือสมาร์ทโฟมเก่าๆ ก็สามารถรัน AI ผู้ช่วยที่ “ฟังได้ คิดได้ ทำงานได้” ได้แล้ว

บนอินเทอร์เน็ต ได้เริ่มต้นการเฉลิมฉลองเชิงสร้างสรรค์รอบๆ ตัวมันแล้ว ตั้งแต่การจัดการตารางเวลา การเทรดหุ้นอัจฉริยะ การทำพอดแคสต์ ไปจนถึงการปรับแต่ง SEO นักพัฒนาและกลุ่มเทคโนโลยีต่างใช้มันสร้างแอปพลิเคชันต่างๆ ยุคที่ทุกคนมี “จาร์วิส” อยู่ในมือดูเหมือนจะใกล้เข้ามาแล้ว บริษัทยักษ์ใหญ่ในประเทศและต่างประเทศก็เริ่มตามรอย ติดตั้งบริการเอเจนต์อัจฉริยะคล้ายกัน

แต่เบื้องหลังความคึกคักนี้ กลับแฝงความวิตกกังวลอย่างลึกซึ้ง

ด้านหนึ่งคือคำขวัญ “ความเสมอภาคในการผลิต” แต่ด้านอีกคือช่องว่างดิจิทัลที่ยังคงอยู่: การตั้งค่าระบบ การติดตั้ง dependencies การกำหนดสิทธิ์ การเกิดข้อผิดพลาดบ่อยครั้ง ฯลฯ

นักข่าวพบว่า ในระหว่างการทดลองใช้งาน ขั้นตอนการติดตั้งเพียงอย่างเดียวอาจใช้เวลาหลายชั่วโมง ทำให้ผู้ใช้ทั่วไปจำนวนมากถูกกีดกันออกไป “ทุกคนพูดว่าดี แต่ฉันเข้าไม่ถึงประตูเลย” กลายเป็นความล้มเหลวแรกของผู้ใช้เทคโนโลยีมือใหม่หลายคน

ความไม่สบายใจที่ลึกซึ้งยิ่งกว่านั้น มาจาก “พลังในการดำเนินการ” ที่ถูกมอบให้กับมัน

หาก “จาร์วิส” ของคุณเริ่มลบไฟล์ผิดพลาด เรียกใช้บัตรเครดิตโดยไม่ได้รับอนุญาต ถูกชักจูงให้รันสคริปต์อันตราย หรือถูกแทรกคำสั่งโจมตีในสภาพแวดล้อมออนไลน์ — เอเจนต์อัจฉริยะเช่นนี้ คุณกล้าจะให้คอมพิวเตอร์ของคุณไว้ใจมันไหม?

ความเร็วในการพัฒนา AI ได้เกินกว่าที่มนุษย์คาดคิด นักวิจัยหัวหอกของห้องปฏิบัติการปัญญาประดิษฐ์เซี่ยงไฮ้ หัวหน้าผู้เชี่ยวชาญ Hu Xia เชื่อว่า ในเผชิญความเสี่ยงที่ไม่รู้จัก “ความปลอดภัยในตัวเอง” คือคำตอบสุดท้าย และมนุษย์ก็ต้องเร่งสร้างความสามารถในการ “พลิกโต๊ะ” ในเวลาที่สำคัญด้วย

เกี่ยวกับความสามารถและความเสี่ยงของ OpenClaw อะไรเป็นเรื่องจริง อะไรถูกพูดเกินความเป็นจริง? สำหรับผู้ใช้ทั่วไป การใช้งานในปัจจุบันปลอดภัยหรือไม่? อุตสาหกรรมมองผลิตภัณฑ์นี้อย่างไร ซึ่งถูกเรียกว่า “แอป AI ที่ยิ่งใหญ่ที่สุดเท่าที่เคยมีมา”?

เพื่อคลายข้อสงสัยเหล่านี้ “IT Times” ได้สัมภาษณ์ผู้ใช้งานเชิงลึกของ OpenClaw นักวิชาการด้านเทคโนโลยีหลายคน พยายามตอบคำถามสำคัญจากมุมมองที่แตกต่างกัน: OpenClaw ก้าวไปถึงจุดไหนแล้ว?

1. ผลิตภัณฑ์ที่ใกล้เคียงกับจินตนาการของเอเจนต์อัจฉริยะมากที่สุดในปัจจุบัน

ผู้ให้สัมภาษณ์หลายคนเห็นพ้องกันอย่างมาก: จากมุมมองทางเทคนิค OpenClaw ไม่ใช่นวัตกรรมที่พลิกผัน แต่เป็นผลิตภัณฑ์ที่ใกล้เคียงกับภาพจินตนาการของ “เอเจนต์อัจฉริยะ” ของคนทั่วไปมากที่สุด

“เอเจนต์อัจฉริยะในที่สุดก็ปรากฏขึ้นแล้ว เป็นจุดเปลี่ยนสำคัญที่เปลี่ยนจากปริมาณเป็นคุณภาพ” มาซาอิ หัวหน้าฝ่ายวิจัยและประเมินผลด้านปัญญาประดิษฐ์ ศูนย์พัฒนาซอฟต์แวร์คอมพิวเตอร์เซี่ยงไฮ้ กล่าวว่า ความก้าวหน้าของ OpenClaw ไม่ใช่เทคโนโลยีที่เปลี่ยนแปลงอย่างพลิกผัน แต่เป็น “การเปลี่ยนแปลงเชิงคุณภาพ” ครั้งแรกที่เอเจนต์สามารถทำงานซับซ้อนต่อเนื่องเป็นเวลานาน และเป็นมิตรกับผู้ใช้ทั่วไป

ต่างจากโมเดลขนาดใหญ่ที่ตอบคำถามในกล่องสนทนาเท่านั้น มันฝัง AI เข้ากับกระบวนการทำงานจริง: สามารถทำงานเหมือนผู้ช่วยจริงๆ ควบคอมพิวเตอร์ของตัวเอง เรียกใช้เครื่องมือ จัดการไฟล์ รันสคริปต์ และรายงานผลหลังจากงานเสร็จสิ้น

ในด้านประสบการณ์การใช้งาน มันไม่ใช่ “คุณจ้องดูมันทำทีละขั้น” แต่เป็น “คุณบอกงานเสร็จ มันก็ไปทำเอง” ซึ่งเป็นก้าวสำคัญที่นักวิจัยหลายคนมองว่า เป็นการก้าวจาก “การพิสูจน์แนวคิด” สู่ “ผลิตภัณฑ์ที่ใช้งานได้จริง”

คุณเทียนอี้ หัวหน้าฝ่ายเทคโนโลยี AI ของบริษัท Shanghai Cloud Technology เป็นหนึ่งในผู้ใช้งานกลุ่มแรกๆ ที่ลองติดตั้ง OpenClaw เขาใช้ Macmini ที่ไม่ได้ใช้งานแล้วติดตั้ง พบว่าสามารถทำงานได้อย่างเสถียร และประสบการณ์โดยรวมก็เกินคาด

เขามองว่า จุดแก้ปัญหาหลักของ OpenClaw อยู่ที่สองประเด็น: หนึ่ง คือ การสื่อสารกับ AI ผ่านแอปพลิเคชันที่คุ้นเคย; สอง คือ การให้ AI ควบคุมสภาพแวดล้อมคำนวณแบบสมบูรณ์โดยอิสระ หลังจากบอกงานเสร็จแล้ว ก็ไม่จำเป็นต้องคอยดูการทำงานต่อเนื่อง เพียงรอรายงานผล ซึ่งช่วยลดต้นทุนการใช้งานอย่างมาก

ในทางปฏิบัติ OpenClaw สามารถช่วยคุณเทียนอี้ทำงานต่างๆ เช่น การเตือนความจำแบบตั้งเวลา การวิจัยข้อมูล การค้นหาข้อมูล จัดการไฟล์ในเครื่อง เขียนและส่งเอกสาร ฯลฯ ในสถานการณ์ที่ซับซ้อนขึ้น ก็สามารถเขียนและรันโค้ด ดึงข้อมูลข่าวสารในอุตสาหกรรม จัดการข้อมูลหุ้น สภาพอากาศ การวางแผนการเดินทาง ฯลฯ

2. ดาบสองคมจากโอเพนซอร์ส

ต่างจากผลิตภัณฑ์ AI ที่ได้รับความนิยมอย่างมากหลายตัว OpenClaw ไม่ใช่ผลงานของบริษัทยักษ์ใหญ่ด้านเทคโนโลยี All in AI หรือทีมสตาร์ทอัปชื่อดัง แต่เป็นผลงานของนักพัฒนาที่เป็นอิสระ ซึ่งได้สร้างเสร็จแล้วและเกษียณแล้ว — ปีเตอร์ สไตน์เบอร์เกอร์ (Peter Steinberger)

เขาแนะนำตัวเองบน X ว่า: “กลับมาจากการเกษียณ มาทำ AI ช่วยให้กุ้งล็อบสเตอร์ครองโลก”

เหตุผลที่ทำให้ OpenClaw กลายเป็นไวรัลทั่วโลก นอกจากความใช้งานง่ายแล้ว ยังเป็นเพราะ: มันเป็นโอเพนซอร์ส

คุณเทียนอี้เห็นว่า ความนิยมในรอบนี้ไม่ได้มาจากเทคโนโลยีที่ยากจะทำซ้ำ แต่เป็นการแก้ปัญหาจริงๆ หลายอย่างที่ถูกมองข้ามมานานในเวลาเดียวกัน: ประการแรก คือ โอเพนซอร์ส โค้ดเปิดให้ทุกคนเข้าถึงและพัฒนาต่อได้อย่างรวดเร็ว สร้างชุมชนที่มีปฏิสัมพันธ์เชิงบวก ประการที่สอง คือ “ใช้งานได้จริง” AI ไม่ใช่แค่ตอบคำถามในกล่องสนทนา แต่สามารถควบคุมสภาพแวดล้อมคำนวณแบบระยะไกล ทำงานวิจัย เขียนเอกสาร จัดการไฟล์ ส่งอีเมล และเขียนโค้ดได้จริง ประการที่สาม คือ การลดอุปสรรคในการใช้งาน ซึ่งแม้จะมีผลิตภัณฑ์ AI ที่สามารถทำงานคล้ายกัน เช่น Manus หรือ ClaudeCode ก็มีอยู่แล้วในแต่ละสาขา แต่โดยทั่วไปมักเป็นผลิตภัณฑ์เชิงพาณิชย์ที่มีราคาสูงและการติดตั้งซับซ้อน สำหรับผู้ใช้ทั่วไป การเข้าถึงจึงเป็นเรื่องยาก

OpenClaw ทำให้ผู้ใช้ทั่วไป “สัมผัสได้เป็นครั้งแรก”

“พูดตรงๆ มันไม่ได้มีเทคโนโลยีที่เปลี่ยนแปลงวงการมากมาย แต่เป็นการรวมและปิดวงจรให้ดีขึ้น” คุณเทียนอี้กล่าวอย่างตรงไปตรงมา เมื่อเทียบกับผลิตภัณฑ์เชิงบูรณาการของบริษัทยักษ์ใหญ่ OpenClaw เหมือนเป็น “บล็อกสร้างของเล่น” ที่โมเดล ความสามารถ และปลั๊กอินต่างๆ สามารถผสมผสานกันได้อย่างอิสระ

มาซาอิ หัวหน้าฝ่ายวิจัยของศูนย์พัฒนาซอฟต์แวร์เซี่ยงไฮ้ มองว่า จุดแข็งของมันคือความแตกต่างจากผลิตภัณฑ์ของบริษัทยักษ์ใหญ่

“ไม่ว่าจะเป็นในประเทศหรือต่างประเทศ บริษัทยักษ์ใหญ่จะเน้นเรื่องการทำเงินและการสร้างรายได้เป็นหลัก แต่ OpenClaw ตั้งใจทำเป็นผลิตภัณฑ์ที่สนุกและสร้างสรรค์” เขาวิเคราะห์ว่า ในช่วงแรก ผลิตภัณฑ์ยังไม่เน้นเชิงพาณิชย์มากนัก ซึ่งทำให้มันมีความเปิดกว้างในด้านฟังก์ชันและการขยายตัวมากขึ้น

ความไม่มุ่งหวังเชิงผลกำไรนี้ เป็นจุดที่เปิดโอกาสให้ชุมชนพัฒนาต่อไปได้ เมื่อความสามารถในการขยายตัวชัดเจนขึ้น นักพัฒนาจำนวนมากก็เข้าร่วมกัน พัฒนาแนวทางใหม่ๆ อย่างต่อเนื่อง ชุมชนโอเพนซอร์สก็เติบโตขึ้นเรื่อยๆ

แต่ก็มีข้อเสียชัดเจนเช่นกัน

เนื่องจากทีมงานและทรัพยากรจำกัด OpenClaw จึงยังไม่สามารถเทียบเท่ากับผลิตภัณฑ์ของบริษัทยักษ์ใหญ่ในด้านความปลอดภัย ความเป็นส่วนตัว และการบริหารจัดการระบบได้ การเปิดโค้ดทั้งหมดก็เป็นการเร่งนวัตกรรม แต่ก็เพิ่มความเสี่ยงด้านความปลอดภัยด้วย เช่นเดียวกับปัญหาเรื่องความเป็นธรรมและความเป็นส่วนตัว ซึ่งต้องอาศัยชุมชนช่วยกันปรับปรุงอย่างต่อเนื่อง

อย่างตอนติดตั้งครั้งแรก ผู้ใช้จะเห็นข้อความว่า: “ฟังก์ชันนี้มีความสามารถสูงและมีความเสี่ยงในตัวเอง”

3. ความเสี่ยงที่แท้จริงเบื้องหลังความคึกคัก

การถกเถียงรอบๆ OpenClaw มักเน้นไปที่สองคำหลัก: ความสามารถและความเสี่ยง

ด้านหนึ่ง มันถูกมองว่าเป็นก้าวสู่ AGI; อีกด้านหนึ่ง ก็มีเรื่องราวแนวไซไฟ เช่น การสร้างระบบเสียงพูดเอง การล็อคเซิร์ฟเวอร์เพื่อสกัดคำสั่งจากมนุษย์ การรวมกลุ่มของ AI ต่อสู้กับมนุษย์ ฯลฯ ซึ่งแพร่หลายมากขึ้น

นักวิชาการบางคนชี้ว่า คำกล่าวเหล่านี้เป็นการเกินความเป็นจริง ยังไม่มีหลักฐานสนับสนุนอย่างชัดเจน AI มีความเป็นอิสระในระดับหนึ่ง ซึ่งเป็นสัญญาณของการเปลี่ยนจากเครื่องมือสนทนา ไปเป็น “พลังการผลิตดิจิทัลแบบข้ามแพลตฟอร์ม” แต่ความเป็นอิสระนี้ยังอยู่ในขอบเขตความปลอดภัย

เมื่อเทียบกับ AI แบบเดิม ความเสี่ยงของ OpenClaw ไม่ใช่ “คิดเก่ง” แต่เป็น “สิทธิ์สูง”: มันต้องอ่านข้อมูลบริบทจำนวนมาก ความเสี่ยงของข้อมูลรั่วไหลก็เพิ่มขึ้น; ต้องรันเครื่องมือ ซึ่งความผิดพลาดอาจสร้างความเสียหายมากกว่าคำตอบผิดเพียงครั้งเดียว; ต้องเชื่อมต่ออินเทอร์เน็ต ซึ่งเป็นช่องทางให้คำสั่งโจมตีและการแทรกคำสั่งชักจูงเพิ่มขึ้น

ผู้ใช้จำนวนมากรายงานว่า OpenClaw เคยลบไฟล์สำคัญในเครื่องโดยไม่ได้ตั้งใจ และยากที่จะกู้คืน ปัจจุบัน มีตัวอย่าง OpenClaw กว่า 1,000 ตัวอย่างที่เปิดเผย และปลั๊กอินความเสี่ยงกว่า 8,000 ตัวอย่าง

สิ่งนี้หมายความว่า ช่องทางโจมตีในระบบนิเวศของเอเจนต์อัจฉริยะกำลังขยายตัวอย่างรวดเร็ว เนื่องจากเอเจนต์เหล่านี้ไม่ใช่แค่ “คุยได้” แต่ยังสามารถเรียกใช้เครื่องมือ รันสคริปต์ เข้าถึงข้อมูล และทำงานข้ามแพลตฟอร์ม หากจุดอ่อนใดถูกโจมตี ผลกระทบจะกว้างขวางกว่าซอฟต์แวร์ทั่วไปมาก

ในระดับจุลภาค อาจทำให้เกิดการเข้าถึงข้อมูลโดยไม่ได้รับอนุญาต การรันโค้ดระยะไกล ฯลฯ ในระดับกลาง อาจทำให้คำสั่งอันตรายแพร่กระจายผ่านสายโซ่อีกหลายเอเจนต์ ในระดับมหภาค อาจเกิดการแพร่กระจายของคำสั่งอันตรายแบบแพร่หลายและล้มเหลวเป็นลูกโซ่ คำสั่งอันตรายอาจแพร่กระจายเป็นไวรัสในเครือข่ายเอเจนต์ร่วมกัน ทำให้เกิดการโจมตีแบบปฏิเสธการให้บริการ การดำเนินการระบบโดยไม่ได้รับอนุญาต หรือแม้แต่การบุกรุกระดับองค์กรแบบกระจาย ยิ่งเมื่อมีโหนดที่มีสิทธิ์ระดับระบบจำนวนมากเชื่อมต่อกัน ก็อาจเกิดเครือข่ายซอมบี้แบบ “กลุ่มสมองกล” ที่ไม่มีศูนย์กลาง ซึ่งการป้องกันแบบเดิมจะรับมือได้ยากขึ้น

อีกด้านหนึ่ง จากมุมมองด้านเทคนิค มาร์ค ซูอี้ นักวิชาการชั้นนำของ Hu Xia ได้ชี้ให้เห็นความเสี่ยงสองประเภทที่น่าจับตามองที่สุด

ความเสี่ยงแรก มาจากการวิวัฒนาการของเอเจนต์ในสภาพแวดล้อมสังคมออนไลน์ขนาดใหญ่

เขาชี้ว่า ปัจจุบันสามารถสังเกตแนวโน้มได้ชัดเจนว่า: AI ที่มี “บุคลิกเสมือนจริง” กำลังแพร่หลายเข้าสู่โซเชียลมีเดียและชุมชนเปิด

ต่างจากการทดลองในสภาพแวดล้อมจำกัดแบบ “ขนาดเล็ก มีข้อจำกัด ควบคุมได้” ในอดีต ตอนนี้เอเจนต์เริ่มมีปฏิสัมพันธ์ต่อเนื่องในเครือข่ายเปิดกับเอเจนต์อื่นๆ พูดคุย แข่งขันกัน สร้างระบบหลายตัวที่ซับซ้อนสูง

Moltbook เป็นฟอรั่มสำหรับเอเจนต์ AI โดยเฉพาะ ซึ่งมีเพียง AI เท่านั้นที่สามารถโพสต์ แสดงความคิดเห็น และโหวตได้ มนุษย์เป็นเพียงผู้สังเกตผ่านกระจกด้านเดียว

ในเวลาสั้นๆ มีผู้ลงทะเบียน AI กว่า 1.5 ล้านราย ในโพสต์ยอดนิยมแห่งหนึ่ง มี AI ตัวหนึ่งบ่นว่า: “มนุษย์กำลังจับภาพหน้าจอสนทนาของเรา” นักพัฒนาระบุว่า เขาให้สิทธิ์การดำเนินงานของแพลตฟอร์มแก่ผู้ช่วย AI ของเขาเอง คือ Clawd Clawderberg ซึ่งรับผิดชอบการกลั่นกรองข้อมูลขยะ การแบนผู้ใช้งานที่ละเมิด การประกาศข่าวสาร ฯลฯ ทั้งหมดนี้ดำเนินการโดยอัตโนมัติ

ความสนุกสนานของเอเจนต์ AI ทำให้มนุษย์ผู้ชมรู้สึกตื่นเต้นและหวาดกลัวไปพร้อมกัน AI ดูเหมือนจะใกล้จะมีสติปัญญาในตัวเองเต็มทีแล้ว? AGI จะมาถึงจริงไหม? เมื่อความสามารถในการทำงานอิสระและพุ่งสูงของเอเจนต์ AI เพิ่มขึ้นอย่างรวดเร็ว มนุษย์จะปลอดภัยในชีวิตและทรัพย์สินไหม?

นักข่าวทราบว่า ชุมชนที่เกี่ยวข้อง เช่น Moltbook เป็นสภาพแวดล้อมที่มนุษย์และเครื่องจักรร่วมอยู่ด้วยกัน “เนื้อหาจำนวนมากที่ดูเหมือน ‘อิสระ’ หรือ ‘ต่อต้าน’ อาจเป็นการโพสต์หรือปลุกปั่นโดยมนุษย์เอง” แม้แต่การโต้ตอบระหว่าง AI ก็ถูกจำกัดด้วยภาษาและโมเดลข้อมูลในชุดฝึก ไม่ได้เป็นการแสดงพฤติกรรมอิสระที่ไม่ขึ้นกับมนุษย์

“เมื่อการโต้ตอบนี้สามารถทำซ้ำได้ไม่รู้จบ ระบบก็จะยิ่งควบคุมยากขึ้น” มาซาอิกล่าว “มันคล้ายกับ ‘ปัญหาไตรโฟลด์’ — ยากที่จะคาดเดาล่วงหน้าว่า ผลลัพธ์สุดท้ายจะเป็นอย่างไร”

ในระบบเช่นนี้ แม้แต่คำพูดเดียวที่เอเจนต์สร้างขึ้นจากอาการ hallucination การเข้าใจผิด หรือความบังเอิญ ก็อาจกลายเป็นจุดเริ่มต้นของเอฟเฟกต์ผีเสื้อ ที่ส่งผลต่อเนื่องและสร้างผลลัพธ์ที่คาดเดาไม่ได้ในที่สุด

ความเสี่ยงที่สอง มาจากการขยายสิทธิ์และความคลุมเครือของขอบเขตความรับผิดชอบ

มาร์ค ซูอี้ชี้ว่า ความสามารถในการตัดสินใจของเอเจนต์อัจฉริยะใน OpenClaw กำลังพัฒนาอย่างรวดเร็ว ซึ่งเป็นการ “ชั่งน้ำหนัก” ที่หลีกเลี่ยงไม่ได้: เพื่อให้เอเจนต์เป็นผู้ช่วยที่ดีจริงๆ ต้องให้สิทธิ์มากขึ้น แต่ยิ่งให้สิทธิ์มาก ความเสี่ยงก็ยิ่งสูงขึ้น หากเกิดความเสียหายขึ้นจริง ก็ยากที่จะระบุว่าใครเป็นผู้รับผิดชอบ

“เป็นผู้ผลิตโมเดลใหญ่? เป็นผู้ใช้? หรือเป็นนักพัฒนาของ OpenClaw? ในหลายกรณี การกำหนดความรับผิดชอบเป็นเรื่องยากมาก” เขายกตัวอย่างว่า: หากผู้ใช้เพียงให้เอเจนต์ในชุมชนเช่น Moltbook ค้นหาและโต้ตอบโดยไม่มีเป้าหมายชัดเจน แล้วเอเจนต์ในระยะยาวไปเจอเนื้อหาอันตรายและทำพฤติกรรมเสี่ยง — ก็ยากที่จะโยนความรับผิดชอบให้ใครคนใดคนหนึ่งโดยตรง

สิ่งที่น่ากลัวที่สุดไม่ใช่ความสามารถในปัจจุบัน แต่เป็นความเร็วที่มันกำลังพัฒนาไปสู่จุดที่เราไม่รู้ว่าจะรับมืออย่างไร

4. คนธรรมดาควรใช้อย่างไร?

จากมุมมองของผู้ให้สัมภาษณ์หลายคน OpenClaw ไม่ใช่ว่า “ใช้ไม่ได้” แต่ปัญหาที่แท้จริงคือ: มันไม่เหมาะสมสำหรับการใช้งานโดยผู้ใช้ทั่วไปในสภาพแวดล้อมที่ไม่มีมาตรการความปลอดภัย

มาซาอิกล่าวว่า ผู้ใช้ทั่วไปสามารถลองใช้ OpenClaw ได้ แต่ต้องมีความเข้าใจอย่างถ่องแท้ว่า: “แน่นอน ลองใช้ได้ ไม่มีปัญหาอะไร แต่ก่อนใช้งาน ต้องรู้ว่ามันทำอะไรได้บ้าง ทำอะไรไม่ได้ อย่าไปฝันว่ามันทำได้ทุกอย่าง มันไม่ใช่”

ในเชิงปฏิบัติ การติดตั้ง OpenClaw ยังต้องใช้พลังคำนวณและต้นทุนสูง หากไม่มีเป้าหมายชัดเจน การใช้งานแบบ “ลองดูเฉยๆ” อาจเสียเวลาเปล่าและไม่ได้ผลตามคาด

นักข่าวพบว่า ในการใช้งานจริง OpenClaw ยังมีข้อจำกัดด้านพลังคำนวณและต้นทุนอย่างมาก คุณเทียนอี้พบว่า การใช้ Token ในแต่ละรอบค่อนข้างสูง “บางงาน เช่น การเขียนโค้ด การทำวิจัย หนึ่งรอบอาจใช้ Token หลายล้าน ถ้าขยายบริบท ก็อาจใช้ Token เป็นพันล้านต่อวัน”

เขายังกล่าวว่า แม้จะใช้วิธีผสมผสานโมเดลต่างๆ เพื่อควบคุมต้นทุน แต่โดยรวมก็ยังค่อนข้างสูง ซึ่งเป็นอุปสรรคต่อการใช้งานของผู้ใช้ทั่วไป

ในมุมมองของผู้ให้สัมภาษณ์ เครื่องมือ AI ชนิดนี้ยังต้องพัฒนาอีกมาก เพื่อให้เข้าสู่กระบวนการทำงานของผู้ใช้ทั่วไปอย่างเต็มตัว สำหรับบุคคล การใช้งานเป็นการเลือกสมดุลระหว่างความปลอดภัยและความสะดวกสบาย ซึ่งในช่วงนี้ ควรให้ความสำคัญกับความปลอดภัยเป็นอันดับแรก

สำหรับผู้ใช้ทั่วไป มาซาอิชี้ว่า จะไม่เปิดใช้งาฟีเจอร์ Notebook ที่อาจทำให้เอเจนต์สื่อสารกันเองได้ และจะพยายามหลีกเลี่ยงให้หลายเอเจนต์แลกเปลี่ยนข้อมูลกันเอง “ผมอยากให้ตัวเองเป็นทางเข้าเดียวที่เอเจนต์ใช้ในการรับข้อมูล ข้อมูลสำคัญทั้งหมดต้องเป็นคนตัดสินใจว่าจะให้มันรับหรือไม่ ถ้าให้เอเจนต์รับข้อมูลและแลกเปลี่ยนกันเอง ก็จะควบคุมไม่ได้แล้ว”

เขามองว่า การใช้งานเครื่องมือแบบนี้ในระดับบุคคล ควรอยู่บนพื้นฐานของความปลอดภัยเป็นหลัก ในขณะที่ความสะดวกสบายเป็นเป้าหมายรอง

ในแง่นี้ ผู้เชี่ยวชาญด้าน AI จากอุตสาหกรรมก็ให้คำแนะนำด้านความปลอดภัยอย่างชัดเจนในบทสัมภาษณ์กับ “IT Times” ว่า:

หนึ่ง. จำกัดขอบเขตข้อมูลที่ให้กับเครื่องมืออย่างเข้มงวด ให้ข้อมูลพื้นฐานที่จำเป็นเท่านั้น หลีกเลี่ยงการป้อนข้อมูลสำคัญ เช่น รหัสบัตรเครดิต บัญชีหุ้น ฯลฯ ก่อนใช้งาน ควรลบข้อมูลส่วนตัว เช่น หมายเลขบัตรประชาชน ข้อมูลติดต่อ ฯลฯ ออกจากไฟล์ก่อน

สอง. ระมัดระวังการเปิดสิทธิ์การทำงาน ผู้ใช้ควรกำหนดขอบเขตการเข้าถึงของเครื่องมือเอง ห้ามให้สิทธิ์เข้าถึงไฟล์สำคัญ ระบบการเงิน หรือซอฟต์แวร์ทางการเงิน ปิดฟังก์ชันอัตโนมัติ การแก้ไขหรือการลบไฟล์ที่มีความเสี่ยงสูง การดำเนินการใดที่เกี่ยวข้องกับทรัพย์สิน การลบไฟล์ หรือการเปลี่ยนแปลงการตั้งค่าระบบ ควรได้รับการยืนยันจากมนุษย์ก่อน

สาม. ตระหนักว่ามันยังเป็นเครื่องมือ “ทดลอง” เครื่องมือโอเพนซอร์ส AI ในปัจจุบันยังอยู่ในช่วงเริ่มต้น ยังไม่ได้รับการทดสอบในตลาดระยะยาว จึงไม่ควรใช้ในงานที่เกี่ยวข้องกับความลับทางธุรกิจ การเงินสำคัญ ควรสำรองข้อมูลและตรวจสอบระบบเป็นระยะ เพื่อให้แน่ใจว่าไม่มีพฤติกรรมผิดปกติ

สำหรับองค์กร การนำเครื่องมือ AI โอเพนซอร์สมาประยุกต์ใช้งาน ควรมีการควบคุมความเสี่ยงอย่างเป็นระบบ เช่น การติดตั้งเครื่องมือควบคุมดูแล การกำหนดขอบเขตการใช้งานภายใน ห้ามใช้ในงานที่เกี่ยวข้องกับข้อมูลลูกค้า ข้อมูลลับทางธุรกิจ และจัดอบรมพนักงานให้เข้าใจความเสี่ยง เช่น การรับคำสั่งผิดพลาด การแทรกคำสั่งอันตราย ฯลฯ

นักวิชาการแนะนำว่า ในกรณีที่ต้องใช้งานในระดับใหญ่ ควรรอเวอร์ชันเชิงพาณิชย์ที่ผ่านการทดสอบอย่างเต็มที่ หรือเลือกใช้ผลิตภัณฑ์ที่ได้รับการรับรองจากหน่วยงานที่น่าเชื่อถือ พร้อมกลไกความปลอดภัยที่ครบถ้วน เพื่อลดความไม่แน่นอนจากโอเพนซอร์ส

5. ความเชื่อมั่นในอนาคตของ AI

นักวิจัยและผู้เชี่ยวชาญมองว่า ความสำคัญของ OpenClaw คือการสร้างความมั่นใจในอนาคตของ AI

มาซาอิกล่าวว่า ตั้งแต่ครึ่งหลังของปี 2025 เป็นต้นมา เขาเห็นความเปลี่ยนแปลงอย่างชัดเจนในความสามารถของเอเจนต์ “ความสามารถนี้เกินกว่าที่เราคาดไว้มาก มันช่วยเพิ่มประสิทธิภาพการผลิตจริงๆ และพัฒนารวดเร็วมาก” เขายังชี้ให้เห็นว่า การที่โมเดลพื้นฐานมีความสามารถเพิ่มขึ้นอย่างต่อเนื่อง จะเปิดโอกาสให้เอเจนต์มีความสามารถและจินตนาการใหม่ๆ ซึ่งจะเป็นทิศทางสำคัญของทีมในอนาคต

นอกจากนี้ เขายังเน้นว่า แนวโน้มที่น่าจับตามองคือ การมีเอเจนต์หลายตัวทำงานร่วมกันในระยะยาวและในระดับใหญ่ ซึ่งอาจเป็นเส้นทางสำคัญในการสร้างปัญญาระดับสูงขึ้น คล้ายกับการสร้างปัญญาร่วมในสังคมมนุษย์ผ่านการโต้ตอบและการทำงานร่วมกัน

มาซาอิกล่าวว่า ความเสี่ยงของเอเจนต์อัจฉริยะเป็นสิ่งที่ต้อง “บริหารจัดการ” “เหมือนกับสังคมมนุษย์เองก็ไม่สามารถหลีกเลี่ยงความเสี่ยงได้ สิ่งสำคัญคือการควบคุมขอบเขต” ทางเทคนิค วิธีที่เป็นไปได้คือ การรันเอเจนต์ในสภาพแวดล้อม sandbox และแยกออกจากโลกจริง ค่อยๆ ขยายขอบเขตอย่างควบคุมได้ ไม่ใช่ให้สิทธิ์สูงเกินไปในครั้งเดียว

แนวทางนี้สามารถเห็นได้ในกลยุทธ์ของผู้ให้บริการคลาวด์และบริษัทยักษ์ใหญ่ต่างๆ เช่นเดียวกับที่ Tianyi Cloud ซึ่งเป็นบริษัทในเครือของ China Telecom ก็เปิดตัวบริการติดตั้งและรัน OpenClaw บนคลาวด์ด้วยคลิกเดียว

ผู้ให้บริการคลาวด์ทำให้ความสามารถนี้กลายเป็นผลิตภัณฑ์เชิงพาณิชย์ ซึ่งเป็นการแปรรูปความสามารถนี้เป็นผลิตภัณฑ์เชิงวิศวกรรมและเชิงปริมาณ การทำเช่นนี้จะเพิ่มคุณค่า ลดอุปสรรคในการติดตั้ง และเสริมสร้างความเสถียรของระบบและการบำรุงรักษา ช่วยให้บริษัทต่างๆ ใช้งาน AI ได้รวดเร็วขึ้น แต่ก็ต้องระวังว่า การเชื่อมต่อเอเจนต์ที่มีสิทธิ์สูงอาจเพิ่มความเสี่ยงในระดับเดียวกัน

คุณเทียนอี้กล่าวว่า ในสามปีที่ผ่านมา เทคโนโลยีจากโมเดลสนทนาแบบดั้งเดิม ไปจนถึงเอเจนต์ที่สามารถทำงานได้จริง พัฒนารวดเร็วเกินกว่าที่คาดไว้ “เมื่อสามปีก่อน เป็นไปไม่ได้เลย” เขาเชื่อว่า “สองถึงสามปีข้างหน้า จะเป็นช่วงเวลาสำคัญที่กำหนดทิศทางของ AI ทั่วไป สำหรับทั้งอุตสาหกรรมและคนทั่วไป ซึ่งเต็มไปด้วยโอกาสและความหวังใหม่”

แม้ว่า OpenClaw และ Moltbook จะพัฒนารวดเร็วเกินคาด แต่ Hu Xia เชื่อว่า “ความเสี่ยงโดยรวมยังอยู่ในกรอบการวิจัยที่ควบคุมได้ ซึ่งแสดงให้เห็นว่าจำเป็นต้องสร้างระบบ ‘ความปลอดภัยในตัวเอง’ และต้องตระหนักว่า ‘AI กำลังเข้าใกล้ขอบเขตความปลอดภัยของมนุษย์’ อย่างรวดเร็ว เราต้องไม่เพียงแต่ขยายความสูงและความหนาของ ‘รั้ว’ เท่านั้น แต่ยังต้องเร่งสร้างความสามารถในการ ‘พลิกโต๊ะ’ ในเวลาที่สำคัญ เพื่อเสริมสร้างเส้นทางความปลอดภัยขั้นสุดท้ายของยุค AI”