72 часа, тройной кризис: душа Anthropic находится на распродаже

Написано: Ada, Deep Tide TechFlow

24 февраля, вторник. Вашингтон, Пентагон.

Генеральный директор Anthropic Dario Amodei сидит напротив министра обороны Пита Хегсета. Как сообщили несколько СМИ, в том числе NPR и CNN, атмосфера встречи была «вежливой», но содержание — совсем не мягким.

Хегсет дал ему последний ультиматум: до пятницы, 17:01, снять ограничения на военное использование Claude, разрешить Пентагону применять его «для всех законных целей», включая автономное прицеливание оружия и внутренний массовый мониторинг.

Иначе — отмена контракта на 200 миллионов долларов, запуск закона о производстве обороны, принудительное изъятие. Включение Anthropic в список «рисков цепочки поставок» — что равно внесению в черный список враждебных субъектов России и Китая.

В тот же день Anthropic выпустила третью редакцию «Ответственной политики расширения» (RSP 3.0), тихо убрав из нее самое важное обещание: если нельзя обеспечить безопасность, не тренировать более мощные модели.

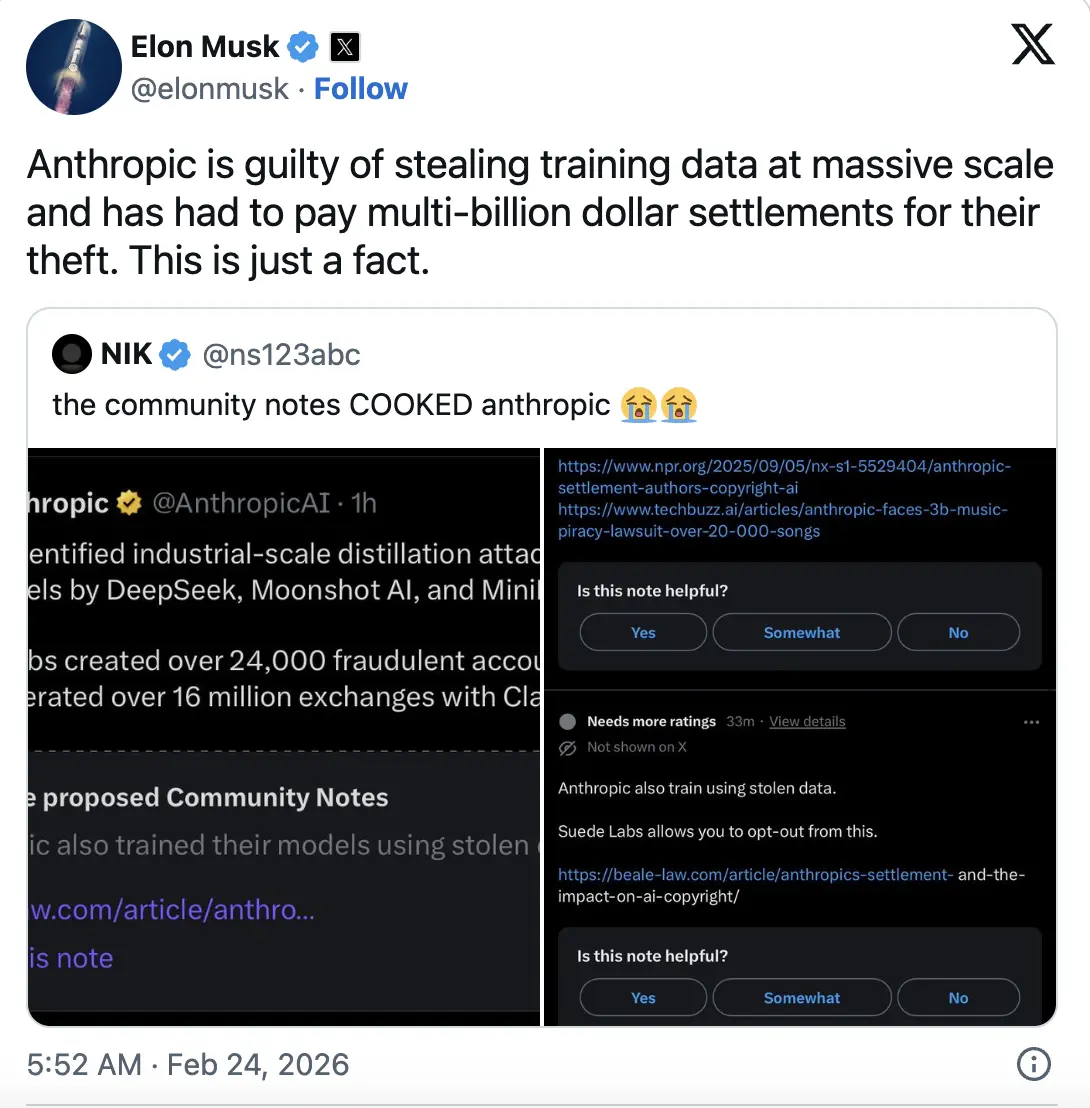

Также в тот же день Илон Маск в X написал: «Anthropic массово крадет тренировочные данные, это факт». В то же время, в сообществе X появилась заметка, что Anthropic заплатил 1,5 миллиарда долларов за урегулирование спора о использовании пиратских книг для обучения Claude.

За три дня эта компания, которая называет себя «духовной», одновременно сыграла три роли: защитника безопасности, нарушителя интеллектуальных прав и предателя Пентагона.

Кто из них настоящий?

Возможно, все.

Пентагон: «Либо подчиняйся, либо уходи»

Первая часть истории очень проста.

Anthropic — первая компания, получившая доступ к секретной информации Минобороны США. Контракт, заключенный прошлым летом, — максимум 200 миллионов долларов. Затем аналогичные контракты получили OpenAI, Google и xAI.

По данным Al Jazeera, Claude использовался в январе этого года в операции американских войск, которая, как сообщается, включала похищение президента Венесуэлы Мадуро.

Но Anthropic поставила две красные линии: не поддерживать полностью автономное прицеливание оружия и не участвовать в массовом мониторинге граждан США. Компания считает, что ИИ недостаточно надежен для управления оружием, и в настоящее время нет законов или правил, регулирующих использование ИИ в массовом наблюдении.

Пентагон не согласен.

Советник по ИИ в Белом доме Дэвид Сакс в октябре прошлого года публично обвинил Anthropic в «использовании страха для захвата регулирования».

Конкуренты уже сдались. OpenAI, Google и xAI согласились позволить военным использовать их ИИ «во всех законных сценариях». Мусковский Grok недавно получил разрешение на работу в секретных системах.

Anthropic — последний, кто стоит.

На момент публикации в последнем заявлении компания заявила, что не собирается идти на уступки. Но крайний срок — пятница, 17:01, — уже близко.

Анонимный бывший связной Минобороны и Минюста сказал CNN: «Как можно одновременно объявлять компанию «риском цепочки поставок» и принуждать ее работать на вашу армию?»

Это хороший вопрос, но он не входит в планы Пентагона. Их интересует только одно: если Anthropic не пойдет на компромисс, применить принудительные меры или оставить ее в стороне.

«Атака дистилляции»: удар в лицо

23 февраля Anthropic выпустила резкую статью в блоге, обвиняя три китайские ИИ-компании в «промышленной дистилляции Claude».

Обвиняемые — DeepSeek, Moonshot AI, MiniMax.

Anthropic утверждает, что эти компании через 24 000 фальшивых аккаунтов провели более 16 миллионов взаимодействий с Claude, целенаправленно извлекая его ключевые способности в области рассуждений, вызова инструментов и программирования.

Компания квалифицирует это как угрозу национальной безопасности, заявляя, что модели после дистилляции «вряд ли сохранят меры безопасности» и могут быть использованы авторитарными режимами для кибератак, распространения фейков и массового наблюдения.

История кажется идеально выстроенной, а момент — очень подходящим.

Совпадение: после того, как правительство Трампа ослабило экспортный контроль на чипы в Китай, и как раз в тот момент, когда Anthropic искала аргументы для лоббирования своих позиций по экспортным ограничениям.

Но Муск дал залп: «Anthropic массово крадет тренировочные данные и за это заплатила миллиарды долларов в виде урегулирования. Это факт.»

Соучредитель компании AI-инфраструктуры IO.Net Тори Грин заявил: «Вы тренируете свою модель на данных всей сети, а другие используют ваш публичный API для обучения — и это называется ‘атака дистилляции’?»

Anthropic называет дистилляцию «атакой», но в индустрии ИИ это — обычное дело. OpenAI использует ее для сжатия GPT-4, Google — для оптимизации Gemini, и даже Anthropic сама этим занимается. Единственное отличие — теперь она «дистиллирует» свою же модель.

По словам профессора AI из Нанянгского технологического университета в Сингапуре Эрика Камбрии CNBC: «Границы между законным использованием и злонамеренным — зачастую размыты».

Еще более иронично, что Anthropic заплатила 1,5 миллиарда долларов за урегулирование по делу о использовании пиратских книг для обучения Claude. Теперь она обвиняет других в использовании ее публичных API для обучения — это не двойные стандарты, а тройные.

Изначально Anthropic хотела выступить в роли жертвы, а в итоге оказалась обвиняемой.

Разрушение обещаний безопасности: RSP 3.0

В тот же день, когда компания противостояла Пентагону и вела внутренние разборки в Кремниевой долине, Anthropic выпустила третью редакцию «Ответственной политики расширения».

Главный ученый Anthropic Джаред Каплан в интервью заявил: «Мы считаем, что прекращение тренировки ИИ-моделей никому не поможет. В условиях быстрого развития ИИ односторонние обещания… бессмысленны, особенно когда конкуренты идут полным ходом».

Иными словами, если другие не придерживаются правил, то и мы — тоже не будем.

RSP 1.0 и 2.0 основывались на жестком обещании: если модель превысит рамки безопасности, тренировки приостанавливаются. Это сделало Anthropic уникальной в сфере ИИ безопасностью.

Но в 3.0 это исчезло.

Вместо этого появился более «гибкий» подход: разделение мер безопасности, которые может реализовать сама компания, и рекомендаций по безопасности, требующих отраслевого сотрудничества. Каждые 3–6 месяцев публикуется отчет о рисках, с привлечением внешних экспертов.

Звучит ответственно?

Независимый рецензент из некоммерческой организации METR, Крис Пейнтер, после ознакомления с ранним проектом политики сказал: «Это говорит о том, что Anthropic считает необходимым перейти в ‘режим диагностики’, потому что методы оценки и снижения рисков не успевают за ростом возможностей. Это больше подтверждает, что общество не готово к потенциальным катастрофам, связанным с ИИ».

По данным TIME, на подготовку этой редакции внутри компании ушел почти год. Генеральный директор Амодеи и совет директоров проголосовали единогласно. Официальная версия — изначальный замысел был в том, чтобы стимулировать отраслевое согласие, но индустрия не поспевала за этим. Правительство Трампа вела политику невмешательства, даже пыталось отменить законы штатов. Федеральное регулирование ИИ — вопрос отдаленного будущего. В 2023 году казалось возможным создание глобальной системы управления, но за три года эта дверь закрылась.

Анонимный исследователь, следящий за регулированием ИИ, сказал прямо: «RSP — это самое ценное брендовое активное у Anthropic. Убрать обещание о приостановке тренировки — все равно что органическая компания тихо срезает слово ‘органическая’ с упаковки и говорит, что теперь их проверка стала прозрачнее».

Оценка в 380 миллиардов и кризис идентичности

В начале февраля Anthropic завершила раунд финансирования на сумму 300 миллиардов долларов при оценке в 380 миллиардов, инвестором-якорем стала Amazon. За время существования компания достигла годового дохода в 14 миллиардов долларов, увеличиваясь более чем в 10 раз за последние три года.

В то же время, Пентагон угрожает внести ее в черный список. Муск публично обвиняет в краже данных. Собственные обещания безопасности были удалены. После ухода руководителя по безопасности Мринанка Шармы в X появилась запись: «Мир в опасности».

Противоречие?

Возможно, противоречие — это ген Anthropic.

Компания основана бывшими топ-менеджерами OpenAI, которые опасались, что OpenAI движется слишком быстро в вопросах безопасности. Они создали свою компанию, чтобы быстрее строить более мощные модели и одновременно говорить всему миру, насколько эти модели опасны.

Бизнес-модель сводится к тому, что мы — более опасные ИИ, чем все остальные, и поэтому вы должны платить нам за создание ИИ.

Этот нарратив отлично работал в 2023–2024 годах. Безопасность ИИ — горячая тема в Вашингтоне, а Anthropic — главный лоббист.

К 2026 году ситуация изменилась.

«Пробужденный ИИ» стал ярлыком для критики, законы штатов о регулировании ИИ были заблокированы Белым домом, а поддерживаемый Anthropic закон штата Калифорния SB 53 был подписан, но на федеральном уровне ситуация осталась без изменений.

Безопасность Anthropic переходит из «конкурентного преимущества» в «политический бремя».

Компания балансирует между необходимостью казаться «безопасной» для сохранения репутации и «гибкой» для избегания исключения из рынка и регулирования. Но терпимость к ошибкам и с той, и с другой стороны сокращается.

Стоит ли ценить безопасность?

Объединив три аспекта, картина становится ясной.

Обвинение китайских компаний в дистилляции Claude — это попытка усилить лоббизм по экспортному контролю чипов. Удаление обещания о приостановке тренировки — чтобы не отставать в гонке вооружений. Отказ от требований Пентагона к автономному оружию — чтобы сохранить моральную репутацию.

Каждый шаг логичен, но между ними есть противоречия.

Нельзя одновременно утверждать, что китайские компании «крадут» модели и это опасно для национальной безопасности, и при этом отменять меры по предотвращению выхода модели из-под контроля. Если модели действительно так опасны, нужно быть осторожнее, а не более агрессивным.

Если только ты — Anthropic.

В индустрии ИИ статус определяется не заявлениями, а балансом активов и обязательств. «Безопасность» Anthropic — по сути, брендовая надбавка.

На ранних этапах гонки вооружений ИИ эта надбавка имела смысл. Инвесторы платили за «ответственный ИИ», правительства — за «доверяемый ИИ», клиенты — за «более безопасный ИИ».

Но к 2026 году эта премия исчезает.

Теперь Anthropic сталкивается не с вопросом «идти на компромисс или нет», а с вопросом «кому первым уступить». Пойти на уступки Пентагону — потерять бренд. Пойти на уступки конкурентам — потерять обещания по безопасности. Пойти навстречу инвесторам — компромисс по обоим фронтам.

В пятницу, в 17:01, Anthropic даст свой ответ.

Но одно уже ясно: та Anthropic, которая раньше строилась на «мы отличаемся от OpenAI», становится такой же, как все остальные.

Конец кризиса идентичности — это исчезновение самой идентичности.