Увеличение роли профессора в разборе генеративного ИИ: Vibe Coding не так уж и магичен? Какой лучший способ писать программы с помощью ИИ?

В условиях стремительного развития генеративного ИИ многие чувствуют себя потерянными в вопросе, стоит ли продолжать учиться программированию. В программе журнала GQ профессор делится принципами работы LLM, объясняя ограничения Vibe Coding.

Профессор Gаdа поднимает вопрос о генеративном ИИ, учит правильно понимать Vibe Coding

Недавно GQ Taiwan на своем канале YouTube опубликовал видео, в котором особо приглашен профессор компьютерных наук Университета Калифорнии в Беркли (UC Berkeley) Sarah Chasins, чтобы ответить на многочисленные вопросы пользователей о программировании и ИИ.

В условиях быстрого развития генеративного ИИ многие чувствуют себя потерянными в вопросе, стоит ли продолжать учиться программированию. В видео профессор Chasins не только объясняет технические принципы, но и дает практическое наблюдение по недавно появившейся тенденции «Vibe Coding».

Профессор разбирает технологические принципы LLM, стоящие за ChatGPT

Профессор Sarah Chasins сначала простым языком объясняет, как работает ChatGPT.

ChatGPT основан на больших языковых моделях (LLM), его основная логика работы очень проста — это программа, которая отвечает за объединение слов, выглядящих как подходящие друг к другу.

Разработчики LLM сначала собирают все документы и веб-страницы, созданные людьми, — эти данные отражают разумные сочетания слов в человеческом восприятии.

Затем программа проходит масштабное обучение на «игре в заполнение пропусков». Например, система видит предложение «У собаки есть четыре [пробел]», и правильный ответ — «ласти», но если программа ошибается, разработчики исправляют ее, пока она не научится правильно отвечать.

После обучения, которое занимает примерно 300–400 лет по земному времени, программа в конечном итоге создает очень большой «подсказочный лист», то есть параметры, широко известные в технологической сфере.

Далее, достаточно предоставить диалоговый файл, и эта программа, умеющая заполнять пропуски, превращается в чат-бота, автоматически дополняя ответы на вопросы человека по логике.

Источник изображения: AI-сгенерированное изображение Nanobanana, только для справки, некоторые китайские символы могут быть размыты — просим прощения.

Лучшие способы учиться программировать в эпоху ИИ

Перед лицом мощных возможностей инструментов ИИ многие задаются вопросом, зачем вообще учиться программировать. Профессор считает, что в обучении программированию ключевым навыком является «разделение задач», то есть разбиение неясной большой задачи на мелкие части, пока каждую часть не удастся решить несколькими строками кода.

Без такой тренировки пользователи не смогут эффективно использовать ИИ-инструменты для создания действительно работающих сложных программ. Кроме того, обучающие данные LLM в основном содержат инженерные описания, а не повседневный язык обычных пользователей, что часто не совпадает с данными обучения и мешает ИИ генерировать полезный код.

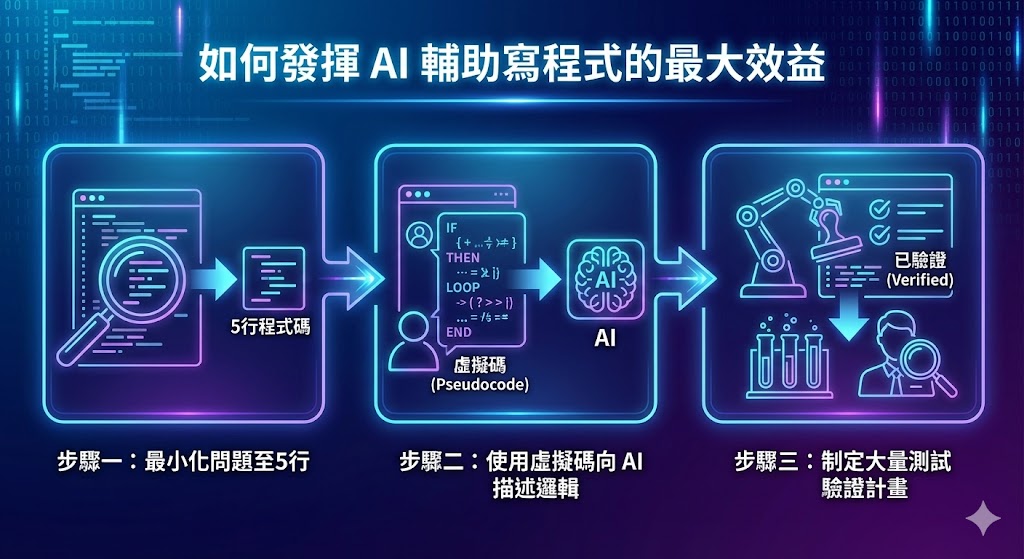

Что касается максимизации пользы от использования ИИ при программировании, профессор Chasins рекомендует следовать трем шагам:

- Минимизировать проблему: разбить задачу примерно на 5 строк кода.

- Использовать псевдокод: это способ описания логики, который может объединять разные языки программирования и ключевые слова, — хотя псевдокод похож на естественный язык, он не является нашим повседневным языком, а предназначен для более точного понимания логики компьютером.

- Разработать план проверки: проводить множество тестов или профессиональную проверку для обеспечения правильности вывода ИИ.

Источник изображения: AI-сгенерированное изображение Nanobanana, только для справки, некоторые китайские символы могут быть размыты — просим прощения.

Vibe Coding — не такой уж волшебный?

Относительно недавней популярности использования LLM для прямого генерации кода, а не его ручного написания, профессор Sarah Chasins выражает осторожность.

Она анализирует, что такие инструменты хорошо справляются с обработкой стандартных задач, написанных людьми много раз, но при попытке реализовать что-то инновационное этот подход обычно не работает.

Профессор также приводит исследования, показывающие, что люди, использующие LLM для помощи, хотя и считают, что их эффективность выросла на 20%, на самом деле разрабатывают медленнее, чем те, кто не использует такие инструменты, на 20%.

Это показывает, что чрезмерная зависимость от инструментов может создавать иллюзию повышения эффективности. В случае новых требований к программам, если отсутствует базовое умение логического разбиения и знания физических принципов, невозможно исправить ошибки ИИ, что в итоге ведет к более затратной разработке.

Простым примером, LLM — это как высокотехнологичный автомобиль с автопилотом, который помогает справляться с типичными ситуациями на дороге, но если вы не умеете разбирать трассу или не знаете физических принципов работы автомобиля, — как при разборе логики программирования, — при столкновении с незнакомой сложной кривой или инновационным требованием, автопилот может ошибаться, а вы — не знать, как его исправить.

Дополнительное чтение:

ИИ позволяет создавать компании с одним человеком! «Атмосферное кодирование» меняет правила, и даже небольшие команды могут зарабатывать миллионы в год

Связанные статьи

Dogecoin (DOGE) Удалил ноль на восемь часов, но вернется ли он? - U.Today

Оцените, удержит ли DOGE уровень выше 0,088 долларов при росте продаж со стороны китов

Цены на Dogecoin под давлением, поддержка на уровне $0.08 близка к пробою

Цена Dogecoin приближается к пробою восходящего треугольника, насколько энтузиазм розничных инвесторов сможет вернуть цену к максимумам февраля?

DOGE(Dogecoin)за последние 24 часа вырос на 7.58%