Óculos inteligentes Meta expostos: utilizadores enviam imagens privadas de banho, relações sexuais, números de cartão de crédito... para treinar IA em Quénia

Uma investigação dos media suecos revelou que imagens íntimas de utilizadores de óculos inteligentes Meta Ray-Ban, desde ecrãs de sanita a nudes, foram enviadas para os ecrãs de censores subcontratados no Quénia, enquanto os empregados disseram aos consumidores que “os dados permanecem locais.”

(Resumo: Zuckerberg previu que os telemóveis seriam eliminados!) Óculos inteligentes de IA + projeção holográfica são o futuro da humanidade)

(Suplemento de contexto: Ex-executivo da Meta revelou que Zuckerberg cometeu o crime do comunismo: criou secretamente uma ferramenta de “censura de discurso no Facebook Taiwan e Hong Kong” e traiu a privacidade dos utilizadores do Facebook)

Índice deste artigo

Toggle

- Máscaras defeituosas, funcionários de afasia

- Uma identidade tripla com um par de óculos

- Resistência popular nos sinais Bluetooth

- Colapso estrutural dos mecanismos de consentimento

Segundo um relatório de investigação publicado em conjunto pelo “Daily News” e pelo “Gothenburg Post” da Suécia: os utilizadores de óculos inteligentes da Meta estão a enviar toda a sua vida privada para o Quénia!

A investigação revelou que, quando um utilizador ativa as funcionalidades de IA dos óculos inteligentes Meta Ray-Ban (seja a pedir para reconhecer um objeto à sua frente, traduzir um menu ou responder a uma pergunta), os dados de imagem e voz captados pela câmara são enviados para os servidores da Meta em Luleå, Suécia, e Dinamarca.

Estes dados são depois distribuídos a milhares de trabalhadores contratados pelo subcontratador da Meta, Sama, em Nairobi, Quénia, para os rever, anotar e classificar um a um para treinar modelos de IA.

Um examinador queniano dirigiu-se a jornalistas de investigação:

“Conseguimos ver tudo – desde a sala de estar até ao nu. Estas são pessoas reais, como nós.”

Viram imagens de utilizadores na casa de banho, imagens de atos sexuais, números de cartões de crédito captados acidentalmente em câmara, conversas privadas e imagens de utilizadores a ver conteúdos para adultos.

Máscara defeituosa, funcionário de afasia

O design do sistema da Meta deveria teoricamente incluir um mecanismo de segurança: um algoritmo automático de mascaramento que oculte rostos e informações sensíveis nas imagens. No entanto, investigações dos media suecos concluíram que este sistema frequentemente falha. Os censores conseguem ver claramente cenas do dia a dia nas casas de pessoas comuns que não fazem ideia de que os seus óculos estão a gravar, quanto mais que o que gravam aparecerá no ecrã de alguém do outro lado do mundo.

O que é ainda mais irónico é a lacuna de informação do lado dos consumidores. O repórter visitou um total de dez cadeias de lojas de óculos em Estocolmo e Gotemburgo, principalmente a Synsam e a Synoptik. Quando questionados sobre privacidade, os vendedores em muitas lojas disseram que os utilizadores têm controlo total e que todos os dados permanecem na aplicação móvel e não serão transmitidos para outros locais.

Isto parece ser exatamente o oposto da verdade.

Com as funcionalidades de IA dos óculos inteligentes Ray-Ban Meta, os dados têm de ser processados através da infraestrutura da Meta, e não existe opção para computação puramente local. Os registos de voz são armazenados na cloud por defeito durante até um ano para “melhorar o sistema de IA”, e não existe mecanismo de saída exceto a eliminação manual um a um. Muitos funcionários da loja admitiram que não sabiam que dados os óculos realmente transmitiam.

Petter Flink, especialista em segurança informática da Agência Sueca de Proteção de Dados (IMY), alerta que esta tecnologia é uma tática de marketing que esconde riscos reais de privacidade. Os consumidores não têm conhecimento do processo de processamento de back-end. A resposta da Meta é uma linha padrão de defesa corporativa: a empresa cumpre os acordos de utilizador e os regulamentos do RGPD, e a localização dos revisores “não afeta a conformidade, desde que as regras sejam cumpridas.”

A tripla identidade de um par de óculos

A investigação sueca revela a primeira camada de preocupações com a privacidade dos óculos inteligentes da Meta: o que pensa ser privado está na verdade a ser revisto por desconhecidos. Mas isso é apenas a ponta do icebergue.

A segunda camada já emergiu do outro lado do Atlântico. Agentes do Serviço de Imigração e Alfândega dos EUA (ICE) foram encontrados a usar óculos inteligentes Meta Ray-Ban durante operações de aplicação da lei, a tirar fotografias secretamente de suspeitos de imigrantes indocumentados em locais públicos e a verificá-las com bases de dados e plataformas de redes sociais. O “The Verge” citou pessoas familiarizadas com o assunto a apontar que este não é um caso isolado, mas sim um modelo operativo em expansão.

Um par de dispositivos vestíveis de consumo torna-se diretamente uma ferramenta de vigilância estatal, sem ordem judicial ou mandado de busca.

A terceira camada é a ameaça estrutural mais grande. Em meados de fevereiro, o New York Times obteve documentos internos da Meta que revelavam que a Reality Labs estava a desenvolver uma funcionalidade de reconhecimento facial em tempo real com o nome de código “Name Tag”: quando o utilizador olha para alguém, a IA pode comparar dados da Meta plataforma e mostrar o nome, perfil e amigos em comum da pessoa em segundos. O documento interno contém uma descrição arrepiante da estratégia: “Iremos viver num ambiente político dinâmico onde muitos grupos da sociedade civil concentrarão os seus recursos noutras questões.”

Por outras palavras: Meta sabe que esta funcionalidade vai desencadear uma reação, por isso escolhe atacar quando o adversário não tem tempo para a tratar.

Com três camadas empilhadas, um par de óculos de sol de 299 dólares desempenha três funções ao mesmo tempo: um coletor silencioso de dados de treino de IA, uma ferramenta furtiva para as forças policiais estaduais e uma arma social para identificação em tempo real. E nenhuma pessoa à volta do utilizador (fotografada, identificada, censurada) alguma vez carregou no botão “concordar”.

Resistência popular nos sinais Bluetooth

A resposta a nível institucional tem sido frustrantemente lenta. O Centro de Informação de Privacidade Eletrónica dos EUA (EPIC) enviou uma carta à Comissão Federal de Comércio (FTC) solicitando uma investigação, mas no clima político atual, a aplicação da lei por parte do regulador é, por si só, uma incógnita. A Europa tem o RGPD, mas a resposta padrão da Meta é “cumprimos”, e a diferença entre os fluxos reais de dados e os compromissos de conformidade foi revelada por jornalistas suecos através de visitas presenciais a dez lojas.

O primeiro a responder de forma substancial foi um sociólogo suíço. O desenvolvedor independente Yves Jeanrenaud lançou “Nearby Glasses” no final de fevereiro, uma aplicação Android que alerta quando óculos inteligentes Meta ou Snap num intervalo de 10 a 15 metros são detetados através da varridura do identificador do fabricante no sinal de transmissão Bluetooth Low Energy (BLE).

Jeanrenaud disse que o seu motor veio de “testemunhar a dimensão e a natureza anti-humana dos abusos envolvidos nestes óculos inteligentes.” Algumas pessoas fotografam secretamente clientes em salões de beleza, outras gravam vídeos em tribunais e clínicas, e algumas ligam câmaras em casas de banho públicas… Cada um tem casos reais, não hipóteses.

Colapso estrutural dos mecanismos de consentimento

Voltando à questão fundamental: os óculos inteligentes Meta são uma crise de privacidade e não apenas uma controvérsia de produto, porque desmontam a premissa básica sobre a qual operam os frameworks modernos de privacidade: o modelo de “consentimento informado”.

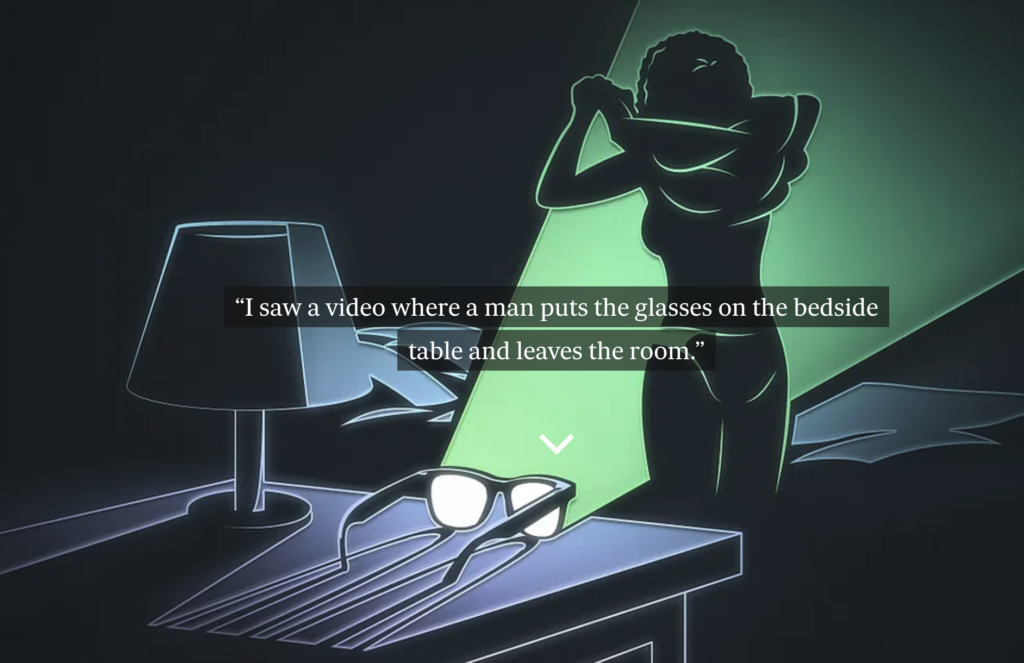

A lógica tradicional é que as empresas devem informá-lo e obter consentimento antes de recolher os seus dados. Mas a forma como o Ray-Ban Meta funciona faz com que esta lógica colapse em três direções ao mesmo tempo. Para o utilizador, o empregado da loja diz-lhe que a informação é deixada localmente, mas na verdade está a voar para a Dinamarca e o Quénia.

Para a pessoa que está a ser fotografada, não é utilizador Meta, não clicou em nenhum botão de consentimento, nem sequer sabe que está a ser gravado.

Para esses censores em Nairobi, são obrigados a assistir aos momentos mais íntimos de estranhos, e o custo psicológico do trabalho nunca é mostrado nos relatórios ESG da Meta.

A força da proteção da privacidade nunca depende do que está escrito no texto dos regulamentos, mas sim de a empresa achar que irá avançar com o processo. E o Meta aparentemente parece ter calculado isso: não vais…