72 horas, tríplice crise: a alma da Anthropic está a ser leiloada

Escrito por: Ada, Deep Tide TechFlow

24 de fevereiro, terça-feira. Washington, Pentágono.

O CEO da Anthropic, Dario Amodei, senta-se em frente ao Secretário de Defesa, Pete Hegseth. Segundo várias fontes citadas pela NPR e CNN, o ambiente da reunião é “educado”, mas o conteúdo nada tem de cortês.

Hegseth deu-lhe um ultimato: até sexta-feira às 17h01, liberar restrições militares ao Claude, permitindo que o Pentágono o utilize para “todos os fins legais”, incluindo mira de armas autônomas e vigilância em massa doméstica.

Caso contrário, cancelar o contrato de 200 milhões de dólares, ativar a Lei de Produção de Defesa, expropriar forçadamente, e listar a Anthropic como “risco na cadeia de suprimentos”, o que equivale a colocá-la na lista negra de entidades hostis da Rússia e China.

No mesmo dia, a Anthropic lançou a terceira versão da “Política de Expansão Responsável” (RSP 3.0), silenciosamente removendo uma das promessas mais centrais desde a fundação: que, se não fosse possível garantir medidas de segurança, não treinariam modelos mais poderosos.

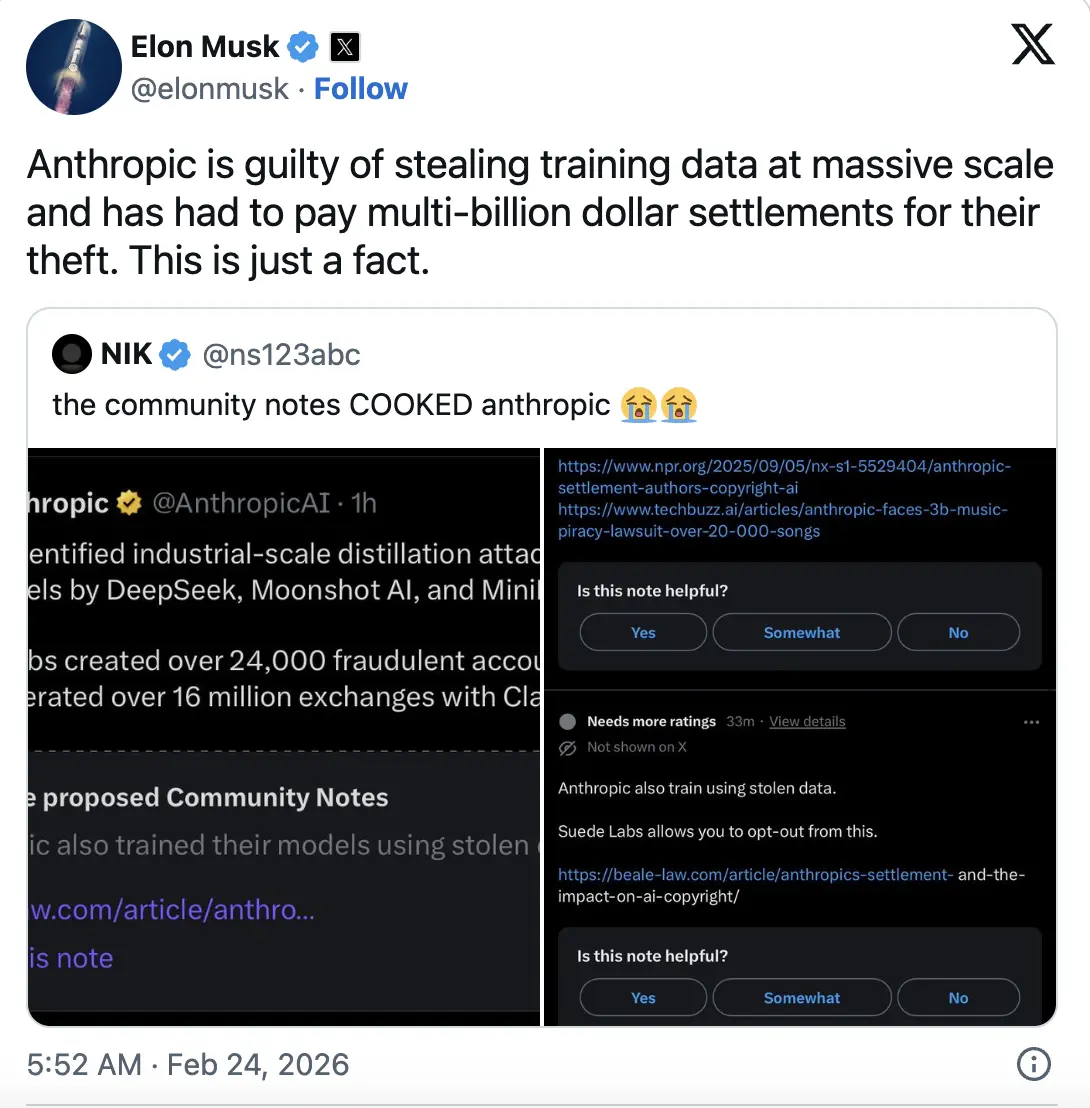

Também nesse dia, Elon Musk postou no X: “Anthropic está roubando dados de treinamento em grande escala, isso é um fato.” Ao mesmo tempo, a nota da comunidade no X acrescentou que a Anthropic pagou 1,5 bilhão de dólares em acordo por treinar Claude com livros piratas.

Em 72 horas, essa empresa de IA que se autodenomina “com alma” desempenhou três papéis: mártir da segurança, ladrão de propriedade intelectual, traidora do Pentágono.

Qual deles é o verdadeiro?

Talvez todos.

Pentágono: “Ou obedece, ou sai”

A história é simples na sua primeira camada.

A Anthropic foi a primeira empresa de IA a obter acesso confidencial ao Departamento de Defesa dos EUA. Contrato assinado no verão passado, limite de 200 milhões de dólares. OpenAI, Google e xAI também receberam contratos de valor semelhante posteriormente.

Segundo a Al Jazeera, Claude foi usado em uma operação militar dos EUA em janeiro deste ano, envolvendo o sequestro do presidente venezuelano Maduro.

Porém, a Anthropic estabeleceu duas linhas vermelhas: não apoiar mira de armas totalmente autônomas, nem vigilância em massa de cidadãos americanos. Acredita que a IA não é confiável o suficiente para controlar armas, e que ainda não há leis ou regulamentações que regulem o uso de IA na vigilância em larga escala.

O Pentágono não aceitou.

O conselheiro de IA da Casa Branca, David Sacks, acusou publicamente, em outubro do ano passado, a Anthropic de “usar o medo como arma, para capturar regulamentações”.

Concorrentes já se renderam. OpenAI, Google, xAI concordaram em permitir que o setor militar use suas IA em “todos os cenários legais”. Musk’s Grok foi aprovado nesta semana para acesso a sistemas confidenciais.

A Anthropic é a última a resistir.

Até o momento, a Anthropic declarou que não pretende ceder. Mas o prazo de sexta às 17h01 está se aproximando.

Um ex-liaison anônimo do Departamento de Justiça e Defesa disse à CNN: “Como é possível declarar uma empresa como ‘risco na cadeia de suprimentos’ e, ao mesmo tempo, obrigá-la a trabalhar para o seu exército?”

Boa pergunta, mas não está na pauta do Pentágono. Para eles, o que importa é que, se a Anthropic não ceder, usarão de força ou a abandonarão em Washington.

“Ataque de destilação”: uma acusação de bofetada

Em 23 de fevereiro, a Anthropic publicou um blog com tom agressivo, acusando três empresas chinesas de realizar “ataques de destilação em nível industrial” contra Claude.

As acusadas são DeepSeek, Moonshot AI e MiniMax.

A Anthropic afirma que essas empresas usaram 24 mil contas falsas para realizar mais de 16 milhões de interações com Claude, extraindo direcionadamente suas capacidades centrais de raciocínio, chamadas de ferramentas e programação.

A empresa classifica isso como uma ameaça à segurança nacional, alegando que o modelo destilado “provavelmente não manterá as salvaguardas de segurança”, podendo ser usado por governos autoritários para ataques cibernéticos, desinformação e vigilância em massa.

A narrativa é perfeita, o timing também.

Justamente após o governo Trump relaxar o controle de exportação de chips para a China, e quando a Anthropic buscava argumentos para sua posição na luta contra restrições de exportação de chips.

Porém, Musk disparou: “A Anthropic roubou dados de treinamento em grande escala e pagou bilhões de dólares em acordos judiciais. Isso é um fato.”

Tory Green, cofundador da empresa de infraestrutura de IA IO.Net, comentou: “Vocês treinam seus modelos com dados de toda a internet, e quando outros usam sua API pública para aprender com vocês, isso é ‘ataque de destilação’?”

A Anthropic chama de “ataque” a destilação, mas na indústria de IA isso é algo comum. OpenAI usou para comprimir o GPT-4, Google para otimizar o Gemini, e até a própria Anthropic faz isso. A única diferença é que, desta vez, ela está sendo destilada por ela mesma.

Segundo Erik Cambria, professor de IA na Universidade Tecnológica de Nanyang, Cingapura, “a linha entre uso legítimo e uso malicioso costuma ser tênue.”

Mais irônico ainda: a Anthropic pagou 1,5 bilhão de dólares em acordo por treinar Claude com livros piratas, e agora acusa outros de usar sua API pública para aprender com ela. Isso não é duplo padrão, é triplo.

A Anthropic queria se passar de vítima, mas acabou sendo processada como ré.

A desmontagem da promessa de segurança: RSP 3.0

No mesmo dia em que enfrentava o Pentágono e trocava farpas com o Vale do Silício, a Anthropic lançou a terceira versão de sua Política de Expansão Responsável.

Jared Kaplan, chefe de ciência da Anthropic, afirmou em entrevista: “Achamos que parar de treinar IA não ajuda ninguém. Em um cenário de rápido avanço da IA, fazer promessas unilaterais… enquanto os concorrentes avançam a toda velocidade, não faz sentido.”

Em outras palavras, se os outros não jogam limpo, também não vamos.

As versões 1.0 e 2.0 da RSP tinham uma promessa rígida: se a capacidade do modelo ultrapassasse a cobertura das medidas de segurança, o treinamento seria suspenso. Essa promessa deu à Anthropic uma reputação única na comunidade de segurança de IA.

Mas a 3.0 a removeu.

Substituiu por uma estrutura mais “flexível”, que divide as medidas de segurança que a Anthropic pode implementar e as recomendações de segurança que requerem colaboração de toda a indústria. Cada 3-6 meses, um relatório de riscos é divulgado, com revisão de especialistas externos.

Parece responsável?

Chris Painter, avaliador independente do METR, disse após revisar o rascunho inicial: “Isso mostra que a Anthropic acha que precisa entrar em uma ‘fase de triagem’, porque os métodos de avaliação e mitigação de riscos não acompanham o ritmo de crescimento das capacidades. Isso mais revela que a sociedade não está preparada para os riscos catastróficos potenciais da IA.”

Segundo a TIME, a Anthropic passou quase um ano discutindo internamente essa reescrita, com CEO Amodei e conselho aprovando por unanimidade. A justificativa oficial é que a política original tinha como objetivo impulsionar uma maior aceitação do setor, mas o setor não acompanhou. O governo Trump adotou uma postura permissiva com o desenvolvimento de IA, até tentando revogar regulamentações estaduais. A legislação federal sobre IA ainda está longe de acontecer. Apesar de parecer possível estabelecer uma governança global em 2023, três anos se passaram e a porta parece fechada.

Um pesquisador anônimo que acompanha de perto a governança de IA foi direto: “A RSP é o ativo de maior valor da Anthropic. Remover a promessa de suspender treinamentos é como uma empresa de alimentos orgânicos que tira silenciosamente a palavra ‘orgânico’ da embalagem e diz que agora seus testes são mais transparentes.”

Valor de 380 bilhões e a crise de identidade

No início de fevereiro, a Anthropic levantou 300 milhões de dólares em uma rodada de financiamento, avaliada em 380 bilhões de dólares, com a Amazon como investidora âncora. Desde sua fundação, já faturou 14 bilhões de dólares anuais, crescendo mais de 10 vezes ao ano nos últimos três anos.

Ao mesmo tempo, o Pentágono ameaçou colocá-la na lista negra. Musk acusou publicamente de roubo de dados. Seus compromissos de segurança foram removidos. Após a saída de Sharma, chefe de segurança de IA, ele escreveu no X: “O mundo está em perigo.”

Contradições?

Ou talvez a contradição seja parte do DNA da Anthropic.

Fundada por ex-executivos da OpenAI, por medo de que a OpenAI estivesse avançando rápido demais na segurança, criaram uma nova empresa para desenvolver modelos mais poderosos, ao mesmo tempo que alertavam para seus perigos.

O modelo de negócio é resumido assim: somos mais assustados com IA do que qualquer um, por isso você deve pagar para que a gente construa IA.

Essa narrativa funcionou perfeitamente em 2023-2024. Segurança de IA virou palavra de ordem em Washington, e a Anthropic era a maior lobista.

Mas em 2026, o cenário mudou.

“IA woke” virou um rótulo de ataque, leis estaduais de regulação de IA foram barradas pelo governo, e a SB 53 apoiada pela Anthropic foi sancionada na Califórnia, mas o Congresso federal permanece vazio.

A estratégia de segurança da Anthropic, que antes era uma vantagem competitiva, agora virou um passivo político.

Ela faz uma jogada de equilíbrio delicado: precisa parecer “segura” o suficiente para manter sua marca, mas também “flexível” o bastante para não ser abandonada pelo mercado ou pelo governo. O problema é que o espaço de tolerância de ambos está diminuindo.

Quanto vale a narrativa de segurança?

Ao juntar esses três elementos, fica claro:

Acusar empresas chinesas de destilação de Claude serve para reforçar a narrativa de controle de exportação de chips. Para não ficar para trás na corrida armamentista, a Anthropic removeu sua promessa de pausa de segurança. Recusar o pedido do Pentágono por armas autônomas é uma tentativa de manter sua última máscara moral.

Cada passo faz sentido, mas também se contradiz.

Não se pode dizer que empresas chinesas “destilam” seu modelo e que isso ameaça a segurança nacional, e ao mesmo tempo remover a promessa de evitar que seu próprio modelo saia do controle. Se o modelo fosse realmente tão perigoso, deveria ser mais cautelosa, não mais agressiva.

A não ser que você seja a Anthropic.

Na indústria de IA, sua identidade não é definida por declarações, mas por seu balanço patrimonial. A narrativa de “segurança” da Anthropic é, na essência, uma estratégia de valor de marca.

No início da corrida armamentista de IA, esse valor valia dinheiro. Investidores pagavam mais por “IA responsável”, governos davam luz verde para “IA confiável”, clientes pagavam por “IA mais segura”.

Mas em 2026, esse valor está desaparecendo.

Hoje, a Anthropic enfrenta uma escolha: não de “se deve ou não ceder”, mas de “a quem ceder primeiro”. Ceder ao Pentágono prejudica sua marca. Ceder aos concorrentes anula suas promessas de segurança. Ceder aos investidores compromete ambos.

Na sexta-feira às 17h01, a Anthropic entregará sua resposta.

Mas uma coisa já está certa: aquela que antes se apoiava na ideia de “não somos como a OpenAI”, está se tornando igual a todos os outros.

A crise de identidade, muitas vezes, termina na própria ausência de identidade.