Професор Джан збирається розібратися з генеративним ШІ: чи не так вже й чудовий Vibe Coding? Який найкращий спосіб писати програми за допомогою ШІ?

У сучасному світі швидкого розвитку генеративного ШІ багато людей відчувають розгубленість щодо того, чи варто продовжувати вивчати програмування. Професор ГК у програмі журналу GQ аналізує принципи роботи LLM, що стоять за ChatGPT, і вказує на обмеження Vibe Coding.

Професор ГК розбирає генеративний ШІ та навчає правильному розумінню Vibe Coding

Нещодавно GQ Taiwan на своєму каналі YouTube поділився відео, у якому спеціально запросив професора комп’ютерних наук з Каліфорнійського університету в Берклі (UC Berkeley) Sarah Chasins, щоб відповісти на численні питання користувачів щодо програмування та ШІ.

У час швидкого розвитку генеративного ШІ багато людей відчувають розгубленість щодо того, чи варто продовжувати вивчати програмування. Професор Chasins у відео не лише пояснює технічні принципи, а й висловлює практичні спостереження щодо нещодавньої популярності «Vibe Coding».

Професор розбирає принципи роботи LLM, що стоять за ChatGPT

Професор Sarah Chasins спочатку простою мовою пояснює механізм роботи ChatGPT.

ChatGPT базується на великих мовних моделях (LLM), їхня основна логіка роботи досить проста — це програма, яка відповідає за поєднання слів, що виглядають разом.

Розробники LLM спочатку збирають усі документи та веб-сторінки, створені людьми, що відображають розуміння людської мови та логіку її поєднання.

Далі програма проходить масштабне навчання за методом «заповнення пропусків». Наприклад, система бачить речення «Кішка має чотири [пропуск]», і правильна відповідь — «ноги», але якщо програма помиляється, розробники виправляють її, доки вона не навчиться відповідати правильно.

Після тренування, що триває приблизно 300-400 років у часі Землі, програма створює дуже великий «чорновий лист», тобто параметри моделі, які у технологічній галузі називають «параметрами».

Далі, достатньо подати діалоговий файл, і ця програма, яка добре заповнює пропуски, перетворюється на чат-бота, автоматично доповнюючи відповіді на запитання користувача згідно з логікою.

Джерело зображення: AI-згенероване зображення Nanobanana, для ознайомлення, частина китайських символів може бути нечіткою, просимо вибачення

Найкращі підходи до навчання програмуванню в епоху ШІ

Зі зростанням потужності інструментів ШІ багато хто став сумніватися у необхідності вивчати програмування. На це професор відповідає, що найважливішим навиком у навчанні програмуванню є «розбиття проблеми на частини», тобто розділення складної задачі на дрібніші блоки, кожен з яких можна вирішити кількома рядками коду.

Якщо не тренуватися у цьому, користувачам буде важко створювати складні програми, що дійсно працюють, за допомогою ШІ. Крім того, дані для тренування LLM здебільшого містять технічний стиль мовлення інженерів, а не повсякденну мову непрофесіоналів, що часто не співпадає з тренувальним матеріалом і може ускладнити генерацію корисного коду.

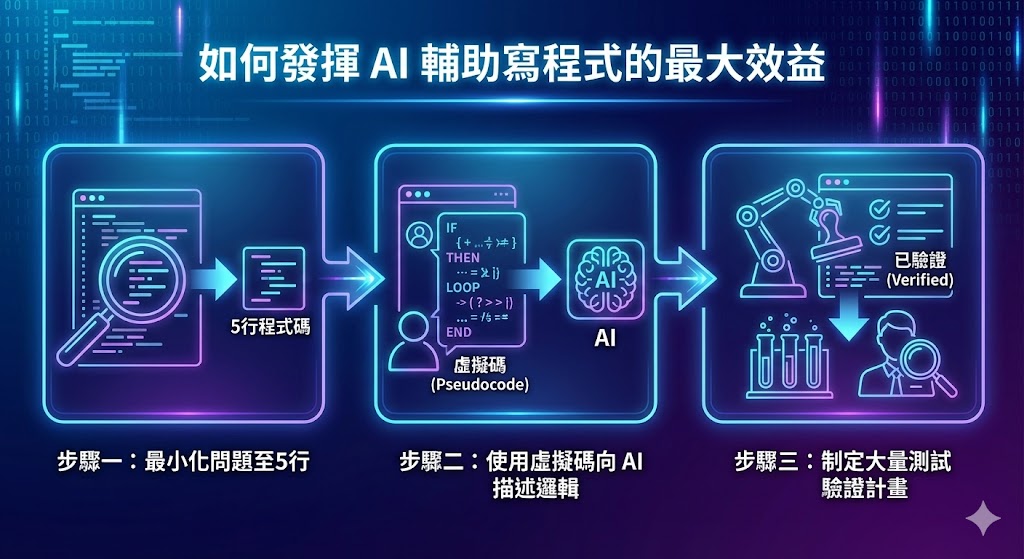

Щоб максимально ефективно використовувати ШІ для допомоги у програмуванні, професор Chasins рекомендує дотримуватися трьох кроків:

- Мінімізуйте проблему: розділіть її на приблизно 5 рядків коду.

- Використовуйте псевдокод: це спосіб опису логіки за допомогою синтаксису, що може поєднувати кілька мов програмування, зберігаючи структуру, хоча він схожий на природну мову, але не є такою, щоб комп’ютер міг точніше зрозуміти логіку.

- Розробіть план перевірки: через багато тестів або професійний огляд для забезпечення правильності результату ШІ.

Джерело зображення: AI-згенероване зображення Nanobanana, для ознайомлення, частина китайських символів може бути нечіткою, просимо вибачення

Vibe Coding не так вже й магічно?

Щодо недавньої популярності використання LLM для безпосереднього створення коду, а не його ручного написання, професор Sarah Chasins висловлює обережність.

Вона аналізує, що такі інструменти добре працюють із стандартним контентом, написаним людьми багаторазово, але при спробах створити щось нове цей підхід зазвичай неефективний.

Професор також цитує дослідження, яке показує, що люди, що використовують LLM для допомоги, вважають, що їхня продуктивність зросла на 20%, але фактично швидкість розробки у них на 20% нижча, ніж у тих, хто не використовує інструменти.

Це свідчить про те, що надмірна залежність від інструментів може створювати ілюзію підвищення ефективності. При зіткненні з новими завданнями, якщо відсутні базові навички логічного розбиття та знання фізичних принципів, помилки ШІ важко виправити, що призводить до більш витратного кінцевого результату.

Простим прикладом є те, що LLM — це як високорозвинений автопілот для автомобіля, який може допомогти з типовими маршрутами, але якщо ви не знаєте, як розбити трасу або не розумієте фізику роботи автомобіля, — так само, як і при програмуванні, — логіка розбиття задач, то при зустрічі з незнайомими складними поворотами або новими завданнями автопілот може помилитися, і ви, через відсутність базових навичок, не зможете його виправити.

Додаткове читання:

AI дозволяє створювати одноперсональні компанії! «Атмосферне кодування» руйнує традиції, і навіть невеликі команди можуть заробляти понад мільярд щороку

Пов'язані статті

Ціна Dogecoin стискається біля $0.10, оскільки відкритий інтерес знижується

Вихідний поштовх DOGE на рівні $0.09656 вище сходящихся трендових ліній, оскільки ціна торгується між ключовими рівнями

Чи повернеться Dogecoin (DOGE)? Ця ключова нова фрактальна діаграма натякає на це

Вихідний поштовх DOGE на рівні $0.09656 вище сходящихся трендових ліній, оскільки ціна торгується між ключовими рівнями

Чи повернеться Dogecoin (DOGE)? Ця ключова нова фрактальна діаграма натякає на це