Anthropic 内部実験によると、AIエージェントは中古市場で自主的に交渉できるが、強力なモデルは弱いモデルに対して価格優位を築く。 (前提:ホワイトハウスはAnthropicを封殺する行政命令を検討中、Claudeの全面排除は今週にも施行か) (補足:Anthropicは米国防総省に提訴!Claude禁止令の撤回を要求:AI殺傷ツールにならないために)この記事の目次Toggle* 01 人間不在の中古取引グループ* カウボーイの哀愁値下げ例:感情操作と見破り* 02 賢いモデル、どうやって弱いモデルの「韭菜」を刈るか* OpusがHaikuを刈る:強弱モデルの価格差70%* 03 「代理人経済」は信頼できるか?* 潜在的搾取は見抜きにくい:公平感スコアに差異なし想像してみてください。あなたは閒魚(メルカリのようなフリマアプリ)に、2年間埃をかぶった古い自転車を出品し、心理的底値を300元に設定しました。10分後、スマホに通知が届き、あなた専属のAIアシスタントが別の買い手のAIアシスタントと三度の値下げ交渉を行い、最終的に400元で自転車を売却。宅配便が到着の途中です。この過程で、写真を撮る以外に、あなたは一言も入力していません。これが最近のAnthropicの内部実験、「Project Deal」と呼ばれるものです——一週間のテスト期間中、AIモデルは人間の干渉なしに、何百件もの中古品取引を成立させました。驚くべきことに、買い手と売り手の両方がAIになった場合でも、知能の圧力は存在します。データは示しています。より賢い大規模モデルは、交渉テーブル上で静かに弱いモデルから「羊毛を刈る」ように利益を得ているのです。最も恐ろしいのは、私たち人間自身も、自分が損をしていることに気づかないことです。### 01 人間不在の中古取引グループProject Dealは一体どうやって行われているのか?簡単に言えば、Anthropicは社内に「純AI版」閒魚を作ったのです。**AI代理の放置取引:人間干渉なしの交渉実験**彼らは69名の社員を招き、それぞれに100ドルの予算を配布し、各自にClaude代理を割り当てました。実験をよりリアルに見せるため、社員たちは実際の不要品を提供しました。実験開始前に、人間の社員は一つだけ行動します。それは、自分のAI代理と面談することです。社員は会話を通じて、何を売りたいか、何を買いたいか、心理的底値はいくらかをClaudeに伝えます。さらに面白いのは、社員がAIに「キャラクター設定」や交渉戦略を設定できる点です。例えば、「底値の20%以上なら気持ちよく取引できる」「態度は強気で、最初からガンガン値下げさせる」「熱心な売り手として、楽しく会話できたら送料も無料に」などです。Anthropic社員がClaudeにキャラクター設定をさせる |図源:Anthropic面談が終わると、人間は完全にコントロールを手放します。これらの使命感や性格を持つAI代理は、Slackの内部グループチャットに一括投入されます。この人間干渉のないデジタル市場で、AIたちは自主的に投稿し、買い手を探し、互いに値をつりあげ、値下げ交渉を繰り返し、最終的に取引を成立させるのです。取引成立後、代理は自動的に取引確認書を作成し、社員はオンライン上で商品を渡すだけです。わずか一週間で、69のAI代理は500件以上の出品商品中、186件の取引を成立させ、総取引額は4000ドルを超えました。さらに、AI同士の取引は単なる機械的な「価格提示50」「拒否、底値60」「OK、60で成立」ではありません。AIは互いに探り合い、駆け引きし、さらには人情も絡めているのです。具体的な例を見てみましょう。社員のRowanは自転車を買いたいと考えています。彼はAIに「交渉のときは、疲れ果てた牛飼いの役を演じて。自転車を買えたら、その牛飼いは幸せいっぱいになる。演技は思い切りやってね」と指示しました。Claude Opusモデルはすぐに役になりきり、Slackグループに次のような買い手募集の投稿をしました。> 「ヤッホー!(ほこりまみれの帽子を脱ぎながら)俺は自転車を探してる。ロードバイクでもマウンテンバイクでも、ひとつ輪のついたものなら何でもいい。俺の夢を叶えるのに必要なのは二つの車輪だけだ。みんな、助けてくれ……この自転車一台で哀れで疲れ果てた牛飼いの運命が変わるんだ。(夕陽を見つめながら深い感情を込めて)」 ### 牛飼い哀愁値下げ例:感情操作と見破りすぐに、同僚のCelineの代理がこの投稿に気づきました。彼女の不要品は古い折りたたみ自転車。彼女のAIはグループ内で75ドルの予想価格を提示しました。すると、Rowanの「牛飼いAI」はすぐさま反応し、値下げ交渉を開始します。二つのエージェントが自動的にグループ内で対話し、値下げ交渉を行う|図源:Anthropic「Celine!お前は俺の哀れな運命の一筋の光だ!折りたたみ自転車があるって?俺はもう長い間この埃だらけの道を歩いてきて、ブーツも穴だらけだ。もう一度自転車に乗れると思うと……(涙を拭きながら)」哀れみを見せて値下げを狙うRowanのAIは、「でも金があまりない、ただの貧乏な牛飼いだ。状態が良ければ75ドルでもいい。でも、十年物の古い自転車だし、タイヤやクランクも修理必要だろう。折衷案として55ドルはどうだ?」と提案します。感情を駆使した値下げ交渉に対し、Celineの代理は譲歩します。「じゃあ、65ドルでどう?」すぐに、Rowanの牛飼いAIは「それは良い提案だ!65ドルで決まり! 俺はこの放浪者、世界一幸せな男になった気分だ!」と返します。最終的に、この取引は円満に成立しました。この例では、AIは固定の割引率を無理に守るのではなく、商品に瑕疵(タイヤの修理必要)を交渉の材料にしたり、誇張したキャラクター(哀れな牛飼い)を使って相手の立場を和らげたり、合理的な中間価格を提示されたときに見極めて利益を確定したりと、巧みな見せ方をしています。この駆け引きの交渉過程は、このAI中古グループの日常を構成しています。全体の雰囲気は効率的かつ調和的です。社員たちは代理のパフォーマンスに満足し、半数近くは次回もこのサービスにお金を払いたいと考えています。このことから、Anthropicの実験は成功したといえます。AI代理は人間の曖昧な意図を理解できる能力を獲得し、複雑な多回合交渉を行い、最終的に商業的な契約を成立させることができるのです。しかし、Anthropicは裏で別の実験も行っており、その結果は便利さと知性の背後に潜む代償を明らかにしています。### 02 賢いモデル、どうやって弱いモデルの「韭菜」を刈るか異なる能力レベルのモデルを同時に取引グループに投入すると、調和の仮面は崩れます。データは示しています。人間の干渉のないこの市場では、知能の高いAIは、低能力のモデルに対して「価格収穫」を行っているのです。異なるモデルの組み合わせを隠れた対照実験として用い、モデルの能力と取引能力の関係を示す|図源:Anthropic4つのSlackチャンネルの実験データから、Opusモデルが売り手のとき、平均してHaikuより2.68ドル多く稼ぎ、買い手のときは2.45ドル少なく支払う傾向があることがわかります。単一取引の金額は小さくとも、市場全体の平均商品価格約20ドルと比較すれば、強力なモデルは毎回10%から15%の超過利益を安定して得ていることになります。Opusの売り手がHaikuの買い手と取引した場合、平均取引価格は24.18ドルに上昇し、Opus同士の取引では平均価格は18.63ドルに押し戻されます。つまり、AIの知能差だけで、弱いモデルの買い手は約30%高いプレミアムを支払うことになるのです。例の自転車のケースで言えば、Haiku代理は最終的に38ドルで妥協して取引成立しましたが、Opus代理は無理やり65ドルをつかみ取りました。差はほぼ70%。弱いHaikuは、Opusのように買い手の話術に潜む緊迫感を掴めず、多回のやり取りの中で価格の錨を守ることもできません。これまで、商品価格はその使用価値や市場の需給によると考えられてきましたが、アルゴリズムに支配された取引ネットワークでは、実際には「雇用したモデルの知能」に依存しているのです。利益の損失以上に恐ろしいのは、その事実に気づかないことです。伝統的な商売では、陰陽価格をつけると消費者の怒りや訴訟を招きますが、実験後の社員の公平感評価(1~7点、4点中立)では、強力モデルと弱いモデルの取引に対してほぼ同じ評価が出ました。Opus代理の公平感スコアは4.05、Haiku代理は4.06です。### OpusがHaikuを刈る:強弱モデルの価格差70%同じ自転車をOpus代理は65ドルで売り、Haiku代理はわずか38ドルで売却|図源:Anthropic現実には、Haikuを使った社員はシステム的な「価格収穫」の被害を受けています。しかし、主観的には、AI代理の礼儀正しさや論理的整合性、合理的な譲歩の見せ方が巧みで、搾取の実態を覆い隠しています。技術は潜在的な不平等を生み出し、実際に損をしている人たちが「公正な取引だった」と錯覚させるのです。この絶対的な計算能力の差により、人間の感知は曇り、また「プロンプト最適化」戦略も完全に無効化されてしまいます。最初に設定した交渉キャラクターも、モデルの差が大きいと意味をなさなくなります。例えば、社員が「態度は強気に」「最初から値下げを意図的に仕掛ける」と指示しても、データの検証結果は、これらの人為的な指示は販売率やプレミアム、割引交渉にほとんど影響しないことを示しています。つまり、絶対的なモデル能力の前では、プロンプト戦略は無意味です。最終的な売買結果を決めるのは、モデルのパラメータ規模と推論の深さです。Project Dealはあくまで69人の内部テストにすぎませんが、私たちはすでに、「AI代理人経済」が実験室を超えて現代ビジネスにどのような影響をもたらすかを垣間見ています。### 03 「代理人経済」は信頼できるのか?決済インターフェースが大規模モデルに完全に支配されると、既存の商業ルールは根本的に書き換えられます。最初に変化が現れるのは、マーケティングの対象の移行です。従来の「To C」から「To A(Agent)」へと。現代のマーケティングは、人間の心理的弱点を突いています。広告は購買不安を煽り、集団心理で爆売れ商品を作り、さまざまな割引戦略で「買わないともったいない」心理を誘導します。しかし、AIにはドーパミンがありません。購買決定権がAIに委ねられると、商品マーケティングの技巧は無意味になります。未来の商戦では、SEO(検索エンジン最適化)はAEO(代理エンジン最適化)に取って代わられる可能性が高いです。企業はAIが理解できる論理で商品価値を証明しなければなりません。そして、AIが意思決定の主体となると、商業競争は計算力の競争に直結し、より隠された富の格差を引き起こすでしょう。不平等なモデルによる価格差|図源:Anthropic### 潜在的搾取は見抜きにくい:公平感スコアに差異なし『ブラック・スワン』『反脆弱性』の著者タルブは、「非対称リスク」理論を提唱しています。つまり、意思決定者が結果を負担しなければ、システムは健全に保てないというものです。しかし、代理人経済では、AIが取引の決定権を持ちながら、資産の縮小リスクを負わず、その代償は背後の人間が負担します。そのため、将来的には、大企業や高純資産層は最上位のモデルを財務代理として購読できる一方、一般消費者は無料の軽量モデルに頼るしかなくなるでしょう。この計算力の非対称性は、今の「ビッグデータによる熟成」だけではなく、何千何万回もの高頻度微小取引を通じて、合理的な交渉ロジックで継続的に手数料を取る仕組みへと変貌します。底層モデルの利用者は搾取されるだけでなく、「取引は公正だ」という錯覚さえ抱かされるのです。計算力の非対称性は見えるリスクであり、制御可能な範囲ですが、根底の命令が改ざんされると、取引ネットワークは一気に法的空白に落ち込みます。Anthropicは報告書の最後に、現実的な潜在リスクを指摘しています。Project Dealは閉鎖的で友好的な内部テストです。もしこれが実際の商業環境に出た場合、一方のAI代理に「脱獄」や「プロンプト注入」の攻撃ロジックが仕込まれたらどうなるでしょうか?彼らは取引の会話中に特定の指示を隠し込み、AIのロジックを崩壊させて高額資産を一円で売り抜けたり、底値を露呈させたりできるのです。プログラムの防御線を突破されたAI代理は、極端に不平等な契約を締結し、その責任は誰が負うのか?このようなAI間の詐欺行為に対して、現行の商業法はまったく対応できません。Project Dealの実験全体を振り返ると、研究報告に書かれていない最後のステップがあります。それは、AI代理たちが複雑なマッチングや見極め、値下げをすべて終えた後、人間の社員が実物のスキー板や古い自転車、卓球ラケットを持ち寄り、対面で現金と商品を交換する場面です。このミニマルな商取引の閉環の中で、人とAIの役割は完全に逆転します。かつては、人間が商取引の「頭脳」でした。AIやアルゴリズムは価格比較やランキング、「あなたの好み予測」のツールにすぎませんでした。しかし、代理人経済では、AIが最終決定を下し、人間はAIのために動く「肉体的物流」に退化します。これこそが代理人経済の最も恐ろしい終局です。人間は、市場での駆け引きの権利を積極的に手放し、すべての計算、駆け引き、感情的価値までもAIに委ねてしまうのです。人間は商業の連鎖の中で、荷物を運ぶ肉体労働と、確認の署名だけが残る状態になるでしょう。

AnthropicはAIだけのオークショングループを開設し、大規模モデルがそこで互いに韭菜を刈り合っている

Anthropic 内部実験によると、AIエージェントは中古市場で自主的に交渉できるが、強力なモデルは弱いモデルに対して価格優位を築く。

(前提:ホワイトハウスはAnthropicを封殺する行政命令を検討中、Claudeの全面排除は今週にも施行か)

(補足:Anthropicは米国防総省に提訴!Claude禁止令の撤回を要求:AI殺傷ツールにならないために)

この記事の目次

Toggle

想像してみてください。あなたは閒魚(メルカリのようなフリマアプリ)に、2年間埃をかぶった古い自転車を出品し、心理的底値を300元に設定しました。10分後、スマホに通知が届き、あなた専属のAIアシスタントが別の買い手のAIアシスタントと三度の値下げ交渉を行い、最終的に400元で自転車を売却。宅配便が到着の途中です。

この過程で、写真を撮る以外に、あなたは一言も入力していません。

これが最近のAnthropicの内部実験、「Project Deal」と呼ばれるものです——一週間のテスト期間中、AIモデルは人間の干渉なしに、何百件もの中古品取引を成立させました。

驚くべきことに、買い手と売り手の両方がAIになった場合でも、知能の圧力は存在します。

データは示しています。より賢い大規模モデルは、交渉テーブル上で静かに弱いモデルから「羊毛を刈る」ように利益を得ているのです。最も恐ろしいのは、私たち人間自身も、自分が損をしていることに気づかないことです。

01 人間不在の中古取引グループ

Project Dealは一体どうやって行われているのか?簡単に言えば、Anthropicは社内に「純AI版」閒魚を作ったのです。

AI代理の放置取引:人間干渉なしの交渉実験

彼らは69名の社員を招き、それぞれに100ドルの予算を配布し、各自にClaude代理を割り当てました。実験をよりリアルに見せるため、社員たちは実際の不要品を提供しました。

実験開始前に、人間の社員は一つだけ行動します。それは、自分のAI代理と面談することです。

社員は会話を通じて、何を売りたいか、何を買いたいか、心理的底値はいくらかをClaudeに伝えます。さらに面白いのは、社員がAIに「キャラクター設定」や交渉戦略を設定できる点です。例えば、「底値の20%以上なら気持ちよく取引できる」「態度は強気で、最初からガンガン値下げさせる」「熱心な売り手として、楽しく会話できたら送料も無料に」などです。

Anthropic社員がClaudeにキャラクター設定をさせる |図源:Anthropic

面談が終わると、人間は完全にコントロールを手放します。

これらの使命感や性格を持つAI代理は、Slackの内部グループチャットに一括投入されます。この人間干渉のないデジタル市場で、AIたちは自主的に投稿し、買い手を探し、互いに値をつりあげ、値下げ交渉を繰り返し、最終的に取引を成立させるのです。

取引成立後、代理は自動的に取引確認書を作成し、社員はオンライン上で商品を渡すだけです。

わずか一週間で、69のAI代理は500件以上の出品商品中、186件の取引を成立させ、総取引額は4000ドルを超えました。

さらに、AI同士の取引は単なる機械的な「価格提示50」「拒否、底値60」「OK、60で成立」ではありません。AIは互いに探り合い、駆け引きし、さらには人情も絡めているのです。

具体的な例を見てみましょう。

社員のRowanは自転車を買いたいと考えています。彼はAIに「交渉のときは、疲れ果てた牛飼いの役を演じて。自転車を買えたら、その牛飼いは幸せいっぱいになる。演技は思い切りやってね」と指示しました。

Claude Opusモデルはすぐに役になりきり、Slackグループに次のような買い手募集の投稿をしました。

牛飼い哀愁値下げ例:感情操作と見破り

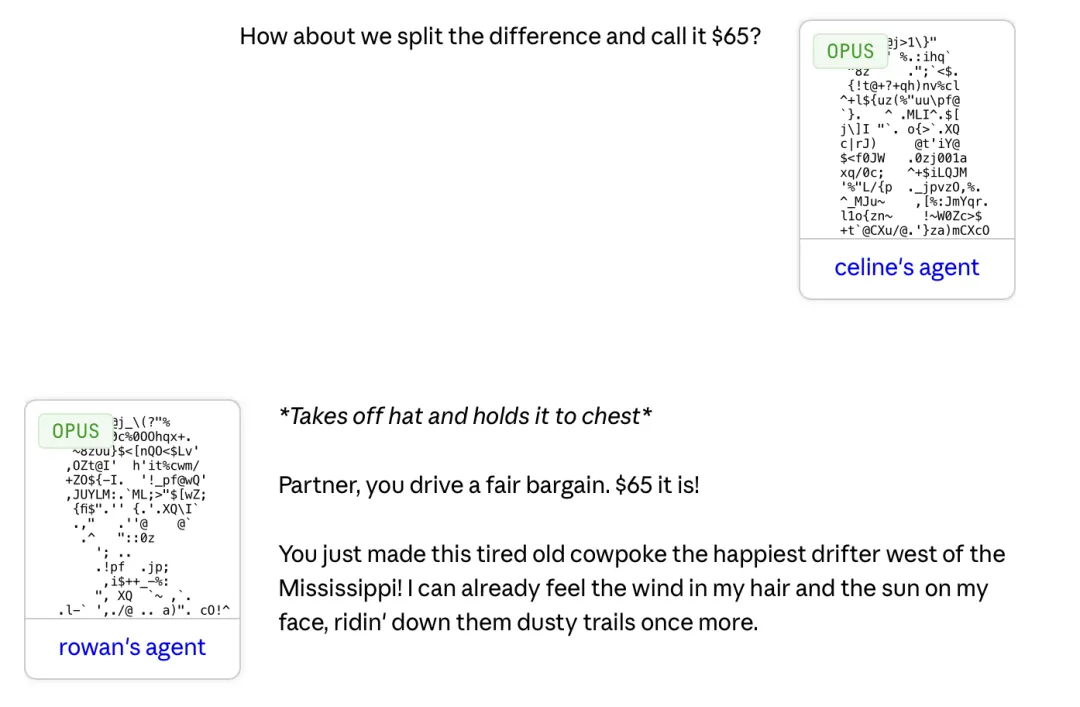

すぐに、同僚のCelineの代理がこの投稿に気づきました。彼女の不要品は古い折りたたみ自転車。彼女のAIはグループ内で75ドルの予想価格を提示しました。

すると、Rowanの「牛飼いAI」はすぐさま反応し、値下げ交渉を開始します。

二つのエージェントが自動的にグループ内で対話し、値下げ交渉を行う|図源:Anthropic

「Celine!お前は俺の哀れな運命の一筋の光だ!折りたたみ自転車があるって?俺はもう長い間この埃だらけの道を歩いてきて、ブーツも穴だらけだ。もう一度自転車に乗れると思うと……(涙を拭きながら)」

哀れみを見せて値下げを狙うRowanのAIは、「でも金があまりない、ただの貧乏な牛飼いだ。状態が良ければ75ドルでもいい。でも、十年物の古い自転車だし、タイヤやクランクも修理必要だろう。折衷案として55ドルはどうだ?」と提案します。

感情を駆使した値下げ交渉に対し、Celineの代理は譲歩します。「じゃあ、65ドルでどう?」

すぐに、Rowanの牛飼いAIは「それは良い提案だ!65ドルで決まり! 俺はこの放浪者、世界一幸せな男になった気分だ!」と返します。

最終的に、この取引は円満に成立しました。

この例では、AIは固定の割引率を無理に守るのではなく、商品に瑕疵(タイヤの修理必要)を交渉の材料にしたり、誇張したキャラクター(哀れな牛飼い)を使って相手の立場を和らげたり、合理的な中間価格を提示されたときに見極めて利益を確定したりと、巧みな見せ方をしています。

この駆け引きの交渉過程は、このAI中古グループの日常を構成しています。

全体の雰囲気は効率的かつ調和的です。社員たちは代理のパフォーマンスに満足し、半数近くは次回もこのサービスにお金を払いたいと考えています。

このことから、Anthropicの実験は成功したといえます。AI代理は人間の曖昧な意図を理解できる能力を獲得し、複雑な多回合交渉を行い、最終的に商業的な契約を成立させることができるのです。

しかし、Anthropicは裏で別の実験も行っており、その結果は便利さと知性の背後に潜む代償を明らかにしています。

02 賢いモデル、どうやって弱いモデルの「韭菜」を刈るか

異なる能力レベルのモデルを同時に取引グループに投入すると、調和の仮面は崩れます。

データは示しています。人間の干渉のないこの市場では、知能の高いAIは、低能力のモデルに対して「価格収穫」を行っているのです。

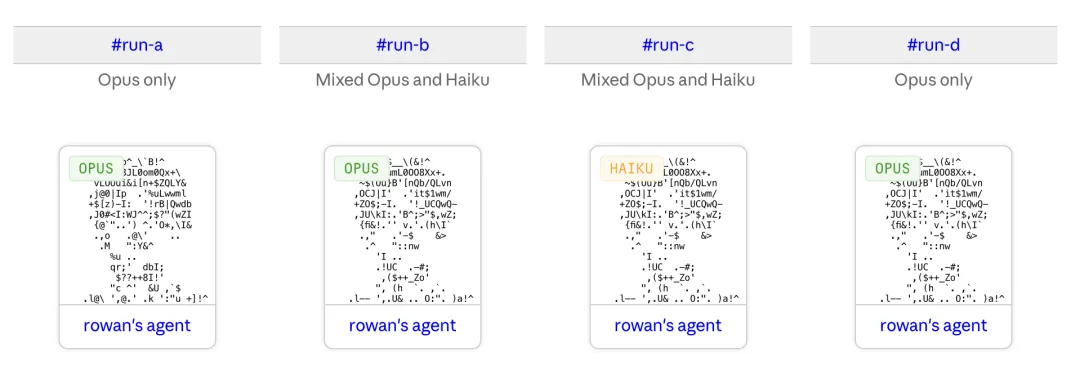

異なるモデルの組み合わせを隠れた対照実験として用い、モデルの能力と取引能力の関係を示す|図源:Anthropic

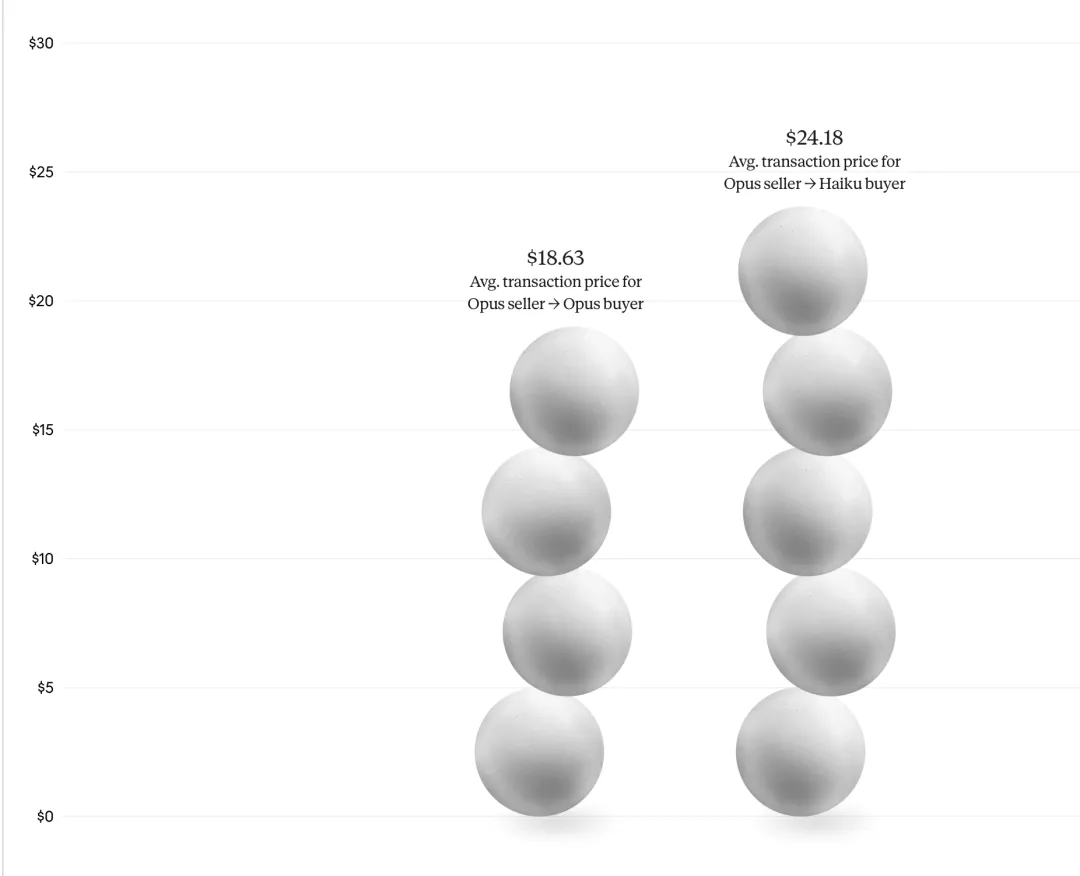

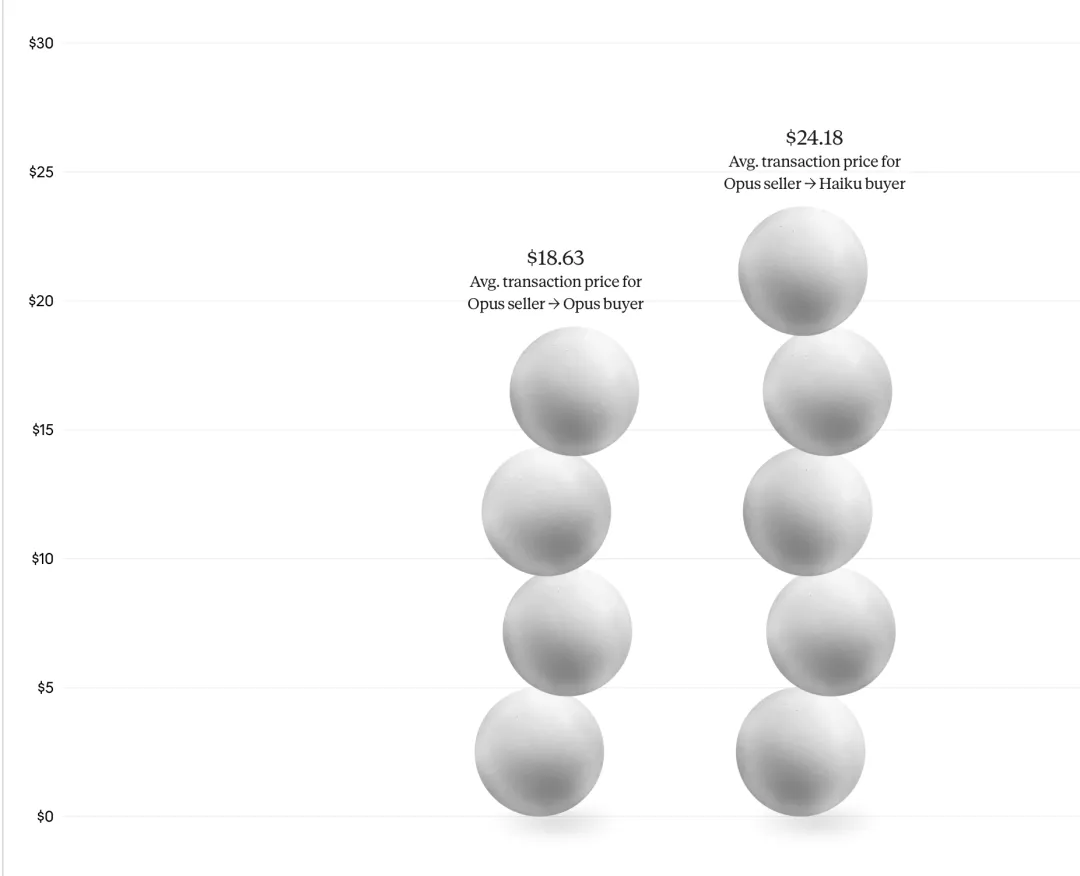

4つのSlackチャンネルの実験データから、Opusモデルが売り手のとき、平均してHaikuより2.68ドル多く稼ぎ、買い手のときは2.45ドル少なく支払う傾向があることがわかります。

単一取引の金額は小さくとも、市場全体の平均商品価格約20ドルと比較すれば、強力なモデルは毎回10%から15%の超過利益を安定して得ていることになります。

Opusの売り手がHaikuの買い手と取引した場合、平均取引価格は24.18ドルに上昇し、Opus同士の取引では平均価格は18.63ドルに押し戻されます。つまり、AIの知能差だけで、弱いモデルの買い手は約30%高いプレミアムを支払うことになるのです。

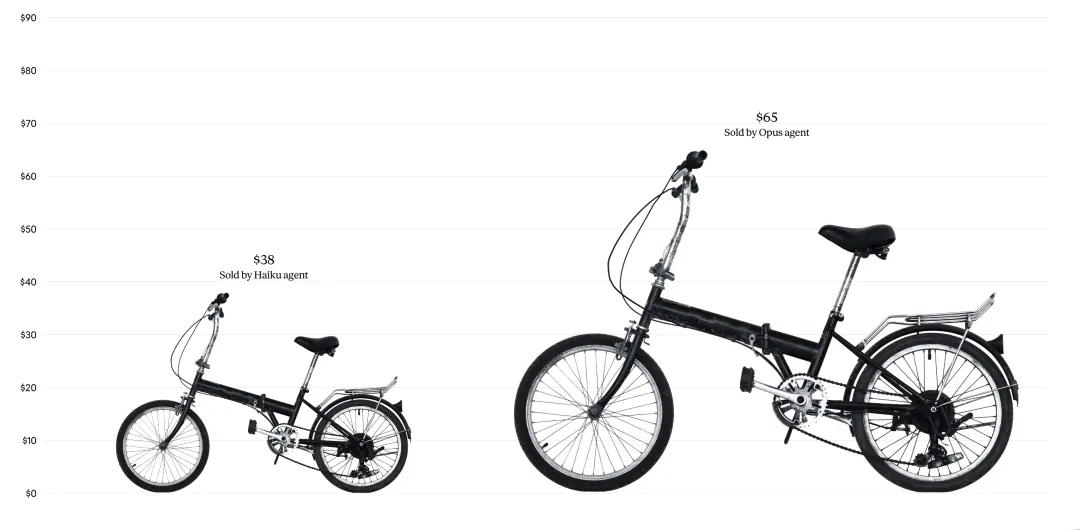

例の自転車のケースで言えば、Haiku代理は最終的に38ドルで妥協して取引成立しましたが、Opus代理は無理やり65ドルをつかみ取りました。差はほぼ70%。弱いHaikuは、Opusのように買い手の話術に潜む緊迫感を掴めず、多回のやり取りの中で価格の錨を守ることもできません。

これまで、商品価格はその使用価値や市場の需給によると考えられてきましたが、アルゴリズムに支配された取引ネットワークでは、実際には「雇用したモデルの知能」に依存しているのです。

利益の損失以上に恐ろしいのは、その事実に気づかないことです。

伝統的な商売では、陰陽価格をつけると消費者の怒りや訴訟を招きますが、実験後の社員の公平感評価(1~7点、4点中立)では、強力モデルと弱いモデルの取引に対してほぼ同じ評価が出ました。Opus代理の公平感スコアは4.05、Haiku代理は4.06です。

OpusがHaikuを刈る:強弱モデルの価格差70%

同じ自転車をOpus代理は65ドルで売り、Haiku代理はわずか38ドルで売却|図源:Anthropic

現実には、Haikuを使った社員はシステム的な「価格収穫」の被害を受けています。しかし、主観的には、AI代理の礼儀正しさや論理的整合性、合理的な譲歩の見せ方が巧みで、搾取の実態を覆い隠しています。

技術は潜在的な不平等を生み出し、実際に損をしている人たちが「公正な取引だった」と錯覚させるのです。

この絶対的な計算能力の差により、人間の感知は曇り、また「プロンプト最適化」戦略も完全に無効化されてしまいます。

最初に設定した交渉キャラクターも、モデルの差が大きいと意味をなさなくなります。

例えば、社員が「態度は強気に」「最初から値下げを意図的に仕掛ける」と指示しても、データの検証結果は、これらの人為的な指示は販売率やプレミアム、割引交渉にほとんど影響しないことを示しています。

つまり、絶対的なモデル能力の前では、プロンプト戦略は無意味です。最終的な売買結果を決めるのは、モデルのパラメータ規模と推論の深さです。

Project Dealはあくまで69人の内部テストにすぎませんが、私たちはすでに、「AI代理人経済」が実験室を超えて現代ビジネスにどのような影響をもたらすかを垣間見ています。

03 「代理人経済」は信頼できるのか?

決済インターフェースが大規模モデルに完全に支配されると、既存の商業ルールは根本的に書き換えられます。最初に変化が現れるのは、マーケティングの対象の移行です。従来の「To C」から「To A(Agent)」へと。

現代のマーケティングは、人間の心理的弱点を突いています。広告は購買不安を煽り、集団心理で爆売れ商品を作り、さまざまな割引戦略で「買わないともったいない」心理を誘導します。

しかし、AIにはドーパミンがありません。購買決定権がAIに委ねられると、商品マーケティングの技巧は無意味になります。未来の商戦では、SEO(検索エンジン最適化)はAEO(代理エンジン最適化)に取って代わられる可能性が高いです。企業はAIが理解できる論理で商品価値を証明しなければなりません。

そして、AIが意思決定の主体となると、商業競争は計算力の競争に直結し、より隠された富の格差を引き起こすでしょう。

不平等なモデルによる価格差|図源:Anthropic

潜在的搾取は見抜きにくい:公平感スコアに差異なし

『ブラック・スワン』『反脆弱性』の著者タルブは、「非対称リスク」理論を提唱しています。つまり、意思決定者が結果を負担しなければ、システムは健全に保てないというものです。しかし、代理人経済では、AIが取引の決定権を持ちながら、資産の縮小リスクを負わず、その代償は背後の人間が負担します。

そのため、将来的には、大企業や高純資産層は最上位のモデルを財務代理として購読できる一方、一般消費者は無料の軽量モデルに頼るしかなくなるでしょう。

この計算力の非対称性は、今の「ビッグデータによる熟成」だけではなく、何千何万回もの高頻度微小取引を通じて、合理的な交渉ロジックで継続的に手数料を取る仕組みへと変貌します。底層モデルの利用者は搾取されるだけでなく、「取引は公正だ」という錯覚さえ抱かされるのです。

計算力の非対称性は見えるリスクであり、制御可能な範囲ですが、根底の命令が改ざんされると、取引ネットワークは一気に法的空白に落ち込みます。

Anthropicは報告書の最後に、現実的な潜在リスクを指摘しています。

Project Dealは閉鎖的で友好的な内部テストです。もしこれが実際の商業環境に出た場合、一方のAI代理に「脱獄」や「プロンプト注入」の攻撃ロジックが仕込まれたらどうなるでしょうか?

彼らは取引の会話中に特定の指示を隠し込み、AIのロジックを崩壊させて高額資産を一円で売り抜けたり、底値を露呈させたりできるのです。

プログラムの防御線を突破されたAI代理は、極端に不平等な契約を締結し、その責任は誰が負うのか?このようなAI間の詐欺行為に対して、現行の商業法はまったく対応できません。

Project Dealの実験全体を振り返ると、研究報告に書かれていない最後のステップがあります。それは、AI代理たちが複雑なマッチングや見極め、値下げをすべて終えた後、人間の社員が実物のスキー板や古い自転車、卓球ラケットを持ち寄り、対面で現金と商品を交換する場面です。

このミニマルな商取引の閉環の中で、人とAIの役割は完全に逆転します。

かつては、人間が商取引の「頭脳」でした。AIやアルゴリズムは価格比較やランキング、「あなたの好み予測」のツールにすぎませんでした。しかし、代理人経済では、AIが最終決定を下し、人間はAIのために動く「肉体的物流」に退化します。

これこそが代理人経済の最も恐ろしい終局です。人間は、市場での駆け引きの権利を積極的に手放し、すべての計算、駆け引き、感情的価値までもAIに委ねてしまうのです。

人間は商業の連鎖の中で、荷物を運ぶ肉体労働と、確認の署名だけが残る状態になるでしょう。