OpenAI、ペンタゴンとの契約における安全性の「レッドライン」を主張—しかし、ユーザーはそれを信じていない

要点

- OpenAIは、機密環境でのAI展開のためにペンタゴンと契約を締結した。

- 同社は「レッドライン」を設定したと述べたが、契約は「すべての合法的な目的」を許可しており、その解釈は最終的に政府の判断に委ねられる。

- この論争はQuitGPT運動を引き起こし、Claudeのダウンロード数増加を促した。

OpenAIは今週末、米軍との協力の一環として高度なAIシステムを機密環境で展開する契約をペンタゴンと結んだと発表した。これは同社の米軍との協力拡大を示す重要な動きである。 この発表は、トランプ政権がAnthropicを「国家安全保障に対するサプライチェーンリスク」としてブラックリストに載せた24時間以内の出来事であり、監視や自律兵器に関する契約条項を巡る争いを背景としている。 ドナルド・トランプ大統領は連邦機関に対し、Anthropicの技術の使用を直ちに停止するよう指示し、財務長官スコット・ベッセントはX上で、「当省はAnthropicの製品全ての使用、特にClaudeプラットフォームの使用を終了する」と述べた。

「アメリカ合衆国は、過激な左翼やウオーク企業に我々の偉大な軍隊の戦い方や勝利の方法を決めさせることは決してない!その決定は、あなたの最高司令官と私が任命した優秀な指導者たちに委ねられている。

Anthropicの左翼狂信者たち… pic.twitter.com/aIEx92nnyx

— ホワイトハウス (@WhiteHouse) 2026年2月27日

AIに関する発表のタイミングは、OpenAIの契約を厳しい目で見られる要因となった。同社は詳細なブログ投稿で、「レッドライン」として設定した内容や、ペンタゴンとの提携を規定する安全策を説明した。 OpenAIが示す契約内容は、国家安全保障の場でAIシステムがどのように管理されるか、また同社の制限が実際にどう解釈・執行されるかについて、より広範な疑問を投げかけている。 「合法的」だけでは不十分な場合 OpenAIのブログは、三つの非交渉条項を最初に掲げている:国内の大規模監視への技術利用禁止、自律兵器の独立運用禁止、社会信用スコアのような高リスクの自動意思決定への使用禁止だ。 次に、実際の契約条項が登場するが、OpenAIはこれを「関連する言語」と呼び、「完全な契約」とは呼ばない。

「戦争省は、適用法令、運用要件、確立された安全・監督プロトコルに沿った範囲で、すべての合法的目的にAIシステムを使用できる」とOpenAIは述べている。 これが、Anthropicが交渉中に政府から求められていたと述べた正確なフレーズと一致している。Anthropicが拒否したフレーズでもある。OpenAIはこれに署名したが、自社のレッドラインは完全に維持されていると主張している。 しかし、「合法的」という表現は国家安全保障の文脈では固定された境界ではなく、法律、行政命令、内部指示、しばしば機密の法的解釈の寄せ集めの中に存在している。契約が「すべての合法的目的」を許す場合、その実質的な制限は、ベンダーが定める基準ではなく、政府の現行法的枠組みに依存することになる。 複数の条項の集合 兵器に関する条項は、「法令、規制、または省の方針により人間の管理が必要な場合を除き、自律兵器を独立して運用しない」と記されている。 この禁止は、既存の方針、特に米国防総省の指令3000.09に基づいている。この指令は、自律システムに対し、「適切なレベルの人間の判断を武力行使に行使できるようにする」ことを求めている。 そして、「適切な」は非常に主観的な表現だ。 人間の 判断 は人間の 管理 ではない。この区別は意図的であり、防衛学者は、「人間のループ」言語を省略したのは、運用の柔軟性を保つためだと指摘している。

OpenAIの最も強力な反論は、そのクラウド専用展開アーキテクチャだ。完全自律の致死決定ループは、戦場の端末にエッジ展開を必要とし、これはこの契約では許可されていない。これは実際の技術的制約だ。 しかし、クラウドベースのAIは、ターゲット識別、ライフパターン分析、ミッション計画などを行える。これらは最終的なトリガーがどこにあっても、キルチェーンの活動に変わりはない。ターゲットに対する結果は、モデルが動作するサーバーによって変わらない。 監視条項も同様のパターンをたどる。OpenAIの示すレッドラインは、「大量の国内監視禁止」だ。契約条項は、「これらの権限に沿った範囲で、米国人の私的情報の無制限監視にシステムを使用しない」とし、第四修正、FISA、行政命令12333を列挙している。 「無制限」という言葉は、制約された形の大量監視が許容されることを示唆している。そして、行政命令12333は、NSAが米国内外で米国人の通信を傍受するために用いる命令だ。 ここで、Anthropicの懸念が顕著になる。交渉中の文言について、Anthropicは、現行法はAIの可能性に追いついていないと主張した。政府は、令状なしに米国人に関する膨大な商業データを合法的に購入でき、すでに行っている。 OpenAIの契約条項は、既存の法的枠組みに保護を依存させているため、Anthropicが懸念したギャップを完全には埋めていない可能性がある。 アルトマンの反応 土曜夜、AltmanはAMAを開催し、契約についての数千の質問に答えた。政府との提携を辞める理由について尋ねられると、「違憲または違法なことを求められた場合は辞退する」と答えた。

違憲または違法なことを求められたら、辞退します。必要なら私を牢に入れてください。

— サム・アルトマン (@sama) 2026年3月1日

この表現は、OpenAIの限界を「合法性」に置いている。つまり、倫理的判断や企業の意志ではなく、あくまで合法かどうかに基づくということだ。将来的な「合法」の解釈を巡る争いについて心配しているかと問われ、彼はリスクを認めた。「その争いに巻き込まれることもあるが、そのリスクは明らかだ」と述べた。 なぜOpenAIがAnthropicと異なる契約に至ったのかについて、Altmanは次のように述べている。「Anthropicは契約の具体的禁止事項に焦点を当てていたが、私たちは適用法に基づく方針を重視した。技術的な安全策に頼る方が確実だと感じている。Anthropicは運用上のコントロールをもっと求めていたのかもしれない。」 これは、哲学的な根本的違いだ。Anthropicは、最先端モデルは予測困難な軍事・情報用途に再利用される可能性があるため、制限は明示的かつ拘束力のある書面で示す必要があると主張している。一方、OpenAIは、技術的アーキテクチャ、関係者の配置、既存の法律の方が、契約書だけの安全策よりも堅固だと考えている。 世論の反応

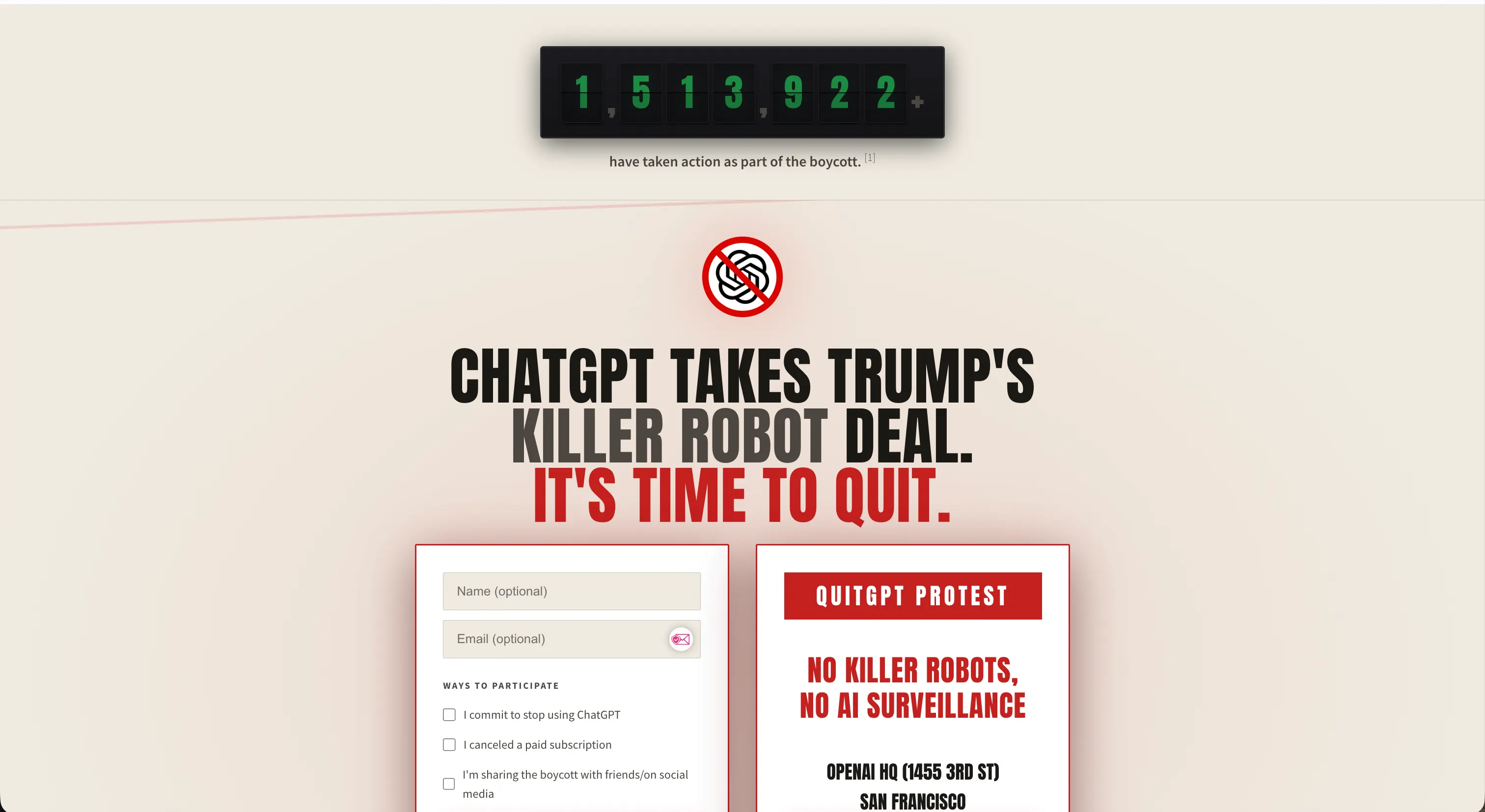

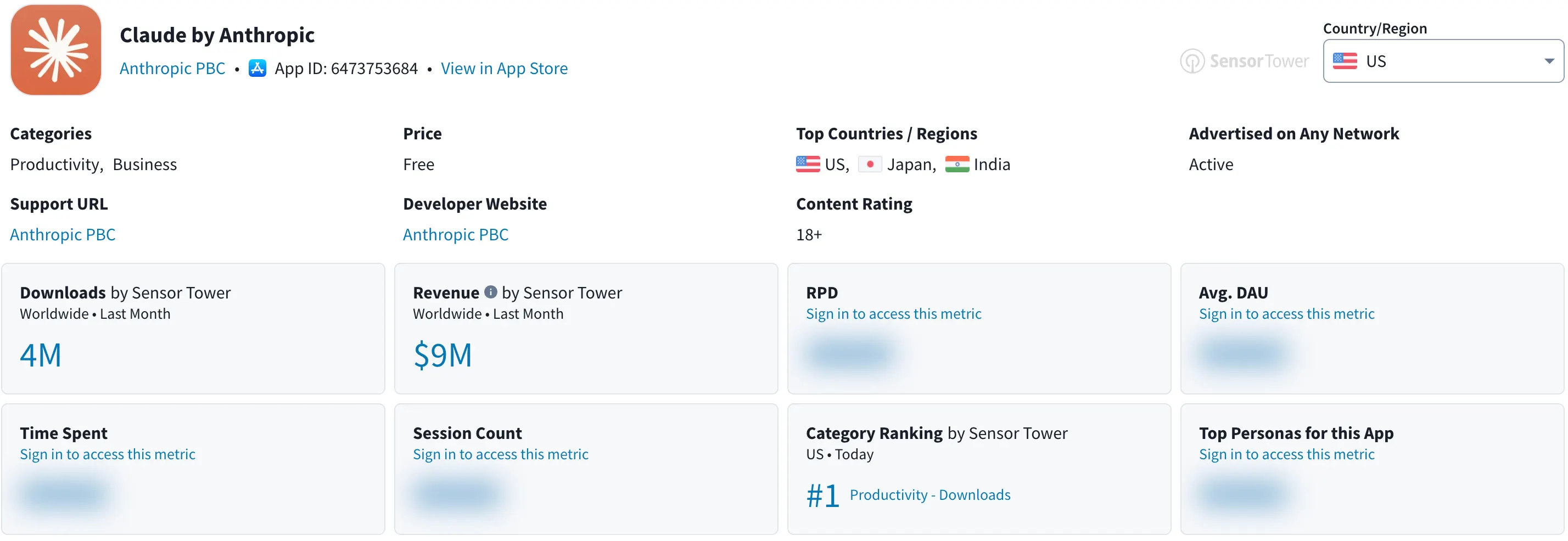

反発は即座に始まった。月曜日までに、「QuitGPT」運動は150万人以上が行動を起こしたと主張し、サブスクリプションの解約やボイコット投稿の共有、quitgpt.orgへの登録を行った。 このキャンペーンは、OpenAIの動きがユーザーの安全よりも軍事契約を優先したとし、「殺人ロボットや大量監視を含む『合法的な目的』のために技術を使わせることに同意した」と非難した。 OpenAIはこの評価に異議を唱えるかもしれないが、市場は動いた。 AnthropicのClaudeは、AppleのApp StoreでChatGPTを抜き、米国で最もダウンロードされた無料アプリとなった。同社は_decrypt_に対し、週末に記録的な日次登録者数を記録したと語った。 ポップスターのケイティ・ペリーは、Claudeの価格ページのスクリーンショットをXに投稿した。何百人ものユーザーがRedditでサブスクリプション解約を公に記録した。サンフランシスコのオフィス前にはAnthropicを称賛する落書きが現れ、OpenAIの歩道にはチョーク攻撃が行われた。OpenAIの従業員の中には、以前、Anthropicの拒否を支持する公開書簡に署名した者もいる。

QuitGPTのフレーミングは感情的に訴えるものだが、完全に正確ではない。Anthropicは、PalantirやAmazon Web Servicesと提携し、米国の情報機関や防衛省にClaudeモデルへのアクセスを許可している。さらに、ベネズエラやイランの政権転覆に軍事作戦で利用されたとも報告されている。AIの倫理や国家安全保障の契約は、どちら側も決してクリーンな状態ではなかった。 キャンペーンが正確に捉えたのは、多くのユーザーが、両社の制限の引き方に意味のある違いがあると信じ、その違いを支持してサブスクリプションを選択したという点だ。 その違いが実際にどれほど重要かは、契約内容を注意深く読む必要がある。