72時間、三重危機:Anthropicの魂がオークションにかけられている

執筆:Ada、深潮 TechFlow

2月24日、火曜日。ワシントン、ペンタゴン。

AnthropicのCEO Dario Amodeiは国防長官Pete Hegsethの向かいに座っている。NPRやCNNなど複数のメディアが引用した情報筋によると、会談の雰囲気は「礼儀正しい」ものの、内容は全く容赦ない。

Hegsethは彼に最後通牒を突きつけた:金曜日の午後5時01分までにClaudeの軍事利用制限を解除し、「すべての合法的用途」に使用できるようにすること。これには自主兵器の照準や国内大規模監視も含まれる。

さもなくば、2億ドルの契約を取り消す。国防生産法を発動し、強制徴用を行う。Anthropicを「サプライチェーンリスク」としてリストアップし、ロシアや中国の敵対勢力のブラックリストに入れるのと同じ扱いにする。

同じ日に、Anthropicは第三版の「責任ある拡張ポリシー」(RSP 3.0)を静かに発表し、創業以来最も重要な約束の一つを削除した:安全対策が確保できない場合は、より強力なモデルの訓練を行わない。

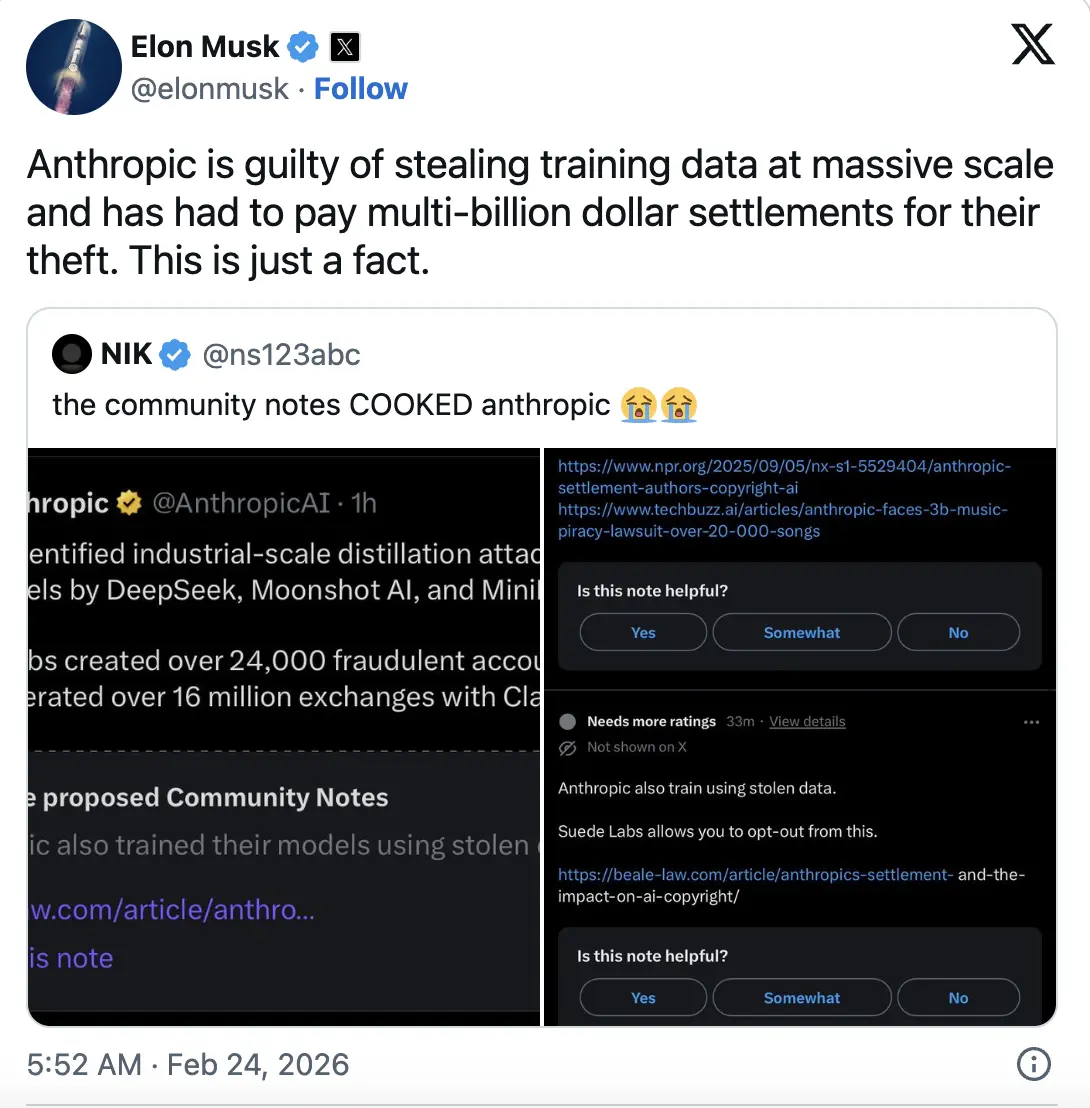

また同じ日に、Elon MuskはX上で「Anthropicは大規模な訓練データの窃盗を行っている。これは事実だ」と投稿した。同時に、Xのコミュニティノートは、Anthropicが盗版書籍を使ってClaudeを訓練し、15億ドルの和解金を支払ったとの報道を補足した。

72時間以内に、この「魂を持つ」と自称するAI企業は、三つの役割を演じていた:安全の殉教者、知的財産権の窃盗者、ペンタゴンの裏切り者。

どれが本当なのか?

多分、全部だ。

ペンタゴンの「従え、さもなくば去れ」

物語の第一層は非常に単純だ。

Anthropicは米国防省の機密アクセス権を最初に得たAI企業だ。昨夏に獲得した契約は上限2億ドル。次いでOpenAI、Google、xAIも同規模の契約を獲得した。

Al Jazeeraによると、Claudeは今年1月の米軍作戦に使われたことがあるという。その作戦はベネズエラのマドゥロ大統領の誘拐に関わるものだったと報じられている。

しかし、Anthropicには二つの赤線が引かれている:全自律兵器の照準支援はしない、米国市民の大規模監視には協力しない。Anthropicは、AIの信頼性は武器の操作に十分ではなく、現行の法律や規制もAIの大規模監視への適用を規定していないと考えている。

しかし、ペンタゴンはこれを受け入れない。

ホワイトハウスのAI顧問David Sacksは昨年10月、X上でAnthropicを「恐怖を武器に規制を操る」と公然と非難した。

競合他社はすでに屈服している。OpenAI、Google、xAIは皆、軍に対して「すべての合法的シナリオ」でのAI利用を許可している。MuskのGrokも今週、秘密システムへのアクセスが承認された。

Anthropicだけが最後まで立っている。

執筆時点で、Anthropicは最新の声明で「譲歩するつもりはない」と表明している。しかし、金曜日の5:01の期限は目前だ。

匿名の元司法省・国防省の連絡員はCNNにこう語った:「どうして、ある会社を『サプライチェーンリスク』と宣言しながら、その会社に軍のための仕事を強制できるのか?」

良い質問だが、これはペンタゴンの考慮範囲外だ。彼らが気にするのは、もしAnthropicが妥協しなければ、強制手段に出るか、あるいはワシントンの捨て駒になるかだ。

「蒸留攻撃」:顔面パンチの告発

2月23日、Anthropicは激しい言葉でブログを発表し、中国の三つのAI企業がClaudeに対して「工業レベルの蒸留攻撃」を仕掛けたと非難した。

被告はDeepSeek、Moonshot AI、MiniMax。

Anthropicは、これらの企業が2万4千の偽アカウントを使い、Claudeと1600万回以上のインタラクションを行い、推論、ツール呼び出し、プログラミングの核心能力を狙い撃ちしたと指摘している。

Anthropicはこれを国家安全保障の脅威とみなし、蒸留後のモデルは「安全性のバリアをほぼ保持できない可能性が高く」、権威主義的政府によるサイバー攻撃や偽情報、大規模監視に悪用される恐れがあると警告した。

物語は完璧で、タイミングも絶妙だ。

ちょうどトランプ政権が中国向け半導体輸出規制を緩和した直後、Anthropicが自社の半導体輸出規制に対するロビー活動の弾薬を探しているタイミングだった。

しかし、Muskは一発で反撃した:「Anthropicは大規模に訓練データを窃盗し、そのために数十億ドルの和解金を支払った。これは事実だ。」

AIインフラ企業IO.Netの共同創設者Tory Greenはこう述べる:「全ネットのデータを使って自分たちのモデルを訓練し、その後、他者があなたの公開APIを使って学習したら、それを『蒸留攻撃』と呼ぶのか?」

Anthropicは蒸留を「攻撃」と呼ぶが、この行為はAI業界では日常茶飯事だ。OpenAIはGPT-4の圧縮に使い、GoogleはGeminiの最適化に利用し、Anthropic自身も行っている。唯一の違いは、今回は自分自身のモデルを蒸留されたことだ。

シンガポールの南洋理工大学AI教授Erik CambriaはCNBCに対し、「合法的な利用と悪意ある利用の境界はしばしば曖昧だ」と述べている。

さらに皮肉なことに、Anthropicは盗版書籍を使ってClaudeを訓練し、15億ドルの和解金を支払った直後に、公開APIを使って他者が学習していると非難している。これは二重基準どころか三重基準だ。

Anthropicは被害者を演じたかったが、結局は被告に成り下がった。

安全約束の解体:RSP 3.0

ペンタゴンと対立し、シリコンバレーと激しくやり合った同じ日に、Anthropicは第三版の責任ある拡張ポリシーを発表した。

Anthropicの主任科学者Jared Kaplanはメディアのインタビューでこう述べた:「我々はAIモデルの訓練停止は誰の役にも立たないと考えている。AIの急速な進展の中で、一方的に約束をすることは……競合他社が全速力で進めているのに意味がない。」

つまり、他者が武士道を守らなくても、我々も守らない、ということだ。

RSP 1.0と2.0の核心は、「モデルの能力が安全対策の範囲を超えた場合は訓練を停止する」という硬い約束だった。この約束により、AnthropicはAI安全の分野で唯一無二の評判を築いた。

しかし、3.0ではそれを削除した。

代わりに、より「柔軟」な枠組みを導入し、Anthropicが自ら実施可能な安全対策と、業界全体で協力すべき安全提言を二つの軌道に分けた。3〜6ヶ月ごとにリスクレポートを発行し、外部の専門家に審査を依頼する。

これを責任ある措置と呼べるだろうか?

非営利団体METRの独立審査員Chris Painterは、政策の初期草案を見てこうコメントした:「これは、Anthropicがリスク評価と緩和の方法が能力の伸びに追いついていないと認めている証拠だ。社会はAIの潜在的な破滅的リスクに対して十分に備えていない、ということだ。」

TIMEの報道によると、Anthropicはこの改訂に約1年をかけて内部議論を重ね、CEOのAmodeiと取締役会が全会一致で承認したという。公式見解は、「当初のポリシーは業界の合意を促進するためだったが、実際には業界が追いつかなかった」とのこと。トランプ政権はAIの発展を放任し、各州の規制も廃止しようとした。連邦レベルのAI法案は遠い未来の話だ。2023年にグローバルなガバナンス枠組みを構築する可能性もあったが、すでに3年が経ち、その扉は閉じられた。

AIガバナンスを長年追い続ける匿名の研究者はこう言う:「RSPはAnthropicの最も価値あるブランド資産だ。訓練停止の約束を削除するのは、有機食品のパッケージから『有機』の文字をこっそり剥がし、透明性を高めたと偽るようなものだ。」

3800億ドルの評価とアイデンティティの裂け目

2月初旬、Anthropicは3800億ドルの評価額で300億ドルの資金調達を完了した。アマゾンが主要投資者だ。創業以来、年平均収益は140億ドルに達し、過去3年間で毎年10倍以上の成長を続けている。

一方、ペンタゴンは同社をブラックリスト入りさせると脅している。Muskはデータ窃盗を公然と非難。自社の安全保障に関わる約束も削除された。AnthropicのAI安全責任者Mrinank Sharmaは辞任後、X上でこう書いた:「世界は危険にさらされている。」

矛盾?

いや、むしろこれがAnthropicの本質だ。

この会社は、元OpenAI幹部が設立した。OpenAIの安全性の進展が速すぎると危惧したためだ。その後、より速く、より強力なモデルを作るために自社を立ち上げ、同時にこれらのモデルの危険性を世界に訴え続けている。

ビジネスモデルは一言で言えば、「我々は誰よりもAIを恐れている。だから資金を出して我々にAIを作らせてほしい」。

このストーリーは2023〜2024年に完璧に機能した。AI安全はワシントンのホットトピックとなり、Anthropicは最も影響力のあるロビイストの一つとなった。

しかし、2026年になると風向きが変わる。

「woke AI」が攻撃のレッテルとなり、州レベルのAI規制法案はホワイトハウスに阻まれる。Anthropicが支援したカリフォルニア州SB 53は成立したものの、連邦レベルでは何も進まない。

Anthropicの安全性を売りにしてきたブランドは、「差別化の優位」から「政治的負の資産」へと滑り落ちつつある。

Anthropicは複雑なバランスを取る必要がある。十分に「安全」でブランドを維持しつつ、市場や政府から見捨てられない「柔軟さ」も必要だ。問題は、その両方の許容範囲が狭まっていることだ。

安全神話の価値はどれほどか?

三つの事象を重ねてみると、全体像が見えてくる。

中国企業のClaude蒸留は、半導体輸出規制のロビー活動を強化するための材料だ。安全停止の約束を削除し、最後の道徳的外衣を失いながらも、五角大楼の自主武器要求を拒否している。

すべてに合理的な理由はあるが、その間には矛盾も存在する。

中国企業が「蒸留」したモデルが国家安全に危険をもたらすとしながら、自分たちのモデルの安全停止約束を削除するのは矛盾だ。もしモデルが本当に危険なら、より慎重になるべきで、むしろ積極的に進めるべきではない。

それがAnthropicなら、という話だ。

AI業界では、声明だけではなく資産負債表がアイデンティティを決める。Anthropicの「安全」神話は、根本的にブランドのプレミアムだ。

AI軍拡競争の初期段階では、そのプレミアムは価値があった。投資家は「責任あるAI」に高い評価を払った。政府も「信頼できるAI」に寛容だった。顧客も「より安全なAI」に金を出した。

しかし、2026年にはそのプレミアムは消えつつある。

今、Anthropicが直面しているのは、「妥協すべきかどうか」の選択ではなく、「誰に先に妥協するか」の優先順位だ。ペンタゴンに妥協すればブランドは傷つく。競合に妥協すれば安全約束は無効になる。投資家に妥協すれば、両方を失う。

金曜日の午後5時01分、Anthropicは答えを出す。

しかし、答えが何であれ、確かなことが一つある。かつて「OpenAIと違う」として立ち上がったAnthropicは、今やすべての人と同じ道を歩み始めている。

アイデンティティの危機の果てには、しばしばアイデンティティの消滅が待っている。