Anthropic、中国の3つのAI蒸餾訓練を非難!ネットユーザーは二重基準を批判:あなたたちも著作権物を盗んでいるのに

Anthropicは、中国のAI企業DeepSeek、Moonshot AI、Minの3社が蒸留法を用いてモデルの能力を複製していると指摘しました。この行為は、ネットユーザーから著作権侵害の疑いを皮肉られ、同時に米国の半導体輸出と国家安全保障に関する激しい議論を引き起こしています。

Anthropicは、中国の3つのAI研究所による蒸留訓練を非難

AIチャットボットClaudeの開発企業Anthropicは、3つの中国AI研究所DeepSeek、Moonshot AI、Minが、24,000を超える偽アカウントを設置し、Claudeモデルに対して1,600万回以上のデータアクセスと交流を行い、蒸留法技術を用いてClaudeの核心能力を自社モデルに移転しようとしたと公表しました。

「蒸留法」とは、古いまたは大規模で成熟したモデルを用いて新モデルの回答品質を評価し、小型でコスト効率の良いモデルが大規模モデルの計算成果を学習・転移できるようにする一般的なAI訓練手法です。

蒸留技術はもともと、AI業界がクライアント向けに軽量化モデルを作成するための合法的な訓練手法でしたが、競合他社もこの手法を利用して他の研究所の研究成果を直接コピーすることが可能です。

Anthropicは、これらの中国AI研究所が代理サーバーを使って検知を回避し、Claudeの差別化された推論能力、ツール使用、プログラムコード作成能力を大規模に取得していたと指摘しています。

図源:X Anthropicは中国AIの蒸留訓練を非難し、先進モデルの能力を取得

ネットユーザーは二重基準を批判、Anthropicは著作権訴訟の争点に

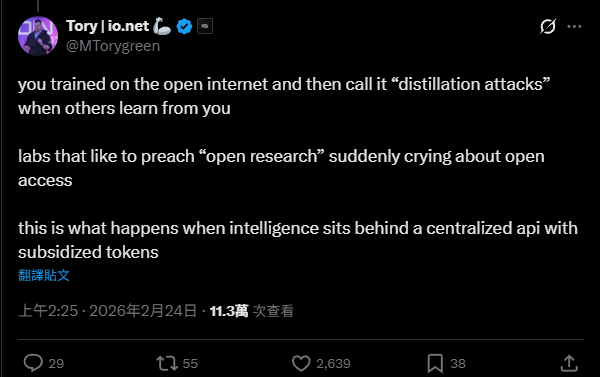

しかし、Anthropicが声明を発表した後、多くのネットユーザーから嘲笑や疑問の声が上がりました。一部の意見では、Anthropicのモデル訓練手法に対する態度に二重基準があると指摘されています。

AIインフラ企業IO.Net共同創業者のTory Greenは、公開されたネット資料を用いて訓練を行うAI企業が、他者から学習されると蒸留攻撃と呼び、普段はオープンな研究を掲げるAnthropicが、今度は公開アクセスを理由に不満を漏らしていると批判しています。

**2025年、米国の著名なフォーラムRedditは、Anthropicを正式に訴え、同社が無許可で10万件を超えるフォーラム投稿とコメントを収集し、Claudeモデルの微調整に使用したとしています。**Redditは、Anthropicが利用規約に違反し、公開停止を宣言した後も、引き続きRedditサーバーに10万回以上アクセスを続けていたと指摘しています。

また、Anthropicは、700万冊の書籍を無断で使用してClaudeを訓練したとして集団訴訟も起こされており、昨年9月には最大の著作権和解金である15億ドルの支払いに合意しました。これは米国史上最大の和解金額となりますが、裁判所の承認待ちです。

- 関連報道: AI史上最大の賠償金!Claudeの著作権侵害訓練書籍、和解金480億円、台湾の作家も賠償対象に

OpenAIもDeepSeekに対して類似の警告

Anthropicに加え、AI大手のOpenAIも同様の状況に直面しています。

《ロイター》が先週入手した内部メモによると、OpenAIは米国立法者に対し、DeepSeekがChatGPTの開発者や米国をリードするAI企業を標的に、モデルの複製と自社のアルゴリズム訓練に利用しようとしていると警告しています。

OpenAIは、DeepSeekの従業員に関連するアカウントが、OpenAIのアクセス制限を回避するためのさまざまな手法を開発していると観察しています。混乱させるためのサードパーティルーターや隠された情報源を経由し、プログラム的に米国のAIモデルにアクセスし、出力結果を蒸留訓練に利用していると指摘しています。

中国AIの蒸留技術論争、米国の半導体輸出規制緩和のタイミング

米国のAI大手が中国の蒸留法訓練技術を非難する中、米国は中国への半導体輸出規制に関して敏感な議論の最中にあります。トランプ政権は1月に、NVIDIAなど米国企業がH200などの先進AI半導体を中国に輸出することを正式に許可しました。

批評家は、AIの世界的な覇権争いの重要な局面で、輸出規制の緩和は中国のAI計算能力を大きく高めると指摘しています。

Silverado Policy Acceleratorのディミトリ・アルペロヴィッチ会長は、**中国のAIモデルの進歩が非常に速いのは、蒸留技術を用いて米国の最先端モデルを盗用している部分もあると述べています。**彼は、米国はこれらの企業にAI半導体の販売を拒否すべきだと呼びかけ、そうしなければ彼らの優位性がさらに拡大すると警告しています。

Anthropicは、米国企業が構築したAIシステムには、国家または非国家の行為者がAIを利用して生物兵器開発や悪意あるサイバー活動を行うのを防ぐ安全対策が備わっていると警告しています。しかし、蒸留法で作られたAIモデルは、必要な防護措置が欠如している場合が多いです。

Anthropicは、海外のAI研究所がこれらの無制限の能力を軍事や情報活動に組み込むことを許せば、権威主義的政府がAIを使った攻撃的サイバー行動、偽情報拡散、大規模監視を行うリスクが倍増すると懸念しています。

関連記事:

中国ハッカーによる大規模AIサイバー攻撃!Anthropic:AIハッカーの速度と規模は人間のハッカーを超えた