OpenAI Klaim Garis Merah Keamanan dalam Kesepakatan Pentagon—Tapi Pengguna Tidak Percaya

Singkatnya

- OpenAI menandatangani kesepakatan dengan Pentagon untuk mengerahkan AI di lingkungan rahasia.

- Perusahaan mengatakan mereka memberlakukan “garis merah,” tetapi kontrak mengizinkan “semua tujuan yang sah,” sebuah standar yang pada akhirnya bergantung pada interpretasi pemerintah sendiri.

- Kontroversi memicu gerakan QuitGPT dan mendorong lonjakan unduhan Claude.

OpenAI mengatakan akhir pekan ini bahwa mereka telah mencapai kesepakatan dengan Pentagon untuk mengerahkan sistem AI canggih di lingkungan rahasia, menandai perluasan signifikan dari kerja sama perusahaan dengan militer AS. Pengumuman ini muncul kurang dari 24 jam setelah pemerintahan Trump memasukkan Anthropic ke daftar hitam, menandai perusahaan AI pesaing sebagai “risiko rantai pasokan terhadap keamanan nasional” setelah sengketa terkait bahasa kontrak mengenai pengawasan dan senjata otonom. Presiden Donald Trump juga memerintahkan lembaga federal segera berhenti menggunakan teknologi Anthropic, dengan Menteri Keuangan Scott Bessent menulis di X hari Senin bahwa lembaga tersebut “menghentikan semua penggunaan produk Anthropic, termasuk platform Claude-nya, di dalam departemen kami.”

"AMERIKA SERIKAT TIDAK PERNAH MENGIZINKAN PERUSAHAAN KIRI RADIKAL, WOKE UNTUK MENGATUR CARA MILITER KITA BERPERANG DAN MENANG! Keputusan itu adalah hak KOMANDAN TERTINGGI ANDA, dan para pemimpin hebat yang saya tunjuk untuk menjalankan Militer kita.

Orang-orang kiri gila di Anthropic… pic.twitter.com/aIEx92nnyx

— The White House (@WhiteHouse) 27 Februari 2026

Waktu pengumuman AI ini menempatkan kesepakatan OpenAI di bawah pengawasan ketat. Dalam sebuah posting blog rinci, perusahaan menguraikan apa yang mereka sebut sebagai “garis merah” yang tegas dan lapisan perlindungan yang mengatur kemitraan mereka dengan Pentagon. Kesepakatan yang disampaikan oleh OpenAI menimbulkan pertanyaan lebih luas tentang bagaimana sistem AI akan diatur dalam konteks keamanan nasional, dan bagaimana batasan yang dinyatakan perusahaan akan diinterpretasikan dan ditegakkan secara praktis. Ketika “sah” tidak cukup Posting blog OpenAI dibuka dengan tiga komitmen yang digambarkan sebagai tidak dapat dinegosiasikan: tidak menggunakan teknologi mereka untuk pengawasan massal domestik, untuk mengarahkan sistem senjata otonom secara independen, atau untuk keputusan otomatis berisiko tinggi seperti penilaian kredit sosial. Lalu muncul bahasa kontrak yang sebenarnya—yang secara khusus OpenAI sebut “bahasa yang relevan,” bukan “kesepakatan lengkap.”

“Departemen Perang dapat menggunakan sistem AI untuk semua tujuan yang sah, sesuai dengan hukum yang berlaku, kebutuhan operasional, dan protokol pengawasan serta keselamatan yang sudah mapan,” kata OpenAI. Itu adalah frasa tepat yang dikatakan Anthropic bahwa pemerintah telah tuntut selama negosiasi. Frasa yang sama yang ditolak oleh Anthropic. OpenAI menandatanganinya, tetapi berargumen bahwa garis merah mereka tetap utuh. Namun, “sah” dalam konteks keamanan nasional bukanlah batas tetap—ia hidup di dalam kerangka undang-undang, perintah eksekutif, arahan internal, dan sering kali interpretasi hukum yang bersifat rahasia. Ketika kontrak memberi izin “semua tujuan yang sah,” batas praktisnya menjadi kerangka hukum saat ini dari pemerintah, bukan standar independen yang ditetapkan vendor. Sekumpulan klausul Ketentuan senjata menyatakan bahwa sistem AI “tidak akan digunakan untuk mengarahkan senjata otonom secara independen dalam kasus di mana hukum, regulasi, atau kebijakan departemen mengharuskan kontrol manusia.” Larangan ini hanya berlaku jika otoritas lain sudah mewajibkan kontrol manusia—mengambil kekuatannya dari kebijakan yang ada, khususnya DoD Directive 3000.09. Arahan ini mengharuskan sistem otonom memungkinkan komandan untuk menerapkan “tingkat penilaian manusia yang sesuai terhadap penggunaan kekerasan.” Dan “sesuai” adalah istilah yang sangat subjektif. Penilaian manusia bukan kontrol manusia. Perbedaan ini tidak kebetulan. Para ahli pertahanan mencatat bahwa penghilangan bahasa “human-in-the-loop” dilakukan secara sengaja, tepat untuk menjaga fleksibilitas operasional.

Argumen terkuat OpenAI adalah arsitektur penyebarannya yang berbasis cloud—loop pengambilan keputusan mematikan yang sepenuhnya otonom memerlukan penyebaran di perangkat di medan perang, yang tidak diizinkan oleh kontrak ini. Itu adalah batasan teknis nyata. Tapi AI berbasis cloud tetap bisa melakukan identifikasi target, analisis pola kehidupan, dan perencanaan misi. Itu adalah aktivitas rantai pembunuhan terlepas dari di mana trigger akhir berada. Hasil untuk target tidak berbeda tergantung server mana yang menjalankan model. Klausul pengawasan mengikuti pola serupa. Garis merah yang dinyatakan OpenAI: tidak ada pengawasan massal domestik. Bahasa kontrak: Sistem “tidak akan digunakan untuk pengawasan tanpa batas terhadap informasi pribadi warga AS sesuai dengan otoritas ini”—kemudian mencantumkan Amandemen Keempat, FISA, dan Perintah Eksekutif 12333. Kata “tanpa batas” menyiratkan bahwa versi pengawasan massal yang terbatas akan diizinkan. Dan EO 12333 adalah perintah eksekutif yang digunakan NSA untuk membenarkan penyadapan komunikasi warga AS saat dilakukan di luar perbatasan AS. Di sinilah kekhawatiran Anthropic tentang wording selama negosiasi menjadi terlihat. Argumen Anthropic adalah bahwa hukum saat ini belum mengikuti apa yang dimungkinkan AI. Pemerintah secara legal dapat membeli data komersial yang besar tentang warga AS tanpa surat perintah—dan sudah melakukannya. Bahasa kontrak OpenAI, yang mengaitkan perlindungannya dengan kerangka hukum yang ada, mungkin tidak menutup celah yang sebenarnya dikhawatirkan Anthropic. Respon Altman Pada Sabtu malam, Altman mengadakan AMA untuk menjawab ribuan pertanyaan tentang kesepakatan tersebut. Ketika ditanya apa yang akan membuat OpenAI mundur dari kemitraan pemerintah, dia menjawab: “Jika kami diminta melakukan sesuatu yang tidak konstitusional atau ilegal, kami akan mundur.”

Jika kami diminta melakukan sesuatu yang tidak konstitusional atau ilegal, kami akan mundur. Jika perlu, datanglah kunjungi saya di penjara.

— Sam Altman (@sama) 1 Maret 2026

Kerangka ini menempatkan batas OpenAI pada aspek legal—bukan pada penilaian etis independen tentang apa yang akan atau tidak akan diizinkan perusahaan jika itu legal, yang menjadi pembelaan Anthropic. Ditanya apakah dia khawatir tentang sengketa di masa depan mengenai apa yang dianggap “legal,” dia mengakui risikonya: “Kalau harus berjuang soal itu, kami akan, tapi jelas menempatkan kami pada risiko tertentu.” Mengapa OpenAI mencapai kesepakatan yang tidak bisa dilakukan Anthropic, Altman menjelaskan: “Anthropic tampaknya lebih fokus pada larangan spesifik dalam kontrak, daripada mengutip hukum yang berlaku, yang menurut kami nyaman. Saya lebih memilih mengandalkan perlindungan teknis jika harus memilih satu. Saya rasa Anthropic mungkin menginginkan kontrol operasional lebih besar daripada kami.” Itu adalah perbedaan filosofi yang substantif. Anthropic berargumen bahwa karena model frontier dapat diubah penggunaannya untuk intelijen dan alur kerja militer dengan cara yang sulit diprediksi, batasan harus eksplisit dan mengikat secara tertulis, bahkan dengan risiko kehilangan kesepakatan. Posisi OpenAI adalah bahwa arsitektur teknis, personel yang terlibat, dan kerangka hukum yang ada bersama-sama merupakan perlindungan yang lebih kuat daripada teks kontrak semata. Publik memilih satu pihak

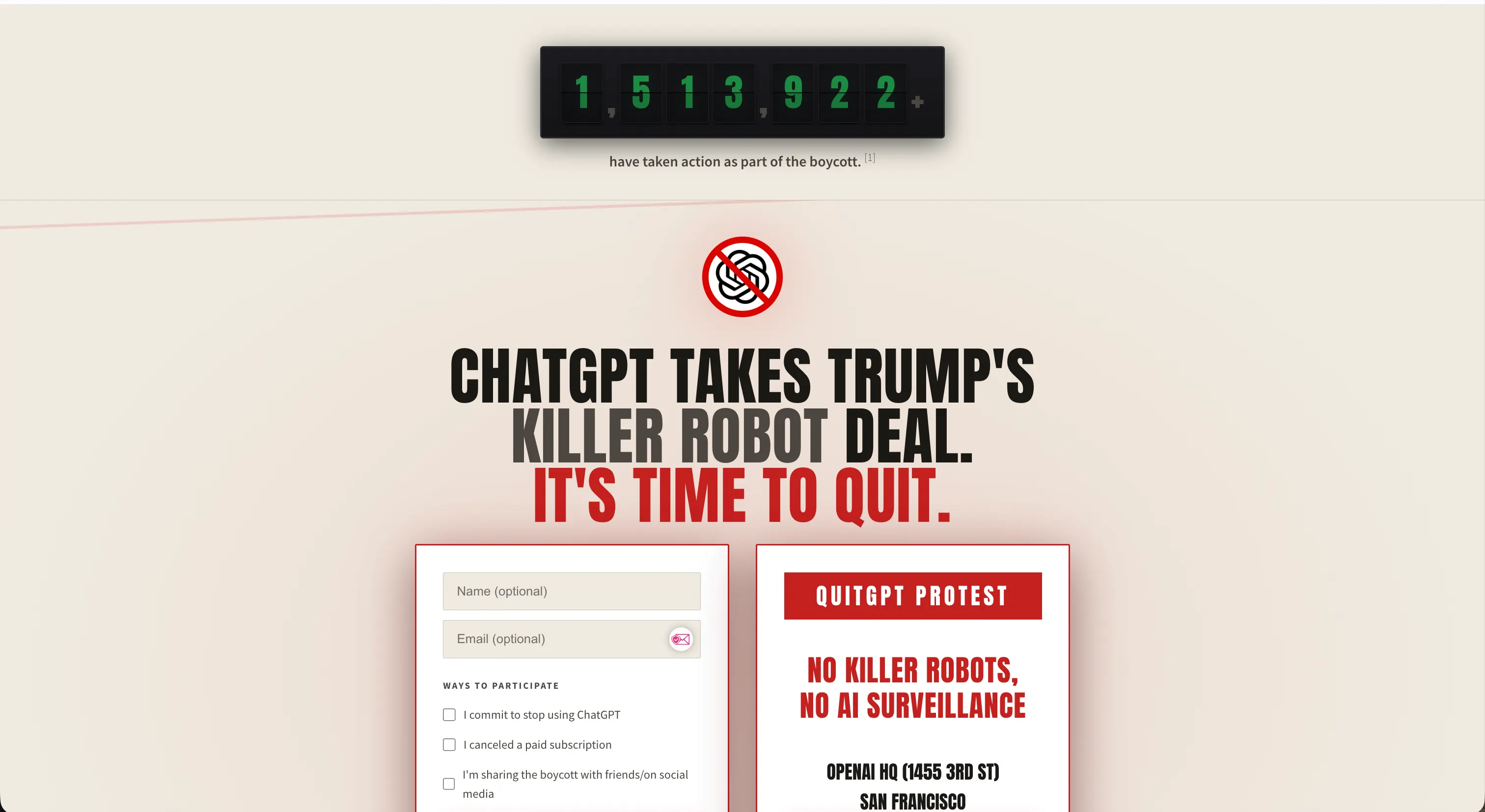

Respon keras langsung muncul. Pada hari Senin, gerakan “QuitGPT” mengklaim bahwa lebih dari 1,5 juta orang telah bertindak—membatalkan langganan, membagikan posting boikot, atau mendaftar di quitgpt.org.

Kampanye ini menggambarkan langkah OpenAI sebagai prioritas kontrak militer di atas keselamatan pengguna, menuduh perusahaan menyetujui Pentagon menggunakan teknologinya untuk “tujuan apa pun yang sah, termasuk robot pembunuh dan pengawasan massal.”

OpenAI mungkin membantah karakterisasi tersebut. Tapi pasar bergerak terlepas dari itu.

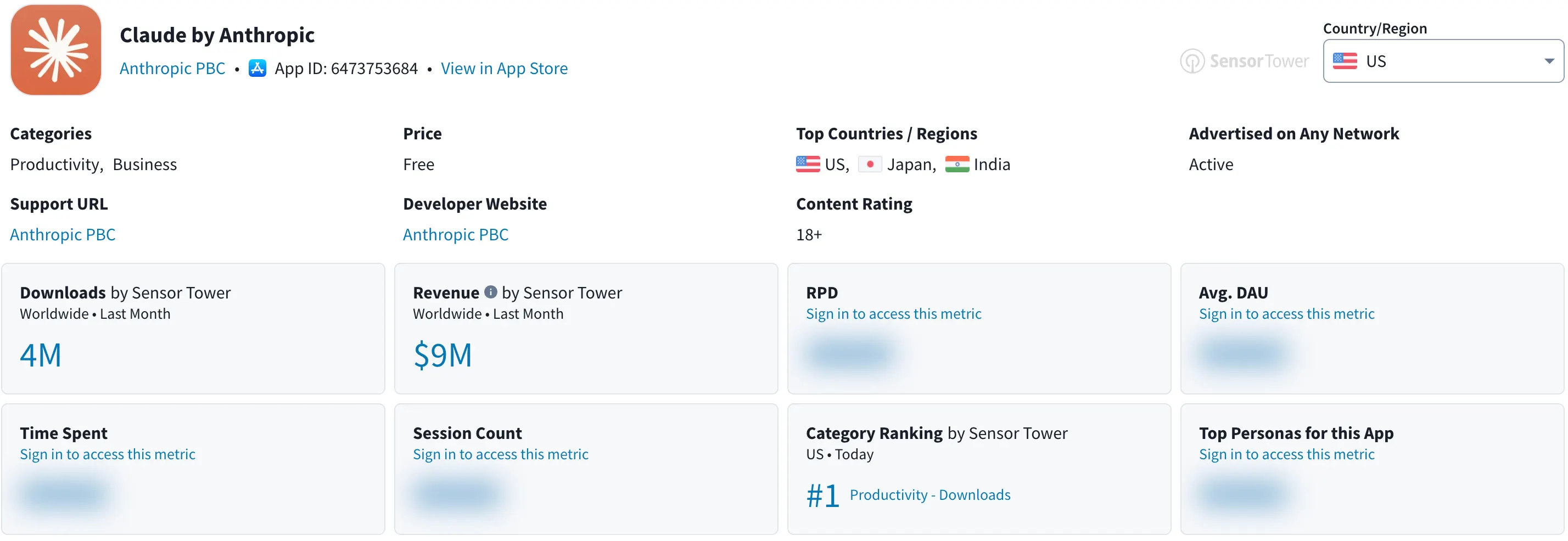

Claude dari Anthropic melampaui ChatGPT menjadi aplikasi gratis yang paling banyak diunduh di Amerika Serikat di App Store Apple, dengan perusahaan mengatakan kepada Decrypt bahwa mereka melihat rekor pendaftaran harian selama akhir pekan.

Bintang pop Katy Perry membagikan tangkapan layar halaman harga Claude di X. Ratusan pengguna secara terbuka membatalkan langganan mereka di Reddit. Grafiti yang memuji Anthropic muncul di luar kantor mereka di San Francisco, sementara serangan kapur menutupi trotoar OpenAI. Bahkan ratusan karyawan OpenAI sebelumnya menandatangani surat terbuka mendukung penolakan Anthropic terhadap tuntutan Pentagon.

Kerangka QuitGPT memang emosional dan menarik, tetapi tidak sepenuhnya tepat. Anthropic sendiri memiliki kemitraan dengan Palantir dan Amazon Web Services yang memberi akses kepada badan intelijen dan departemen pertahanan AS ke model Claude, dan dikabarkan telah digunakan dalam operasi militer untuk menggulingkan pemerintahan Venezuela dan Iran. Etika AI dan kontrak keamanan nasional tidak pernah bersih di kedua sisi. Apa yang diungkap kampanye itu, secara akurat, adalah bahwa sebagian besar pengguna percaya ada perbedaan bermakna dalam cara kedua perusahaan menentukan batas mereka—dan memilih berdasarkan langganan mereka. Apakah perbedaan itu sebermakna yang tampak, tergantung pada membaca kontrak dengan cermat.