Profesor Jiada membongkar AI generatif: Apakah Vibe Coding tidak sehebat itu? Apa cara terbaik untuk menulis kode dengan AI?

Di tengah perkembangan pesat AI generatif saat ini, banyak orang merasa bingung apakah harus terus belajar menulis kode, dan Profesor DaJia dalam acara GQ Magazine menganalisis prinsip dasar LLM di balik ChatGPT, serta menunjukkan keterbatasan Vibe Coding.

Profesor DaJia membongkar AI generatif dan mengajarkan cara memahami Vibe Coding dengan benar

Baru-baru ini, GQ Taiwan membagikan sebuah video di saluran YouTube mereka, mengundang secara khusus Profesor Sarah Chasins dari University of California, Berkeley, untuk menjawab berbagai pertanyaan dari netizen tentang pemrograman dan AI.

Di tengah perkembangan pesat AI generatif, banyak orang merasa bingung apakah harus terus belajar menulis kode, Profesor Chasins dalam video tersebut tidak hanya menjelaskan prinsip teknisnya, tetapi juga memberikan pengamatan praktis terhadap tren “Vibe Coding” yang sedang muncul.

Profesor membongkar prinsip teknologi LLM di balik ChatGPT

Profesor Sarah Chasins pertama-tama menjelaskan dengan cara yang mudah dipahami oleh masyarakat umum, bagaimana mekanisme kerja ChatGPT.

ChatGPT dibangun di atas model bahasa besar (LLM), yang intinya sangat sederhana, yaitu sebuah program yang bertanggung jawab untuk menggabungkan kata-kata yang tampaknya cocok satu sama lain.

Pengembang LLM pertama-tama mengumpulkan semua dokumen dan halaman web yang ditulis manusia di internet, data ini mewakili kombinasi kata yang masuk akal menurut persepsi manusia.

Selanjutnya, program akan menjalani pelatihan “permainan pengisian kosong” secara besar-besaran. Sebagai contoh, sistem akan melihat kalimat seperti “Anjing memiliki empat [kosong]” dan jawaban yang sesuai dengan persepsi manusia adalah “Anjing memiliki empat kaki”, tetapi jika program menebak salah, pengembang akan memperbaikinya sampai jawaban benar.

Setelah menjalani pelatihan selama waktu yang setara dengan 300 hingga 400 tahun pemrosesan komputer, program akhirnya akan menghasilkan sebuah “kertas curang” yang sangat besar, yang biasa disebut sebagai “parameter” di dunia teknologi.

Selanjutnya, cukup menyediakan sebuah dokumen dalam format percakapan, program yang pandai mengisi kekosongan ini dapat diubah menjadi chatbot, secara otomatis melengkapi sisa jawaban dari pertanyaan manusia berdasarkan logika.

Sumber gambar: Gambar yang dihasilkan AI oleh Nanobanana, hanya untuk referensi, mohon maaf jika ada bagian karakter Cina yang buram.

Di era AI, cara terbaik belajar menulis kode

Menghadapi kemampuan luar biasa dari alat AI, banyak orang mempertanyakan kebutuhan belajar menulis kode. Menanggapi hal ini, profesor berpendapat bahwa, keterampilan inti dalam pendidikan pemrograman adalah “memecahkan masalah”, yaitu memecah sebuah masalah besar yang kabur menjadi bagian-bagian kecil, sampai setiap bagian dapat diselesaikan dengan beberapa baris kode.

Tanpa latihan ini, pengguna akan sulit memanfaatkan alat AI untuk menghasilkan kode yang benar-benar berfungsi dan kompleks. Selain itu, data pelatihan LLM sebagian besar berupa deskripsi bahasa yang bergaya insinyur, bukan bahasa sehari-hari yang digunakan oleh non-profesional, sehingga sering tidak cocok dengan data pelatihan dan menyebabkan AI kesulitan menghasilkan kode yang berguna.

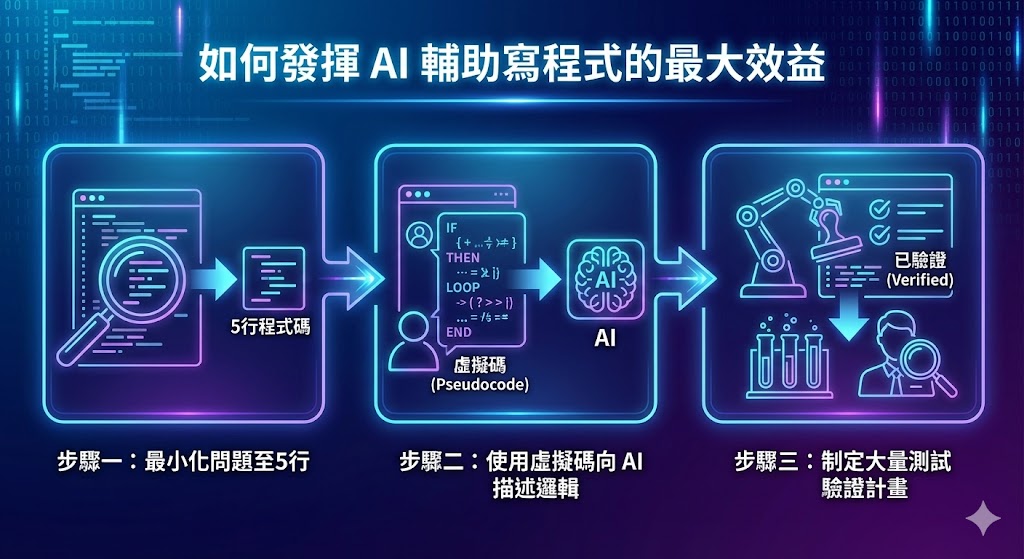

Untuk memaksimalkan manfaat AI dalam membantu menulis kode, Profesor Chasins menyarankan mengikuti tiga langkah berikut:

- Memperkecil masalah: Memecah masalah menjadi sekitar 5 baris kode.

- Menggunakan pseudo code: Ini adalah cara mendeskripsikan logika menggunakan sintaks yang mungkin menggabungkan berbagai bahasa pemrograman dan kata kunci, meskipun mirip bahasa alami, bukan bahasa yang kita gunakan sehari-hari, dengan tujuan agar komputer memahami logika eksekusi secara lebih akurat.

- Membuat rencana verifikasi: Melalui pengujian massal atau review profesional untuk memastikan keakuratan output AI.

Sumber gambar: Gambar yang dihasilkan AI oleh Nanobanana, hanya untuk referensi, mohon maaf jika ada bagian karakter Cina yang buram.

Vibe Coding Tidak Segitu Hebat?

Terkait tren baru menggunakan LLM langsung untuk menghasilkan kode, bukan mengetik kode secara manual, Profesor Sarah Chasins bersikap skeptis.

Dia menganalisis bahwa alat semacam ini cukup baik dalam menangani konten rutin yang sudah ditulis manusia berkali-kali, tetapi jika ingin mencoba hal inovatif, mode ini biasanya tidak berhasil.

Profesor juga mengutip data penelitian terkait yang menunjukkan bahwa, meskipun pengguna LLM merasa efisiensinya meningkat 20%, kenyataannya kecepatan pengembangan justru 20% lebih lambat dibandingkan yang tidak menggunakan alat tersebut.

Ini menunjukkan bahwa ketergantungan berlebihan pada alat bisa menimbulkan ilusi peningkatan efisiensi. Ketika menghadapi kebutuhan program yang belum pernah dilihat sebelumnya, jika tidak memiliki kemampuan dasar memecah logika dan pengetahuan tentang prinsip fisika, AI tidak akan mampu memperbaiki kesalahan yang terjadi, sehingga hasil akhirnya justru lebih memakan waktu.

Sebagai analogi sederhana, LLM seperti mobil otomatis canggih yang bisa membantu mengatasi jalur umum, tetapi jika Anda tidak tahu cara memecah trek, tidak memahami prinsip fisika kendaraan, seperti logika pemrograman, ketika menghadapi tikungan berbahaya yang belum pernah dilihat, seperti kebutuhan program inovatif, otomatisasi ini mudah salah, dan Anda juga akan kesulitan memperbaikinya karena kurangnya dasar.

Baca lebih lanjut:

AI memungkinkan munculnya perusahaan satu orang! “Vibe Coding” mengubah paradigma, tim kecil pun bisa meraih pendapatan miliaran

Artikel Terkait

Dogecoin Turun 9,6% menjadi $0,08885 saat Pola Adam dan Hawa Menguji Garis Leher Utama

Dogecoin Merayakan Sejarah Pertama di Penghormatan Lonceng Nasdaq - U.Today

Dogecoin (DOGE) Berpotensi Melonjak ke $1.60 Tahun Ini: Analis - U.Today

Harga Dogecoin Menyempit Dekat $0.10 saat Open Interest Menurun