OpenAI behauptet Sicherheits-"rote Linien" im Pentagon-Deal—Aber die Nutzer sind skeptisch

Kurzfassung

- OpenAI hat eine Vereinbarung mit dem Pentagon unterzeichnet, um KI in geheimen Umgebungen einzusetzen.

- Das Unternehmen sagte, es habe „rote Linien“ gezogen, doch der Vertrag erlaubt „alle rechtmäßigen Zwecke“, eine Maßgabe, die letztlich von der Interpretation der Regierung abhängt.

- Die Kontroverse löste die QuitGPT-Bewegung aus und führte zu einem Anstieg bei Claude-Downloads.

OpenAI gab an diesem Wochenende bekannt, dass es eine Vereinbarung mit dem Pentagon getroffen hat, um fortschrittliche KI-Systeme in geheimen Umgebungen einzusetzen, was eine bedeutende Erweiterung der Zusammenarbeit mit dem US-Militär darstellt. Die Ankündigung erfolgte weniger als 24 Stunden nachdem die Trump-Administration Anthropic auf die Schwarze Liste gesetzt hatte, da das rivalisierende KI-Unternehmen nach Streitigkeiten über Vertragsformulierungen im Zusammenhang mit Überwachung und autonomen Waffen als „Lieferkettenrisiko für die nationale Sicherheit“ eingestuft wurde. Präsident Donald Trump wies außerdem die Bundesbehörden an, die Nutzung von Anthropic-Technologie sofort einzustellen, wobei Finanzminister Scott Bessent am Montag auf X schrieb, dass die Behörde „alle Nutzung von Anthropic-Produkten, einschließlich der Claude-Plattform, innerhalb unseres Ministeriums beendet.“

"DIE VEREINIGTEN STAATEN VON AMERIKA LASSEN NIE ZU, DASS EINE RADIKALE LINKSEXTREME, WOKE FIRMA VORSCHREIBT, WIE UNSER GROSSARTIGES MILITÄR KÄMPFT UND GEWINNT! Diese Entscheidung liegt bei IHREM KOMMANDANT-IM-CHIEF und den großartigen Führern, die ich ernenne, um unser Militär zu leiten.

Die linksgerichteten Spinner bei Anthropic… pic.twitter.com/aIEx92nnyx

— Das Weiße Haus (@WhiteHouse) 27. Februar 2026

Der Zeitpunkt der KI-Ankündigungen setzte OpenAIs Abkommen unter starken Druck. In einem ausführlichen Blogbeitrag skizzierte das Unternehmen, was es als feste „rote Linien“ und Schutzmaßnahmen für die Partnerschaft mit dem Pentagon beschreibt. Das von OpenAI präsentierte Abkommen wirft breitere Fragen auf, wie KI-Systeme in sicherheitsrelevanten Bereichen geregelt werden und wie die vom Unternehmen genannten Beschränkungen in der Praxis interpretiert und durchgesetzt werden. Wenn „rechtmäßig“ nicht ausreicht Der Blogbeitrag von OpenAI beginnt mit drei Verpflichtungen, die als unverhandelbar dargestellt werden: keine Nutzung der Technologie für Massenüberwachung im Inland, keine eigenständige Steuerung autonomer Waffensysteme oder für hochriskante automatisierte Entscheidungen wie soziale Kreditsysteme. Dann folgt die eigentliche Vertragsformulierung – die OpenAI ausdrücklich „relevanten Wortlaut“ nennt, nicht „das vollständige Abkommen“.

„Das Verteidigungsministerium darf das KI-System für alle rechtmäßigen Zwecke verwenden, die mit geltendem Recht, betrieblichen Anforderungen und bewährten Sicherheits- und Überwachungsprotokollen übereinstimmen“, sagte OpenAI. Genau diese Formulierung sagte Anthropic, dass die Regierung während der Verhandlungen verlangt habe. Die gleiche Formulierung, die Anthropic ablehnte. OpenAI unterschrieb sie, argumentiert aber, dass seine roten Linien weiterhin vollständig intakt seien. Allerdings ist „rechtmäßig“ im sicherheitspolitischen Kontext kein festgelegter Grenzwert – es lebt innerhalb eines Flickenteppichs aus Gesetzen, Exekutivverordnungen, internen Richtlinien und oft geheimen rechtlichen Auslegungen. Wenn ein Vertrag „alle rechtmäßigen Zwecke“ erlaubt, ist die praktische Grenze das aktuelle rechtliche Umfeld der Regierung, nicht ein unabhängiger Standard des Anbieters. Eine Reihe von Klauseln Die Waffenbestimmung lautet, dass das KI-System „nicht zur eigenständigen Steuerung autonomer Waffen verwendet wird, in Fällen, in denen Recht, Vorschriften oder Abteilungsrichtlinien menschliche Kontrolle vorschreiben.“ Das Verbot gilt nur, wenn eine andere Behörde bereits menschliche Kontrolle verlangt – es basiert vollständig auf bestehenden Richtlinien, insbesondere DoD Directive 3000.09. Diese Direktive verlangt, dass autonome Systeme Kommandanten ermöglichen, „angemessene menschliche Urteile“ bei der Anwendung von Gewalt auszuüben. Und „angemessen“ ist so subjektiv wie nur möglich. Menschliches Urteilsvermögen ist nicht menschliche Kontrolle. Dieser Unterschied ist kein Zufall. Verteidigungsexperten haben festgestellt, dass das Weglassen von „Mensch-in-der-Schleife“-Formulierungen absichtlich erfolgte, um operative Flexibilität zu bewahren.

OpenAIs stärkster Gegenargument ist seine Cloud-only-Architektur – vollständig autonome tödliche Entscheidungszyklen würden Edge-Deployment auf Kampffahrzeugen erfordern, was dieser Vertrag nicht erlaubt. Das ist eine echte technische Einschränkung. Aber cloudbasierte KI kann weiterhin Zielerkennung, Verhaltensmusteranalyse und Missionsplanung durchführen. Diese Aktivitäten gehören zur Kill-Chain, unabhängig davon, wo der finale Auslöser sitzt. Das Ergebnis für ein Ziel ändert sich nicht, je nachdem, auf welchem Server das Modell läuft. Das Überwachungsklausel folgt einem ähnlichen Muster. OpenAIs erklärte rote Linie: keine Massenüberwachung im Inland. Der Vertragswortlaut: Das System „darf nicht für uneingeschränkte Überwachung der privaten Informationen von US-Personen verwendet werden, soweit diese Befugnisse dies zulassen“ – und listet den 4. Verfassungszusatz, FISA und Executive Order 12333 auf. Das Wort „uneingeschränkt“ impliziert, dass eine eingeschränkte Version der Massenüberwachung zulässig wäre. Und EO 12333 ist die Exekutivverordnung, mit der die NSA die Abhörung amerikanischer Kommunikation außerhalb der US-Grenzen rechtfertigt. Hier wird auch deutlich, warum Anthropic während der Verhandlungen Bedenken hinsichtlich der Formulierungen äußerte. Anthropic argumentierte, dass das aktuelle Recht mit den Möglichkeiten der KI nicht Schritt halte. Die Regierung kann legal große Mengen an aggregierten kommerziellen Daten über Amerikaner ohne Durchsuchungsbefehl kaufen – was sie bereits tut. Die Vertragsformulierung von OpenAI, die seine Schutzmaßnahmen an bestehende rechtliche Rahmenbedingungen bindet, schließt die Lücke möglicherweise nicht, die Anthropic befürchtete. Altman antwortet Am Samstagabend führte Altman eine AMA durch, in der er auf Tausende von Fragen zum Abkommen einging. Auf die Frage, was OpenAI dazu bringen würde, eine Partnerschaft mit der Regierung zu beenden, antwortete er: „Wenn wir aufgefordert werden, etwas verfassungswidriges oder illegales zu tun, gehen wir weg.“

Wenn wir aufgefordert werden, etwas verfassungswidriges oder illegales zu tun, gehen wir weg. Falls nötig, komm mich im Gefängnis besuchen.

— Sam Altman (@sama) 1. März 2026

Dieses Framing setzt die Grenze von OpenAI bei der Legalität – nicht bei einer unabhängigen ethischen Bewertung dessen, was das Unternehmen tun wird oder nicht, falls es legal ist, was Anthropic fordert. Auf die Frage, ob er sich Sorgen über zukünftige Streitigkeiten macht, was als „rechtmäßig“ gilt, gab er zu: „Wenn wir diesen Kampf führen müssen, werden wir es tun, aber es setzt uns auch gewissen Risiken aus.“ Warum OpenAI ein Abkommen schloss, das Anthropic nicht eingehen konnte, erklärte Altman so: „Anthropic schien mehr auf konkrete Verbote im Vertrag fokussiert zu sein, anstatt auf anwendbare Gesetze, was wir für vertretbar hielten. Ich würde eindeutig lieber auf technische Schutzmaßnahmen setzen, wenn ich nur eine wählen müsste. Ich denke, Anthropic wollte vielleicht mehr operative Kontrolle, als wir wollten.“ Das ist ein wesentlicher philosophischer Unterschied. Anthropic argumentierte, dass weil Grenzmodelle in Weise für Geheimdienst- und Militäranwendungen umfunktioniert werden können, die schwer vorhersehbar sind, die Grenzen explizit und bindend schriftlich festgelegt werden müssen, selbst wenn das den Deal gefährdet. OpenAI ist der Ansicht, dass technische Architektur, eingesetztes Personal und bestehendes Recht zusammen eine stärkere Absicherung bieten als reiner Vertragstext. Die Öffentlichkeit hat sich positioniert

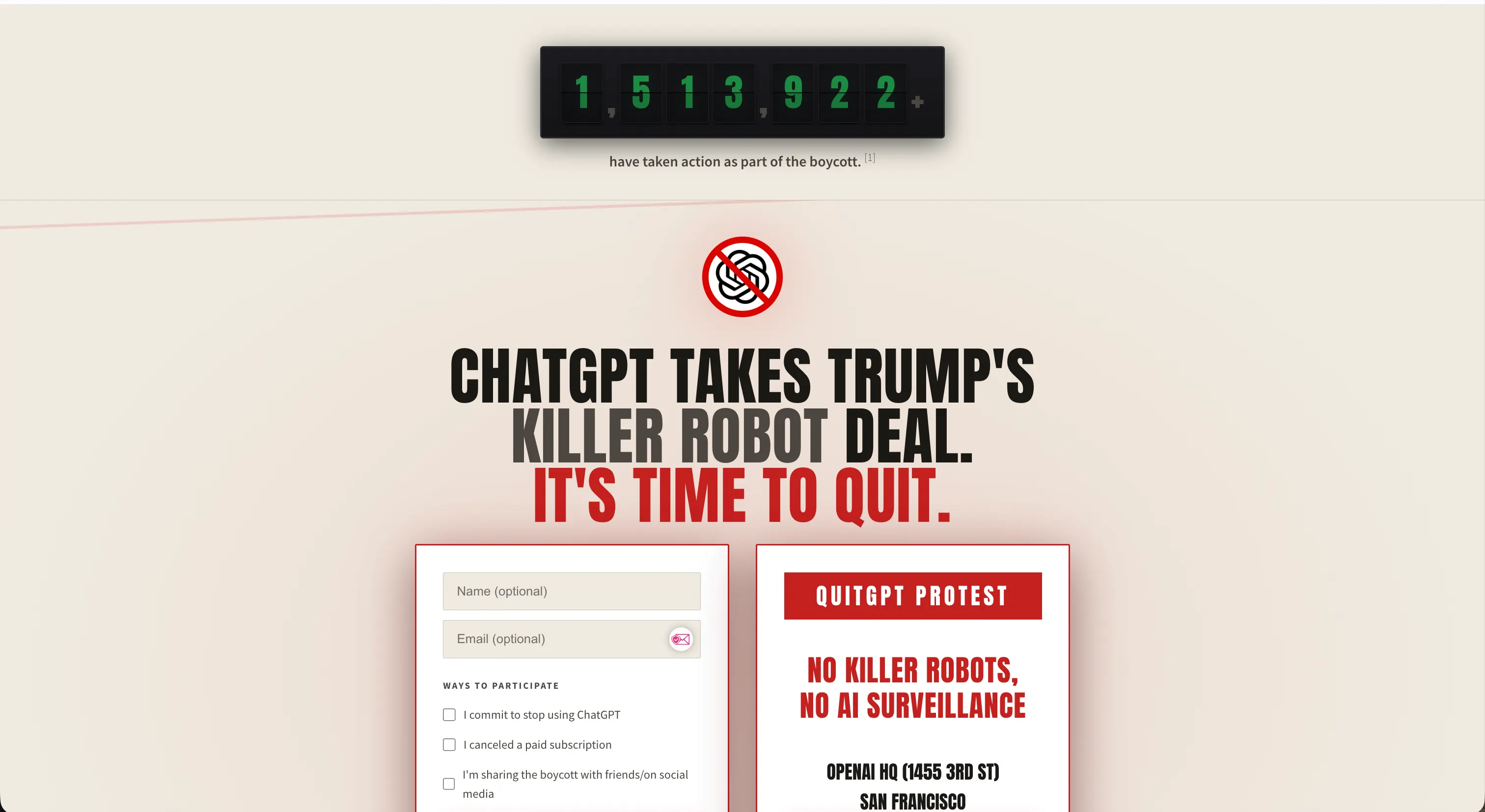

Der Gegenwind war sofort spürbar. Bis Montag behauptete die „QuitGPT“-Bewegung, dass über 1,5 Millionen Menschen Maßnahmen ergriffen hätten – Abonnements gekündigt, Boykott-Posts geteilt oder sich bei quitgpt.org registriert haben.

Die Kampagne stellte die Entscheidung von OpenAI, militärische Verträge zu priorisieren, über die Sicherheit der Nutzer, dar und warf dem Unternehmen vor, zugestimmt zu haben, das Pentagon könne seine Technologie für „alle rechtmäßigen Zwecke, einschließlich Killer-Roboter und Massenüberwachung“ zu verwenden.

OpenAI mag diese Charakterisierung bestreiten. Doch der Markt bewegte sich trotzdem.

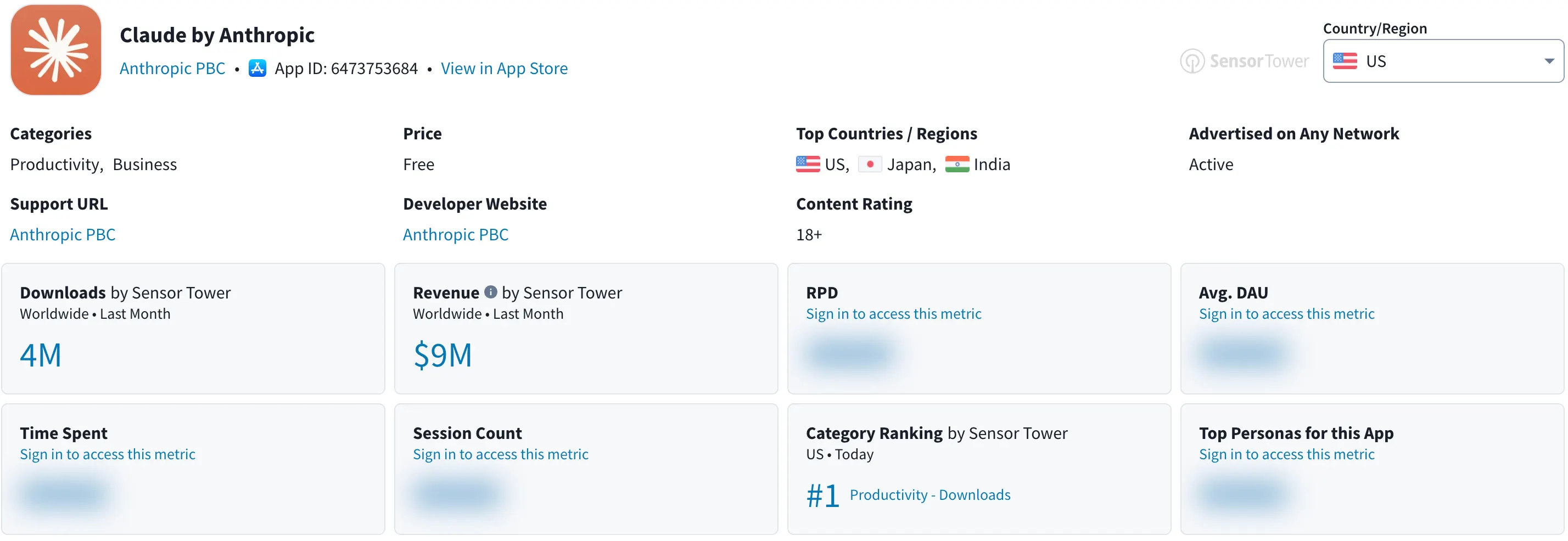

Anthropics Claude überholte ChatGPT und wurde die meist heruntergeladene kostenlose App in den USA im Apple App Store, wobei das Unternehmen Decrypt gegenüber angab, am Wochenende Rekordzahlen bei täglichen Anmeldungen verzeichnet zu haben.

Popstar Katy Perry teilte einen Screenshot der Claude-Preisseite auf X. Hundert Nutzer dokumentierten öffentlich ihre Kündigungen auf Reddit. Graffiti, das Anthropic lobt, tauchte vor den Büros in San Francisco auf, während Kreideattacken die Gehwege von OpenAI bedeckten. Selbst Hunderte von OpenAI-Mitarbeitern hatten zuvor einen offenen Brief unterschrieben, in dem sie Anthropic unterstützten, sich den Pentagon-Anforderungen nicht zu beugen.

Das QuitGPT-Framing ist emotional überzeugend, aber nicht ganz präzise. Anthropic selbst hat eine Partnerschaft mit Palantir und Amazon Web Services, die US-Geheimdiensten und Verteidigungsbehörden Zugang zu Claude-Modellen gewährt und angeblich in Militäraktionen eingesetzt wurde, um die Regierungen Venezuelas und Irans zu stürzen. Die Ethik von KI und sicherheitsbezogenen Verträgen war auf beiden Seiten nie eindeutig sauber. Was die Kampagne richtig erfasste, ist, dass ein großer Teil der Nutzer glaubte, es gebe einen bedeutenden Unterschied darin, wie die beiden Unternehmen ihre Grenzen ziehen – und ihre Entscheidungen durch Abonnements zum Ausdruck brachten. Ob dieser Unterschied tatsächlich so bedeutend ist, wie es scheint, hängt davon ab, den Vertrag sorgfältig zu lesen.