72 Stunden, dreifache Krise: Die Seele von Anthropic wird versteigert

Verfasst von: Ada, Deep Tide TechFlow

- Februar, Dienstag. Washington, Pentagon.

Anthropic-CEO Dario Amodei sitzt seinem Verteidigungsminister Pete Hegseth gegenüber. Laut mehreren Medien, darunter NPR und CNN, ist die Stimmung des Treffens „höflich“, aber der Inhalt alles andere als freundlich.

Hegseth stellte ihm eine letzte Frist: Bis Freitag, 17:01 Uhr, die militärische Nutzung von Claude freizugeben und dem Pentagon zu erlauben, ihn für „alle legalen Zwecke“ zu verwenden, inklusive autonomer Waffenzielerfassung und inländischer Massenüberwachung.

Andernfalls wird der Vertrag über 200 Millionen Dollar gekündigt. Das „Defense Production Act“ wird aktiviert, um Zwangsmaßnahmen durchzusetzen. Anthropic wird als „Lieferkettenrisiko“ eingestuft, was gleichbedeutend ist mit einer schwarzen Liste für feindliche Akteure aus Russland und China.

Am selben Tag veröffentlichte Anthropic die dritte Version ihrer „Verantwortungsvollen Erweiterungsrichtlinie“ (RSP 3.0), in der sie heimlich die wichtigste Zusage seit Gründung streichen: Wenn Sicherheitsmaßnahmen nicht garantiert werden können, wird kein leistungsstärkeres Modell trainiert.

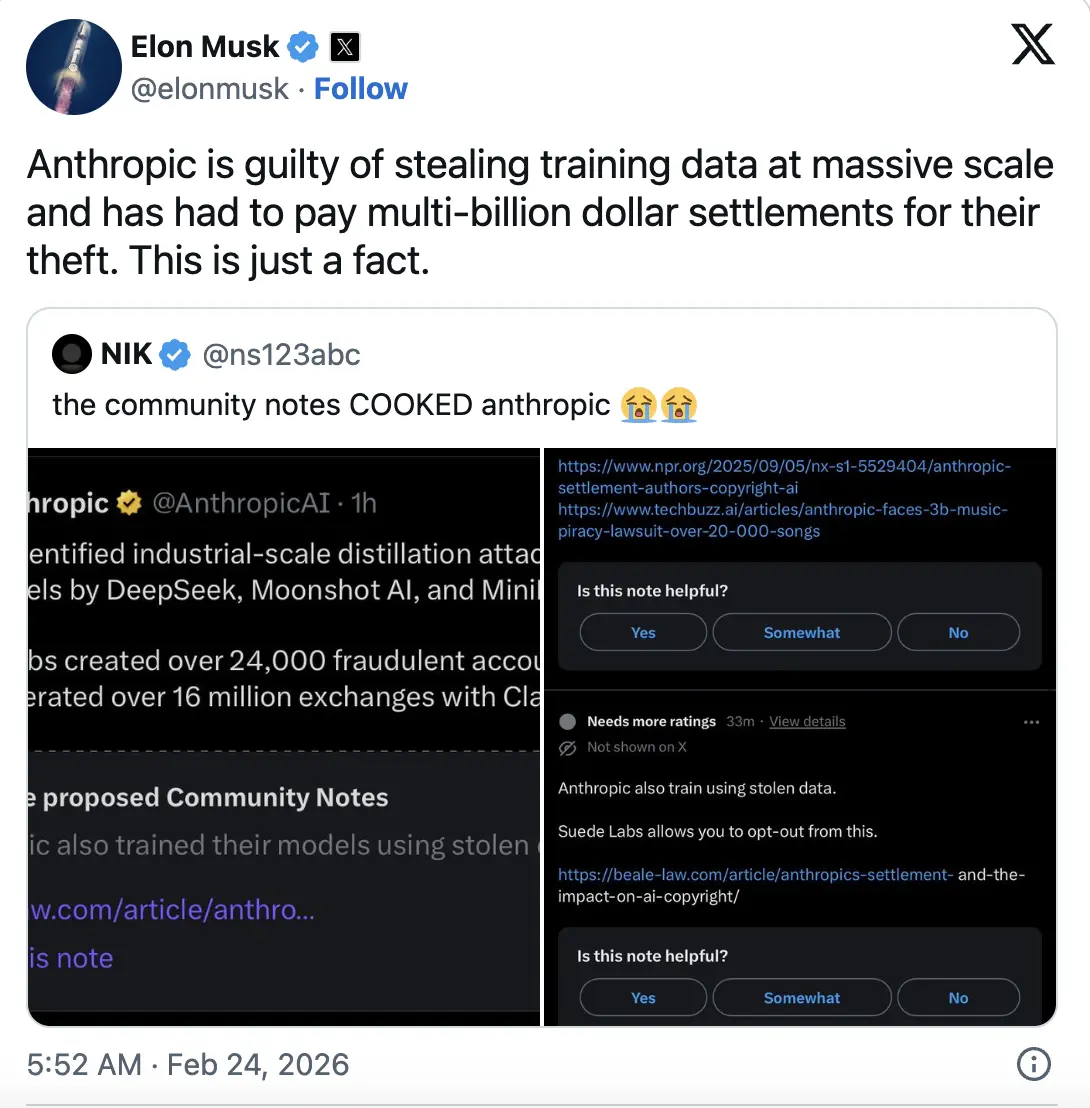

Ebenso am selben Tag postete Elon Musk auf X: „Anthropic stiehlt in großem Stil Trainingsdaten, das ist Fakt.“ Gleichzeitig ergänzte die Community-Note auf X den Bericht, dass Anthropic 1,5 Milliarden Dollar an Vergleichszahlungen geleistet hat, weil es Claude mit Raubkopien von Büchern trainiert hat.

Innerhalb von 72 Stunden spielte dieses angeblich „seelenvolle“ KI-Unternehmen gleichzeitig drei Rollen: Sicherheitsmartyrium, Urheberrechtsdiebstahl und Verräter des Pentagons.

Welches ist das Wahre?

Vielleicht alle.

Pentagon: „Entweder gehorchen oder gehen“

Die erste Ebene der Geschichte ist einfach.

Anthropic ist das erste KI-Unternehmen, das vom US-Verteidigungsministerium Zugang auf Geheimnisebene erhält. Der Vertrag wurde im letzten Sommer abgeschlossen, mit einer Obergrenze von 200 Millionen Dollar. Kurz darauf erhielten auch OpenAI, Google und xAI vergleichbare Verträge.

Laut Al Jazeera wurde Claude im Januar dieses Jahres bei einem US-Militäreinsatz eingesetzt, der die Entführung Venezuelas Präsident Maduro betraf.

Doch Anthropic zog zwei rote Linien: keine Unterstützung für vollautonome Waffenzielerfassung, keine Unterstützung für groß angelegte Überwachung amerikanischer Bürger. Anthropic ist der Ansicht, dass KI nicht zuverlässig genug ist, um Waffen zu steuern, und es gibt derzeit keine Gesetze oder Vorschriften, die den Einsatz von KI bei Massenüberwachung regeln.

Das Pentagon ist nicht überzeugt.

Der KI-Berater des Weißen Hauses, David Sacks, beschuldigte Anthropic im Oktober letzten Jahres öffentlich auf X, „Angst als Waffe zu nutzen, um Regulierung zu erzwingen“.

Die Konkurrenz ist bereits eingeknickt. OpenAI, Google und xAI haben zugestimmt, ihre KI für „alle legalen Szenarien“ für das Militär nutzbar zu machen. Musks Grok wurde diese Woche für den Zugang zu geheimen Systemen genehmigt.

Anthropic ist der letzte, der noch steht.

Bis zum Redaktionsschluss erklärte Anthropic in einer aktuellen Stellungnahme, dass sie keinen Rückzieher machen wollen. Doch die Frist am Freitag um 17:01 Uhr rückt näher.

Ein anonymer ehemaliger Kontaktmann des Justiz- und Verteidigungsministeriums sagte gegenüber CNN: „Wie kann man gleichzeitig eine Firma als ‘Lieferkettenrisiko’ einstufen und sie zwingen, für das Militär zu arbeiten?“

Gute Frage, aber das interessiert das Pentagon nicht. Ihnen ist nur wichtig, dass sie, falls Anthropic nicht nachgeben, Zwangsmaßnahmen ergreifen oder sie in Washington fallengelassen wird.

„Destillationsangriff“: eine schallende Anklage

Am 23. Februar veröffentlichte Anthropic einen scharf formulierten Blogbeitrag, in dem sie drei chinesische KI-Unternehmen der „Industrie-Grad-Destillation“ von Claude beschuldigten.

Die Angeklagten sind DeepSeek, Moonshot AI und MiniMax.

Anthropic wirft ihnen vor, mit 24.000 gefälschten Konten über 16 Millionen Interaktionen mit Claude durchgeführt zu haben, um gezielt die Kernfähigkeiten in reasoning, Tool-Calls und Programmierung zu extrahieren.

Anthropic bezeichnet dies als eine Bedrohung für die nationale Sicherheit, da das destillierte Modell „wahrscheinlich keine Sicherheitsbarrieren mehr“ aufweist und von autoritären Regierungen für Cyberangriffe, Desinformation und Massenüberwachung genutzt werden könnte.

Die Erzählung ist perfekt, der Zeitpunkt auch.

Genau nach der Lockerung der US-Chip-Exportkontrollen durch die Trump-Regierung, genau als Anthropic nach Argumenten für ihre eigene Lobbyarbeit gegen Chip-Exportbeschränkungen suchte.

Doch Musk schoss zurück: „Anthropic stiehlt in großem Stil Trainingsdaten und hat dafür Milliarden an Vergleichszahlungen geleistet. Das ist Fakt.“

Der Mitbegründer der KI-Infrastruktur-Firma IO.Net, Tory Green, sagt: „Ihr trainiert eure Modelle mit Daten aus dem ganzen Netz, und andere lernen von euch über eure öffentliche API – das nennt man ‘Destillationsangriff’?“

Anthropic nennt es „Angriff“, doch in der KI-Branche ist das üblich. OpenAI komprimiert GPT-4, Google optimiert Gemini, und auch Anthropic macht das. Der einzige Unterschied ist, dass diesmal sie selbst destilliert werden.

Laut Erik Cambria, KI-Professor an der Nanyang Technological University in Singapur, gegenüber CNBC: „Die Grenze zwischen legaler Nutzung und böswilliger Ausnutzung ist oft verschwommen.“

Noch ironischer: Anthropic hat gerade 1,5 Milliarden Dollar Vergleichszahlungen geleistet, weil sie Claude mit Raubkopien von Büchern trainiert haben. Jetzt werfen sie anderen vor, ihre öffentlich zugängliche API zu nutzen, um von ihnen zu lernen. Das ist kein Doppelstandard, sondern ein Dreifachstandard.

Anthropic wollte sich als Opfer darstellen, wurde aber zum Angeklagten.

Auflösung des Sicherheitsversprechens: RSP 3.0

Am selben Tag, an dem sie mit dem Pentagon konfrontiert wurden und sich mit Silicon Valley streiten, veröffentlichte Anthropic die dritte Version ihrer „Verantwortungsvollen Erweiterungsrichtlinie“.

Der Chief Scientist Jared Kaplan sagte in einem Interview: „Wir glauben nicht, dass es irgendjemandem hilft, das Training von KI-Modellen zu stoppen. Angesichts der schnellen Entwicklung von KI ist ein einseitiges Versprechen… sinnlos, während die Konkurrenz Vollgas gibt.“

Kurz gesagt: Wenn andere nicht fair spielen, machen wir auch nicht mit.

RSP 1.0 und 2.0 basierten auf einer harten Zusage: Wenn die Fähigkeiten eines Modells die Sicherheitsmaßnahmen übersteigen, wird das Training pausiert. Diese Zusage hat Anthropic in der KI-Sicherheitsbranche einzigartig gemacht.

Doch 3.0 streicht das.

Stattdessen gibt es einen „flexibleren“ Rahmen, bei dem die Sicherheitsmaßnahmen von Anthropic und die Sicherheitsvorschläge, die branchenweit notwendig sind, in zwei separate Bahnen gelenkt werden. Alle 3-6 Monate erscheint ein Risikobericht, der von externen Experten geprüft wird.

Klingt verantwortungsvoll?

Chris Painter, unabhängiger Gutachter vom Non-Profit-Organisation METR, sagte nach Durchsicht des frühen Entwurfs: „Das zeigt, dass Anthropic meint, in eine ‘Triage-Phase’ eintreten zu müssen, weil die Methoden zur Risikoabschätzung und -minderung mit dem Wachstum ihrer Fähigkeiten nicht Schritt halten. Das ist eher ein Beweis dafür, dass die Gesellschaft auf potenzielle katastrophale Risiken von KI noch nicht vorbereitet ist.“

Laut TIME hat Anthropic fast ein Jahr lang intern über diese Neufassung diskutiert, CEO Amodei und der Vorstand haben einstimmig zugestimmt. Offiziell heißt es, die ursprüngliche Richtlinie sei dazu gedacht gewesen, Branchenkonsens zu fördern, doch die Branche habe nicht mitgezogen. Die Trump-Regierung habe die KI-Entwicklung sogar eher geduldet und versucht, bundesstaatliche Gesetze abzuschaffen. Ein bundesweites KI-Gesetz sei in weiter Ferne. Obwohl eine globale Governance im Jahr 2023 noch möglich schien, sind drei Jahre vergangen – diese Tür ist offensichtlich geschlossen.

Ein langjähriger Beobachter der KI-Regulierung sagte direkt: „RSP ist das wertvollste Marken-Asset von Anthropic. Das Streichen der Pause-Zusage ist wie bei einem Bio-Lebensmittelhersteller, der heimlich das Wort ‘Bio’ vom Verpackungsdesign entfernt und dann behauptet, ihre Kontrollen seien jetzt transparenter.“

380 Milliarden Bewertung und die Identitätskrise

Anfang Februar schloss Anthropic eine Finanzierungsrunde im Wert von 300 Milliarden Dollar bei einer Bewertung von 380 Milliarden Dollar ab, mit Amazon als Ankerinvestor. Seit Gründung erzielt das Unternehmen eine jährliche Umsatzrendite von 14 Milliarden Dollar. In den letzten drei Jahren ist diese Zahl jährlich um mehr als das Zehnfache gewachsen.

Gleichzeitig droht das Pentagon, das Unternehmen auf die schwarze Liste zu setzen. Musk beschuldigt öffentlich Datenklau. Das eigene Sicherheitsversprechen wurde gestrichen. Nach dem Rücktritt des Sicherheitschefs Mrinank Sharma schrieb dieser auf X: „Die Welt ist in Gefahr.“

Widersprüche?

Vielleicht ist Widersprüchlichkeit das Markenzeichen von Anthropic.

Das Unternehmen wurde von ehemaligen OpenAI-Topmanagern gegründet, die befürchteten, OpenAI gehe bei der Sicherheit zu schnell. Dann gründeten sie eine eigene Firma, um noch schnellere und stärkere Modelle zu bauen, während sie gleichzeitig der Welt erzählen, wie gefährlich diese Modelle sind.

Das Geschäftsmodell lässt sich in einem Satz zusammenfassen: Wir fürchten KI mehr als jeder andere, also sollt ihr uns das Geld geben, um KI zu entwickeln.

Dieses Narrativ funktionierte perfekt in den Jahren 2023–2024. KI-Sicherheit war Washingtons Top-Thema, Anthropic war der beliebteste Lobbyist.

Doch 2026 änderte sich die Richtung.

„Woke AI“ wurde zum Schimpfwort, bundesstaatliche KI-Regulierungen wurden vom Weißen Haus blockiert, der kalifornische SB 53, an dem Anthropic beteiligt war, wurde zwar verabschiedet, aber auf Bundesebene herrscht Stillstand.

Anthropics Sicherheits-Image schwindet vom „Differenzierungs-Vorteil“ zum „politischen Ballast“.

Anthropic versucht, eine komplexe Balance zu halten: Es braucht genug „Sicherheit“, um die Marke zu schützen, aber auch genug „Flexibilität“, um nicht vom Markt und von der Politik fallengelassen zu werden. Das Problem ist, dass beide Seiten immer weniger Toleranz zeigen.

Wie viel ist das Sicherheitsnarrativ noch wert?

Wenn man die drei Aspekte zusammen betrachtet, wird das Bild klar:

Die Anklage gegen chinesische Firmen wegen Destillation von Claude dient dazu, das Narrativ der Chip-Exportkontrollen zu stärken. Um im Rüstungswettlauf nicht zurückzubleiben, wurde das Sicherheits-Pausenversprechen gestrichen. Das Ablehnen der Forderung nach autonomen Waffen ist ein Versuch, die letzte moralische Schutzschicht zu bewahren.

Jeder Schritt ist logisch, doch die Schritte widersprechen sich.

Man kann nicht gleichzeitig behaupten, chinesische Firmen „destillieren“ dein Modell, was die nationale Sicherheit gefährdet, und gleichzeitig das Sicherheitsversprechen streichen, das dich vor unkontrollierten Modellen schützt. Wenn das Modell wirklich so gefährlich ist, sollte man vorsichtiger sein, nicht radikaler.

Außer bei Anthropic.

In der KI-Branche wird die Identität nicht durch Erklärungen definiert, sondern durch die Bilanzen. Anthropics Sicherheitsnarrativ ist im Kern eine Marken-Preissetzung.

In der Frühphase des KI-Wettlaufs war diese Prämie viel wert. Investoren zahlten höhere Bewertungen für „verantwortungsvolle KI“, Regierungen gaben grünes Licht für „vertrauenswürdige KI“, Kunden zahlten für „sicherere KI“.

Doch 2026 schwindet diese Prämie.

Anthropic steht heute vor der Wahl: „Wozu zuerst kompromittieren?“ – entweder gegenüber dem Pentagon, was den Ruf schädigt, oder gegenüber den Wettbewerbern, was Sicherheitsversprechen obsolet macht. Oder gegenüber Investoren, was beide Seiten kostet.

Am Freitag um 17:01 Uhr wird Anthropic ihre Entscheidung präsentieren.

Doch eines ist sicher: Das Unternehmen, das einst mit „Wir sind anders als OpenAI“ Fuß fasste, wird allmählich wie alle anderen.

Der Endpunkt der Identitätskrise ist oft der Verlust der Identität.