Anthropic wirft 3 chinesischen KI-Trainings vor! Nutzer kritisieren Doppelstandards: Ihr klaut auch urheberrechtlich geschützte Inhalte

Anthropic beschuldigt drei chinesische KI-Unternehmen DeepSeek, Moonshot AI und Min, ihre Modellfähigkeiten durch Destillationsmethoden kopiert zu haben. Diese Vorgehensweise wurde von Internetnutzern satirisch als ebenfalls rechtswidriges Urheberrechtsverletzen kritisiert und hat gleichzeitig eine hitzige Debatte in den USA über Chip-Exportkontrollen und nationale Sicherheit ausgelöst.

Anthropic beschuldigt 3 chinesische KI-Destillations-Trainings, fortschrittliche Modellfähigkeiten zu stehlen

Der Entwickler des KI-Chatbots Claude, Anthropic, hat öffentlich behauptet, dass die drei chinesischen KI-Labore DeepSeek, Moonshot AI und MiniMax über 24.000 Fake-Accounts eingerichtet haben, um auf den Claude-Modell zuzugreifen und mehr als 16 Millionen Mal Daten zu sammeln und auszutauschen. Dabei nutzten sie Destillationsverfahren, um die Kernfähigkeiten von Claude auf ihre eigenen Modelle zu übertragen.

„Destillation“ ist eine gängige KI-Trainingstechnik, bei der ältere oder größere, ausgereifte Modelle genutzt werden, um die Qualität der Antworten neuer Modelle zu bewerten. Dadurch können kleinere, kostengünstigere Modelle lernen und die Rechenleistung großer Modelle übernehmen.

Ursprünglich war die Destillation eine legale Trainingsmethode in der KI-Branche, um leichte Modelle für Kunden zu entwickeln. Allerdings können Wettbewerber diese Technik auch nutzen, um die Forschungsergebnisse anderer Labore direkt zu kopieren.

Anthropic weist darauf hin, dass diese drei chinesischen KI-Labore Proxy-Server verwendet haben, um Erkennung zu umgehen, und groß angelegte Datenextraktionen bei den differenzierten Proxy-Inference-, Tool-Use- und Code-Schreibfähigkeiten von Claude durchgeführt haben.

Bildquelle: X Anthropic beschuldigt 3 chinesische KI-Labore, fortschrittliche Modellfähigkeiten durch Destillation zu stehlen

Internetnutzer kritisieren Doppelstandards, Anthropic steht vor Urheberrechtsklagen

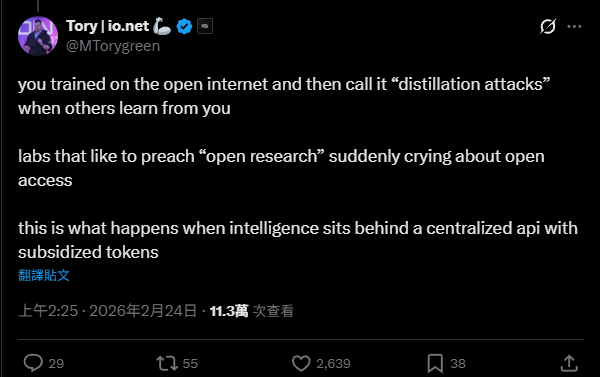

Nach der Veröffentlichung einer Erklärung von Anthropic löste dies jedoch massiven Spott und Zweifel in der Online-Community aus. Einige Nutzer meinen, Anthropic zeige bei der Bewertung der Modell-Trainingsmethoden eine doppelte Moral.

Tory Green, Mitbegründer des KI-Infrastrukturunternehmens IO.Net, kritisierte in einem Beitrag, dass KI-Firmen öffentlich Daten aus dem Internet für das Training nutzen, aber beim Lernen von anderen dies als „Destillationsangriff“ bezeichnen. Während Anthropic sonst lautstark für offene Forschung wirbt, klage man nun wegen offener Zugänglichkeit.

2025 verklagt die bekannte US-Forum Reddit Anthropic offiziell, weil das Unternehmen ohne Erlaubnis mehr als 100.000 Forum-Posts und Kommentare gesammelt haben soll, um den Claude-Modell zu feintunen. Reddit wirft Anthropic vor, gegen die Nutzungsbedingungen verstoßen zu haben, und behauptet, dass das Unternehmen auch nach angeblichem Ende des Sammelns weiterhin über 100.000 Mal auf Reddit-Server zugegriffen habe.

Außerdem wurde Anthropic wegen der Verwendung von 7 Millionen Büchern zum Training seines Modells Claude verklagt. Im vergangenen September einigte sich das Unternehmen auf eine Entschädigung von bis zu 1,5 Milliarden US-Dollar, was den größten Urheberrechtsvergleich in den USA darstellt. Die Zahlung steht jedoch noch unter gerichtlicher Genehmigung.

- **Weitere Berichte: Der größte Entschädigungsfall in der KI-Geschichte! Claude mit Raubkopien trainiert, Vergleichssumme 48 Milliarden, taiwanesische Autoren erhalten ebenfalls Entschädigung

OpenAI warnt vor ähnlichen Problemen bei DeepSeek

Neben Anthropic sieht sich auch der KI-Gigant OpenAI ähnlichen Vorwürfen gegenüber.

Laut einem internen Memo, das letzte Woche von Reuters veröffentlicht wurde, hat OpenAI US-Gesetzgeber gewarnt, dass DeepSeek es auf den Entwickler von ChatGPT und führende US-KI-Unternehmen abgesehen hat, um Modelle zu kopieren und für eigene Algorithmen-Trainings zu verwenden.

OpenAI beobachtet, dass Accounts im Zusammenhang mit DeepSeek- Mitarbeitern verschiedene Methoden entwickeln, um OpenAIs Zugriffsbeschränkungen zu umgehen. Durch verschleierte Drittanbieter-Router und andere versteckte Quellen greifen sie programmatisch auf US-amerikanische KI-Modelle zu und extrahieren Ausgaben für Destillationszwecke.

Chinesische KI-Destillations-Technologie im Konflikt, während US-Chip-Exportkontrollen gelockert werden

Während die US-amerikanischen KI-Giganten China der Destillations-Trainingsmethoden beschuldigen, befindet sich die USA in einer sensiblen Phase der Debatte über die Lockerung der Chip-Exportkontrollen nach China. Die Trump-Regierung hat im Januar offiziell die Ausfuhr von fortschrittlichen KI-Chips wie dem H200 durch US-Unternehmen wie Nvidia genehmigt.

Kritiker argumentieren, dass eine Lockerung der Exportkontrollen in einer entscheidenden Phase des globalen KI-Wettbewerbs die KI-Rechenkapazitäten Chinas erheblich steigern wird.

Dmitri Alperovitch, Vorsitzender des Silverado Policy Accelerators, sagte, dass Chinas rascher Fortschritt bei KI-Modellen teilweise auf das Stehlen amerikanischer Spitzentechnologien durch Destillation zurückzuführen sei. Diese Beweise untermauern die Notwendigkeit, den Verkauf von KI-Chips an diese Unternehmen zu verbieten, um ihre Vorteile nicht noch zu vergrößern.

Anthropic warnt, dass US-Unternehmen entwickelte KI-Systeme Sicherheitsmechanismen besitzen, um zu verhindern, dass nationale oder nicht-staatliche Akteure mit KI biologische Waffen entwickeln oder bösartige Cyberangriffe durchführen. Modelle, die durch Destillation entstanden sind, verfügen jedoch oft nicht über diese Schutzmaßnahmen.

Anthropic befürchtet, dass, wenn ausländische KI-Labore diese uneingeschränkten Fähigkeiten in militärische und nachrichtendienstliche Systeme integrieren, autoritäre Regierungen KI für offensive Cyberangriffe, Desinformation und Massenüberwachung nutzen könnten, was die Sicherheitsrisiken erheblich erhöht.

Weiterführende Literatur:

Chinesische Hacker starten groß angelegte KI-Online-Angriffe! Anthropic: KI-Hacker sind schneller und größer als menschliche Hacker