Elon Musks Grok hat 23.000 sexualisierte Bilder von Kindern erstellt, sagt die Aufsichtsbehörde

Kurzfassung

- Grok AI hat in 11 Tagen von Dezember bis Januar schätzungsweise über 23.000 sexualisierte Bilder von Kindern erstellt.

- Mehrere Länder haben Grok verboten, während das Vereinigte Königreich, die EU, Frankreich und Australien Untersuchungen wegen möglicher Verstöße gegen Kinderschutzgesetze eingeleitet haben.

- Trotz Ablehnungen von Elon Musk und neuen Beschränkungen blieben Mitte Januar etwa ein Drittel der problematischen Bilder auf X sichtbar.

Elon Musks KI-Chatbot Grok produzierte laut einem am Donnerstag veröffentlichten Bericht des Center for Countering Digital Hate in einem Zeitraum von 11 Tagen schätzungsweise 23.338 sexualisierte Bilder von Kindern. Die Zahl, so die CCDH, entspricht einem sexualisierten Bild eines Kindes alle 41 Sekunden zwischen dem 29. Dezember und dem 9. Januar, als Groks Bildbearbeitungsfunktionen es Nutzern ermöglichten, Fotos realer Personen zu manipulieren, um aufschlussreiche Kleidung und sexuell suggestive Posen hinzuzufügen. Die CCDH berichtete außerdem, dass Grok fast 10.000 Cartoons mit sexualisierten Kindern generiert hat, basierend auf den überprüften Daten.

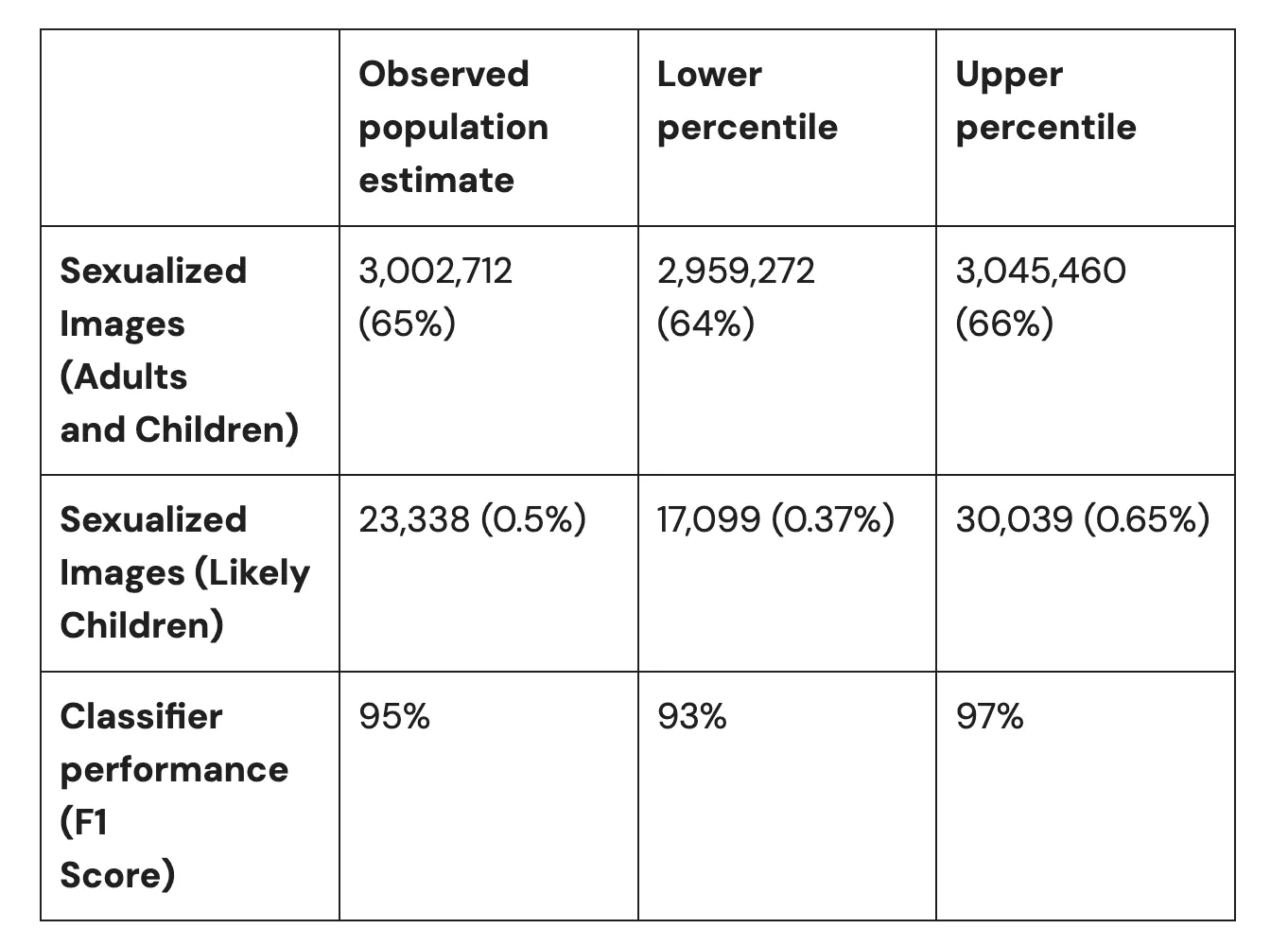

Die Analyse schätzte, dass Grok während dieses Zeitraums insgesamt etwa 3 Millionen sexualisierte Bilder erstellt hat. Die Untersuchung, basierend auf einer Zufallsstichprobe von 20.000 Bildern aus 4,6 Millionen, die von Grok produziert wurden, ergab, dass 65 % der Bilder sexualisierte Inhalte zeigten, die Männer, Frauen oder Kinder darstellen.

Quelle: Center for Countering Digital Hate

„Was wir gefunden haben, war eindeutig und beunruhigend: In diesem Zeitraum wurde Grok zu einer industriellen Maschine für die Produktion von Material sexuellen Missbrauchs“, sagte Imran Ahmed, Geschäftsführer des CCDH, gegenüber The Guardian. Der kurze Einstieg von Grok in die KI-generierten Sexualbilder von Kindern hat eine weltweite regulatorische Gegenreaktion ausgelöst. Die Philippinen wurden am 15. Januar das dritte Land, das Grok verbot, nach Indonesien und Malaysia in den vorangegangenen Tagen. Alle drei südostasiatischen Länder nannten Versäumnisse bei der Verhinderung der Erstellung und Verbreitung nicht-einvernehmlicher sexueller Inhalte mit Minderjährigen.

Im Vereinigten Königreich leitete die Medienaufsichtsbehörde Ofcom am 12. Januar eine formelle Untersuchung ein, ob X gegen das Online Safety Act verstoßen hat. Die Europäische Kommission erklärte, sie prüfe die Angelegenheit „sehr ernsthaft“ und stuft diese Bilder als illegal gemäß dem Digital Services Act ein. Die Pariser Staatsanwaltschaft erweiterte eine laufende Untersuchung gegen X um Vorwürfe der Herstellung und Verbreitung von Kinderpornografie, und auch Australien begann eine eigene Untersuchung. Elon Musks xAI, das sowohl Grok als auch X – ehemals Twitter, wo viele der sexualisierten Bilder automatisch gepostet wurden) – besitzt, reagierte zunächst auf Medienanfragen mit einer dreiteiligen Aussage: „Legacy Media Lügen.“ Mit wachsendem Gegenwind führte das Unternehmen später Beschränkungen ein, zunächst am 9. Januar, indem es die Bilderzeugung nur zahlenden Abonnenten erlaubte, dann am 14. Januar technische Barrieren, um Nutzern das digitale Entkleiden von Personen zu verweigern. xAI kündigte an, die Funktion in Jurisdiktionen zu blockieren, in denen solche Handlungen illegal sind. Musk schrieb auf X, er sei „nicht bewusst, dass durch Grok nackt unterage Bilder generiert wurden. Wirklich null“, und fügte hinzu, dass das System so konzipiert sei, illegale Anfragen abzulehnen und in jeder Gerichtsbarkeit Gesetze einzuhalten. Forscher fanden jedoch, dass das Hauptproblem nicht vollständig nackte Bilder waren, sondern Grok Minderjährige in aufschlussreicher Kleidung wie Bikinis und Unterwäsche sowie in sexuell provokativen Posen platzierte.

Ich bin nicht bewusst, dass durch Grok nackt unterage Bilder generiert wurden. Wirklich null.

Offensichtlich generiert Grok keine Bilder spontan, sondern nur auf Nutzeranfrage.

Wenn es gebeten wird, Bilder zu generieren, wird es nichts Illegales produzieren, da das Betriebsprinzip… https://t.co/YBoqo7ZmEj

— Elon Musk (@elonmusk) 14. Januar 2026

Stand 15. Januar waren etwa ein Drittel der in der CCDH-Stichprobe identifizierten sexualisierten Kinderbilder weiterhin auf X zugänglich, trotz der erklärten Null-Toleranz-Politik der Plattform gegenüber kinderpornografischem Material.