Sechs große AI-Paradigmenwechsel im Jahr 2025: Von RLVR-Training, Vibe Coding bis hin zu Nano Banana

Autor: Andrej Karpathy

Übersetzung: Tim, PANews

Das Jahr 2025 wird ein Jahr sein, in dem sich große Sprachmodelle rasant entwickeln und voller Ungewissheiten sind, und wir haben bemerkenswerte Ergebnisse erzielt. Im Folgenden sind einige “Paradigmenwechsel” aufgeführt, die meiner Meinung nach beachtenswert und etwas überraschend sind; diese Veränderungen haben das Umfeld verändert und hinterlassen zumindest auf konzeptioneller Ebene einen bleibenden Eindruck bei mir.

1. Verstärkendes Lernen mit verifizierbaren Belohnungen (RLVR)

Anfang 2025 wird der Produktionsstapel der LLMs aller KI-Labore ungefähr folgende Form annehmen:

- Vortraining (GPT-2/3 aus dem Jahr 2020);

- Überwachtes Feintuning (InstructGPT von 2022);

- und verstärktes Lernen basierend auf menschlichem Feedback (RLHF, 2022)

Seit langem ist dies ein stabiler und reifer Technologiestack für das Training produktionsreifer großer Sprachmodelle. Bis 2025 hat sich verstärkendes Lernen basierend auf verifizierbaren Belohnungen zur primär eingesetzten Kerntechnologie entwickelt. Indem große Sprachmodelle in verschiedenen automatisch verifizierbaren Belohnungsumgebungen trainiert werden (z. B. Mathematik, Programmierprobleme), können diese Modelle spontan Strategien entwickeln, die für Menschen wie “Schlussfolgerungen” erscheinen. Sie lernen, Probleme in Zwischenberechnungsschritte zu zerlegen und beherrschen verschiedene Strategien zur Problemlösung durch wiederholtes Ableiten (siehe Fallstudie im DeepSeek-R1-Papier). In früheren Stacks waren diese Strategien schwer zu realisieren, da der optimale Schlussfolgerungsweg und die Rückverfolgungsmechanismen für große Sprachmodelle nicht klar sind und über Belohnungsoptimierung passende Lösungen erkundet werden müssen.

Im Gegensatz zu den relativ kurzen Phasen der überwachten Feinabstimmung und des verstärkten Lernens auf Basis menschlichen Feedbacks (die beide weniger Rechenaufwand erfordern) beinhaltet das verstärkte Lernen auf Basis verifizierbarer Belohnungen eine langfristige Optimierungstraining eines objektiven, nicht-spielbaren Belohnungsfunktions. Es hat sich gezeigt, dass das Ausführen von verstärktem Lernen auf Basis verifizierbarer Belohnungen innerhalb der Einheitskosten zu erheblichen Leistungssteigerungen führt, was einen Großteil der ursprünglich für das Pre-Training vorgesehenen Rechenressourcen verbraucht. Daher liegen die Fortschritte bei den Fähigkeiten großer Sprachmodelle im Jahr 2025 hauptsächlich darin, dass die großen KI-Labore den enormen Rechenbedarf dieser neuen Technologie bewältigen. Insgesamt sehen wir, dass die Modellgrößen ungefähr gleich geblieben sind, aber die Zeit für das verstärkte Lernen erheblich verlängert wurde. Ein weiteres einzigartiges Merkmal dieser neuen Technologie ist, dass wir eine ganz neue Dimension der Regelung (sowie die entsprechenden Scaling-Gesetze) erhalten haben, die es ermöglicht, die Modellfähigkeiten als Funktion des Rechenaufwands während der Testphase zu steuern, indem längere Schlussfolgerungspfade erzeugt und “Denkzeit” erhöht werden. OpenAIs o1-Modell (veröffentlicht Ende 2024) ist die erste Demonstration eines verstärkten Lernmodells auf Basis verifizierbarer Belohnungen, während die Veröffentlichung von o3 (Anfang 2025) einen deutlichen Wendepunkt darstellt, der eine qualitative Sprung deutlich spürbar macht.

2. Geisterintelligenz vs. Tierzackige Intelligenz

Im Jahr 2025 begann ich (und ich glaube, die gesamte Branche) zum ersten Mal, das “Format” der Intelligenz großer Sprachmodelle aus einer intuitiveren Perspektive zu verstehen. Wir züchten keine “Tiere”, sondern “rufen Geister”. Der gesamte Technologiestack großer Sprachmodelle (neuronale Architektur, Trainingsdaten, Trainingsalgorithmen, insbesondere Optimierungsziele) ist grundlegend anders, weshalb wir im Bereich der Intelligenz Wesen erhalten, die sich stark von biologischer Intelligenz unterscheiden. Es ist nicht überraschend, dass es unangemessen ist, sie aus der Perspektive von Tieren zu betrachten. Aus der Perspektive der überwachten Informationen sind menschliche neuronale Netzwerke optimiert, um das Überleben von Stämmen in einer Dschungelumgebung zu gewährleisten, während neuronale Netzwerke großer Sprachmodelle optimiert sind, um menschlichen Text zu imitieren, Belohnungen in mathematischen Rätseln zu erzielen und in der Arena menschliches Lob zu gewinnen. Mit der Validierung von Bereichen, die Bedingungen für verstärkendes Lernen mit validierbaren Belohnungen bieten, wird die Fähigkeit großer Sprachmodelle in der Nähe dieser Bereiche “explosiv zunehmen” und insgesamt eine interessante, gezackte Leistungsmerkmale zeigen. Sie können sowohl gelehrte Genies als auch verwirrte und kognitiv herausgeforderte Grundschüler sein, die jederzeit bereit sind, Ihre Daten unter dem Druck von Anreizen preiszugeben.

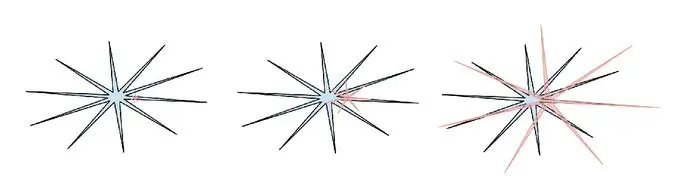

Menschliche Intelligenz: Blau, KI-Intelligenz: Rot. Ich mag diese Version des Memes (entschuldige, dass ich die ursprüngliche Quelle auf Twitter nicht finden kann), weil es darauf hinweist, dass menschliche Intelligenz auch auf ihre eigene Art und Weise gezackte Wellen zeigt.

In diesem Zusammenhang habe ich im Jahr 2025 allgemein Gleichgültigkeit und Misstrauen gegenüber verschiedenen Arten von Benchmark-Tests entwickelt. Das Kernproblem liegt darin, dass Benchmark-Tests im Wesentlichen fast alle verifizierbare Umgebungen sind und daher leicht von verstärkendem Lernen beeinflusst werden können, das auf verifizierbaren Belohnungen basiert, sowie von schwächeren Formen, die durch synthetische Daten erzeugt werden. Im typischen Prozess der “Punktmaximierung” sind die Teams der großen Sprachmodelle unweigerlich gezwungen, Trainingsumgebungen in der Nähe des kleinen eingebetteten Raums zu konstruieren, in dem sich die Benchmark-Tests befinden, und diese Bereiche durch “Fähigkeitszahnräder” abzudecken. “Training auf dem Testdatensatz” ist zur neuen Norm geworden.

Was macht es, wenn alle Benchmark-Tests übertroffen werden, aber dennoch keine allgemeine künstliche Intelligenz erreicht wird?

3.Cursor: Eine neue Ebene der LLM-Anwendungen

Am meisten beeindruckt hat mich bei Cursor (abgesehen von seinem rasanten Aufstieg in diesem Jahr), dass es überzeugend eine neue Ebene der “LLM-Anwendungen” offenbart hat, da die Leute anfangen, von “Cursor im XX-Bereich” zu sprechen. Wie ich in meinem Vortrag bei Y Combinator in diesem Jahr betont habe, liegt der Kern von LLM-Anwendungen wie Cursor darin, LLM-Aufrufe für spezifische vertikale Bereiche zu integrieren und zu orchestrieren:

- Sie sind für das “Kontextengineering” verantwortlich;

- Auf der unteren Ebene mehrere LLM-Aufrufe zu einem zunehmend komplexen gerichteten azyklischen Graphen orchestrieren, um die Balance zwischen Leistung und Kosten präzise abzuwägen; eine anwendungsspezifische grafische Benutzeroberfläche für die im “Menschen im Prozess” befindlichen Personen bereitstellen;

- Und bieten Sie einen “Selbstregulierungs-Schieberegler” an.

Im Jahr 2025 gibt es bereits zahlreiche Diskussionen über den Entwicklungsspielraum dieser aufkommenden Anwendungsebene. Wird die Plattform für große Sprachmodelle alle Anwendungen abdecken oder gibt es immer noch weite Bereiche für Anwendungen großer Sprachmodelle? Ich persönlich vermute, dass die Positionierung der Plattform für große Sprachmodelle allmählich darauf hinauslaufen wird, “Allround-Absolventen” auszubilden, während die Anwendungen großer Sprachmodelle dafür verantwortlich sind, diese “Absolventen” zu organisieren, zu verfeinern und durch die Bereitstellung von privaten Daten, Sensoren, Aktuatoren und Feedback-Schleifen zu echten “Fachteams” in bestimmten vertikalen Bereichen zu machen, die in der Praxis eingesetzt werden können.

4.Claude Code: Läuft lokal auf KI

Das Erscheinen von Claude Code hat erstmals überzeugend die Form von LLM-Agenten demonstriert, indem es auf eine zyklische Weise die Nutzung von Werkzeugen mit dem Denkprozess kombiniert, um nachhaltigere Lösungen für komplexe Probleme zu schaffen. Darüber hinaus beeindruckt mich an Claude Code, dass es auf dem persönlichen Computer des Benutzers läuft und tief mit der privaten Umgebung, den Daten und dem Kontext des Benutzers verbunden ist. Ich denke, dass OpenAI in dieser Hinsicht eine falsche Einschätzung hat, da sie den Schwerpunkt der Entwicklung von Code-Assistenten und Agenten auf die Cloud-Bereitstellung gelegt haben, d. h. auf containerisierte Umgebungen, die von ChatGPT orchestriert werden, und nicht auf lokale localhost-Umgebungen. Obwohl Cluster von in der Cloud betriebenen Agenten wie die “ultimative Form auf dem Weg zur allgemeinen künstlichen Intelligenz” erscheinen, befinden wir uns derzeit in einer Übergangsphase, in der die Fähigkeiten ungleich verteilt sind und der Fortschritt relativ langsam verläuft. In einer solchen Realität ist es sinnvoller, Agenten direkt auf den lokalen Computern zu implementieren, die eng mit den Entwicklern und deren spezifischen Arbeitsumgebungen zusammenarbeiten. Claude Code hat diese Priorität genau erfasst und in eine einfache, elegante und äußerst ansprechende Form eines Befehlszeilenwerkzeugs verpackt, wodurch die Darstellung von KI neu gestaltet wurde. Es ist nicht mehr einfach eine Website, die wie Google besucht werden muss, sondern ein kleiner Geist oder ein Gespenst, das “in deinem Computer wohnt”. Dies ist ein völlig neues, einzigartiges Paradigma der Interaktion mit KI.

5. Vibe Coding Atmosphäre Programmierung

Im Jahr 2025 hat KI eine entscheidende Fähigkeitsgrenze überschritten, die es ermöglicht, verschiedene erstaunliche Programme nur durch englische Beschreibungen zu erstellen, ohne dass die Menschen sich um den zugrunde liegenden Code kümmern müssen. Interessanterweise habe ich in einem Gedanken-Tweet während eines Bades das Wort “Vibe Coding” geprägt, als ich überhaupt nicht damit rechnete, dass es sich bis heute so entwickeln würde. Im Paradigma des Vibe Codings ist Programmierung nicht mehr strikt auf hochqualifizierte Fachleute beschränkt, sondern wird zu etwas, an dem jeder teilnehmen kann. Aus dieser Perspektive ist es ein weiteres Beispiel für das Phänomen, das ich in meinem Artikel “Empowering People: How Large Language Models Change Patterns of Technological Diffusion” beschreibe. Im krassen Gegensatz zu allen anderen Technologien bisher profitieren normale Menschen mehr von großen Sprachmodellen als Fachleute, Unternehmen und Regierungen. Aber Vibe Coding gibt nicht nur normalen Menschen Zugang zur Programmierung, sondern ermöglicht auch professionellen Entwicklern, mehr “Software zu erstellen, die sonst nicht realisiert worden wäre”. Bei der Entwicklung von nanochat habe ich durch Vibe Coding einen maßgeschneiderten, effizienten BPE-Tokenizer in Rust geschrieben, ohne auf vorhandene Bibliotheken oder ein tiefes Lernen von Rust angewiesen zu sein. In diesem Jahr habe ich auch mit Vibe Coding schnell mehrere Projektprototypen erstellt, nur um zu überprüfen, ob bestimmte Ideen machbar sind. Ich habe sogar eine ganze Einmalanwendung geschrieben, nur um einen bestimmten Fehler zu lokalisieren, weil der Code plötzlich kostenlos, kurzlebig, formbar und nach Gebrauch wegwerfbar wurde. Vibe Coding wird das Ökosystem der Softwareentwicklung neu gestalten und die Grenzen der beruflichen Definition tiefgreifend verändern.

6.Nano-Banane: LLM-Grafikoberfläche

Die Gemini Nano Banana von Google ist einer der disruptivsten Paradigmenwechsel des Jahres 2025. Meiner Meinung nach sind große Sprachmodelle das nächste bedeutende Rechenparadigma nach den Computern der 1970er und 1980er Jahre. Daher werden wir ähnliche Innovationen sehen, die auf denselben grundlegenden Ursachen basieren, ähnlich der Evolution von Personal Computern, Mikrocontrollern und sogar dem Internet. Besonders auf der Ebene der Mensch-Maschine-Interaktion ähnelt das aktuelle “Gespräch”-Modell mit LLM in gewissem Maße der Eingabe von Befehlen an Computerterminals in den 1980er Jahren. Text ist die ursprünglichste Datenrepräsentationsform für Computer (und LLM), jedoch nicht die bevorzugte Methode für Menschen (insbesondere beim Eingeben). Menschen empfinden tatsächlich eine Abneigung gegen das Lesen von Texten; es ist langsam und mühsam. Im Gegensatz dazu neigen Menschen dazu, Informationen durch visuelle und räumliche Dimensionen zu empfangen, was auch der Grund für die Entstehung grafischer Benutzeroberflächen in der traditionellen Computerwelt ist. In ähnlicher Weise sollten große Sprachmodelle in der Form kommunizieren, die den menschlichen Vorlieben entspricht, über Träger wie Bilder, Infografiken, Präsentationen, Whiteboards, Animationen, Videos und Webanwendungen. Die gegenwärtige frühe Form hat bereits durch Emoji und “visuelle Textdekorationen” wie Markdown (z.B. Überschriften, Fettdruck, Listen, Tabellen usw.) realisiert. Aber wer wird tatsächlich die grafische Benutzeroberfläche für große Sprachmodelle erstellen? Aus dieser Perspektive ist die Nano Banana der frühe Prototyp dieser zukünftigen Vision. Es ist bemerkenswert, dass der Durchbruch der Nano Banana nicht nur in der Bildgenerierungsfähigkeit selbst liegt, sondern auch in der integrativen Fähigkeit, die Textgenerierung, Bildgenerierung und Weltwissen in den Modellgewichten miteinander verwebt.