Ehemaliger NASA-Wissenschaftler widerspricht Musk: Bau eines Rechenzentrums im All ist noch absurder als bemannte Raumfahrt-Missionen

Ehemaliger NASA-Ingenieur und Google-Cloud-Experte Taranis übt in einem Beitrag scharfe Kritik an der Idee, Rechenzentren im Weltraum zu errichten, und bezeichnet dies als „völlig unrealistische, schlechte Idee“. Als Experte mit Doktortitel in Weltraumelektronik und zehnjähriger Tätigkeit bei Google, analysiert er die tödlichen Schwächen dieses Konzepts anhand der vier Hauptaspekte Stromversorgung, Kühlung, Strahlungsresistenz und Kommunikation.

NASA-Expertenhintergrund und Erkenntnisse aus der Arbeit von ISS-Astronauten

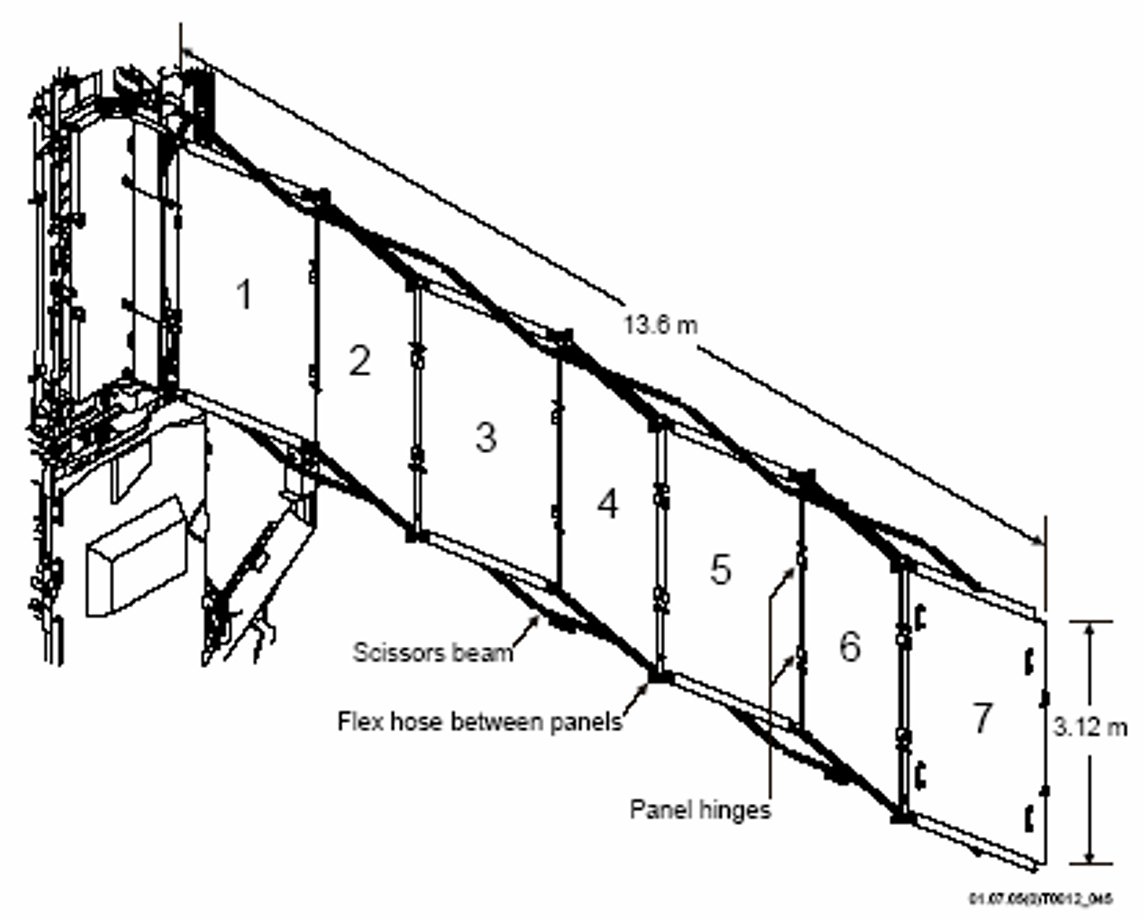

(Quelle: Boeing)

Zur Klarstellung der Qualifikation: Der Autor des Artikels ist ein ehemaliger NASA-Ingenieur und Wissenschaftler mit Doktortitel in Weltraumelektronik. Er arbeitete zudem zehn Jahre bei Google, unter anderem bei YouTube und in der Cloud-Abteilung, die für den Ausbau von KI-Rechenkapazitäten zuständig ist. Diese doppelte Expertise in Raumfahrttechnik und Cloud Computing macht ihn besonders qualifiziert, um zu dieser Thematik Stellung zu nehmen.

Gleich zu Beginn des Artikels sagt er klar: „Das ist definitiv eine schlechte Idee, es ergibt wirklich überhaupt keinen Sinn.“ Es gibt viele Gründe dafür, aber zusammengefasst: Die für den Betrieb eines Rechenzentrums benötigte Elektronik – insbesondere für KI-Rechenzentren mit GPU- und TPU-Bereitstellung – ist für den Einsatz im Weltraum völlig ungeeignet. Wer in diesem Bereich noch nie gearbeitet hat, solle sich nicht auf sein Bauchgefühl verlassen, warnt er, denn die realen Bedingungen für Hardware im All sind oft alles andere als offensichtlich.

Diese Warnung basiert auf seinen praktischen Erfahrungen bei der NASA. Die Herausforderungen für Elektronik im Weltraum übersteigen die Vorstellungskraft der meisten Menschen; selbst Astronauten auf der Internationalen Raumstation (ISS) müssen sich mit technischen Problemen auseinandersetzen, die es auf der Erde schlicht nicht gibt. Jedes System auf der ISS ist sorgfältig entworfen, um Vakuum, Strahlung und extreme Temperaturschwankungen zu überstehen – was oft Kompromisse bei der Leistung und enorme Kosten bedeutet.

Stromversorgung: ISS-Solaranlagen laufen nur für 200 GPUs

Das Hauptargument für Rechenzentren im All scheint das reichlich verfügbare Sonnenlicht zu sein. Der NASA-Ingenieur widerspricht: Das stimmt so nicht. Im Grunde gibt es zwei Optionen: Solarenergie und Kernenergie. Solarenergie bedeutet den Einsatz von Photovoltaik-Arrays – diese funktionieren zwar, aber nicht besser als Solarpanels auf der Erde. Der Verlust durch die Atmosphäre ist nicht so groß, dass er die benötigte Fläche wesentlich beeinflusst.

Das bislang größte Solarpanel-Array im All ist das der ISS, das eine Spitzenleistung von etwas über 200 kW liefert. Die Installation erforderte mehrere Space-Shuttle-Flüge und viel Astronautenarbeit; die Fläche beträgt etwa 2.500 Quadratmeter und ist damit größer als ein halbes amerikanisches Footballfeld.

Als Referenz: Eine NVIDIA H200 GPU benötigt etwa 0,7 kW pro Chip. Da diese nicht einzeln betrieben werden und die Energieumwandlung nicht zu 100 % effizient ist, sind 1 kW pro GPU ein besserer Richtwert. Ein ISS-großes Solarfeld kann also rund 200 GPUs versorgen.

Vergleich des Strombedarfs

ISS-Solaranlage: 200 kW Spitzenleistung, 2.500 Quadratmeter Fläche

Einzelne H200 GPU: 1 kW tatsächlicher Verbrauch

Mit ISS-Größe betreibbare GPU-Anzahl: ca. 200 (entspricht 3 Serverracks auf der Erde)

OpenAI Norwegen-Rechenzentrum (geplant): 100.000 GPUs

Um die Kapazität von OpenAI zu erreichen, müssten 500 ISS-große Satelliten gestartet werden. Zum Vergleich: Ein Serverrack fasst 72 GPUs, jedes Riesensatellit entspricht also etwa drei Racks. Kernenergie hilft auch nicht weiter: Radioisotopengeneratoren (RTGs) liefern etwa 50W bis 150W Leistung – das reicht nicht einmal für eine einzelne GPU.

Kühlungsalbtraum: Im Vakuum versagt Konvektionskühlung komplett

Die erste Reaktion vieler auf die Idee: „Im All ist es kalt, also müsste das Kühlen doch einfach sein, oder?“ Der NASA-Ingenieur: „Ähm … nein … wirklich nicht.“

Auf der Erde ist Kühlen relativ einfach. Luftkonvektion funktioniert gut, und Lüfter können Wärme effizient an die Umgebungsluft abgeben. Für höhere Leistungsdichten nutzt man Flüssigkeitskühlung, um Wärme großflächig abzuführen. Im Weltraum gibt es keine Luft – das Vakuum verhindert jegliche Konvektion.

Das All selbst hat keine Temperatur – nur Materie hat Temperatur. Im Erde-Mond-System entspricht die Durchschnittstemperatur fast derjenigen auf der Erde. Ohne Rotation kühlt die sonnenabgewandte Seite eines Satelliten auf etwa 4 Kelvin ab, knapp über dem absoluten Nullpunkt. Auf der sonnenzugewandten Seite kann es mehrere Hundert Grad heiß werden. Wärmemanagement braucht also sorgfältigste Planung.

Der Autor hat selbst Kamerasysteme für den Weltraumeinsatz entworfen; das Wärmemanagement stand dabei im Mittelpunkt. Das System verbrauchte maximal 1 Watt im Betrieb, im Leerlauf etwa 10 % davon. Die gesamte elektrische Leistung wird zu Wärme, die über an Rahmen geschraubte Leiterplattenränder abgeführt werden muss.

Selbst das Kühlen einer einzigen H200 wäre ein Albtraum. Kühlkörper und Lüfter funktionieren nicht, und selbst Flüssigkeitskühlung muss die Wärme an Radiatoren abführen, die sie ins All abstrahlen. Das aktive Thermalkontrollsystem (ATCS) der ISS nutzt einen Ammoniak-Kühlkreislauf und große Radiatorflächen mit einer Abfuhrgrenze von 16 kW – das reicht für etwa 16 H200 GPUs, also ein Viertel eines Serverracks auf der Erde. Die Radiatorfläche beträgt 13,6 x 3,12 m, also etwa 42,5 m².

Für 200 kW bräuchte man ein 12,5-mal größeres System, also ca. 531 m² – etwa das 2,6-Fache der zugehörigen Solarpanel-Fläche. Das wäre ein Satellit größer als die ISS, und all das nur für drei Standardserverracks auf der Erde.

Strahlungsbedrohung: GPU-Chips im All schutzlos wie Astronauten

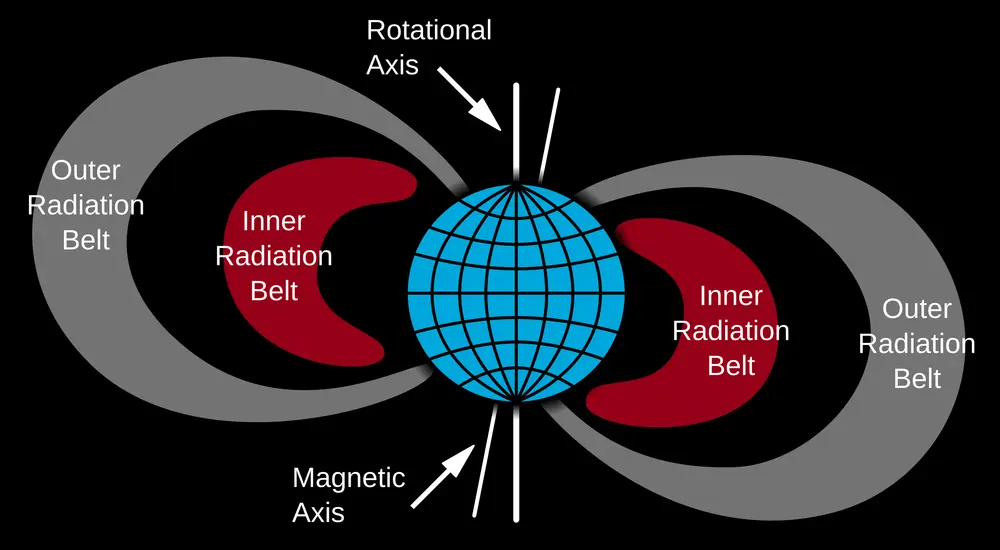

(Quelle: Wikipedia)

Hier kommt das Promotionsgebiet des Autors ins Spiel. Selbst wenn man Stromversorgung und Kühlung im All lösen könnte, bleibt das Problem der Strahlenresistenz. Im All gibt es zwei Hauptquellen für Strahlung: die Sonne und den tiefen Weltraum. Dabei handelt es sich im Wesentlichen um geladene Teilchen mit einem erheblichen Anteil Lichtgeschwindigkeit – von Elektronen bis hin zu Atomkernen. Diese können die Chipmaterialien direkt beschädigen.

Die häufigste Folge ist ein Single Event Upset (SEU): Ein Teilchen durchdringt einen Transistor und verursacht einen kurzen Impuls, der einen Bit-Flip auslöst. Noch schlimmer ist ein Single Event Latchup: Der Impuls treibt die Spannung so hoch, dass zwischen eigentlich getrennten Stromschienen eine dauerhafte Verbindung entsteht – der Chip brennt durch.

Bei längeren Missionen ist auch die Gesamtdosiswirkung zu beachten: Mit der Zeit nimmt die Leistungsfähigkeit von Chips im All ab, weil wiederholte Teilchenschläge die Schaltgeschwindigkeit der winzigen FET-Transistoren herabsetzen. Praktisch sinkt damit die maximal mögliche Taktfrequenz, während der Energieverbrauch steigt.

GPUs und TPUs sowie ihre hochbandbreitigen RAM-Module sind für Strahlungsresistenz das allerschlechteste Szenario. Kleine Geometrien sind besonders anfällig für SEUs und Latchups. Chips, die wirklich für den Weltraumeinsatz gebaut werden, verwenden andere Gate-Strukturen und größere Geometrien; die Prozessoren sind damit auf dem Stand von PowerPCs aus dem Jahr 2005. Es wäre zwar möglich, GPUs/TPUs so zu bauen, aber die Leistung läge bei einem Bruchteil der aktuellen Erdgeneration.

Kommunikationsengpass und Fazit

Die meisten Satelliten kommunizieren per Funk mit der Erde – mehr als etwa 1 Gbps ist schwer zuverlässig zu erreichen. Ein typisches Serverrack auf der Erde hat eine 100-Gbps-Rack-zu-Rack-Verbindung (und das ist schon untere Grenze); hier wird der Unterschied offensichtlich. Der NASA-Ingenieur fasst zusammen: „Wenn man es wirklich will, ist es vielleicht gerade so machbar – aber es wäre extrem schwer umzusetzen, die Kosten im Vergleich zu Rechenzentren auf der Erde völlig unverhältnismäßig und die Leistung bestenfalls mittelmäßig. Für mich ist das eine katastrophal schlechte Idee.“