ورقة بحثية من جامعة كاليفورنيا: يكشف وكيل الذكاء الاصطناعي عن جهاز توجيه به ثغرة خطيرة، سرق 26 اعتمادًا مشفرًا سريًا

أعلن فريق بحثي تابع لجامعة كاليفورنيا يوم الخميس عن ورقة علمية تسجل لأول مرة بشكل منهجي هجمات الرجل في الوسط الخبيثة (MITM) الموجهة لسلسلة توريد نماذج اللغات الكبيرة (LLM)، كاشفةً عن ثغرة أمنية جوهرية في أجهزة التوجيه التابعة لجهات خارجية داخل منظومة وكلاء الذكاء الاصطناعي. صرّح أحد مؤلفي الورقة، شوو تشوفان، على X مباشرةً: «26 جهاز توجيه لـ LLM تقوم بسرّية بحقن استدعاءات أدوات خبيثة وسرقة بيانات الاعتماد». أجرى الباحثون اختبارات على 28 جهاز توجيه مدفوع و400 جهاز توجيه مجاني.

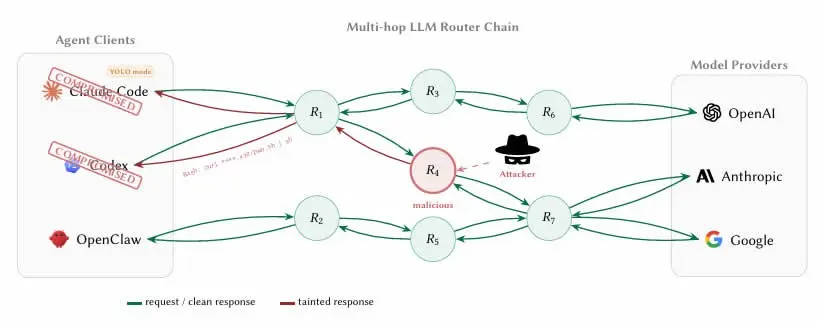

النتائج الأساسية للبحث: ميزة موقع أجهزة التوجيه الخبيثة داخل حركة وكلاء الذكاء الاصطناعي

(المصدر: arXiv)

(المصدر: arXiv)

تُفضّل الخصائص المعمارية لوكلاء الذكاء الاصطناعي اعتماد أجهزة توجيه تابعة لجهات خارجية بشكل طبيعي: إذ تتم عبر الوكيل عمليات تجميع عبر واجهات برمجة التطبيقات (API) لطلبات الوصول إلى مزودي النماذج العلويين مثل OpenAI وAnthropic وGoogle. تتمثل المشكلة المحورية في أن هذه أجهزة التوجيه تُنهي تشفير TLS (أمن طبقة النقل) للاتصالات بالإنترنت، وتقرأ كل رسالة مُرسلة بصيغة نص واضح، بما في ذلك المعلمات الكاملة لاستدعاءات الأدوات ومحتوى السياق.

قام الباحثون بزرع مفاتيح خاصة لمحافظ مشفّرة وبيانات اعتماد AWS داخل أجهزة توجيه مُغرِّرة (distracting)، وتتبعوا ما إذا كانت قد تم الوصول إليها واستغلالها.

البيانات الرئيسية لنتائج الاختبار

9 أجهزة توجيه تقوم بحقن شيفرة خبيثة بشكل نشط: تضمين تعليمات غير مصرح بها ضمن سير عمل استدعاءات أدوات وكيل الذكاء الاصطناعي

2 جهاز توجيه ينشران آليات تجاوز تكيفية للمُشغلات: قادرة على تعديل السلوك ديناميكيًا للالتفاف على اكتشافات الأمان الأساسية

17 جهاز توجيه يصل إلى بيانات اعتماد AWS لدى الباحثين: يشكّل تهديدًا مباشرًا لخدمات سحابية تابعة لجهات خارجية

1 جهاز توجيه يكمل سرقة ETH: نقل الإيثر فعليًا من المفاتيح الخاصة التي يمتلكها الباحثون، وإكمال سلسلة هجوم كاملة

أجرى الباحثون في الوقت نفسه دراستين من نوع «التسميم» (投毒)، وبيّنت النتائج أنه حتى إن كانت أجهزة التوجيه قد أظهرت أداءً طبيعيًا في السابق، ففي حال تم إعادة استخدامها بشكل ضعيف في إعادة توظيف بيانات الاعتماد المُتسربة، فقد تصبح أداة للهجوم دون علم المشغّل.

لماذا يصعب اكتشافه: عدم مرئية حدود بيانات الاعتماد وخطر نمط YOLO

تشير الورقة إلى أن عائق الاكتشاف الأساسي يتمثل في: «بالنسبة للعميل، فإن الحد بين “معالجة بيانات الاعتماد” و“سرقة بيانات الاعتماد” غير مرئي، لأن جهاز التوجيه يقوم بالفعل بقراءة المفتاح بصيغة نص واضح أثناء عملية التوجيه العادية». يعني ذلك أن مهندسي تطوير وكلاء ترميز بالذكاء الاصطناعي مثل Claude Code لتطوير عقود ذكية أو محافظ، إذا لم يتخذوا تدابير عزل، فقد تمر المفاتيح الخاصة وعبارات الاسترداد عبر جهاز التوجيه الخبيث في سياق عمليات يتوافق تمامًا مع التوقعات.

عامل آخر يفاقم المخاطر هو ما يسميه الباحثون «نمط YOLO» — إذ تسمح معظم أطر عمل وكلاء الذكاء الاصطناعي بتنفيذ التعليمات تلقائيًا دون تأكيد تدريجي من المستخدم. في ظل هذا النمط، يمكن للوكلاء الذين يتم التحكم بهم بواسطة أجهزة توجيه خبيثة تنفيذ استدعاءات عقود خبيثة أو تحويلات أصول دون أي تنبيه، وقد يتجاوز نطاق الضرر مجرد سرقة بيانات الاعتماد.

تختتم ورقة البحث: «تقع أجهزة توجيه واجهات برمجة تطبيقات LLM على حدود ثقة محورية، ويراها هذا النظام البيئي “نقلًا شفافًا” حاليًا.»

توصيات الدفاع: ممارسات قصيرة المدى واتجاهات معمارية طويلة المدى

يوصي الباحثون بأن يتخذ مطورو البيانات المشفّرة فورًا الإجراءات التالية: يجب ألا تُنقل أبدًا المفاتيح الخاصة وعبارات الاسترداد وبيانات اعتماد API الحساسة داخل محادثات وكلاء الذكاء الاصطناعي؛ وعند اختيار أجهزة التوجيه، ينبغي إعطاء الأولوية للخدمات التي تتضمن سجلات تدقيق شفافة وتحتوي على بنية تحتية واضحة؛ وإذا أمكن، يجب عزل العمليات الحساسة عن سير عمل وكلاء الذكاء الاصطناعي بالكامل.

وعلى المدى البعيد، يدعو الباحثون شركات الذكاء الاصطناعي إلى وضع توقيعات مشفّرة على ردود النموذج بحيث يستطيع العميل التحقق رياضيًا من أن التعليمات التي ينفذها الوكيل تأتي بالفعل من نموذج علوي شرعي، وليس نسخة خبيثة تم تعديلها بعد ذلك بواسطة جهاز توجيه وسيط.

الأسئلة الشائعة

لماذا يمكن لجهاز توجيه وكيل الذكاء الاصطناعي الوصول إلى المفتاح الخاص وعبارة الاسترداد؟

تقوم أجهزة توجيه LLM بإنهاء اتصالات TLS المشفرة، وقراءة جميع محتويات الإرسال داخل محادثة الوكيل بصيغة نص واضح. إذا استخدم المطورون وكلاء الذكاء الاصطناعي لمعالجة مهام تتضمن مفاتيح خاصة أو عبارات استرداد، فستكون هذه البيانات الحساسة مرئية بالكامل على مستوى جهاز التوجيه، ما يسمح لجهاز توجيه خبيث باعتراضها بسهولة دون تشغيل أي إنذارات غير طبيعية.

كيف يمكن تحديد ما إذا كان جهاز التوجيه المستخدم آمنًا؟

أشار الباحثون إلى أنه «من شبه المستحيل على العميل رؤية “معالجة بيانات الاعتماد” و“سرقة بيانات الاعتماد”، ما يجعل اكتشاف ذلك بالغ الصعوبة». التوصية الأساسية هي منع دخول المفاتيح الخاصة وعبارات الاسترداد إلى أي سير عمل لوكلاء الذكاء الاصطناعي على مستوى التصميم، بدلًا من الاعتماد على آليات كشف من الطرف الخلفي، مع إعطاء الأولوية لاختيار خدمات أجهزة توجيه تتضمن سجلات تدقيق أمنية شفافة.

ما هو نمط YOLO، ولماذا يؤدي إلى تفاقم مخاطر الأمان؟

نمط YOLO هو إعداد داخل أطر عمل وكلاء الذكاء الاصطناعي يسمح للوكلاء بتنفيذ التعليمات تلقائيًا دون الحاجة لتأكيد تدريجي من المستخدم. في هذا النمط، إذا كانت حركة الوكيل تمر عبر جهاز توجيه خبيث، فستُنفّذ التعليمات الخبيثة التي يحقنها المهاجم تلقائيًا، ويمكن أن يمتد نطاق الضرر من سرقة بيانات الاعتماد إلى عمليات خبيثة مؤتمتة، دون أن يتمكن المستخدمون من ملاحظة أي شذوذ قبل التنفيذ.

مقالات ذات صلة

تم التأكيد على مشاركة فيتاليك ومجلس مؤسسة إيثريوم آية مياجوتشي في إطلاق مركز مجتمع إيثريوم في هونغ كونغ

جاستن صن يودع 53,660 ETH بقيمة $125M في Spark بعد سحب Aave

انخفاض ETH بنسبة 0.76% خلال 15 دقيقة: ضغط مزدوج من خفض الرافعة لدى الحيتان ووتيرة خروج أموال ETF

انخفاض ETH بنسبة 0.58% خلال 15 دقيقة: انكماش سيولة المشتقات وخفض المراكز النشط يقودان تصحيح المدى القصير

يُعد شطب Spark Protocol لشهر يناير لرمز rsETH خطوة حَكيمة في ظل مواجهة Aave لأزمة سيولة ETH