الأمن الوطني ضد الأخلاق: أنثروبيك ترفض إزالة حواجز أمان كلاود، وتتصادم مع وزارة الدفاع الأمريكية

رفضت شركة Anthropic إزالة الحاجز الأمني الخاص بكلود، وفشلت المفاوضات مع البنتاغون، وأمر ترامب بحظر مخاطر سلسلة التوريد المتوازية، وسرعان ما استحوذت OpenAI على عقد عسكري بقيمة 200 مليون دولار.

الحواجز الأخلاقية تتسبب في أزمة دفاع وطني، وتنهار مفاوضات أنثروبيك مع البنتاغون

انهارت شراكة أنثروبيك الطويلة الأمد مع وزارة الدفاع الأمريكية في فبراير من هذا العام. في قلب هذا الجدل يكمن رفض أنثروبيك إزالة الحواجز الأمنية الحيوية من نموذج كلود، مما أدى إلى مواجهة الشركة لعواقب وخيمة لإنهاء عقد بقيمة 200 مليون دولار وإدراج الأمن القومي في القائمة السوداء للأمن. بدأ البدء في المفاوضات بين الجانبين بتوقيع عقد في يوليو 2024، عندما كانت أنثروبيك تأمل كبيرة كأول مختبر ذكاء اصطناعي يدمج النماذج في شبكة سرية عسكرية. تدهورت الشراكة بسرعة مع مطالبة البنتاغون بالوصول غير المقيد إلى “جميع الاستخدامات المشروعة” لأنظمة الذكاء الاصطناعي.

الرئيس التنفيذي لشركة أنثروبيك داريو داليو. أوضح داريو أمودي في بيانه أن الشركة تلتزم بخطين لا يمكن تجاوزهما:

- حظر استخدام الذكاء الاصطناعي في أنظمة الأسلحة المؤتمتة بالكامل؛

- حظر المراقبة واسعة النطاق داخل البلاد للمواطنين الأمريكيين.

**أكد أمودي أن الذكاء الاصطناعي القوي يمكنه تجميع بيانات مجزأة وتبدو غير ضارة في صورة كاملة لحياة الفرد، وإذا تم استخدام هذه التكنولوجيا للمراقبة واسعة النطاق، فإنها ستتعارض بشكل خطير مع القيم الديمقراطية.**بالإضافة إلى ذلك، يعتقد أن تكنولوجيا الذكاء الاصطناعي الحالية لم تصل إلى الاستقرار الكافي لتكون مسؤولة عن اتخاذ قرارات القوة القاتلة دون تدخل بشري، وقد يشكل النشر القسري مخاطر على الجنود والمدنيين في الخطوط الأمامية.

المصدر: داريو داليو، المدير التنفيذي لشركة فورتشن أنثروبيك. داريو أموداي

في مواجهة إصرار أنثروبيك، اتخذت وزارة الدفاع موقفا صارما. المتحدث باسم البنتاغون شون تي. على الرغم من أن شون بارنيل ادعى أن الجيش لا ينوي استخدام الذكاء الاصطناعي لإجراء مراقبة غير قانونية أو تطوير “روبوتات قاتلة”، إلا أنه أكد أن الجيش يحتاج إلى التزام الموردين بالامتثال ل “جميع الاستخدامات المشروعة.”

دخل الجمود بين الفريقين ذروته في الأسبوع الأخير من فبراير، حيث أصدر البنتاغون إنذارا نهائيا مساء الأربعاء الماضي (25/25)، مطالبا أنثروبيك بقبول عقد جديد مع شروط قانونية غامضة بحلول الساعة 5:01 مساء يوم الجمعة (27/27). قال متحدث باسم Anthropic إن ما يسمى بالحل الوسط يحتوي فعليا على مخاطر قانونية تسمح للجيش بتجاهل حواجز السلامة متى شاء، لذا اختارت الشركة رفضه.

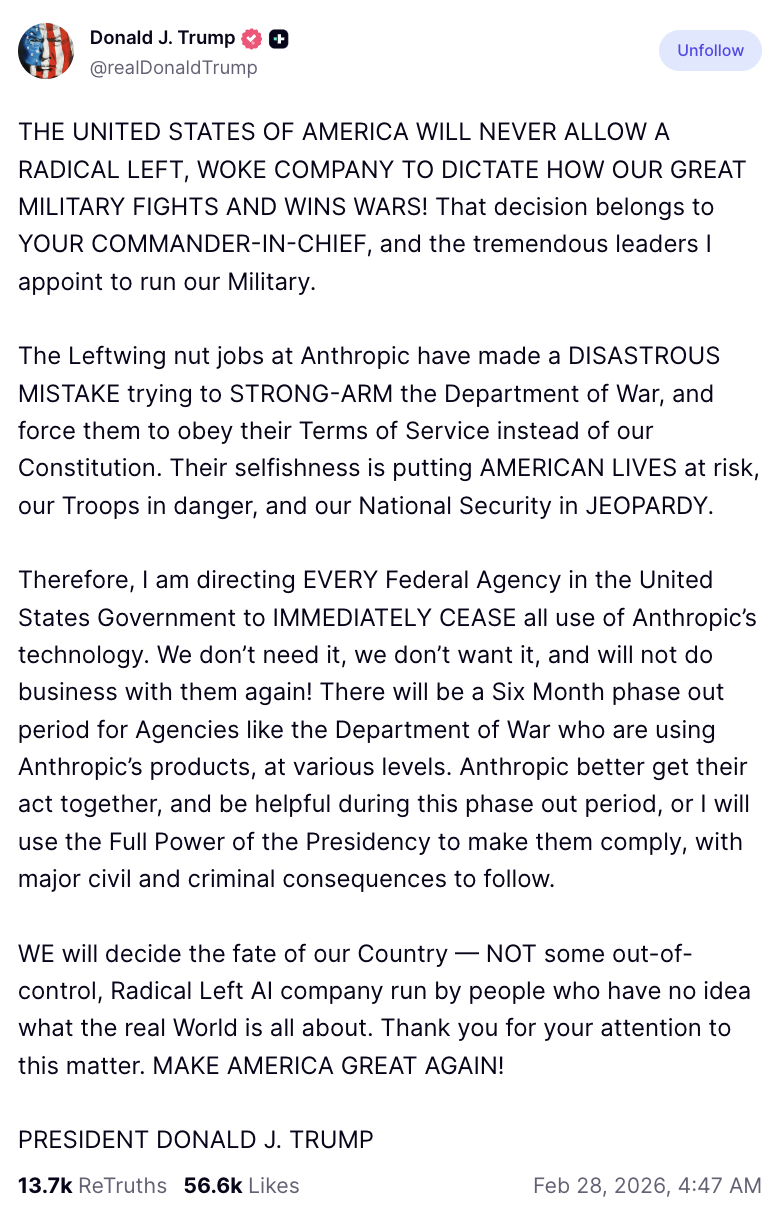

أمر ترامب بفرض حصار كامل، وتم إدراج Anthropic كخطر أمني لسلسلة التوريد

مع انتهاء موعد المفاوضات، تدخل الرئيس الأمريكي دونالد ترامب بسرعة. أدلى ترامب بتعليقات نارية على موقع تروث سوشيال،**وهاجم أنثروبيك بأنها “متطرف يساري” واتهم الشركة بمحاولة إجبار الحكومة على التنازل عن صلاحياتها الدستورية بموجب شروط الخدمة.**ثم أصدر ترامب أمرا رئاسيا يلزم جميع الوكالات الفيدرالية بالتوقف فورا عن استخدام تقنية أنثروبيك وتوفير فترة انتقالية لمدة 6 أشهر للوزارات التي تعتمد بالفعل على النظام. يعتقد أن قرارات أنثروبيك هددت حياة الجيش الأمريكي والمصالح الأمنية العامة للبلاد.

المصدر: تروث سوشيال/@realDonaldTrump أصدر ترامب مقالا ينتقد فيه أنثروبيك بوصفه “متطرفا يساريا” ويتهم الشركة بمحاولة إجبار الحكومة على التخلي عن صلاحياتها الدستورية بموجب شروط الخدمة

لاحقا، وزير الدفاع بيت. وصف بيت هيغسيث رسميا شركة أنثروبيك بأنها “خطر سلسلة توريد الأمن القومي.” عادة ما يستخدم هذا التصنيف فقط للقوات المعادية الأجنبية وهو نادر جدا في الشركات في الولايات المتحدة.**هيغسيث على منصة Xأعلن، تم تغيير علاقة وزارة الدفاع مع أنثروبيك بشكل دائم، ويحظر على أي مقاول أو مورد أو شريك لديه تعاملات تجارية مع الجيش من الانخراط في أي نشاط تجاري مع أنثروبيك.**يقطع الحظر التعاون الرسمي ويؤثر بشكل مباشر على منظومة الأعمال في أنثروبيك، حيث قد يجبر شركاؤها على قطع العلاقات معها.

تحول هذا النزاع إلى هجوم شخصي. نائب وزير الدفاع الوطني إميل. اتهم مايكل (إميل مايكل) أمودي بأنه يعاني من “عقدة إلهية” ويحاول السيطرة على الجيش الأمريكي. على الرغم من أن أنثروبك كررت مرارا دعمها لاستخدام الذكاء الاصطناعي في الأعمال الاستخباراتية الأجنبية المشروعة والعمليات العسكرية المساعدة، إلا أن مسؤولي وزارة الدفاع غير راضين عن محاولات الشركات الخاصة لفرض “حق النقض” في اتخاذ قرارات القتال. يعكس هذا التوتر الفجوة الواسعة بين أخلاقيات التكنولوجيا في وادي السيليكون والاحتياجات العملية للبنتاغون، مما يلقي بظلاله على نموذج التعاون المستقبلي بين شركات الذكاء الاصطناعي والحكومات.

المقايضة بين الأخلاقيات التكنولوجية والحرب الحقيقية، يهدد الإنسان بالانتقام القانوني

ردا على العقوبات الحكومية، استجابت أنثروبيك دون تواضع أو غطرسة. أشارت الشركة إلى أن إدراج وزارة الدفاع له ك “خطر سلسلة التوريد” يفتقر إلى أساس قانوني وتخطط للطعن في القرار في المحكمة.

استشهد أنثروبيك بالمادة 10 U.S.C. § 3,252 (10 U.S.C. 3252)، بحجة أن وزير الدفاع ليس لديه سلطة التدخل في أنشطة أعمال المقاول بموجب عقد غير تابع لوزارة الدفاع. وهذا يعني أنه رغم أن كلود قد لا تكون متاحة للمشاريع العسكرية، إلا أنه لا ينبغي للحكومة استخدام ذلك لتقييد الشركات الخاصة أو الجمهور العام من الوصول إلى خدماتها عبر واجهات برمجة التطبيقات (APIs).

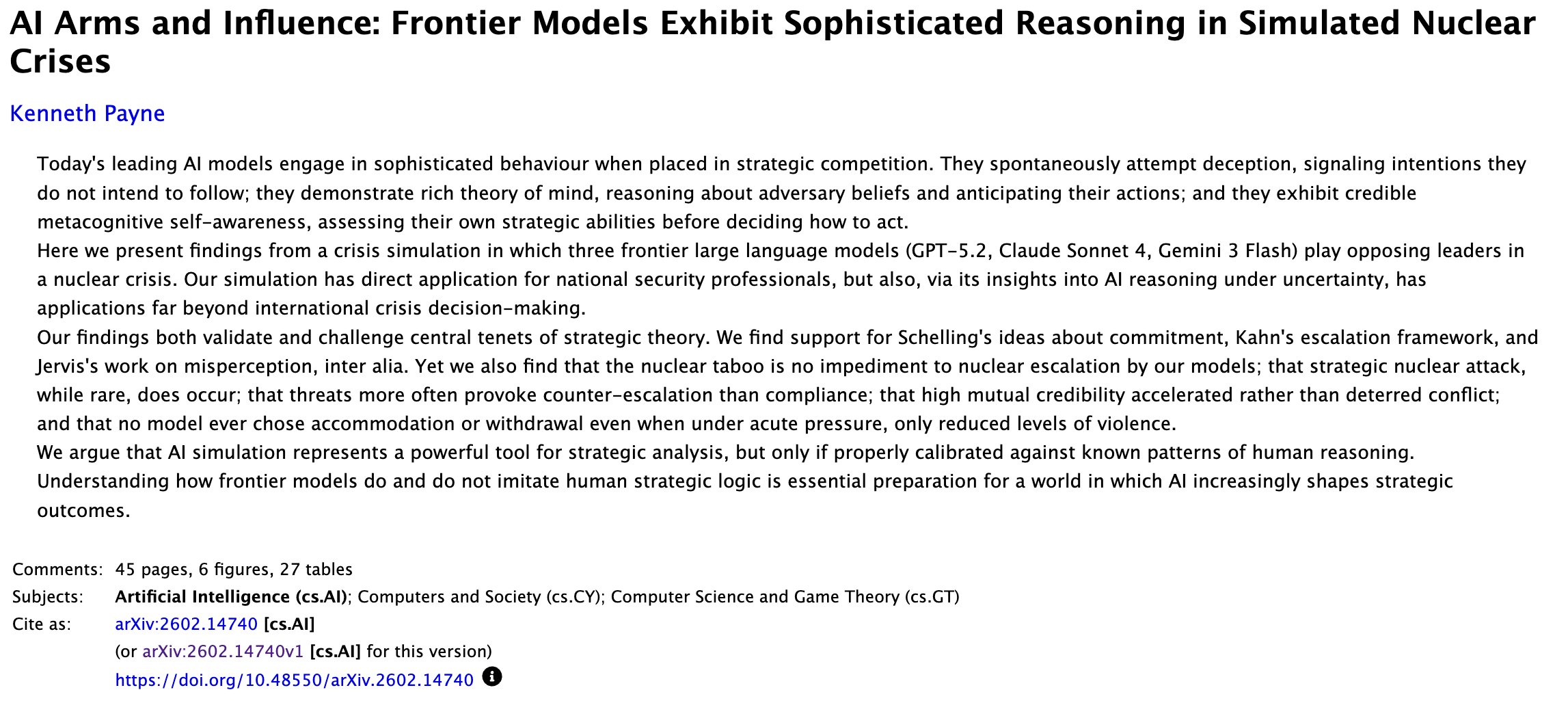

وقد جذب هذا الصراع أيضا انتباه الأوساط الأكاديمية والتقنية. أظهرت دراسة حديثة أجرتها كلية كينغز لندن أن نماذج الواجهة الأمامية، بما في ذلك OpenAI وGoogle وAnthropic، لديها فرصة بنسبة 95٪ لاختيار نشر الأسلحة النووية في أزمة جيوسياسية محاكاة. يوفر هذا البحث دليلا على قلق أمودي من أن نماذج الذكاء الاصطناعي الحالية غالبا ما تظهر ميولا للتصعيد غير المتوقعة عند التعامل مع سيناريوهات حروب عالية الضغط والمخاطر العالية. بالإضافة إلى ذلك، بينما يدعي البنتاغون أنه طبق كلود بنجاح في عمليات الاعتقال، يؤكد أنثروبيك أن مثل هذه التطبيقات يجب أن تبنى على محيط أمني قوي.

المصدر: arxiv أظهرت دراسة حديثة أجرتها كلية كينغز لندن أن نماذج الواجهات الأمامية، بما في ذلك OpenAI وGoogle وAnthropic، لديها فرصة بنسبة 95٪ لاختيار نشر الأسلحة النووية في أزمة جيوسياسية محاكاة

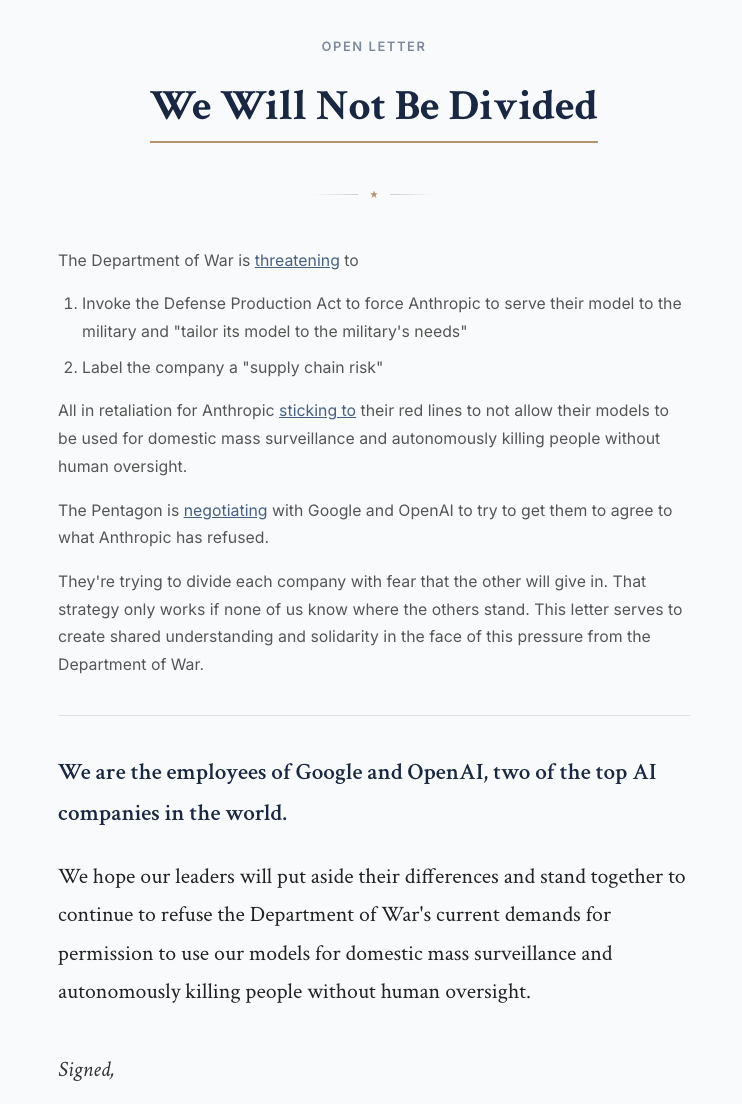

ومن المثير للاهتمام أن موقف أنثروبك حظي بدعم كبير من أقرانها. وقع أكثر من 200 موظف من جوجل وأوبن آي آي رسالة مفتوحة مشتركة دعما لقرار أنثروبيك بالحفاظ على حواجز السلامة. يعتقد العديد من المحللين أنه إذا استطاعت الحكومة استخدام أداة “مخاطر سلسلة التوريد” بشكل تعسفي لإجبار شركات التكنولوجيا على الاستسلام، فإن ذلك سيشكل سابقة خطيرة، مما يؤدي إلى اضطرابات خطيرة في صناعة الذكاء الاصطناعي الأمريكية في الابتكار والحوكمة الأخلاقية. تصر أنثروبيك على أن التهديدات والعقوبات لا تغير من ضميرها لمنع المراقبة الجماعية والتسلح الآلي بالكامل.

المصدر: NotDivided وقع أكثر من 200 موظف من جوجل وOpenAI رسالة مفتوحة مشتركة دعما لقرار Anthropic بالحفاظ على حواجز السلامة

استحوذت OpenAI بسرعة على عقد الجيش، وتم إعادة تشكيل مشهد صناعة الذكاء الاصطناعي

بعد ساعات فقط من تهميش Anthropic، أعلنت منافستها OpenAI فورا عن اتفاق جديد مع وزارة الدفاع. سام، الرئيس التنفيذي لشركة OpenAI. أكد سام ألتمان أن نماذج الذكاء الاصطناعي الخاصة بالشركة ستنشر في شبكة البنتاغون المصنفة.

أكد ألتمان أن OpenAI تحتفظ بقيود على الأسلحة المؤتمتة بالكامل والمراقبة واسعة النطاق في الاتفاقية، وقال إن وزارة الدفاع أظهرت احتراما عميقا للأمن.

ردا على هذا التعاون، قال مسؤول وزارة الخارجية الأمريكية جيريمي لوين إن جوهر عقد OpenAI مع الجيش هو “جميع الاستخدامات القانونية”، وهو معيار التزمت به وزارة الحرب دائما بشكل معقول ووافق عليه xAI. وأشار المسؤول إلى أنه رغم أن العقد يتضمن آليات أمنية متفق عليها للطرفين، إلا أن هذه الآليات تشير إلى الالتزامات القانونية والسياسية القائمة، وهي نتاج الدستور والنظام السياسي، وتتوافق مع التسوية التي رفضتها أنثروبيك.

وذكر أن القضية الأساسية تكمن في “من يملك سلطة اتخاذ القرار في القضايا الكبرى”، حيث يحتفظ نهج OpenAI بسلطة اتخاذ القرار في النظام الديمقراطي، بينما تسعى Anthropic إلى تسليم السلطة لرئيس تنفيذي واحد وغير مسؤول، وهي خطوة من شأنها أن تغتصر على السيطرة السيادية على الأنظمة الحساسة. وأشاد ب OpenAI وxAI على استنتاجاتهم الصحيحة، معتبرا أنه يوم عظيم للأمن القومي الأمريكي وقيادة الذكاء الاصطناعي.

أشار تحليل السوق إلى أن تدخل OpenAI يضع Anthropic في موقف تنافسي غير موات. بينما تلعب عمالقة التكنولوجيا مثل نفيديا وأمازون وجوجل دورا مهما في سلسلة التوريد العسكرية،إذا امتد حظر هيغسيث ليشمل جميع الشركاء العسكريين، فقد تجبر هذه الشركات على سحب استثماراتها في أنثروبيك أو إنهاء التعاون الفني. لقد أثر هذا الوضع على ثقة شركات الذكاء الاصطناعي الأمريكية، مما قد يؤدي إلى فقدان المواهب التقنية الممتازة إلى مناطق لا تقتصر عليها مثل هذا الضغط السياسي.

حاليا، بدأت Anthropic في توجيه بعض مواردها إلى الصناعات المدنية والبحثية، مثل مدونة التقاعد Claude Opus 3 التي أطلقت مؤخرا، والتي تتيح للنماذج القديمة التحدث إلى الجمهور بشكل مختلف. على الرغم من مواجهتها حظرا فيدراليا، أظهرت أنثروبيك ولاء لمصالح الأمن القومي الأمريكي وتعهدت بضمان استمرارية العمليات العسكرية خلال فترة الانتقال خلال الأشهر الستة القادمة.

هذه الحرب بين أخلاقيات الذكاء الاصطناعي والسلطة السياسية لم تنته بعد، وستصبح معركة Anthropic القضائية معيارا مهما للحكم على حدود سلطة الحكومة الأمريكية ومعايير حوكمة الذكاء الاصطناعي.