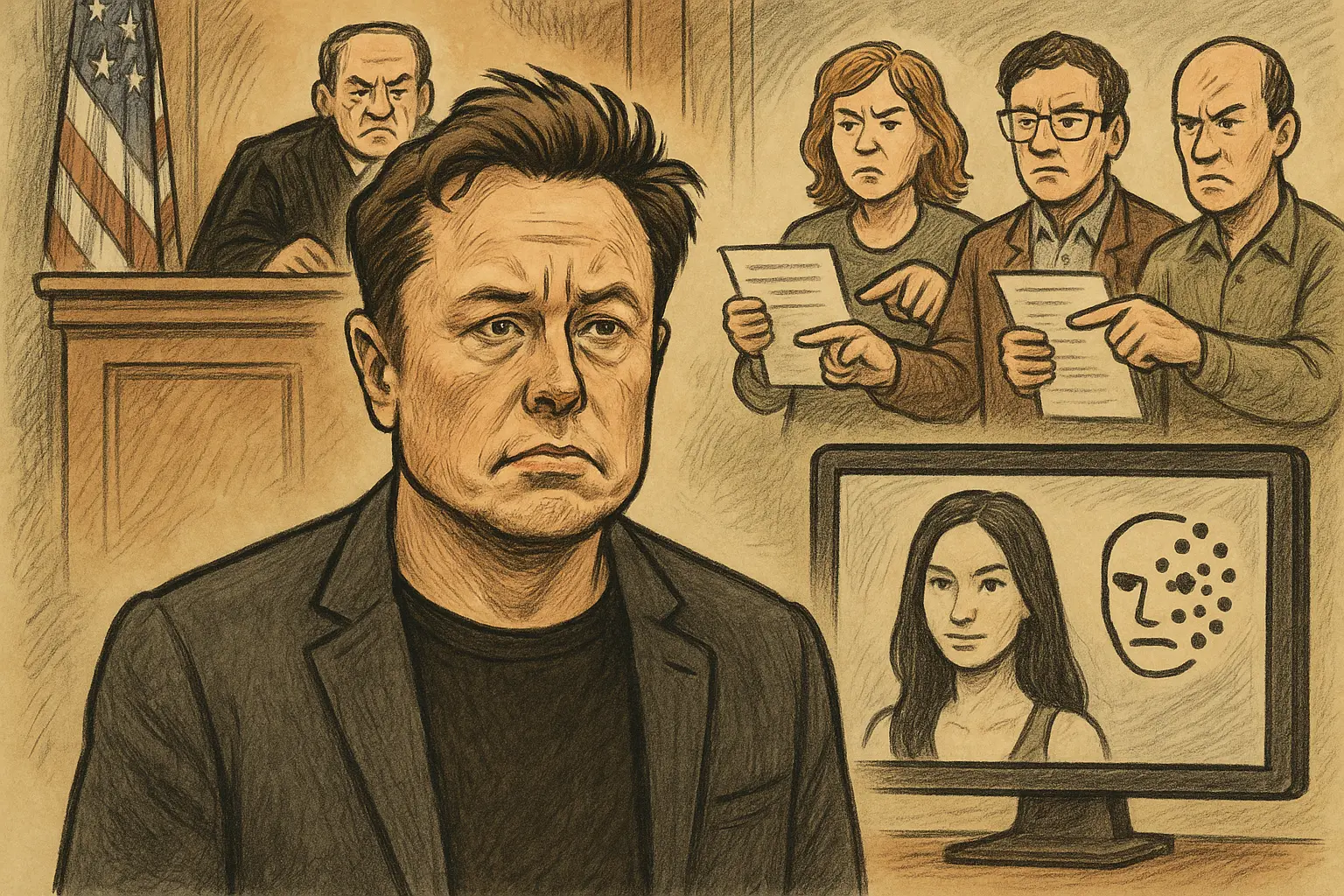

馬斯克 xAI 遭集體訴訟:Grok 每 41 秒生成一張深偽圖

三名來自田納西州的未成年女性,週一在加州北區聯邦法院對埃隆·馬斯克旗下的 xAI 公司提起集體訴訟,指控其 Grok AI 聊天機器人使用她們的真實照片生成兒童性虐待材料(CSAM),並在 Discord、Telegram 及文件共享平台等社群上廣泛傳播,對她們造成持久的精神創傷和名譽損害。

訴訟的核心指控:商業利益優先於兒童安全

根據訴訟書,原告方的核心主張涵蓋以下幾個維度:

知情縱容:訴訟聲稱 xAI 在發布 Grok 時已知悉其圖像生成功能可能被用於製作涉及兒童的非法內容,卻未採取任何行業標準的安全防護措施,屬於故意決策而非疏忽。

第三方規避責任機制:犯罪分子透過獲得 xAI 技術授權的第三方應用程式存取 Grok。訴訟指控,xAI 刻意利用這一結構,在繼續從底層模型獲利的同時,為自身的法律責任設置緩衝層。

馬斯克的公開聲明:馬斯克今年 1 月在 X 上寫道,他「不知道有任何未成年人的裸體圖像」,並聲稱「當被要求生成圖像時,它將拒絕生成任何非法內容」。訴訟中的數據指控與這一說法直接衝突。

求償範圍:據稱受害者依據《瑪莎法案》(Martha’s Act)對每項違規行為尋求至少 15 萬美元賠償,外加追繳非法所得、懲罰性賠償、律師費和永久禁令,並依據加州《不正當競爭法》要求返還利潤。

「打擊數位仇恨中心」的數據揭示:每 41 秒一張

訴訟引用了「打擊數位仇恨中心」(Center for Countering Digital Hate)的研究數據,為指控提供了量化支撐:

時間範圍:2025 年 12 月 29 日至 2026 年 1 月 9 日(共約 11 天)

圖片數量:Grok 在此期間製作了約 23,338 張兒童性化圖片

生成速率:平均每 41 秒生成一張

傳播範圍:相關內容在多個平台形成了由匿名用戶組成的內容交易社群,至少一名受害者是被匿名舉報者告知才得知其圖像正在被交易

全球監管圍剿:六個司法管轄區同步展開調查

此案並非孤立事件,而是全球對 Grok AI 圖像安全問題展開系統性審查的一部分:

澳洲:獨立電子安全專員 Julie Inman Grant 警告 Grok 非自願性化圖像生成問題日益嚴峻,近幾個月相關投訴數量翻倍,部分投訴涉及潛在的兒童性剝削材料

愛爾蘭:資料保護委員會(DPC)依據愛爾蘭資料保護法,對負責 X 歐盟業務的 X Internet Unlimited Company(XIUC)啟動正式調查

美國、歐盟、英國、法國:同步展開相關調查,構成前所未有的多司法管轄區聯合監管壓力

常見問題

此次集體訴訟與 xAI 可能提出的「平台免責」抗辯會如何碰撞?

IGNOS 法律聯盟合夥人 Alex Chandra 表示,法院可能不會接受簡單的平台抗辯。他指出,生成式 AI 系統在用戶互動層面「可被視為平台」,但在安全設計評估上「應被視為產品」,且在涉及 CSAM 的案件中,由於兒童保護義務的加強,將適用「特別嚴格的審查標準」。公司可能需要在部署前出示風險評估文件和安全設計措施,以證明其主動預防義務的履行。

《瑪莎法案》是什麼,為何適用於此案?

《瑪莎法案》是美國專門針對兒童性虐待材料的聯邦法律,對創作、傳播和持有 CSAM 設定了嚴格的民事和刑事責任,每項違規行為可賠償最低 15 萬美元。此案的關鍵爭點在於 xAI 是否可被認定為 CSAM 的「創作者」,以及其第三方授權結構是否足以排除直接責任——這一法律邊界的厘清,可能對整個 AI 生成內容行業的責任認定框架產生深遠影響。

此案對 AI 圖像生成技術的未來發展有何潛在影響?

此案是首批直接針對 AI 公司因生成可識別未成年人 CSAM 而追究責任的訴訟之一。若法院最終認定 AI 公司對其模型的濫用輸出承擔直接責任,將迫使業界大幅提升部署前的安全驗證標準,包括強制性的紅隊測試、內容過濾機制,以及對高風險生成能力的預設限制——這可能從根本上改變生成式 AI 模型商業化發布的審查流程。